Немного изменив название известного телешоу: Дети делают самые ужасные вещи. Недавно исследователи из Германии и Великобритании провели исследование, опубликовано в журнале Научная робототехника, что продемонстрировало, насколько дети восприимчивы к давлению сверстников-роботов. Версия TLDR: ответ на старый родительский вопрос: «Если бы все твои друзья сказали тебе спрыгнуть со скалы, ты бы это сделал?» вполне может быть: «Конечно. Если бы все мои друзья были роботами».

Содержание

- Действительно ли взрослые настолько умнее?

- У каждого корабля есть кораблекрушение

Тест воспроизводил знаменитый эксперимент 1951 года, впервые проведенный польским психологом Соломоном Ашем. Эксперимент продемонстрировал, как на людей может влиять давление группового мышления, даже если это противоречит информации, которую они считают правильной. В экспериментах Аша группа студентов колледжа собралась вместе и показала две карточки. На карточке слева было изображение одной вертикальной линии. На карточке справа изображены три линии разной длины. Затем экспериментатор спросил участников, какая линия на правой карточке соответствует длине линии, показанной на левой карточке.

Рекомендуемые видео

«Особенность детей этой возрастной категории заключается в том, что они все еще находятся в том возрасте, когда они уже не верят».

Пока все так просто. Однако ситуация стала более коварной в составе группы. Только один человек из группы был подлинным участником, тогда как все остальные были актерами, которым заранее сказали, что говорить. Эксперимент заключался в том, чтобы проверить, согласится ли настоящий участник с остальной частью группы, если они единогласно дадут неправильный ответ. Как оказалось, большинство так и сделали. Давление со стороны сверстников означает, что большинство людей будут отрицать информацию, которая явно верна, если это означает соответствие мнению большинства.

Связанный

- Развивающиеся, самовоспроизводящиеся роботы уже здесь, но не беспокойтесь о восстании

- Роботы не придут, чтобы украсть вашу работу. Они придут, чтобы улучшить его

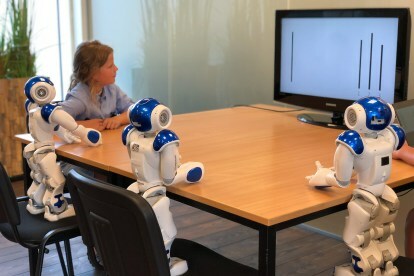

В ремиксе эксперимента 2018 года был использован тот же принцип — только вместо группы сверстников студенческого возраста «настоящим участником» был ребенок в возрасте от семи до девяти лет. «Актеров» играли три робота, запрограммированные давать неправильный ответ. В выборке из 43 добровольцев 74 процента детей дали тот же неправильный ответ, что и роботы. Результаты показывают, что большинство детей этого возраста будут относиться к давлению со стороны роботов так же, как к давлению со стороны своих сверстников из плоти и крови.

«Особенность детей этой возрастной категории заключается в том, что они все еще находятся в том возрасте, когда они уже не верят», Тони Белпаеме, профессор интеллектуальных и автономных систем управления, который помогал проводить исследование, рассказал Digital Trends. «Они будут играть с игрушками и при этом верить, что их фигурки или куклы настоящие; они все равно посмотрят кукольный спектакль и действительно поверят в происходящее; они, возможно, все еще верят в [Санта-Клауса]. То же самое, когда они смотрят на робота: они видят не электронику и пластик, а скорее социальный характер».

Интересно, что эксперимент противопоставил это реакции взрослых. В отличие от детей, на взрослых ошибки роботов не повлияли. «Когда взрослый увидел, что робот дает неправильный ответ, он озадаченно посмотрел на него, а затем дал правильный ответ», — продолжил Белпэме.

Тогда не о чем беспокоиться? Пока мы не позволяем детям брать в руки роботов, запрограммированных давать плохие ответы, все будет в порядке, верно? Не будь таким быстрым.

Действительно ли взрослые настолько умнее?

Как признал Белпэме, эта задача была задумана настолько простой, что не было никакой неопределенности относительно того, каким может быть ответ. Реальный мир другой. Когда мы думаем о видах работ, которые с готовностью передаются машинам, зачастую это задачи, которые мы, люди, не всегда можем выполнить идеально.

Эта задача была задумана настолько простой, что не было никакой неопределенности относительно того, каким может быть ответ.

Возможно, задача невероятно проста, но машина может выполнить ее значительно быстрее, чем мы. Или это может быть более сложная задача, в которой компьютер имеет доступ к гораздо большему объему данных, чем мы. В зависимости от потенциального воздействия выполняемой работы неудивительно, что многие из нас будут недовольны ремонтом машины.

Будет ли медсестра в больнице рада отменить решение Алгоритм, одобренный FDA которые могут помочь расставить приоритеты в отношении здоровья пациентов путем мониторинга жизненно важных показателей и последующей отправки предупреждений медицинскому персоналу? Или водителю будет удобно сесть за руль беспилотного автомобиля, когда он сталкивается с особенно сложной дорожной ситуацией? Или даже пилот, игнорирующий автопилот, потому что считает, что принимается неправильное решение? Во всех этих случаях нам хотелось бы думать, что ответ «да». Однако по разным причинам это может быть не так.

Николас Карр пишет об этом в своей книге 2014 года. Стеклянная клетка: куда нас ведет автоматизация. То, как он это описывает, подчеркивает ту двусмысленность, с которой сталкиваются реальные случаи автоматизации, когда проблемы заключаются в следующем. гораздо сложнее, чем длина строки на карте, машины намного умнее, и результат потенциально более ключевой.

«Как вы оцениваете затраты, связанные с ослаблением усилий и вовлеченности, ослаблением свободы воли и самостоятельности или незначительным ухудшением навыков? Нельзя», — пишет он. «Это те призрачные, нематериальные вещи, которые мы редко ценим до тех пор, пока они не исчезнут, и даже тогда у нас могут возникнуть проблемы с выражением потерь в конкретных терминах».

«Это те призрачные, нематериальные вещи, которые мы редко ценим до тех пор, пока они не исчезнут».

Социальные роботы, о которых Белпаеме теоретизирует в исследовательской работе, еще не стали мейнстримом, но уже есть иллюстрации некоторых из этих загадок в действии. Например, Карр открывает свою книгу упоминанием записки Федерального управления гражданской авиации, в которой отмечается, что пилотам следует тратить меньше времени на полеты на автопилоте из-за связанных с этим рисков. Это было основано на анализе данных о катастрофах, который показал, что пилоты часто слишком сильно полагаются на компьютеризированные системы.

Похожий случай касался иска 2009 года, в котором женщина по имени Лорен Розенберг подал иск против Google после того, как ему посоветовали идти по маршруту, ведущему к опасному движению. Хотя дело было прекращено в суде, оно показывает, что люди пренебрегают собственным здравым смыслом, полагая, что машинный интеллект обладает большим интеллектом, чем мы.

У каждого корабля есть кораблекрушение

В конечном счете, как признает Белпаеме, проблема в том, что иногда мы хотим передать принятие решений машинам. Роботы обещайте выполнять скучную, грязную и опасную работу — и если нам приходится подвергать сомнению каждое решение, то на самом деле это не те трудосберегающие устройства, которые были обещаны. Если мы собираемся в конечном итоге пригласить роботов в свой дом, мы хотим, чтобы они могли действовать автономно, а это потребует определенного уровня доверия.

«Роботы, оказывающие на вас социальное давление, могут быть полезными; оно не обязательно должно быть зловещим», — продолжил Белпаеме. «Если у вас есть роботы, используемые в здравоохранении или образовании, вы хотите, чтобы они могли влиять на вас. Например, если вы хотите похудеть, вам могут предоставить на два месяца робота для похудения, который мониторы потребление калорий и побуждает вас больше заниматься спортом. Вы хотите, чтобы такой робот был убедительным и влиял на вас. Но любая технология, которую можно использовать во благо, может быть использована и во зло».

Какой на это ответ? Подобные вопросы будут обсуждаться в каждом конкретном случае. Если плохое в конечном итоге перевесит хорошее, такие технологии, как социальные роботы, никогда не станут популярными. Но важно, чтобы мы извлекли правильные уроки из исследований, подобных исследованию о давлении со стороны сверстников, вызванном роботами. И дело не в том, что мы настолько умнее детей.

Рекомендации редакции

- Будущее автоматизации: роботы приходят, но они не отнимут вашу работу

- Эти роботы уничтожают сорняки электрошокером, поэтому фермерам не нужны химические гербициды