Como um par de tênis que alguém está usando? Ou talvez um vestido? Existem alguns aplicativos e serviços - como Vaga-lume da Amazon ou Samsung Visão Bixby - que permitem simplesmente apontar a câmera do smartphone para o objeto e procurá-lo, ou estilos semelhantes. O Google está seguindo o exemplo com um recurso semelhante no Google Lens, mas tem potencial para alcançar muito mais pessoas.

Vídeos recomendados

Lente do Google está atualmente incorporado ao Google Assistente sobre Android telefones, bem como Google Fotos. Ele permite que você aponte o Smartphone câmera em objetos para identificá-los, ensinar mais sobre pontos de referência, reconhecer códigos QR, extrair informações de contato de cartões de visita e muito mais. Em sua conferência anual de desenvolvedores do Google I/O, a gigante das buscas anunciou quatro novas melhorias para o Lens, e pudemos testá-las.

Integrado em aplicativos de câmera

O Google Lens agora está integrado ao aplicativo de câmera em telefones de 10 fabricantes: LG, Motorola, Xiaomi, Sony, Nokia, Transsion, TCL, OnePlus, BQ, Asus. Isso não inclui o próprio Google Google Pixel 2. Você ainda pode acessá-lo através Google Assistente em todos

Relacionado

- Em breve, seu Apple Card terá sua própria conta poupança – é assim que parece

- O novo aplicativo Google Wallet chegou e é assim que parece

- O Google adiciona uma pasta privada de fotos bloqueadas aos iPhones para fotos ‘pessoais’

Tivemos a oportunidade de experimentá-lo no recentemente anunciado LG G7 ThinQ, e a nova opção fica ao lado do modo retrato do telefone.

Combinação de estilo

A maior adição ao Lens neste anúncio de I/O é o Style Match. Como Bixby Vision ou Amazon Firefly, você pode apontar o

É relativamente rápido e uma maneira fácil de encontrar coisas que você não consegue escrever na barra de Pesquisa do Google.

Seleção inteligente de texto

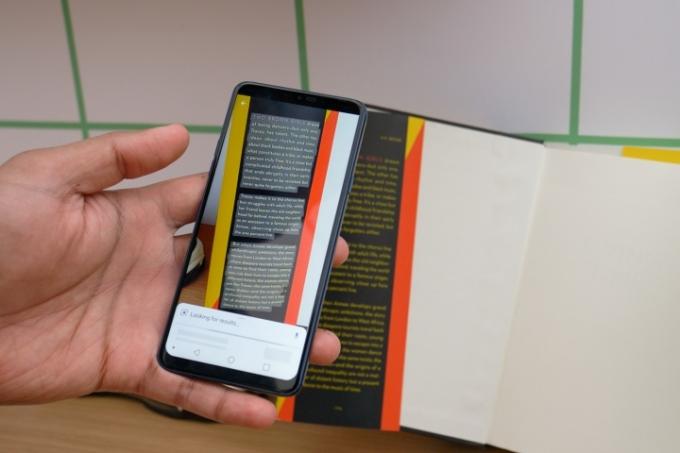

Talvez ainda mais útil seja a Seleção Inteligente de Texto. Aponte o Google Lens para o texto, digamos como em um livro ou menu, e ele pode destacar o texto de todo o resto. Você pode então tocar no texto e copiá-lo ou traduzi-lo. Quando tentamos, o Lens conseguiu capturar três parágrafos inteiros de texto, embora tivéssemos que fazer mais testes para ver quão bem ele consegue captar texto manuscrito.

Tempo real

O Google Lens agora funciona em tempo real, então você não precisa pausar e tirar foto para ele entender o assunto. Isso significa que você pode apontá-lo para várias coisas e vê-lo criando pontos coloridos nos objetos para os quais coleta informações. O Google disse que está identificando bilhões de palavras, frases e coisas em uma fração de segundo, tudo graças ao “aprendizado de máquina de última geração, inteligência no dispositivo e TPUs na nuvem”.

O Google disse que lançará todos esses recursos no final de maio.

Recomendações dos Editores

- Esta é a aparência dos telefones Android sem o iPhone

- Este novo recurso do Google Lens parece saído de um filme de ficção científica

- Esta é a aparência do Pixel Watch do Google no pulso

- O preço do Google Pixel 6 parece corresponder ao do iPhone 13 da Apple

- A Apple agora permite mover facilmente o conteúdo do iCloud Photos para o Google Photos

Atualize seu estilo de vidaDigital Trends ajuda os leitores a manter o controle sobre o mundo acelerado da tecnologia com as últimas notícias, análises divertidas de produtos, editoriais criteriosos e prévias únicas.