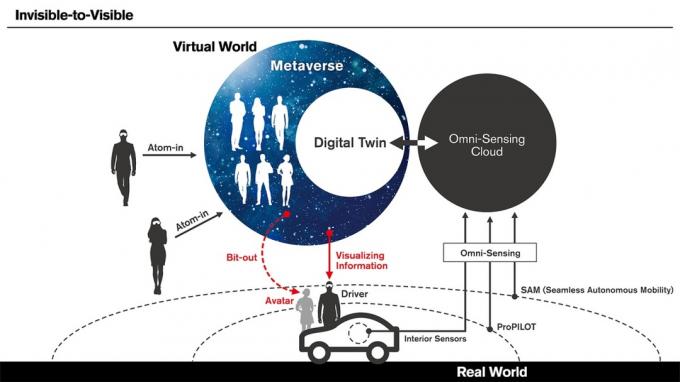

Nissans ingeniører jobber med mer enn bare biler. På CES 2019 avduket den japanske bilprodusenten "usynlig-til-synlig" (I2V) teknologi som kobler biler til en virtuell verden de kaller "Metaverse." Den lar sjåfører "se" inne i bygninger for å finne parkeringsplasser eller få kjøretimer fra virtuelle avatarer. Det høres kanskje ut som science fiction, men Nissan begynte nylig å teste I2V på det japanske prøveområdet.

Digital Trends tok nylig kontakt med Roel de Vries, Nissans globale sjef for markedsføring og merkevarestrategi, på 2019 New York Auto Show for å få hele historien på I2V.

Anbefalte videoer

Digitale trender: Hvor kom ideen om å gjøre dette fra?

Roel de Vries: Måten vi er strukturert på, og jeg tror mange bilselskaper er strukturert, men vi har det vi kaller avansert prosjektering, vi har prosjektering, og så har vi produktplanlegging.

Måten dette normalt fungerer på er at i avansert ingeniørfag har du dette superavanserte stadiet, som er der folk arbeider med spørsmål om «Ok, hva er fremtiden for mobilitet? Hva er fremtiden for teknologi?" Vi har folk med doktorgrad, det vi kaller stipendiater, som er ganske frie til å gjøre hva de vil. De får ganske mye penger for å virkelig komme seg ut og bare utforske og gjøre ting.

"Hvis bilen vår blir mer og mer autonom, må den samhandle mer og mer med omverdenen."

Hvor dette spesifikt kommer fra, I2V, er det denne konstante utviklingen rundt hvordan vi gjør biler tryggere, og hvordan gjør vi opplevelsen til mennesker inne i biler bedre, og hvordan kan vi bruke teknologi og data til å gjøre det at. Hvis bilen vår blir mer og mer autonom, må den samhandle mer og mer med omverdenen. Ellers kan den ikke være autonom.

Noen ganger sier du at du har ett nivå av autonom, som er "Jeg har bilen min, jeg har mange sensorer og radar og ekkolodd," og denne maskinen sjekker hele tiden rundt den.

Men den er egentlig ikke klar over omgivelsene.

Den er egentlig ikke klar over hva som skjer rundt hjørnet. Ingeniørene er konstant opptatt med hvordan de skal gå utover [det]. Så hvordan ser jeg rundt hjørnet? Vel, jeg vet ikke fordi denne tingen ikke kan se gjennom en bygning. Så nå må du koble deg til noe annet enn deg selv.

Nissan og Docomo tester Invisible-to-Visible-teknologi ved å bruke 5G i kjøretøy i bevegelse

Hvor kommer I2V fra? Det er utelukkende fra det. For å være virkelig autonom, må bilen kunne gjøre denne typen ting for sikkerhet og autonom teknologiutvikling. Så har du historien rundt "Hvordan gjør jeg kjøringen morsom og underholdende når jeg kjører?"

Det er så mange datapunkter der ute, og du kan koble disse datapunktene og nesten skape en verden som er der ute, og skape den verden hvor som helst. Så jeg kan ta med det som er rundt hjørnet inn i bilen min. Det er der navnet kommer fra, fordi det usynlige blir synlig.

"Det er så mange datapunkter der ute, og du kan koble disse datapunktene og nesten skape en verden."

For ingeniørene er det ganske enkelt. Så da jeg sa at jeg ville ta den med til CES og få den til å bli levende, var det ikke meningen. De gjør denne seriøse utviklingen fordi de tror at dette vil ha en reell innvirkning på bilene i fremtiden.

Så konseptet med Metaverse er det egentlig bare å utnytte data som allerede er der ute?

I utgangspunktet, ja, men å legge til en massiv skala. Det er tre hovedelementer. Hva er datapunktene som er der ute? Hvordan integrerer jeg alt dette i noe som gir mening? Hvordan kan jeg få dette i hastighet, sanntid, i et brukbart format, inn i bilen?

Nå, hvordan får vi alt dette i fart? Jeg tror alt av 5G-utvikling spiller en rolle i det, hvor du begynner å gjøre ting mulig som bare aldri har vært mulig. Det er der disse tingene kommer sammen, og hvor I2V ble født.

Hvor kom ideen om å bruke avatarer og bringe andre mennesker virtuelt inn i bilen fra?

Jeg skal være ærlig med deg: det var ikke det viktigste jeg ønsket å vise. For hvis du tar med deg avataren i bilen, så er sannsynligvis en bedre applikasjon for det for et selskap som Skype å gjøre det. Jeg sa [til ingeniørene] "det er fascinerende, men hva er bilhistorien?" Vi brukte mye tid på å diskutere: "Ok, hvis det er mulig, hva er fordelen med bilen?"

"For meg er det som faktisk er mer spennende med tanke på fremtiden hvordan du kan se det du ikke kan se."

Så kom vi på det vi demonstrerte på CES, som er, for noen som elsker å kjøre bil ha en profesjonell sjåfør med deg som kan lære deg, coache deg, hvordan du kan gjøre kjøringen mer spennende. Hvis jeg kjører på en svingete vei eller på en racerbane, vil jeg gjerne ha [fem ganger Formel en champion] Lewis Hamilton sitte ved siden av meg og fortelle meg hvordan jeg gjør dette. Det er mulig, fordi vi kan sette denne profesjonelle sjåføren på et sted med virtuell virkelighet. Han ser alt jeg ser på banen.

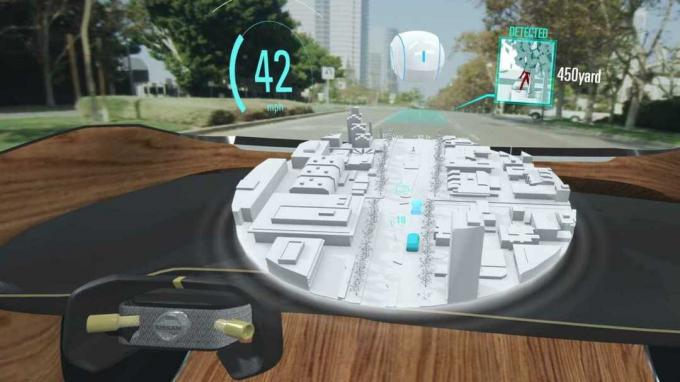

For meg er det som faktisk er mer spennende med tanke på fremtiden hvordan du kan se det du ikke kan se, som i utgangspunktet er at jeg kjører på denne svingen veien, det kommer trafikk fra den andre siden som jeg ikke kan se, så jeg kjører mye saktere, mye mer konservativt, fordi jeg ikke vet hva som kommer til å skje. Jeg vet ikke hvor det er et hull i veien. Jeg vet ikke om været rundt hjørnet ikke er så bra. Så å bringe all denne informasjonen til meg som sjåfør, det var det jeg fant mest fascinerende. Men jeg vet også at avataren er den skinnende, morsomme historien om hva du kan gjøre på CES.

Du har nevnt bruksområder for I2V som involverer både menneskedrevne og autonome biler. I en menneskedrevet bil, er du bekymret for at det å kaste all denne informasjonen mot sjåføren kan være for distraherende?

Dette er grunnen til at det fortsatt er avansert ingeniørfag. Det er virkelig de tingene vi må finne ut av. Men det er en konstant debatt, for på alle nye biler blir skjermene så store at mengden ting du kan sette på dem blir større. Så hvordan lage det vi kaller et HMI, menneske-maskin-grensesnitt, som fortsatt gir mening, og som fortsatt er enkelt og intuitivt, må vi fortsatt finne ut av.

Er det noen andre bruksområder du ser på som mer på den praktiske siden, mer sannsynlig å bli satt i produksjon?

De største applikasjonene er å gjøre kjøringen bedre. Det er andre morsomme ting du kan gjøre som, hvis jeg kjører i bilen min og det er tåkete, kan vi få veien til å se vakker ut. Du drar på ferie til Skottland og vil se denne vakre naturen, men tre av fire dager er det regn i Skottland. Men i fremtiden [kan] du kjøre langs veien, det vil være som om du kjører på en solrik dag.

Jeg tror det er ubegrensede muligheter. Hvilke blir virkelighet, og hvilke blir det ikke? Jeg vet ikke, men den morsomme delen av disse tingene er at du må leke med fantasien. Da vil noe dukke opp, og vi vil innse at vi faktisk kan gjøre det, og kommersialisere det. Hva det blir, vet jeg ikke ennå.

Nissan tester I2V med personer i et kjøretøy i bevegelse. Har du fått noen tilbakemeldinger fra det ennå?

Folk elsker det. Det taler til fantasien. For fem eller seks år siden snakket folk om selvkjørende biler, nå er det usynlig-til-synlig. Trikset nå er å gå fra det, til en reell applikasjon som vi faktisk kan kommersialisere.

Hvilke skritt må Nissan fortsatt ta for å få det til?

Det må komme fra avansert ingeniørarbeid til en kjøretøyapplikasjon. For den syklusen ser vi på mellom fem og 10 år, i det minste, før vi gjør det. Men ofte, i vår bransje, kommer elementer av [ny teknologi] mye tidligere.

Jeg tror det er ubegrensede muligheter. Hvilke blir virkelighet, og hvilke blir det ikke? Jeg vet ikke.

Bruk av data utenfor bilen, langt unna, kommer til å bli brukt til mange ting. Ikke så mye for å sette en avatar ved siden av deg, men for å vite når hvilken parkering er ledig i bygningen nedover veien. Det vi gjorde som en demonstrasjon på CES var at du kunne se bygningen, den ble gjennomsiktig og [viste deg] parkeringsplassen. Det som vil skje før det er at det, sannsynligvis, inne i navigasjonssystemet ditt vil si, "parkeringsplass 5B, femte etasje, andre til høyre er tilgjengelig,” uten å prøve å lage et virtuell virkelighetsbilde av det bygning. Det vil sannsynligvis komme mye tidligere, og det bruker den samme grunnteknologien.

Med denne typen utvikling er det slik du ser det komme til bilen din. Så folk skjønner ikke hvordan det kommer til bilen fordi det kommer i disse små applikasjonene.

Så det blir mer som et gradvis tillegg av nye funksjoner over tid?

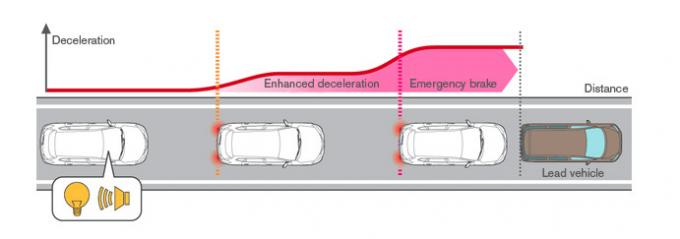

Ja, og det er forresten det samme som autonomt. Folk sier: "Ok, når er bilen selvkjørende?" Det skjer hver dag. Hver dag får du mer teknologi som hjelper deg å kjøre bilen. ABS [blokkeringsfrie bremser] hjelper deg med å bremse, og nå har du biler som hjelper deg med å holde deg i kjørefeltet, og hjelper deg å stoppe før bilene foran deg stopper, og hjelper deg å kjøre selv i ett kjørefelt. Disse tingene skjer hele tiden, så autonom kjøring skjer hele tiden.

Noen mennesker forteller oss, med autonom kjøring, "jeg ønsker ikke å gi opp kontrollen." Men så forteller du dem om nødbremsing fremover og de sier: "Ja, det er bra." Det gjør i bunn og grunn det samme.

En annen ting folk spør om er e-handel, skal folk kjøpe biler på nett? Bildet er at jeg tar kredittkortet mitt, jeg tar dataskjermen min, jeg bruker fem minutter, og i morgen står bilen foran døren min.

Mitt svar til dem er det samme: e-handel skjer hver dag. For tjue år siden måtte man skaffe seg et bilmagasin for å lese om spesifikasjonene, så gikk man inn på nettsiden. Nå kan du gå til nettstedet og faktisk konfigurere bilen din. Fordi det er knyttet til kredittvurderingen din, kan du nå sjekke hvor mye den månedlige betalingen er, og du kan bestille en prøvetur. Over en periode ser du tilbake på at vi gjør ting helt annerledes enn vi gjorde det for 10 år siden.

Ettersom teknologiske funksjoner som I2V potensielt blir mer vanlig, tror du de vil forbigå viktigheten av selve bilene? Vil folk fortsatt bry seg om den faktiske, taktile følelsen av bilen, eller vil det bare være hvor godt den presenterer dette virtuelle miljøet og tilkoblingen til dem?

For det første, hvordan bilene ser ut om 30 eller 40 år fra nå, aner jeg ikke. Kanskje det er flygende biler, jeg vet ikke. Men jeg tror at disse tingene ikke alltid går så fort som folk får dem til å være.

Folk sier, med bildeling, at ingen ønsker å eie en bil lenger. Du kan si at med I2V kan jeg leve i den virtuelle verdenen, så jeg trenger ikke den taktile [erfaringen] lenger. Jeg tror det er en annen dimensjon ved å eie noe som jeg tror vi undervurderer, og til en viss grad kommer det tilbake.

Det fysiske, eierskapet, er fortsatt en veldig stor del av opplevelsen til mennesker. En klokke du eier, telefonen du eier, bilen du har, interiøret i huset ditt, hvordan det føles som hvordan du opplever det, hvordan du lever det, hvordan du gjør det til ditt, jeg tror ikke vi skal undervurdere at. Folk vil ikke være i en verden der alt er virtuelt. Du vil ha tingene dine. Det kan endre seg, men jeg tror ikke det kommer til å endre seg så raskt som noen gjør det til.

Redaktørenes anbefalinger

- Hvordan en stor blå varebil fra 1986 banet vei for selvkjørende biler

- Harman vil at du skal tilpasse hvordan bilen din reagerer i uventede situasjoner

- Nissans høyteknologiske isbil fjerner røyken fra bestillingen din

- Nissan bruker 5G for å teste teknologi som lar bilister tilkalle 3D-avatarer i bilen

- 5G vil gjøre bilen din om til en snakkende, tenkende superdatamaskin. Og det kommer snart