Imagínese una bandeja. En la bandeja hay una variedad de formas: algunos cubos, otros esferas. Las formas están hechas de una variedad de materiales diferentes y representan una variedad de tamaños. En total hay, quizás, ocho objetos. Mi pregunta: "Mirando los objetos, ¿hay el mismo número de cosas grandes y esferas metálicas?"

Contenido

- El ascenso y la caída de la IA simbólica.

- El mundo de las redes neuronales

- Semáforos en llamas

- Ideas complementarias

- AI. investigación: la próxima generación

No es una pregunta capciosa. El hecho de que parezca que lo es es una prueba positiva de lo simple que es en realidad. Es el tipo de pregunta que un niño en edad preescolar probablemente podría responder con facilidad. Pero es casi imposible para las redes neuronales de última generación actuales. Esto necesita cambiar. Y esto debe lograrse reinventando la inteligencia artificial tal como la conocemos.

Vídeos recomendados

Esa no es mi opinión; es la opinion de David Cox, director del MIT-IBM Watson A.I. Laboratorio en Cambridge, MA. En una vida anterior, Cox fue profesor en la Universidad de Harvard, donde su equipo utilizó conocimientos de la neurociencia para ayudar a construir mejores sistemas informáticos de aprendizaje automático inspirados en el cerebro. En su puesto actual en IBM, supervisa una asociación única entre el MIT e IBM que está impulsando la inteligencia artificial. investigación, incluido Watson A.I. plataforma. Watson, para aquellos que no lo saben, fue la A.I. que derrotó a dos de los mejores jugadores del programa de juegos

en historia en un concurso de televisión Peligro. Watson también es un sistema principalmente de aprendizaje automático, entrenado utilizando grandes cantidades de datos en lugar de reglas derivadas de humanos.

Entonces, cuando Cox dice que el mundo necesita repensar la IA. A medida que avanzamos hacia una nueva década, suena un poco extraño. Después de todo, la década de 2010 ha sido posiblemente la década de mayor éxito en la IA. historia: Un período en el que los avances ocurren aparentemente semanalmente, y sin ningún gélido indicio de una AI. invierno conocimiento. Esta es exactamente la razón por la que cree que la A.I. necesita cambiar, sin embargo. Y su sugerencia para ese cambio, un término actualmente oscuro llamado “IA neurosimbólica”, bien podría convertirse en una de esas frases que conocemos íntimamente cuando la década de 2020 llegue a su fin.

El ascenso y la caída de la IA simbólica.

IA neurosimbólica No es, estrictamente hablando, una forma totalmente nueva de hacer A.I. Es una combinación de dos enfoques existentes para construir máquinas pensantes; aquellos que alguna vez se enfrentaron entre sí como enemigos mortales.

La parte "simbólica" del nombre se refiere al primer enfoque generalizado para crear inteligencia artificial. Desde la década de 1950 hasta la de 1980, la IA simbólica. gobernó supremo. A una A.I. simbólica. Investigador, la inteligencia se basa en la capacidad de los humanos para comprender el mundo que los rodea mediante la formación de representaciones simbólicas internas. Luego crean reglas para abordar estos conceptos, y estas reglas pueden formalizarse de manera que capturen el conocimiento cotidiano.

Shakey the Robot: el primer robot en incorporar inteligencia artificial

Si el cerebro es análogo a una computadora, esto significa que cada situación que encontramos depende de que ejecutemos un programa informático interno que explica paso a paso cómo realizar una operación, basándose íntegramente en lógica. Siempre que este sea el caso, la A.I. Los investigadores creen que esas mismas reglas sobre el La organización del mundo podría descubrirse y luego codificarse, en forma de algoritmo, para una computadora. llevar a cabo.

IA simbólica resultó en algunas manifestaciones bastante impresionantes. Por ejemplo, en 1964 el informático Bertram Raphael desarrolló un sistema llamado SIR, que significa “Recuperación de información semántica.” SIR era un sistema de razonamiento computacional que aparentemente era capaz de aprender relaciones entre objetos de una manera que se parecía a la inteligencia real. Si le dijeras que, por ejemplo, “John es un niño; un niño es una persona; una persona tiene dos manos; una mano tiene cinco dedos”, entonces SIR respondería a la pregunta “¿Cuántos dedos tiene John?” con el número correcto 10.

"...hay grietas preocupantes en la pared que están empezando a verse".

Sistemas informáticos basados en A.I. simbólica. alcanzaron el apogeo de sus poderes (y su declive) en la década de 1980. Esta fue la década del llamado "sistema experto", que intentó utilizar sistemas basados en reglas para resolver problemas del mundo real, como ayudar a los químicos orgánicos a identificar moléculas orgánicas desconocidas o ayudar a los médicos a recomendar la dosis correcta de antibióticos para infecciones.

El concepto subyacente de estos sistemas expertos era sólido. Pero tuvieron problemas. Los sistemas eran costosos, requerían una actualización constante y, lo peor de todo, podían volverse menos precisos a medida que se incorporaban más reglas.

El mundo de las redes neuronales

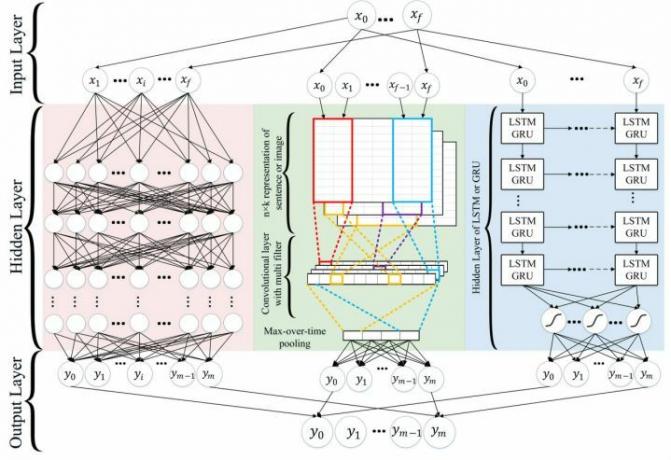

La parte “neuro” de la IA neurosimbólica. se refiere a redes neuronales de aprendizaje profundo. Las redes neuronales son el tipo de computación inspirada en el cerebro que ha impulsado a muchos de los creadores de IA. avances observados en la última década. AI. ¿Que puede conducir coches? Redes neuronales. AI. ¿Cuál puede traducir texto a docenas de idiomas diferentes? Redes neuronales. AI. ¿Qué ayuda al altavoz inteligente de tu hogar a entender tu voz? Las redes neuronales son la tecnología a la que hay que agradecer.

Las redes neuronales funcionan de manera diferente a la IA simbólica. porque se basan en datos, en lugar de reglas. Para explicarle algo a una IA simbólica. sistema significa proporcionarle explícitamente toda la información que necesita para poder realizar una identificación correcta. Como analogía, imagina enviar a alguien a recoger a tu madre a la estación de autobuses, pero tener que describirla proporcionándole un conjunto de reglas que permitan a tu amigo distinguirla entre la multitud. Para entrenar una red neuronal para que lo haga, simplemente le muestra miles de imágenes del objeto en cuestión. Una vez que se vuelva lo suficientemente inteligente, no sólo podrá reconocer ese objeto; puede crear sus propios objetos similares que tengan En realidad nunca existió en el mundo real..

"Sin duda, el aprendizaje profundo ha permitido avances sorprendentes", dijo David Cox a Digital Trends. "Al mismo tiempo, hay grietas preocupantes en la pared que están empezando a aparecer".

Una de estas supuestas grietas se basa exactamente en lo que ha hecho que las redes neuronales actuales sean tan poderosas: los datos. Al igual que un humano, una red neuronal aprende basándose en ejemplos. Pero mientras que un humano sólo necesita ver uno o dos ejemplos de entrenamiento de un objeto para recordarlo correctamente, una IA. Se necesitarán muchos, muchos más. La precisión depende de tener grandes cantidades de datos anotados con los que poder aprender cada nueva tarea.

Semáforos en llamas

Eso los hace menos buenos en problemas estadísticamente raros del “cisne negro”. Un evento del cisne negro, popularizado por Nassim Nicholas Taleb, es un caso de esquina que es estadísticamente raro. "Muchas de nuestras soluciones de aprendizaje profundo actuales, por sorprendentes que sean, son soluciones 80-20", continuó Cox. “Harán bien el 80% de los casos, pero si esos casos extremos son importantes, tenderán a fracasar. Si ves un objeto que normalmente no pertenece [a un lugar determinado], o un objeto con una orientación ligeramente extraña, incluso sistemas asombrosos se caerán”.

Presentamos los autómatas perceptivos

Antes de unirse a IBM, Cox cofundó una empresa, Autómatas perceptivos, que desarrolló software para vehículos autónomos. El equipo tenía un canal de Slack en el que publicaban imágenes divertidas con las que se habían topado durante el curso de la recopilación de datos. Una de ellas, tomada en un cruce, mostraba un semáforo en llamas. "Es uno de esos casos que quizás nunca veas en tu vida", dijo Cox. "No sé si Waymo y Tesla tienen imágenes de semáforos en llamas en los conjuntos de datos que utilizan para entrenar sus redes neuronales, pero estoy dispuesto a apostar... si tienen alguna, solo tendrán una muy pocos."

Una cosa es que un caso de esquina sea algo insignificante porque rara vez sucede y no importa mucho cuándo sucede. Recibir una mala recomendación de restaurante puede no ser lo ideal, pero probablemente no sea suficiente para arruinarte el día. Mientras las 99 recomendaciones anteriores que hizo el sistema sean buenas, no hay motivo real de frustración. Un automóvil autónomo que no responde adecuadamente en una intersección debido a un semáforo encendido o a un carruaje tirado por caballos podría hacer mucho más que arruinarle el día. Puede que sea poco probable que suceda, pero si sucede, queremos saber si el sistema está diseñado para poder afrontarlo.

"Si tenemos la capacidad de razonar y extrapolar más allá de lo que hemos visto antes, podemos afrontar estos escenarios", explicó Cox. “Sabemos que los humanos pueden hacer eso. Si veo un semáforo en llamas, puedo aportar muchos conocimientos. Sé, por ejemplo, que la luz no me va a decir si debo parar o seguir. Sé que debo tener cuidado porque [los conductores que me rodean estarán confundidos]. Sé que los conductores que vienen en sentido contrario pueden comportarse de manera diferente porque es posible que sus luces estén funcionando. Puedo razonar un plan de acción que me llevará a donde necesito ir. En ese tipo de entornos críticos para la seguridad y la misión, ese es un lugar en el que no creo que el aprendizaje profundo nos esté sirviendo perfectamente todavía. Por eso necesitamos soluciones adicionales”.

Ideas complementarias

La idea de la IA neurosimbólica. es reunir estos enfoques para combinar el aprendizaje y la lógica. Las redes neuronales ayudarán a que la I.A. simbólica. Los sistemas son más inteligentes al dividir el mundo en símbolos, en lugar de depender de programadores humanos para que lo hagan por ellos. Mientras tanto, la A.I. simbólica. Los algoritmos ayudarán a incorporar el razonamiento de sentido común y el conocimiento del dominio en el aprendizaje profundo. Los resultados podrían conducir a avances significativos en la IA. sistemas que abordan tareas complejas, relacionadas con todo, desde vehículos autónomos hasta el procesamiento del lenguaje natural. Y todo ello mientras se requieren muchos menos datos para el entrenamiento.

IA neurosimbólica explicada

"Las redes neuronales y las ideas simbólicas se complementan maravillosamente entre sí", dijo Cox. “Porque las redes neuronales te dan las respuestas para pasar del desorden del mundo real a una representación simbólica del mundo, encontrando todas las correlaciones dentro de las imágenes. Una vez que tienes esa representación simbólica, puedes hacer algunas cosas bastante mágicas en términos de razonamiento”.

Por ejemplo, en el ejemplo de forma con el que comencé este artículo, un sistema neurosimbólico usaría las capacidades de reconocimiento de patrones de una red neuronal para identificar objetos. Entonces dependería de la IA simbólica. Aplicar la lógica y el razonamiento semántico para descubrir nuevas relaciones. Tales sistemas tienen ya se ha demostrado que funciona eficazmente.

Esto tampoco sería útil sólo en casos extremos. Cada vez es más importante que la A.I. Los sistemas son explicables cuando es necesario. Una red neuronal puede llevar a cabo ciertas tareas excepcionalmente bien, pero gran parte de su razonamiento interno está en "caja negra", lo que lo vuelve inescrutable para quienes quieren saber cómo tomó su decisión. Nuevamente, esto no importa tanto si se trata de un bot que recomienda la pista equivocada en Spotify. Pero si le negaron un préstamo bancario, le rechazaron una solicitud de empleo o alguien resultó herido en un incidente que involucra un automóvil autónomo, será mejor que pueda explicar por qué se han seguido ciertas recomendaciones hecho. Ahí es donde la IA neurosimbólica. podría entrar.

AI. investigación: la próxima generación

Hace unas décadas, los mundos de la IA simbólica. y las redes neuronales estaban en desacuerdo entre sí. Las figuras de renombre que defendieron estos enfoques no sólo creían que su enfoque era correcto; Creían que esto significaba que el otro enfoque estaba equivocado. No necesariamente se equivocaron al hacerlo. Compitiendo para resolver los mismos problemas y con fondos limitados, ambas escuelas de A.I. parecían fundamentalmente opuestos entre sí. Hoy en día, parece que podría resultar cierto lo contrario.

"Es realmente fascinante ver a la generación más joven", dijo Cox. “[Muchas de las personas de mi equipo son] personas relativamente jóvenes: frescas, entusiasmadas, que acaban de terminar su doctorado. Simplemente no tienen nada de esa historia. Simplemente no les importa [que los dos enfoques se enfrenten entre sí], y no importarles es realmente poderoso porque te abre y elimina esos prejuicios. Están felices de explorar las intersecciones... Sólo quieren hacer algo interesante con la IA”.

Si todo va según lo planeado, todos nos beneficiaremos de los resultados.

Recomendaciones de los editores

- ¿IA analógica? Parece una locura, pero podría ser el futuro.

- Lea la inquietantemente hermosa "escritura sintética" de una IA. que piensa que es dios

- Arquitectura algorítmica: ¿Deberíamos dejar que la A.I. ¿Diseñar edificios para nosotros?

- Supermodelo del lenguaje: cómo GPT-3 está marcando el comienzo silenciosamente de la inteligencia artificial revolución

- Mujeres con Byte: el plan de Vivienne Ming para resolver “problemas humanos complicados” con A.I.