Сильна сторона Google у камерах смартфонів завжди був його А.І. та системи обчислювальної фотографії. Фотографія, яку показує ваш телефон після натискання кнопки спуску затвора, не є точною копією того, що ви бачите — це комбінація десятків кадрів, об’єднаних разом, оброблених передовими алгоритмами. Це створює проблему: Google виявив, що його алгоритми фотографій погано справляються з належним відображенням усіх тонів шкіри та фізичних особливостей.

Рекомендовані відео

В оголошенні за адресою Google I/O У 2021 році компанія сказала, що я працюю над тим, щоб це змінити. Його мета — «зробити смартфон фотографія справді для всіх […] щоб створити точнішу та інтуїтивнішу камеру».

Google запустив нову ініціативу у своєму відділі фотографії, щоб забезпечити роботу своїх алгоритмів обробки фотографій точно й відповідним чином представляють кольорових людей — від відтінків шкіри до рис тіла й обличчя, до типу волосся, і за його межами. Це почалося зі збирання групи експертів із фотографії для збору інформації про те, до чого призвела комп’ютерна фотографія прогалини в належному представленні деяких груп, і розпочав роботу над забезпеченням того, щоб програмне забезпечення в його камерах могло протидіяти що.

Пов'язані

- Маєте старий Google Pixel? Цей тест камери змусить вас захотіти Pixel 7a

- Кольори Google Pixel 7a: тут є всі можливі варіанти

- Чи є в Google Pixel 7a бездротова зарядка?

«Робота для нас. Люди не повинні змінювати свій зовнішній вигляд; це для нас, щоб змінити спосіб роботи інструментів», – сказав Google.

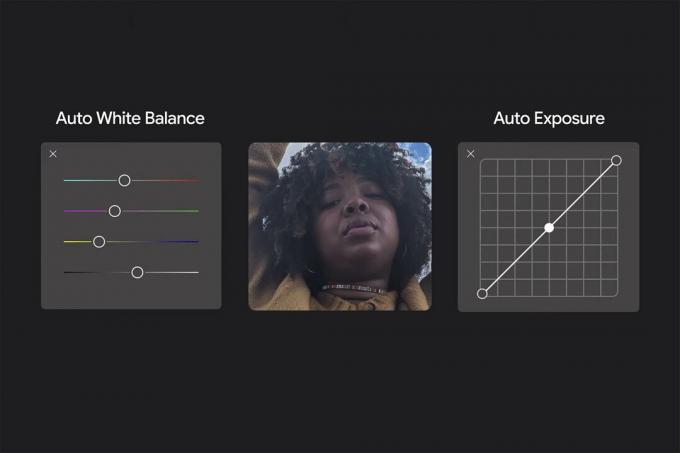

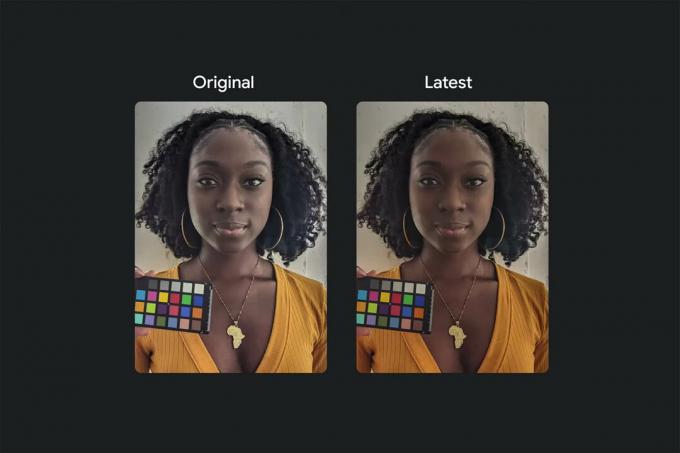

Деякі зміни дещо простіші, ніж інші. Налаштувавши спосіб, яким алгоритми автоматичного балансу білого та автоматичної експозиції обробляють зображення, Google додаток камери може точніше відобразити тон чиєїсь шкіри незалежно від навколишньої сцени.

І замість простого припущення, що «яскравіше зображення – краще», як це часто буває, можна взяти до уваги той факт, що є причина чому певні частини сцени мають такий колір або тон. Google є лідером у об’єднанні кількох кадрів у складені фотографії, і це ще одна сфера, де такий досвід можна застосувати до нової філософії.

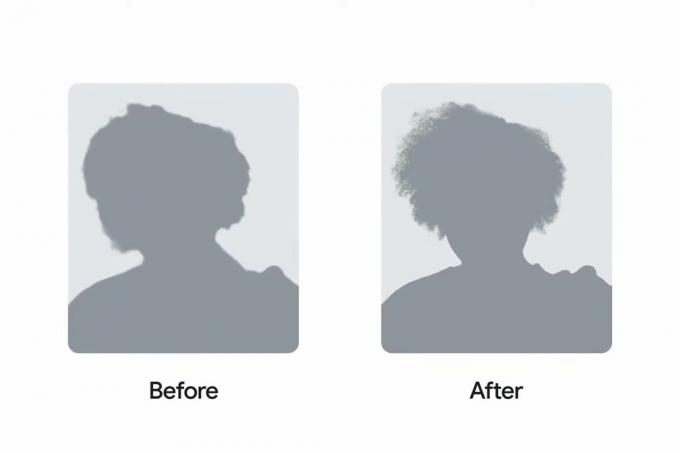

Звичайно, це не тільки колір і яскравість. Google також зосереджується на своїх алгоритмах обробки різних типів волосся — для фото, селфі та портретних знімків. Ми всі стикалися з несправжніми портретами, на яких відрізали окуляри, вуха чи шматки волосся, але Google виявив, що це непропорційно вплинуло на кучеряве волосся. Нові зміни в алгоритмі допомагають належним чином відобразити волосся природним шляхом, а не штучно розгладжувати його та видаляти чіткість із кучерів, наприклад.

Зрештою, все це зводиться до точності. Де різні телефони приземляються в спектрі зйомки точні фотографії або приємно фотографії є постійним джерелом дискусій; але, на жаль, недостатньо уваги було приділено представленню суб’єктів незалежно від їхнього тону шкіри чи фізичних особливостей. Хоча ми можемо і повинні обговорювати суб’єктивний характер того, чи має фотографія парку чи нічної сцени належний білий колір баланс або неприродна зернистість у слабкому освітленні, не повинно бути дискусій про те, що алгоритми камери повинні представляють Люди якомога точніше, без упередження.

Google каже, що всі ці зміни та багато іншого з’являться на телефонах Pixel восени — імовірно, одночасно з запуск Pixel 6. Але це не зупиняється на досягнутому; Google поділиться «всім,» що дізнається, з усіма Android партнерської екосистеми, сподіваючись, що інші компанії приєднаються до цієї ініціативи.

Рекомендації редакції

- Google Pixel 8: усі останні чутки та те, що ми хочемо бачити

- Я в захваті від Google Pixel Fold, і ви теж повинні бути в захваті

- Чи є в Google Pixel 7a роз’єм для навушників?

- Планшет Google Pixel тут, і це велике розчарування

- Не купуйте Google Pixel Fold (поки що)

Оновіть свій спосіб життяDigital Trends допомагає читачам стежити за динамічним світом технологій завдяки всім останнім новинам, цікавим оглядам продуктів, проникливим редакційним статтям і унікальним у своєму роді коротким оглядам.