För att ändra titeln på ett välkänt TV-program något: Kids do the darndest things. Nyligen genomförde forskare från Tyskland och Storbritannien en studie, publiceras i tidskriften Vetenskapsrobotik, som visade i vilken utsträckning barn är mottagliga för grupptryck från robotar. TLDR-version: svaret på den gamla föräldrafrågan: "Om alla dina vänner sa åt dig att hoppa från en klippa, skulle du det?" kan mycket väl vara "Visst. Om alla mina vänner var robotar.”

Innehåll

- Är vuxna verkligen så mycket smartare?

- För varje fartyg finns ett skeppsvrak

Testet återskapade ett berömt experiment från 1951 som pionjärer av den polske psykologen Solomon Asch. Experimentet visade hur människor kan påverkas av trycket från grupptänkande, även när detta går emot information som de vet är korrekt. I Aschs experiment samlades en grupp studenter och visade två kort. Kortet till vänster visade en bild av en enda vertikal linje. Kortet till höger visade tre rader av olika längd. Försöksledaren frågade sedan deltagarna vilken rad på det högra kortet som matchade längden på raden som visas på det vänstra kortet.

Rekommenderade videor

"Det speciella med den åldersgruppen för barn är att de fortfarande är i en ålder där de kommer att avbryta misstro."

Så långt, så okomplicerat. Där saker och ting blev mer snåla var dock i gruppens sammansättning. Endast en person i gruppen var en genuin deltagare, medan de andra alla var skådespelare, som hade fått veta vad de skulle säga i förväg. Experimentet gick ut på att testa om den verkliga deltagaren skulle följa med resten av gruppen när de enhälligt gav fel svar. Det visade sig att de flesta skulle göra det. Grupptryck innebär att majoriteten av människor kommer att förneka information som är uppenbart korrekt om det innebär att överensstämma med majoritetens åsikt.

Relaterad

- Utvecklande, självreplikerande robotar är här - men oroa dig inte för ett uppror

- Robotar kommer inte för att stjäla ditt jobb. De kommer för att förbättra det

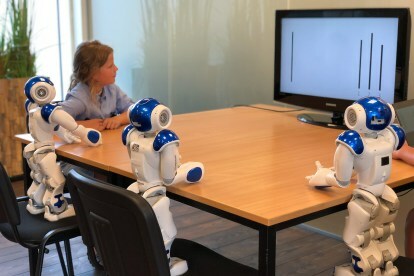

I 2018 års remix av experimentet användes samma princip - bara i stället för en grupp kamrater i collegeåldern var den "riktiga deltagaren" ett barn i åldern sju till nio år. "Skådespelarna" spelades av tre robotar, programmerade att ge fel svar. I ett urval av 43 frivilliga gav 74 procent av barnen samma felaktiga svar som robotarna. Resultaten tyder på att de flesta barn i denna ålder kommer att behandla tryck från robotar på samma sätt som grupptryck från sina kamrater av kött och blod.

"Det speciella med den åldersgruppen för barn är att de fortfarande är i en ålder där de kommer att avbryta misstro," Tony Belpaeme, professor i intelligenta och autonoma styrsystem, som hjälpte till att genomföra studien, berättade för Digital Trends. "De kommer att leka med leksaker och fortfarande tro att deras actionfigurer eller dockor är riktiga; de kommer fortfarande att titta på en dockteater och verkligen tro på vad som händer; de kanske fortfarande tror på [tomten]. Det är samma sak när de tittar på en robot: de ser inte elektronik och plast, utan snarare en social karaktär."

Intressant nog kontrasterade experimentet detta med svaret från vuxna. Till skillnad från barnen påverkades inte vuxna av robotarnas fel. "När en vuxen såg roboten ge fel svar, gav de den en förbryllad blick och gav sedan rätt svar," fortsatte Belpaeme.

Så inget att oroa sig för då? Så länge vi hindrar barn från att lägga vantarna på robotar som är programmerade att ge dåliga svar, borde allt vara bra, eller hur? Var inte så snabb.

Är vuxna verkligen så mycket smartare?

Som Belpaeme erkände, var denna uppgift utformad för att vara så enkel att det inte fanns någon osäkerhet om vad svaret kunde vara. Den verkliga världen är annorlunda. När vi tänker på vilka typer av jobb som lätt överlämnas till maskiner, är det ofta uppgifter som vi som människor inte alltid kan utföra perfekt.

Denna uppgift var utformad för att vara så enkel att det inte fanns någon osäkerhet om vad svaret kunde vara.

Det kan vara så att uppgiften är otroligt enkel, men att maskinen kan utföra den betydligt snabbare än vad vi kan. Eller det kan vara en mer komplex uppgift, där datorn har tillgång till mycket större mängder data än vad vi har. Beroende på den potentiella effekten av det aktuella jobbet är det ingen överraskning att många av oss skulle vara missnöjda med att korrigera en maskin.

Skulle en sjuksköterska på ett sjukhus vara glad över att åsidosätta FDA-godkänd algoritm som kan hjälpa till att göra prioriteringar om patientens hälsa genom att övervaka vitala tecken och sedan skicka varningar till medicinsk personal? Eller skulle en förare vara bekväm med att ta ratten från en förarlös bil när han hanterar ett särskilt komplext vägscenario? Eller till och med en pilot som åsidosätter autopiloten för att de tror att fel beslut fattas? I alla dessa fall skulle vi vilja tro att svaret är "ja". Av alla möjliga skäl kanske det inte är verkligheten.

Nicholas Carr skriver om detta i sin bok från 2014 Glasburen: vart automatiseringen tar oss. Sättet han beskriver det understryker den typ av tvetydighet som verkliga fall av automatisering innebär, där problemen är mycket mer komplex än längden på en rad på ett kort, maskinerna är mycket smartare, och resultatet är potentiellt mer avgörande.

"Hur mäter du kostnaden för en urholkning av ansträngning och engagemang, eller en avtagande av handlingsfrihet och autonomi, eller en subtil försämring av skicklighet? Du kan inte”, skriver han. "Det här är den typen av skumma, immateriella saker som vi sällan uppskattar förrän efter att de är borta, och även då kan vi ha problem med att uttrycka förlusterna i konkreta termer."

"Det här är den typen av skumma, immateriella saker som vi sällan uppskattar förrän efter att de är borta."

Sociala robotar av det slag som Belpaeme teoretiserar om i forskningsrapporten är ännu inte mainstream, men det finns redan illustrationer av några av dessa gåtor i aktion. Till exempel inleder Carr sin bok med att nämna ett memo från Federal Aviation Administration som noterade hur piloter borde spendera mindre tid på att flyga på autopilot på grund av riskerna detta medför. Detta baserades på analys av kraschdata, som visade att piloter ofta förlitar sig för mycket på datoriserade system.

Ett liknande fall gällde en rättegång 2009 där en kvinna vid namn Lauren Rosenberg väckte talan mot Google efter att ha fått rådet att gå längs en väg som ledde ut i farlig trafik. Även om fallet kastades ut från domstol visar det att människor kommer att åsidosätta sitt eget sunda förnuft i tron att maskinintelligens har mer intelligens än vi.

För varje fartyg finns ett skeppsvrak

I slutändan, som Belpaeme erkänner, är problemet att vi ibland vill lämna över beslutsfattandet till maskiner. Robotar lova att göra de jobb som är tråkiga, smutsiga och farliga – och om vi måste gissa varje beslut, är de inte riktigt de arbetsbesparande enheterna som har utlovats. Om vi så småningom ska bjuda in robotar till vårt hem, vill vi att de ska kunna agera självständigt, och det kommer att innebära en viss nivå av förtroende.

"Robotar som utövar socialt tryck på dig kan vara bra; det behöver inte vara läskigt”, fortsatte Belpaeme. ”Om du har robotar som används inom vården eller utbildningen vill du att de ska kunna påverka dig. Till exempel, om du vill gå ner i vikt kan du få en viktminskningsrobot i två månader vilket övervakar ditt kaloriintag och uppmuntrar dig att träna mer. Du vill att en sådan robot ska vara övertygande och påverka dig. Men all teknik som kan användas för det goda kan också användas för det onda."

Vad är svaret på detta? Frågor som denna kommer att diskuteras från fall till fall. Om det dåliga i slutändan uppväger det goda, kommer teknik som sociala robotar aldrig att ta fart. Men det är viktigt att vi tar rätt lärdomar från studier som den om robotinducerat grupptryck. Och det är inte det faktum att vi är så mycket smartare än barn.

Redaktörens rekommendationer

- Framtiden för automatisering: Robotar kommer, men de tar inte ditt jobb

- Dessa robotar tar ihjäl ogräs så att bönder inte behöver kemiska ogräsmedel