Imaginează-ți o tavă. Pe tavă este un sortiment de forme: Unele cuburi, altele sfere. Formele sunt realizate dintr-o varietate de materiale diferite și reprezintă un sortiment de dimensiuni. În total sunt, poate, opt obiecte. Întrebarea mea: „Privind obiectele, există un număr egal de lucruri mari și sfere metalice?”

Cuprins

- Ascensiunea și căderea simbolului A.I.

- Lumea rețelelor neuronale

- Arderea semafoarelor

- Idei complementare

- A.I. cercetare: generația următoare

Nu este o întrebare șmecheră. Faptul că sună ca și cum ar fi este o dovadă pozitivă a cât de simplu este de fapt. Este genul de întrebare la care un preșcolar ar putea răspunde cel mai probabil cu ușurință. Dar este aproape imposibil pentru rețelele neuronale de ultimă generație de astăzi. Acest lucru trebuie să se schimbe. Și trebuie să se întâmple prin reinventarea inteligenței artificiale așa cum o cunoaștem.

Videoclipuri recomandate

Aceasta nu este părerea mea; este parerea lui David Cox, director al MIT-IBM Watson A.I. Laborator din Cambridge, MA. Într-o viață anterioară, Cox a fost profesor la Universitatea Harvard, unde echipa sa a folosit informații din neuroștiință pentru a ajuta la construirea unor sisteme computerizate de învățare automată, inspirate de creier. În rolul său actual la IBM, el supraveghează un parteneriat unic între MIT și IBM, care promovează I.A. cercetare, inclusiv Watson A.I de la IBM. platformă. Watson, pentru cei care nu știu, a fost A.I. care a învins celebru doi dintre cei mai buni jucători de show-uri de jocuri

în istorie la emisiunea de chestionare TV Primejdie. Watson se întâmplă să fie, de asemenea, un sistem de învățare automată, antrenat folosind mase de date, spre deosebire de regulile derivate de la om.

Deci, când Cox spune că lumea trebuie să regândească A.I. pe măsură ce se îndreaptă spre un nou deceniu, sună cam ciudat. La urma urmei, anii 2010 au fost, probabil, cei mai de succes zece ani în A.I. istorie: o perioadă în care descoperirile au loc aparent săptămânal și fără nicio urmă de îngheț. A.I. iarnă la vedere. Tocmai de aceea crede că A.I. trebuie să se schimbe, totuși. Iar sugestia sa pentru această schimbare, un termen obscur în prezent numit „IA neuro-simbolice”, ar putea deveni una dintre acele expresii pe care le cunoaștem îndeaproape până la sfârșitul anilor 2020.

Ascensiunea și căderea simbolului A.I.

I.A. neuro-simbolic. nu este, strict vorbind, un mod total nou de a face A.I. Este o combinație a două abordări existente pentru a construi mașini de gândire; cei care odată au fost înfruntați împotriva fiecăruia ca dușmani de moarte.

Partea „simbolică” a numelui se referă la prima abordare generală a creării inteligenței artificiale. Din anii 1950 până în anii 1980, simbolul A.I. domnit suprem. Pentru un A.I simbolic. cercetător, inteligența se bazează pe capacitatea oamenilor de a înțelege lumea din jurul lor formând reprezentări simbolice interne. Apoi creează reguli pentru a trata aceste concepte, iar aceste reguli pot fi formalizate într-un mod care surprinde cunoștințele de zi cu zi.

Shakey the Robot: primul robot care întruchipează inteligența artificială

Dacă creierul este analog cu un computer, aceasta înseamnă că fiecare situație pe care o întâlnim se bazează pe noi să rulăm un program intern de calculator care explică, pas cu pas, modul de realizare a unei operații, bazat în întregime pe logică. Cu condiția ca acesta să fie cazul, simbolic A.I. cercetătorii cred că aceleași reguli despre organizarea lumii ar putea fi descoperită și apoi codificată, sub forma unui algoritm, pentru un computer a efectua.

I.A simbolic. a avut ca rezultat niște demonstrații destul de impresionante. De exemplu, în 1964, informaticianul Bertram Raphael a dezvoltat un sistem numit SIR, care înseamnă „Găsirea informațiilor semantice.” SIR era un sistem de raționament computațional care aparent era capabil să învețe relațiile dintre obiecte într-un mod care semăna cu inteligența reală. Dacă ar fi să-i spui că, de exemplu, „Ioan este un băiat; un băiat este o persoană; o persoană are două mâini; o mână are cinci degete”, apoi SIR ar răspunde la întrebarea „Câte degete are John?” cu numărul corect 10.

„...există crăpături îngrijorătoare în perete care încep să se vadă.”

Sisteme informatice bazate pe A.I simbolic. au atins apogeul puterilor lor (și au declinat) în anii 1980. Acesta a fost deceniul așa-numitului „sistem expert” care a încercat să folosească sisteme bazate pe reguli pentru a rezolva probleme din lumea reală, cum ar fi ajutarea chimiștilor organici să identifice molecule organice necunoscute sau asistarea medicilor în recomandarea dozei potrivite de antibiotice pentru infectii.

Conceptul de bază al acestor sisteme expert a fost solid. Dar au avut probleme. Sistemele erau scumpe, necesitau actualizare constantă și, cel mai rău, puteau de fapt deveni mai puțin precise cu cât erau încorporate mai multe reguli.

Lumea rețelelor neuronale

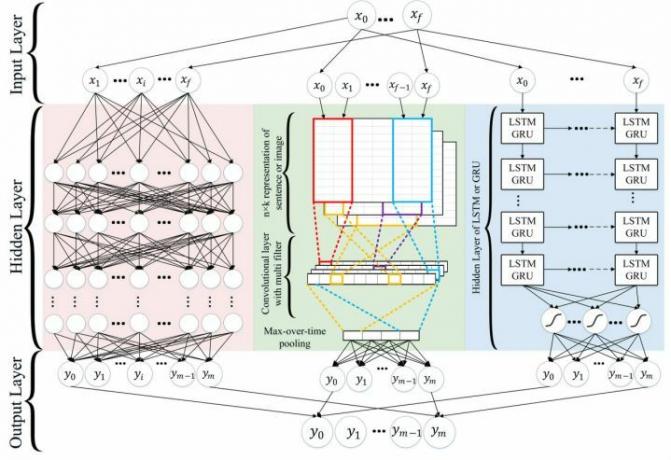

Partea „neuro” a I.A. neuro-simbolică. se refera la rețele neuronale de învățare profundă. Rețelele neuronale sunt tipul de calcul inspirat de creier, care a determinat multe dintre IA. descoperiri observate în ultimul deceniu. A.I. care poate conduce mașini? Rețele neuronale. A.I. care poate traduce text în zeci de limbi diferite? Rețele neuronale. A.I. care ajută difuzorul inteligent din casa dvs. să vă înțeleagă vocea? Rețelele neuronale sunt tehnologia care trebuie mulțumită.

Rețelele neuronale funcționează diferit față de I.A. simbolică. deoarece sunt bazate pe date, mai degrabă decât pe reguli. Pentru a explica ceva unui A.I simbolic. sistem înseamnă să îi furnizeze în mod explicit fiecare informație de care are nevoie pentru a putea face o identificare corectă. Ca o analogie, imaginați-vă că trimiteți pe cineva să vă ia mama de la stația de autobuz, dar trebuie să o descrieți oferindu-i un set de reguli care să-l permită prietenei tale să o aleagă din mulțime. Pentru a antrena o rețea neuronală să facă acest lucru, pur și simplu îi arăți mii de imagini ale obiectului în cauză. Odată ce devine suficient de inteligent, nu numai că va putea recunoaște acel obiect; îşi poate alcătui propriile obiecte similare care au nu a existat niciodată în lumea reală.

„Cu siguranță, învățarea profundă a permis progrese uimitoare”, a spus David Cox pentru Digital Trends. „În același timp, există crăpături îngrijorătoare în perete care încep să se vadă.”

Una dintre aceste așa-numite fisuri se bazează pe exact lucrul care a făcut rețelele neuronale de astăzi atât de puternice: datele. La fel ca un om, o rețea neuronală învață pe baza exemplelor. Dar, în timp ce un om ar putea avea nevoie doar să vadă unul sau două exemple de antrenament ale unui obiect pentru a-l aminti corect, un I.A. va necesita multe, multe altele. Precizia depinde de a avea cantități mari de date adnotate cu care poate învăța fiecare sarcină nouă.

Arderea semafoarelor

Acest lucru îi face mai puțin buni la problemele rare din punct de vedere statistic de „lebădă neagră”. Un eveniment de lebădă neagră, popularizat de Nassim Nicholas Taleb, este un caz de colț care este rar statistic. „Multe dintre soluțiile noastre de învățare profundă de astăzi – oricât de uimitoare sunt ele – sunt un fel de soluții 80-20”, a continuat Cox. „Vor îndrepta 80% din cazuri, dar dacă acele cazuri de colț contează, vor tinde să cadă. Dacă vezi un obiect care nu aparține în mod normal [un anumit loc] sau un obiect într-o orientare ușor ciudată, chiar și sistemele uimitoare vor cădea.

Prezentarea automatelor perceptive

Înainte de a se alătura IBM, Cox a co-fondat o companie, Automate perceptive, care a dezvoltat software pentru mașinile cu conducere autonomă. Echipa a avut un canal Slack în care a postat imagini amuzante peste care au dat peste cap în timpul colectării datelor. Unul dintre ei, luat la o intersecție, a arătat un semafor în flăcări. „Este unul dintre acele cazuri pe care s-ar putea să nu le vezi niciodată în viața ta”, a spus Cox. „Nu știu dacă Waymo și Tesla au imagini cu semafoare în flăcări în seturile de date pe care le folosesc pentru antrenează-le rețelele neuronale, dar sunt dispus să pariez... dacă au, vor avea doar un puțini.”

Un lucru este ca un caz de colț să fie ceva nesemnificativ, deoarece se întâmplă rar și nu contează atât de mult când se întâmplă. A primi o recomandare proastă de restaurant ar putea să nu fie ideal, dar probabil că nu va fi suficient pentru a vă strica ziua. Atâta timp cât cele 99 de recomandări anterioare pe care le-a făcut sistemul sunt bune, nu există niciun motiv real de frustrare. O mașină cu conducere autonomă care nu răspunde corect la o intersecție din cauza unui semafor arzând sau a unei trăsuri trase de cai ar putea face mult mai mult decât să vă strice ziua. Este puțin probabil să se întâmple, dar dacă se întâmplă, vrem să știm că sistemul este conceput pentru a putea face față.

„Dacă aveți capacitatea de a raționa și de a extrapola dincolo de ceea ce am văzut înainte, putem face față acestor scenarii”, a explicat Cox. „Știm că oamenii pot face asta. Dacă văd un semafor în flăcări, pot aduce multe cunoștințe. Știu, de exemplu, că lumina nu îmi va spune dacă ar trebui să mă opresc sau să plec. Știu că trebuie să fiu atent pentru că [șoferii din jurul meu vor fi confuzi.] Știu că șoferii care vin pe cealaltă direcție s-ar putea să se comporte diferit, deoarece lumina lor ar putea funcționa. Pot să raționez un plan de acțiune care să mă ducă acolo unde trebuie să ajung. În acele tipuri de setări critice pentru siguranță, critice pentru misiune, acolo nu cred că învățarea profundă ne servește încă perfect. De aceea avem nevoie de soluții suplimentare.”

Idei complementare

Ideea de A.I neuro-simbolic. este de a reuni aceste abordări pentru a combina atât învățarea, cât și logica. Rețelele neuronale vor contribui la crearea unei I.A. simbolice. sistemele mai inteligente, împărțind lumea în simboluri, mai degrabă decât să se bazeze pe programatori umani pentru a face acest lucru pentru ei. Între timp, simbolic A.I. algoritmii vor ajuta la încorporarea raționamentului de bun simț și a cunoștințelor de domeniu în învățarea profundă. Rezultatele ar putea duce la progrese semnificative în I.A. sisteme care abordează sarcini complexe, legate de orice, de la mașini cu conducere autonomă la procesarea limbajului natural. Și toate în timp ce necesită mult mai puține date pentru antrenament.

AI neurosimbolic explicat

„Rețelele neuronale și ideile simbolice sunt într-adevăr minunat de complementare unele cu altele”, a spus Cox. „Pentru că rețelele neuronale vă oferă răspunsurile pentru a trece de la dezordinea lumii reale la o reprezentare simbolică a lumii, găsind toate corelațiile din imagini. Odată ce ai acea reprezentare simbolică, poți face niște lucruri destul de magice în ceea ce privește raționamentul.”

De exemplu, în exemplul de formă cu care am început acest articol, un sistem neuro-simbolic ar folosi capabilitățile de recunoaștere a modelelor unei rețele neuronale pentru a identifica obiecte. Apoi s-ar baza pe I.A. simbolic. să aplice raționamentul logic și semantic pentru a descoperi noi relații. Astfel de sisteme au deja sa dovedit că funcționează eficient.

Nu sunt doar cazurile de colț în care acest lucru ar fi util. Din ce în ce mai mult, este important ca A.I. sistemele sunt explicabile atunci când este necesar. O rețea neuronală poate îndeplini anumite sarcini excepțional de bine, dar o mare parte din raționamentul ei interior este „cutie neagră”, făcută insondabilă pentru cei care doresc să știe cum a luat decizia. Din nou, acest lucru nu contează atât de mult dacă este un bot care recomandă piesa greșită pe Spotify. Dar dacă vi s-a refuzat un împrumut bancar, a fost respins de la o cerere de angajare sau cineva a fost rănit într-un incident care implică o mașină autonomă, ar fi mai bine să puteți explica de ce au fost anumite recomandări făcut. Acolo este cazul neuro-simbolic I.A. putea intra.

A.I. cercetare: generația următoare

Cu câteva decenii în urmă, lumile simbolice I.A. iar rețelele neuronale erau în contradicție între ele. Personalitățile de renume care au susținut abordările nu numai că au crezut că abordarea lor este corectă; ei credeau că asta însemna că cealaltă abordare este greșită. Nu au fost neapărat greșiți să facă asta. Concurând pentru a rezolva aceleași probleme și cu finanțare limitată pentru a circula, ambele școli de A.I. păreau fundamental opuse unul altuia. Astăzi, se pare că contrariul s-ar putea dovedi adevărat.

„Este cu adevărat fascinant să vezi generația tânără”, a spus Cox. „[Mulți dintre oamenii din echipa mea sunt] oameni relativ juniori: proaspăt, entuziasmați, destul de recent scoși de doctorat. Pur și simplu nu au nimic din această istorie. Pur și simplu nu le pasă [de faptul că cele două abordări sunt puse una împotriva celeilalte] - și a nu le pasă este cu adevărat puternic pentru că te deschide și scapă de acele prejudecăți. Sunt fericiți să exploreze intersecțiile... Vor doar să facă ceva cool cu I.A.”

Dacă toate merg conform planului, toți vom beneficia de rezultate.

Recomandările editorilor

- I.A. analogic? Sună nebunesc, dar ar putea fi viitorul

- Citiți „scriptura sintetică” ciudat de frumoasă a unui A.I. care crede că este Dumnezeu

- Arhitectura algoritmică: Ar trebui să lăsăm A.I. proiectați clădiri pentru noi?

- Supermodel lingvistic: cum GPT-3 introduce în liniște A.I. revoluţie

- Women with Byte: planul lui Vivienne Ming de a rezolva „problemele umane dezordonate” cu A.I.