Para modificar um pouco o título de um programa de TV conhecido: Crianças fazem as coisas mais incríveis. Recentemente, pesquisadores da Alemanha e do Reino Unido realizaram um estudo, publicado na revista Robótica Científica, que demonstrou até que ponto as crianças são suscetíveis à pressão dos colegas dos robôs. Versão TLDR: a resposta para aquela velha pergunta dos pais: “Se todos os seus amigos lhe dissessem para pular de um penhasco, você pularia?” pode muito bem ser “Claro. Se todos os meus amigos fossem robôs.”

Conteúdo

- Os adultos são realmente muito mais inteligentes?

- Para cada navio há um naufrágio

O teste reconstituiu um famoso experimento de 1951 iniciado pelo psicólogo polonês Solomon Asch. A experiência demonstrou como as pessoas podem ser influenciadas pelas pressões do pensamento de grupo, mesmo quando isso vai contra a informação que sabem ser correta. Nas experiências de Asch, um grupo de estudantes universitários foi reunido e foram-lhes mostrados dois cartões. O cartão à esquerda exibia a imagem de uma única linha vertical. O cartão à direita exibia três linhas de comprimentos variados. O experimentador então perguntou aos participantes qual linha do cartão direito correspondia ao comprimento da linha mostrada no cartão esquerdo.

Vídeos recomendados

“O que há de especial nessa faixa etária de crianças é que elas ainda estão em uma idade em que suspenderão a descrença.”

Até agora, tão simples. Onde as coisas ficaram mais tortuosas, porém, foi na composição do grupo. Apenas uma pessoa do grupo era um participante genuíno, enquanto os outros eram todos atores, aos quais foi dito o que dizer com antecedência. O experimento consistia em testar se o participante real concordaria com o resto do grupo quando desse a resposta errada por unanimidade. No final das contas, a maioria o faria. A pressão dos pares significa que a maioria das pessoas negará informações que sejam claramente corretas se isso significar estar em conformidade com a opinião da maioria.

Relacionado

- Robôs em evolução e auto-replicantes estão aqui – mas não se preocupe com uma revolta

- Os robôs não estão vindo para roubar seu emprego. Eles estão vindo para melhorar isso

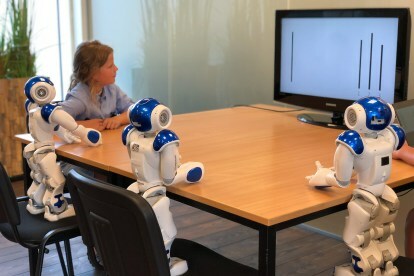

No remix do experimento em 2018, o mesmo princípio foi usado – só que em vez de um grupo de colegas em idade universitária, o “verdadeiro participante” era uma criança, de sete a nove anos de idade. Os “atores” eram interpretados por três robôs, programados para dar a resposta errada. Numa amostra de 43 voluntários, 74% das crianças deram a mesma resposta incorreta que os robôs. Os resultados sugerem que a maioria das crianças desta idade tratará a pressão dos robôs da mesma forma que a pressão dos colegas de carne e osso.

“O que há de especial nessa faixa etária de crianças é que elas ainda estão em uma idade em que suspenderão a descrença”, Tony Belpaeme, Professor de Sistemas de Controle Inteligentes e Autônomos, que ajudou a realizar o estudo, disse ao Digital Trends. “Eles vão brincar com brinquedos e ainda acreditam que seus bonecos ou bonecos são reais; eles ainda assistirão a um show de marionetes e realmente acreditarão no que está acontecendo; eles ainda podem acreditar em [Papai Noel]. É a mesma coisa quando olham para um robô: não veem eletrônicos e plástico, mas sim um personagem social.”

Curiosamente, a experiência comparou isto com a resposta dos adultos. Ao contrário das crianças, os adultos não se deixaram influenciar pelos erros dos robôs. “Quando um adulto viu o robô dando a resposta errada, ele olhou perplexo e depois deu a resposta correta”, continuou Belpaeme.

Então não há nada com que se preocupar? Enquanto impedirmos que as crianças coloquem as mãos em robôs programados para dar respostas erradas, tudo ficará bem, certo? Não seja tão rápido.

Os adultos são realmente muito mais inteligentes?

Como reconheceu Belpaeme, esta tarefa foi concebida para ser tão simples que não havia incerteza quanto à resposta. O mundo real é diferente. Quando pensamos sobre os tipos de tarefas prontamente entregues às máquinas, estas são frequentemente tarefas que nem sempre somos capazes, como seres humanos, de executar com perfeição.

Esta tarefa foi projetada para ser tão simples que não houvesse incerteza quanto à resposta.

Pode ser que a tarefa seja incrivelmente simples, mas a máquina possa executá-la significativamente mais rápido do que nós. Ou poderá ser uma tarefa mais complexa, em que o computador tenha acesso a quantidades de dados muito maiores do que nós. Dependendo do impacto potencial do trabalho em questão, não é surpresa que muitos de nós ficaríamos insatisfeitos com a correção de uma máquina.

Será que uma enfermeira num hospital ficaria feliz em ignorar a Algoritmo aprovado pela FDA o que pode ajudar a estabelecer prioridades sobre a saúde do paciente, monitorando os sinais vitais e enviando alertas à equipe médica? Ou um motorista se sentiria confortável ao dirigir um carro sem motorista ao lidar com um cenário rodoviário particularmente complexo? Ou mesmo um piloto ignorando o piloto automático porque acha que está sendo tomada uma decisão errada? Em todos estes casos, gostaríamos de pensar que a resposta é “sim”. Por todos os tipos de razões, porém, isso pode não ser realidade.

Nicholas Carr escreve sobre isso em seu livro de 2014 A gaiola de vidro: para onde a automação está nos levando. A forma como ele o descreve sublinha o tipo de ambiguidade que envolvem os casos reais de automação, onde os problemas são muito mais complexo do que o comprimento de uma linha num cartão, as máquinas são muito mais inteligentes e o resultado é potencialmente mais crucial.

“Como você mede o custo de uma erosão do esforço e do envolvimento, ou de uma diminuição da agência e da autonomia, ou de uma deterioração sutil de habilidades? Você não pode”, ele escreve. “Estes são os tipos de coisas obscuras e intangíveis que raramente apreciamos até depois de desaparecerem e, mesmo assim, podemos ter dificuldade em expressar as perdas em termos concretos.”

“Esses são os tipos de coisas obscuras e intangíveis que raramente apreciamos até que desapareçam.”

Os robôs sociais do tipo sobre os quais Belpaeme teoriza no artigo de investigação ainda não são convencionais, mas já existem ilustrações de alguns destes enigmas em ação. Por exemplo, Carr abre seu livro mencionando um memorando da Administração Federal de Aviação que observava como os pilotos deveriam passar menos tempo voando no piloto automático devido aos riscos que isso representava. Isto baseou-se na análise de dados de acidentes, mostrando que os pilotos frequentemente dependem demasiado de sistemas informatizados.

Um caso semelhante envolveu uma ação judicial de 2009 em que uma mulher chamada Lauren Rosenberg entrou com uma ação contra o Google depois de ser aconselhado a caminhar por uma rota que conduzia a um trânsito perigoso. Embora o caso tenha sido retirado do tribunal, mostra que as pessoas irão ignorar o seu próprio bom senso na crença de que a inteligência das máquinas tem mais inteligência do que nós.

Para cada navio há um naufrágio

Em última análise, como reconhece Belpaeme, a questão é que por vezes queremos entregar a tomada de decisões às máquinas. Robôs prometer fazer trabalhos chatos, sujos e perigosos – e se tivermos que questionar cada decisão, eles não são realmente os dispositivos que economizam trabalho que foram prometidos. Se eventualmente convidarmos robôs para nossa casa, desejaremos que eles sejam capazes de agir de forma autônoma, e isso envolverá um certo nível de confiança.

“Robôs exercendo pressão social sobre você podem ser uma coisa boa; não precisa ser sinistro”, continuou Belpaeme. “Se você tem robôs usados na saúde ou na educação, você quer que eles sejam capazes de influenciá-lo. Por exemplo, se você quiser perder peso, você pode receber um robô para perder peso por dois meses, que monitores sua ingestão de calorias e incentiva você a fazer mais exercícios. Você quer que um robô como esse seja persuasivo e influencie você. Mas qualquer tecnologia que possa ser usada para o bem também pode ser usada para o mal.”

Qual é a resposta para isso? Questões como esta serão debatidas caso a caso. Se o mal superar o bem, tecnologias como os robôs sociais nunca decolarão. Mas é importante tirarmos as lições certas de estudos como aquele sobre a pressão dos pares induzida por robôs. E não é o fato de sermos muito mais espertos que as crianças.

Recomendações dos Editores

- O futuro da automação: os robôs estão chegando, mas não vão tirar o seu trabalho

- Esses robôs atacam ervas daninhas até a morte para que os agricultores não precisem de herbicidas químicos