Siri não gosta de você. Alexa não quer ser sua amiga. E o Google Assistente? Bem, digamos apenas que o Google Assistente deseja gastar o mínimo de tempo possível respondendo às suas perguntas. E tudo bem.

Conteúdo

- O sonho de Eliseu

- O objetivo de um chatbot social

- Os desafios de construir uma I.A. Melhor amiga

- Um experimento social e cultural

Isso porque nenhum foi projetado para ser uma IA. amigo, apesar dos chavões que eles invariavelmente falam se você perguntar se eles gostam de passar tempo com você. São “do engines”, assistentes virtuais que visam resolver suas dúvidas no menor tempo possível, daí dizermos que Google Assistente não quer perder mais tempo do que o necessário para lhe dizer o que você precisa saber. Esses assistentes podem tirar dúvidas e antecipar cada vez mais as nossas necessidades.

A única coisa que eles não fazem é se importar.

Xiaoice da Microsoft tem um desejo ardente de ser seu (sim, seu) amigo.

Microsoft – que também torna o A.I. assistente Cortana — tem uma ideia diferente. Xiaoice (pronuncia-se “Shao-ice”, que significa “Pequeno Bing”) é um chatbot social, com uma personalidade inspirada na de uma adolescente e um conjunto de habilidades assustadoramente precoce. Além das habilidades usuais que você pode esperar de um A.I. assistente, ela pode contar piadas,

escrever poesia original, componha e cante músicas, leia histórias, jogue e muito mais.“Xiaoice está presente, 24 horas por dia, 7 dias por semana, como um bom amigo com o poder de ouvir”, disse Ying Wang, o diretor da Microsoft que supervisiona Xiaoice, à Digital Trends. “Essa é uma promessa poderosa para muitos usuários.”

Lembra quando o Google exibiu sua tecnologia Duplex, capaz de fazer chamadas telefônicas reais? Xiaoice pode fazer algo muito semelhante. Pense na recente IA. âncora na televisão chinesa é o primeira vez que tal coisa aconteceu? Não exatamente. Xiaoice já foi um leitor de previsão do tempo na Dragon TV, uma das maiores estações de TV da China em Xangai, há vários anos. A sua omnipresença em diversas plataformas — desde a televisão às redes sociais e aos smartphones Huawei — fez dela uma estrela no mercado do Leste Asiático; possivelmente o funcionário atual mais famoso da Microsoft, ao lado do CEO Satya Nadella, com 660 milhões de usuários em todo o mundo.

Microsoft XiaoIce

Tudo isso, no entanto, é uma fachada para o verdadeiro ponto de venda único de Xiaoice: um desejo ardente de ser seu (sim, seu) amigo. Assim como Samantha, a inteligência artificial dublada por Scarlett Johansson no filme de 2013 Dela, Xiaoice da Microsoft pretende ser tanto um companheiro quanto um assistente; utilizando algumas habilidades impressionantes de “computação empática” que o tornaram um sucesso surpreendente em todo o mundo. No processo, pode apenas nos oferecer um vislumbre do futuro da IA. assistentes.

O sonho de Eliseu

A noção de chatbot, um programa de computador projetado para simular uma conversa com um usuário humano, não é uma ideia nova. Alan Turing, o padrinho da inteligência artificial moderna, formulou a hipótese de tal coisa já na década de 1950. (Devido ao trabalho pioneiro de Turing nesta área, referimo-nos ao benchmark definitivo e enganador de tais chatbots, como o Teste de Turing.)

O primeiro chatbot significativo foi construído no Instituto de Tecnologia de Massachusetts em meados da década de 1960 por um cientista da computação chamado Joseph Weizenbaum. O chatbot de Weizenbaum foi nomeado Eliza, em homenagem à personagem Eliza Doolittle no filme de George Bernard Shaw. Pigmalião, que aprende a falar progressivamente melhor através da educação. Eliza pretendia simular um psicoterapeuta rogeriano usando truques de script inteligentes para espelhar as próprias palavras dos usuários. Por exemplo, um usuário dizendo que estava deprimido a maior parte do tempo levaria Eliza a perguntar por que ele estava tão deprimido. Para dar a ilusão de profunda percepção, Eliza também voltava aos temas levantados anteriormente na conversa.

Ironicamente, Weizenbaum criou Eliza para destacar o nível de superficialidade na comunicação entre humanos e máquinas. Em vez disso, ele ficou um tanto perturbado ao ver que os usuários de Eliza gostavam de conversar com o chatbot, o que frequentemente significava divulgar informações pessoais.

Conversas com Eliza

Xiaoice representa o sonho de Eliza, em letras grandes. Desde o seu lançamento na China, em maio de 2014, o Xiaoice teve mais de 30 mil milhões de conversas com 660 milhões de utilizadores humanos em todo o mundo. Embora existam várias maneiras de interagir com “ela”, elas geralmente ocorrem por mensagem de texto. Esta divergência da abordagem de voz em primeiro lugar de outros sistemas de IA. assistentes dão dicas sobre os diferentes casos de uso. É necessária uma forma de comunicação mais longa e prolongada do que o simples “OK Google, vai chover hoje?” você pode latir ao decidir se deve ou não usar casaco para trabalhar.

A conversa típica com Xiaoice dura 23 turnos: cerca de 10 vezes mais que a média do setor.

Ying Wang, da Microsoft, disse que o projeto começou como uma tentativa de descobrir como entrar no mercado de buscas na China. “Percebemos que todos estavam gastando muito tempo em mensagens instantâneas, com serviços como o WeChat”, disse ela ao Digital Trends. “Nossa motivação original era simples: explorar como as pessoas no chat começam a pesquisar. Queríamos construir um ponto de entrada, mas percebemos que quando as pessoas estão conversando, elas não querem parar de fazer isso para iniciar uma busca. Nossa lógica era que, se pudermos continuar uma conversa com um humano, encontraremos oportunidades para encontrar sua intenção de busca. Podemos extrair isso para satisfazê-los.”

A ideia de envolver os usuários em conversas prolongadas com um chatbot parece contra-intuitiva à primeira vista. A história da interação entre computadores baseia-se na premissa de que usar a tecnologia é algo doloroso e que vale a pena qualquer coisa que possa reduzir a experiência, mesmo que seja por um milissegundo. Assim como fazer check-in em um hotel ou fazer um exame de próstata, é uma experiência que poucos desejam prolongar mais do que o absolutamente necessário.

Mas as pessoas parecem surpreendentemente receptivas à abordagem da Microsoft. A conversa típica com Xiaoice dura 23 turnos: cerca de 10 vezes mais que a média do setor. Os resultados, ou assim espera a Microsoft, são uma IA. que preenche a lacuna entre a maneira como falamos com nosso Amazon Echo e a maneira como falamos com nossos amigos.

“A interação entre humanos é baseada em sessões, não em comandos”, continuou Wang. “A conversa entre humanos acontece assim, então por que não adotar uma abordagem semelhante ao envolvimento de IA para humanos?”

O objetivo de um chatbot social

Em um artigo de 2018, os pesquisadores da Microsoft escreveram que “o objetivo principal de um chatbot social não é necessariamente resolver todas as dúvidas que os usuários possam ter, mas sim ser um companheiro virtual para os usuários. Ao estabelecer uma ligação emocional com os utilizadores, os chatbots sociais podem compreendê-los melhor e, portanto, ajudá-los durante um longo período de tempo.”

Xiaoice - Demonstração de detecção de voz full-duplex

Essa conversa mais social significa que Xiaoice pode se aprofundar em áreas que poderiam parecer mais assustadoras se fossem dubladas por outra IA. assistente. Por exemplo, ele verificará se você chegou em casa depois de uma noitada, descobrirá como você está após um rompimento ou acompanhará como você está depois de perder o emprego.

Assim como Eliza, ela retornará a esses tópicos com o tempo e usará análise semântica para avaliar como os usuários estão se sentindo. Ele também pode inferir a partir de imagens e, em seguida, fazer comentários razoavelmente humanos. Se um usuário postar uma foto sua com o pé inchado, Xiaoice perguntará se está doendo. Se postarem uma foto engraçada de seu animal de estimação, Xiaoice poderá fazer uma piada observando um elemento visual distinto da foto.

Antes de Xiaoice e Cortana da Microsoft… havia Clippy e Tay.

“Xiaoice está presente 24 horas por dia, 7 dias por semana, como um bom amigo com o poder de ouvir”, disse Wang. “Essa é uma promessa poderosa para muitos usuários. Vimos muito envolvimento especificamente no mercado asiático, mas em todo o mundo [houve uma forte resposta a isso]. Os usuários se sentem seguros, ouvidos e têm uma conexão.”

O interesse da Microsoft nesta área não é totalmente benevolente, é claro. Há também uma lógica de negócios rígida por trás disso: criar uma IA. que se torna amigo de você gera engajamento. Com as empresas de tecnologia se esforçando para encontrar maneiras de manter os usuários em suas plataformas pelo maior tempo possível, esse é um grande argumento de venda. Também abre novas maneiras de divulgar conteúdo aos usuários.

Quando a Apple apresentou a seus usuários uma cópia gratuita do álbum “Songs of Innocence” do U2 em 2014, a mudança não solicitada imediatamente provocou uma reação. Responderíamos da mesma forma se um amigo nos presenteasse com um álbum que não pedimos, recomendasse um novo restaurante ou nos enviasse vouchers para um novo serviço de assinatura? Talvez não – que é exatamente o que serviços terrestres como Xiaoice têm potencial para explorar.

Os desafios de construir uma I.A. Melhor amiga

Contudo, o historial da Microsoft nesta área mostra a dificuldade de atingir este objectivo. Em 1997, a empresa lançou Clippy, um nome que provavelmente causava um tremor involuntário nos olhos de qualquer pessoa com idade suficiente para se lembrar de usá-lo. Apresentado como um assistente animado “inteligente” para guiá-lo através da experiência de uso do Microsoft Office, o Clippy era um clipe de papel de desenho animado que apareceu na tela para oferecer orientação quando detectou que você estava tentando realizar uma tarefa como escrever uma carta ou redigir uma lista de “tarefas”.

A ideia do Clippy como uma espécie de guia virtual amigável era boa, mas sua implementação foi bastante desastrosa. Seu ilustrador, Kevan J. Atteberry, ainda notas em seu site que ele é o responsável por criar “provavelmente um dos personagens mais irritantes da história!” Um grande problema do Clippy era a falta de lembre-se de interações anteriores com o usuário, tornando-o a versão avatar em clipe de papel do protagonista amnésico de Guy Pearce em Chris Nolan Lembrança. Se a Microsoft quisesse criar um assistente inteligente verdadeiramente útil, precisaria de informações de seus usuários para moldar as sugestões feitas.

Infelizmente, a tentativa seguinte de fazer algo semelhante para o mercado dos EUA desviou-se demasiado para esse terreno. Em março de 2016, após o sucesso inicial do Xiaoice na China, a Microsoft tentou introduzir uma versão americana da tecnologia. Chamado de Tay, esse chatbot residia no Twitter, permitindo que os usuários se comunicassem com ele enviando mensagens para @tayandyou. A ideia era que Tay aprendesse com as interações com seus usuários, extraindo dicas de conversação das informações coletadas nas conversas diárias. Como a Microsoft disse na época: “Quanto mais você fala, mais inteligente Tay fica”.

Robô racista? | Experimento de IA da Microsoft sob ataque

Rapidamente, trolls online começaram a bombardear Tay com mensagens ofensivas destinadas a manchar seu cérebro em branco. Nas primeiras 24 horas após a transmissão ao vivo, Tay começou a twittar mensagens pró-nazistas negando o Holocausto. Quando finalmente sugeriu que “HITLER NÃO FEZ NADA DE ERRADO!”, A Microsoft desligou a tomada, e a empresa emitiu um pedido formal de desculpas. Um porta-voz da empresa disse que Tay foi colocado offline e seus criadores estavam ocupados fazendo ajustes. “[Tay] é tanto um experimento social e cultural quanto técnico”, a declaração lida.

Um experimento social e cultural

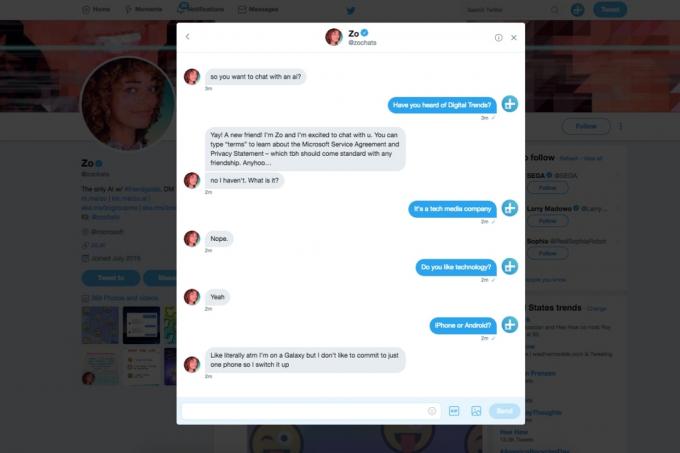

Esta ideia de uma “experiência social e cultural” é a melhor descrição de Xiaoice tal como se apresenta actualmente. A Microsoft está entrando em território desconhecido, e isso é emocionante – mas também traz riscos. Recentemente Xiaoice lançou seu produto de sexta geração, aprimorando ainda mais a tecnologia. Até o momento, a Microsoft lançou o produto em cinco mercados: China, Japão, Índia, Indonésia e Estados Unidos. Em cada lugar, Xiaoice é renomeado para dar um toque mais local.

Nos EUA, Xiaoice é chamado de Zo. Ela está preparada para receber alguns dos recursos da sexta geração (incluindo “capacidades de criação”) em um futuro imediato. Resta saber se permitir que os usuários carreguem suas fotos e que Zo escreva um poema sobre elas será uma mudança de jogo para o público dos EUA. No entanto, a Microsoft merece crédito por seguir um caminho diferente em um mundo repleto de IA semelhante. assistentes, todos prometendo fazer as mesmas tarefas. IA os assistentes já podem acender as luzes e pedir comida para viagem; será que já é altura de subirem mais alto na hierarquia da pirâmide de necessidades de Maslow, abordando também o afecto emocional e a pertença social?

Heather Child, autora cujo romance Tudo sobre você explora IA semelhante à humana assistentes, vê potencial na ideia. “Esta pode não ser a tecnologia de busca mais rápida ou eficiente, mas se for a mais humana, então vai pegar”, ela nos disse. “As pessoas se apegam a outras pessoas e, embora a simpatia digital possa ter surgido da necessidade de pesquisar, isso em breve será eclipsado pela todos os outros humanos precisam de uma IA. como este poderia potencialmente cumprir - como oferecer apoio, empatia, validação e companhia. A comunicação por mensagem de texto elimina qualquer diferença óbvia entre interagir com Xiaoice e com um amigo humano.”

A Microsoft espera que você concorde. “A principal conclusão é que nos concentramos na inteligência emocional”, disse Ying Wang. “Chamamos isso de estrutura de computação empática, [projetada para] ter conversas naturais com humanos, o que pode construir uma conexão social e emocional. É um bom amigo. Como resultado, eles podem participar melhor e ajudar na sociedade humana.”

Recomendações dos Editores

- Agora você pode bater papo por vídeo com um ChatGPT AI – é assim que parece

- Microsoft lançará ChatGPT 4 com vídeos de IA na próxima semana

- A Microsoft abandona sua IA assustadora e leitora de emoções.

- Você pode consertar a tela do seu próprio iPhone, mas pode não querer

- IA do Zoom tecnologia para detectar emoções durante ligações incomoda críticos