Quer saber o nome daquela flor ou pássaro que você encontra durante um passeio por um parque? Em breve, o Google Assistente poderá te avisar, usando a câmera e a inteligência artificial.

Vídeos recomendados

Google iniciou seu ano de 2017 Conferência de E/S em torno de IA e aprendizado de máquina, e uma tecnologia de visão computacional destacada é o Google Lens, que permite a câmera faz mais do que apenas capturar uma imagem – ela fornece um contexto maior sobre o que você está vendo.

Vindo para Google Assistente e Google Fotos, a tecnologia Google Lens pode “entender o que você está vendo e ajudá-lo a agir”, disse o CEO do Google, Sundar Pichai, durante a palestra. Por exemplo, se você apontar a câmera para uma marquise de um local de concerto, o Google Assistente poderá lhe contar mais sobre o evento. artista, além de tocar música, ajuda você a comprar ingressos para o show e adicioná-lo à sua agenda, tudo em um único aplicativo.

Quando a câmera está apontada para um objeto desconhecido, o Google Assistente, por meio de reconhecimento de imagem, pode dizer o que é. Aponte-o para a placa de uma loja e, usando informações de localização, você pode obter informações significativas sobre a empresa. Tudo isso pode ser feito por meio da interação de voz “conversacional” que o usuário mantém com o Assistant.

“Você pode apontar seu telefone para ele e nós podemos fazer o trabalho pesado automaticamente para você”, disse Pichai.

Com o Google Lens, seu Smartphone a câmera não apenas verá o que você vê, mas também entenderá o que você vê para ajudá-lo a agir. #io17pic.twitter.com/viOmWFjqk1

-Google (@Google) 17 de maio de 2017

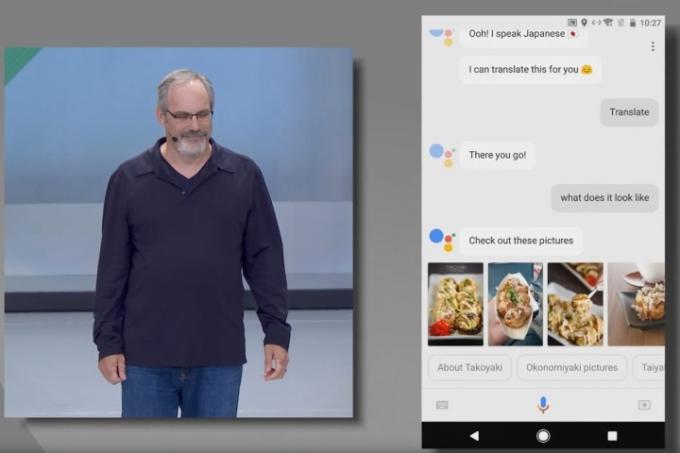

Se você usa o aplicativo Tradutor do Google, já viu como funciona a tecnologia: coloque uma câmera sobre algum texto e o aplicativo irá traduzi-lo para um idioma que você entende. No Google Assistant, o Google Lens vai levar isso adiante. Em uma demonstração, o Google mostrou que

A tecnologia de reconhecimento de imagem não é nova, mas o Google Lens mostra como o aprendizado de máquina está se tornando avançado. Pichai disse que, assim como acontece com seu trabalho na fala, o Google está vendo grandes melhorias na visão. A tecnologia de visão computacional não apenas ajuda a reconhecer o que algo é, mas pode até ajudar a reparar ou aprimorar uma imagem. Tirou uma foto borrada da Torre Eiffel? Como o computador reconhece o objeto e sabe como ele deve ser, ele pode aprimorar automaticamente a imagem com base no que já é conhecido.

“Podemos compreender os atributos por trás de uma foto”, disse Pichai. “Nossos sistemas de visão computacional agora são ainda melhores que os humanos no reconhecimento de imagens.”

Para tornar o Lens eficaz em seu trabalho, o Google está empregando uma arquitetura computacional sofisticada de Chipsets Cloud Tensor Processing Unit (TPU), para lidar com treinamento e inferência para sua máquina aprendizado. Sua tecnologia TPU de segunda geração pode lidar com 180 trilhões de operações de ponto flutuante por segundo; 64 placas TPU em um supercomputador podem lidar com 11,5 petaflops. Com esse poder computacional, a nova TPU pode lidar com treinamento e inferência simultaneamente, o que não era possível. possível no passado (a TPU anterior só conseguia lidar com o trabalho de inferência, mas não com o trabalho mais complexo treinamento). O aprendizado de máquina leva tempo, mas esse hardware ajudará a acelerar o esforço.

O Google Lens também impulsionará a próxima atualização do Google Fotos. O reconhecimento de imagem já é usado no Fotos para reconhecer rostos, lugares e coisas para ajudar na organização e pesquisa. Com o Google Lens, o Google Fotos pode fornecer mais informações sobre as coisas em suas fotos, como o nome e a descrição de um edifício; tocar em um número de telefone em uma foto fará uma ligação, obtendo mais informações sobre uma obra de arte que você viu em um museu, ou até mesmo inserir a senha do Wi-Fi automaticamente a partir de uma foto que você tirou da parte de trás de um Wi-Fi roteador.

Assistente e Fotos serão os primeiros aplicativos a usar o Google Lens, mas serão implementados em outros aplicativos. E com o anúncio do suporte para Assistant no iOS, os usuários do iPhone também poderão utilizar a tecnologia Google Lens.

Recomendações dos Editores

- Não, você realmente não precisa do Google Assistant no seu smartwatch

- 5 coisas que adoraríamos ver no Google I/O 2023 (mas provavelmente não veremos)

- Google I/O 2023 acontecerá em 10 de maio com um evento presencial

- iPhone 14 Pro vs. A batalha de câmeras do Google Pixel 7 Pro está incrivelmente próxima

- Este novo recurso do Google Lens parece saído de um filme de ficção científica

Atualize seu estilo de vidaDigital Trends ajuda os leitores a manter o controle sobre o mundo acelerado da tecnologia com as últimas notícias, análises divertidas de produtos, editoriais criteriosos e prévias únicas.