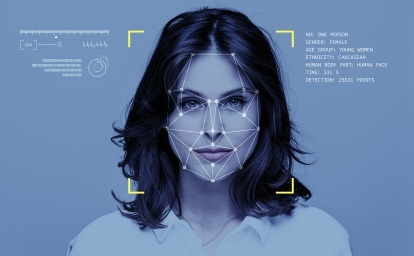

O exemplo mais recente da arrogância do Vale do Silício é o aplicativo de reconhecimento facial IA de visualização clara. O aplicativo da pequena startup é tão poderoso que alguém poderia ir até você na rua, tirar sua foto e descobrir rapidamente seu nome, endereço e número de telefone, de acordo com uma reportagem do The New York Times.

Conteúdo

- Uma nova ferramenta para abusadores

- Um problema contínuo

Esta tecnologia provavelmente parece uma ótima ideia para dois tipos de pessoas: Aplicação da lei e arrepios. Os defensores temem que esse tipo de tecnologia de reconhecimento facial possa ser uma vantagem para os perseguidores, pessoas com histórico de violência doméstica e qualquer outra pessoa que queira descobrir tudo sobre você por um motivo nefasto propósito.

Vídeos recomendados

“À medida que a notícia deste aplicativo se espalhava, as mulheres de todos os lugares suspiravam”, disse Jo O’Reilly, defensora da privacidade da ProPrivacy, com sede no Reino Unido, em declaração à Digital Trends. “Mais uma vez, a segurança das mulheres, tanto online como na vida real, ficou em segundo lugar em relação ao desejo das startups de tecnologia de criar – e monetizar – tecnologias cada vez mais invasivas.”

Relacionado

- Amazon implanta IA para resumir análises de produtos

- IA transformou Breaking Bad em anime – e é assustador

- Tecnologia de reconhecimento facial para ursos visa manter os humanos seguros

Clearview funciona, em parte, coletando dados publicamente disponíveis de sites populares de mídia social como Facebook, Twitter, YouTube e Venmo, entre outros. Um porta-voz da empresa Facebook disse à Digital Trends que “raspar

Uma nova ferramenta para abusadores

A perseguição sempre foi um problema para as mulheres online, e isso sem uma ferramenta que possa rastrear alguém com base apenas em seu rosto. Por enquanto, a Clearview afirma que está vendendo seus serviços apenas para autoridades policiais, que deram análises verdadeiramente elogiosas sobre a tecnologia. “Eles estão estranhamente silenciosos, no entanto, sobre o fato de que, nas mãos erradas, este software poderia ser utilizado para assediar e perseguir quase qualquer pessoa”, disse O’Reilly. “Isso seria impossível de evitar se o software fosse disponibilizado ao público – um cenário que os investidores da Clearview reconheceram ser possível.”

“Qualquer tecnologia que você desenvolver e que será consumida por humanos, você tem que pensar nas falhas”, disse Crystal Justice, diretor de marketing e desenvolvimento da a Linha Direta Nacional de Violência Doméstica . “Os abusadores estão sempre procurando a próxima ferramenta em sua caixa de ferramentas.”

A linha direta começou a denunciar o abuso digital como uma categoria específica em 2015 e tem registado um aumento acentuado nos números desde então, especialmente entre os jovens. Justice disse à Digital Trends que a linha direta recebeu 371 mil contatos em 2018, e 15% deles eram reclamações de abuso digital. Em média, a nível nacional, uma em cada quatro mulheres e um em cada sete homens são sobreviventes de violência doméstica, de acordo com os números da linha direta.

“Os sobreviventes constituem uma grande parte da nossa população”, disse Justice. “As empresas de tecnologia devem considerar a experiência do sobrevivente ao projetar seus aplicativos.”

Um problema contínuo

Este é um padrão persistente com muita tecnologia disruptiva nos dias de hoje. Quando o Uber foi lançado em 2009, a tecnologia parecia legal demais para ser verdade. Não éramos mais escravos das indústrias de táxis ou do transporte público incompetente em nossas respectivas cidades.

É claro que o modelo da Uber também foi diretamente contra a sabedoria convencional que aprendemos quando éramos crianças: não entre em carros com estranhos. Dez anos e vários milhares de ações judiciaissobre agressão sexual mais tarde, pareceria que havia uma razão que era a sabedoria convencional. Para muitas pessoas, entrar no carro de um estranho não é seguro, mesmo quando você paga para estar lá.

Mas este elemento de pensar em segurança, ou de ter que se deslocar pelo mundo constantemente preocupado com a sua segurança física, como muitos mulheres e pessoas de gêneros minoritários devem, não parece ter estado na mente dos homens (em sua maioria brancos) que fundaram empresas de tecnologia como a Uber, como Twitter, como tantos outros. Eles só queriam fazer algo legal que mudasse o mundo. A ideia de que seria usado para fins nefastos não passou pela cabeça deles até que fosse tarde demais.

“Fazer estas coisas para consumo público coloca os sobreviventes em risco e precisamos de pensar nas consequências não intencionais.”

A privacidade e a segurança precisam ser integradas em um aplicativo desde o início, disse Rachel Gibson, especialista sênior em segurança tecnológica da Rede Nacional para Acabar com a Violência Doméstica. “Uma coisa é que algo é construído com boas intenções, mas sabemos que a tecnologia pode ser mal utilizada”, disse Gibson ao Digital Trends. “Pensamos nisso como nova tecnologia, comportamento antigo. As pessoas ainda eram estupradas em táxis [antes do Uber], mas temos que pensar em como a tecnologia hoje em dia pode facilitar velhos comportamentos como perseguição e agressão.”

Algo como o Clearview, disse Gibson, embora tenha utilidade para a aplicação da lei, certamente levanta questões sobre como ou por que seria útil para o público em geral. “Fazer estas coisas para consumo público coloca os sobreviventes em risco e precisamos de pensar nas consequências não intencionais”, disse ela.

Justice disse que vê a conversa sobre o papel da tecnologia na segurança pública mudando. “O discurso mudou desde o MeToo”, disse ela. “E já era hora também. Este não é um problema novo. Não estamos necessariamente a assistir a um aumento da violência doméstica, estamos a ver que isso está finalmente a ser discutido. E agora podemos incluir nos elementos complexos de como a tecnologia faz parte disso.”

Gibson também disse que conversou com várias “grandes empresas de tecnologia” (embora ela não especificar qual), e eles disseram que agora estavam “tentando estar atentos” ao construir para privacidade e segurança.

Clearview deu uma breve declaração à Digital Trends, dizendo que eles “levam essas preocupações a sério e não têm planos para um lançamento comercial”. Em uma postagem no blog, a empresa enfatizou que seu produto não estava disponível ao público e que seria disponibilizado “apenas para agências de aplicação da lei e profissionais de segurança selecionados”.

Se você acredita que você ou alguém que você conhece está sofrendo abuso de parceiro íntimo, entre em contato com a Linha Direta Nacional de Violência Doméstica 24 horas por dia, 7 dias por semana, pelo telefone 1−800−799−7233.

Recomendações dos Editores

- Comentários alimentados por IA chegarão ao Wimbledon do próximo mês

- Elon Musk configura projeto de IA generativa no Twitter, afirma relatório

- Google Smart Canvas obtém integração mais profunda entre aplicativos

- Nvidia está alugando sua plataforma AI Superpod por US$ 90 mil por mês

- Portland proíbe o uso público e privado de tecnologia de reconhecimento facial