For å endre litt på tittelen på et velkjent TV-program: Kids do the darndest things. Nylig utførte forskere fra Tyskland og Storbritannia en studie, publisert i tidsskriftet Vitenskap Robotikk, som demonstrerte i hvilken grad barn er mottakelige for gruppepress fra roboter. TLDR-versjon: svaret på det gamle foreldrespørsmålet: "Hvis alle vennene dine fortalte deg å hoppe utfor en klippe, ville du det?" kan godt være "Jada. Hvis alle vennene mine var roboter.»

Innhold

- Er voksne virkelig så mye smartere?

- For hvert skip er det et forlis

Testen gjenskapte et kjent eksperiment fra 1951 som ble utviklet av den polske psykologen Solomon Asch. Eksperimentet demonstrerte hvordan mennesker kan bli påvirket av presset fra gruppetenkning, selv når dette går i møte med informasjon de vet er riktig. I Aschs eksperimenter ble en gruppe studenter samlet og vist to kort. Kortet til venstre viste et bilde av en enkelt vertikal linje. Kortet til høyre viste tre linjer med varierende lengde. Eksperimentatoren spurte deretter deltakerne hvilken linje på det høyre kortet samsvarte med lengden på linjen vist på det venstre kortet.

Anbefalte videoer

"Det spesielle med den aldersgruppen for barn er at de fortsatt er i en alder hvor de vil suspendere vantro."

Så langt, så enkelt. Hvor ting ble mer utspekulert, var imidlertid i sammensetningen av gruppen. Bare én person ut av gruppen var en ekte deltaker, mens de andre alle var skuespillere, som hadde blitt fortalt hva de skulle si på forhånd. Eksperimentet skulle teste om den virkelige deltakeren ville gå sammen med resten av gruppen når de enstemmig ga feil svar. Som det viste seg, ville de fleste. Gruppepress betyr at flertallet av mennesker vil nekte informasjon som er åpenbart korrekt hvis det betyr å samsvare med flertallets mening.

I slekt

- Utviklende, selvreplikerende roboter er her - men ikke bekymre deg for et opprør

- Roboter kommer ikke for å stjele jobben din. De kommer for å forbedre det

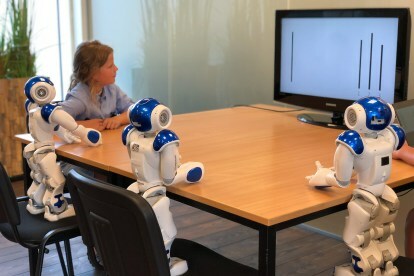

I 2018-remiksen av eksperimentet ble det samme prinsippet brukt - bare i stedet for en gruppe jevnaldrende i college-alder, var den "virkelige deltakeren" et barn i alderen syv til ni år. "Skuespillerne" ble spilt av tre roboter, programmert til å gi feil svar. I et utvalg på 43 frivillige ga 74 prosent av barna samme feil svar som robotene. Resultatene tyder på at de fleste barn i denne alderen vil behandle press fra roboter på samme måte som gruppepress fra jevnaldrende av kjøtt og blod.

"Det spesielle med den aldersgruppen for barn er at de fortsatt er i en alder hvor de vil suspendere vantro," Tony Belpaeme, fortalte professor i intelligente og autonome kontrollsystemer, som hjalp til med å gjennomføre studien, til Digital Trends. «De vil leke med leker og fortsatt tro at actionfigurene eller dukkene deres er ekte; de vil fortsatt se på et dukketeater og virkelig tro på hva som skjer; de kan fortsatt tro på [julenissen]. Det er det samme når de ser på en robot: de ser ikke elektronikk og plast, men snarere en sosial karakter.»

Interessant nok kontrasterte eksperimentet dette med responsen fra voksne. I motsetning til barna, ble ikke voksne påvirket av robotenes feil. "Når en voksen så roboten gi feil svar, ga de den et forvirret blikk og ga deretter det riktige svaret," fortsatte Belpaeme.

Så ingenting å bekymre seg for da? Så lenge vi hindrer barn i å få tak i roboter programmert til å gi dårlige svar, burde alt være bra, ikke sant? Ikke vær så rask.

Er voksne virkelig så mye smartere?

Som Belpaeme erkjente, var denne oppgaven designet for å være så enkel at det ikke var noen usikkerhet om hva svaret kunne være. Den virkelige verden er annerledes. Når vi tenker på hva slags jobber som lett kan overlates til maskiner, er dette ofte oppgaver som vi som mennesker ikke alltid er i stand til å utføre perfekt.

Denne oppgaven ble designet for å være så enkel at det ikke var noen usikkerhet om hva svaret kunne være.

Det kan være at oppgaven er utrolig enkel, men at maskinen kan utføre den betydelig raskere enn vi kan. Eller det kan være en mer kompleks oppgave, der datamaskinen har tilgang til langt større datamengder enn oss. Avhengig av den potensielle påvirkningen av jobben som er for hånden, er det ingen overraskelse at mange av oss ville være misfornøyde med å korrigere en maskin.

Ville en sykepleier på et sykehus være glad for å overstyre FDA-godkjent algoritme som kan bidra til å gjøre prioriteringer om pasientens helse ved å overvåke vitale tegn og deretter sende varsler til medisinsk personell? Eller ville en sjåfør være komfortabel med å ta rattet fra en førerløs bil når han håndterer et spesielt komplekst veiscenario? Eller til og med en pilot som overstyrer autopiloten fordi de tror feil beslutning blir tatt? I alle disse tilfellene vil vi tro at svaret er «ja». Av alle slags grunner er det kanskje ikke virkeligheten.

Nicholas Carr skriver om dette i sin bok fra 2014 Glassburet: Hvor automatisering tar oss. Måten han beskriver det på understreker den typen tvetydighet som virkelige tilfeller av automatisering innebærer, der problemene er langt mer kompleks enn lengden på en linje på et kort, maskinene er mye smartere, og utfallet er potensielt mer avgjørende.

"Hvordan måler du kostnadene ved en erosjon av innsats og engasjement, eller en avtakende handlefrihet og autonomi, eller en subtil forringelse av ferdigheter? Det kan du ikke», skriver han. "Dette er den typen skyggefulle, immaterielle ting som vi sjelden setter pris på før etter at de er borte, og selv da kan vi ha problemer med å uttrykke tapene i konkrete termer."

"Dette er den typen skyggefulle, immaterielle ting som vi sjelden setter pris på før etter at de er borte."

Sosiale roboter av den typen som Belpaeme teoretiserer om i forskningsoppgaven er ennå ikke mainstream, men allerede er det illustrasjoner av noen av disse gåtene i aksjon. For eksempel åpner Carr boken sin med omtale av et notat fra Federal Aviation Administration som bemerket hvordan piloter bør bruke mindre tid på å fly på autopilot på grunn av risikoen dette utgjorde. Dette var basert på analyse av krasjdata, som viste at piloter ofte stoler for sterkt på datastyrte systemer.

En lignende sak involverte et søksmål fra 2009 der en kvinne ved navn Lauren Rosenberg anla søksmål mot Google etter å ha blitt rådet til å gå langs en rute som ledet inn i farlig trafikk. Selv om saken ble kastet ut av retten, viser den at folk vil overstyre sin egen sunne fornuft i troen på at maskinell intelligens har mer intelligens enn oss.

For hvert skip er det et forlis

Til syvende og sist, som Belpaeme erkjenner, er problemet at noen ganger ønsker vi å overlate beslutningstaking til maskiner. Roboter lover å gjøre jobbene som er kjedelige, skitne og farlige – og hvis vi må gjette hver eneste avgjørelse, er de egentlig ikke de arbeidsbesparende enhetene som har blitt lovet. Hvis vi til slutt skal invitere roboter inn i hjemmet vårt, vil vi at de skal kunne handle autonomt, og det vil innebære et visst nivå av tillit.

«Roboter som utøver sosialt press på deg kan være en god ting; det trenger ikke å være skummelt,» fortsatte Belpaeme. «Hvis du har roboter brukt i helsevesenet eller utdanning, vil du at de skal kunne påvirke deg. For eksempel, hvis du ønsker å gå ned i vekt kan du få en vekttapsrobot i to måneder som monitorer kaloriinntaket ditt og oppmuntrer deg til å trene mer. Du vil at en slik robot skal være overbevisende og påvirke deg. Men all teknologi som kan brukes til det gode, kan også brukes til det onde.»

Hva er svaret på dette? Spørsmål som dette vil bli diskutert fra sak til sak. Hvis det dårlige til syvende og sist veier opp for det gode, vil teknologi som sosiale roboter aldri ta av. Men det er viktig at vi tar den rette lærdommen fra studier som den om robotindusert gruppepress. Og det er ikke det faktum at vi er så mye smartere enn barn.

Redaktørenes anbefalinger

- Fremtiden for automatisering: Roboter kommer, men de vil ikke ta jobben din

- Disse robotene tar ihjel ugresset slik at bønder ikke trenger kjemiske ugressmidler