Prognozējošā policijas darbība bija paredzēts pārveidot policijas darbības veidu, ievedot mūs gudru tiesību pasaulē izpilde, kurā neobjektivitāte tika noņemta un policija varētu reaģēt uz datiem, nevis uz nojautas. Taču desmit gadus pēc tam, kad lielākā daļa no mums pirmo reizi dzirdēja terminu “prognozējošā kārtības nodrošināšana”, šķiet skaidrs, ka tas nav strādājis. Sabiedrības pretreakciju dēļ tehnoloģija piedzīvo ievērojamu tās lietojuma samazināšanos, salīdzinot ar situāciju tikai pirms dažiem gadiem.

Saturs

- Prognozējošas policijas solījums

- Diskriminējošie algoritmi

- Netīro datu briesmas

- Prognozējošās policijas darbības neskaidrā nākotne

- Nepareizi instrumenti darbam?

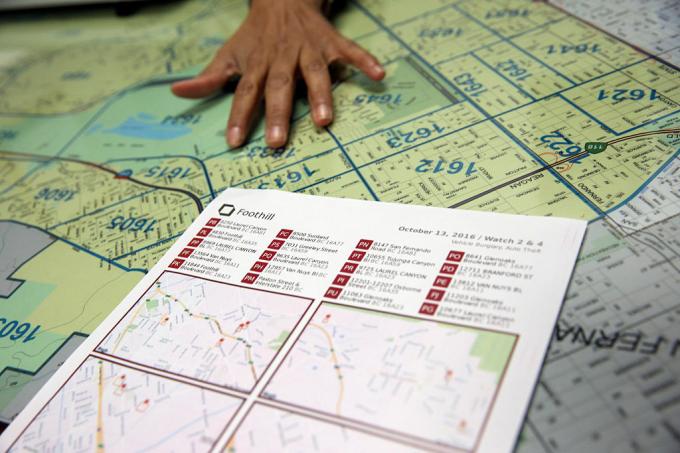

Šā gada aprīlī Losandželosa, kas, saskaņā ar LA Times datiem, bija “pirmā noziedzības prognozēšana, izmantojot datus”, samazināja finansējumu savai paredzamās policijas programmas, vainojot izmaksas. "Tas ir smags lēmums," policijas priekšnieks Mišels Mūrs pastāstīja LA Times. “Tā ir stratēģija, ko mēs izmantojām, taču izmaksu prognozes ir simtiem tūkstošu dolāru, ko tērēt šīm tiesībām tagad, salīdzinot ar šīs naudas atrašanu un šīs naudas novirzīšanu citām svarīgākām aktivitātēm, man ir jādara.

Ieteiktie videoklipi

Kas notika? Kā kaut kas, kas tiek reklamēts kā “gudra” tehnoloģija, varētu izraisīt vēl vairāk iesakņojušos aizspriedumus un diskrimināciju? Un vai sapnis par paredzamo policijas darbu ir tāds, ko varētu pielāgot ar pareizo algoritmu, vai tas ir strupceļš godīgākā sabiedrībā, kas pašlaik cīnās ar to, kā policijai vajadzētu darboties?

Prognozējošas policijas solījums

Prognozējošā policijas darbība tās pašreizējā formā aizsākās apmēram desmit gadus pēc psiholoģes Kolīnas Makkjū un Losandželosas policijas priekšnieka Čārlija Beka 2009. gada raksta ar nosaukumu “Prognozējošā policijas darbība: ko mēs varam mācīties no Walmart un Amazon par noziedzības apkarošanu lejupslīdes laikā?Rakstā viņi aplūkoja veidu, kā lielākie mazumtirgotāji izmanto lielos datus, lai palīdzētu atklāt pircēju pagātnes uzvedības modeļus, ko varētu izmantot, lai prognozētu turpmāko uzvedību. Pateicoties progresam gan skaitļošanas, gan datu vākšanas jomā, Makkjū un Beks ierosināja, ka ir iespējams savākt un analizēt noziegumu datus reāllaikā. Pēc tam šos datus varētu izmantot, lai paredzētu, novērstu un efektīvāk reaģētu uz noziegumiem, kas vēl nebija notikuši.

Kopš tā laika daudzās ASV daļās, tāpat kā pārējā pasaulē, paredzamā policijas darbība ir pārgājusi no nelietderīgas idejas uz realitāti. Šajā procesā tā ir nolēmusi mainīt policijas darbu no reaģējoša spēka uz proaktīvu; balstoties uz dažiem sasniegumiem datu vadītā tehnoloģijā, kas ļauj pamanīt modeļus reāllaikā un rīkoties saskaņā ar tiem.

"Ir divi galvenie paredzamās policijas veidi," Endrjū Fergusons, Kolumbijas apgabala universitātes tiesību profesors Deivids A. Klārka Juridiskā skola un autors Lielo datu policijas uzplaukums: uzraudzība, sacīkstes un tiesībaizsardzības nākotne, stāstīja Digital Trends. "[Tie ir] uz vietu balstīta paredzamā policijas darbība un uz personu balstīta prognozēšana."

Abos gadījumos paredzamās policijas sistēmas attiecīgajai personai vai vietai piešķir riska punktu, kas mudina policiju veikt uzraudzību noteiktā intervālā. Pirmā no šīm pieejām, uz vietas balstīta prognozēšana, galvenokārt koncentrējas uz policijas patruļām. Tas ietver noziegumu kartēšanas un analītikas izmantošanu par iespējamām turpmāko noziegumu vietām, pamatojoties uz iepriekšējo statistiku.

Tā vietā, lai palīdzētu atbrīvoties no tādām problēmām kā rasisms un citi sistēmiski aizspriedumi, prognozēšanas kārtība var palīdzēt tās nostiprināt.

Otrā pieeja ir vērsta uz iespējamības prognozēšanu, ka indivīds rada potenciālu nākotnes risku. Piemēram, 2013. gadā Čikāgas policijas komandieris tika nosūtīts uz 22 gadus vecā Roberta Makdaniela māju, kuru Čikāgas pilsētas centrā atzīmēja kā potenciālu vardarbības izraisītāju vai vardarbības veicēju ar ieročiem algoritms. “Karstuma saraksts”, kuru algoritms palīdzēja sastādīt, meklēja modeļus, kas varētu paredzēt turpmākos likumpārkāpējus vai upuriem, pat ja viņi paši nav darījuši neko, lai garantētu šo pārbaudi, izņemot atbilstību a profils.

Kā atzīmēja Chicago Tribune: “Stratēģija aicina individuāli brīdināt karstuma sarakstā esošos, ka turpmāk noziedzīga darbība, pat par vissīkākajiem nodarījumiem, likuma spēks tiks pilnībā samazināts viņiem.”

Sapnis par prognozējamu policijas darbu bija tāds, ka, rīkojoties pēc kvantitatīvi izsakāmiem datiem, tā padarītu policijas darbu ne tikai efektīvāku, bet arī mazāk pakļautu minējumiem un līdz ar to neobjektivitātei. Atbalstītāji apgalvoja, ka tas mainītu policijas darbu uz labo pusi un uzsāktu jaunu gudras policijas ēru. Tomēr jau gandrīz no paša sākuma paredzamajai policijas darbībai ir bijuši stingri kritiķi. Viņi apgalvo, ka prognozējošā kārtības nodrošināšana var palīdzēt tās nostiprināt, nevis palīdzēt atbrīvoties no tādām problēmām kā rasisms un citi sistēmiski aizspriedumi. Un ir grūti iebilst, ka viņiem nav jēgas.

Diskriminējošie algoritmi

Ideja, ka uz mašīnmācībām balstītas paredzamās policijas sistēmas var iemācīties diskriminēt, pamatojoties uz tādiem faktoriem kā rase, nav nekas jauns. Mašīnmācības rīki tiek apmācīti, izmantojot milzīgus datu apjomus. Un, kamēr šos datus apkopo sistēma, kurā rase joprojām ir pārliecinošs faktors, tas var izraisīt diskrimināciju.

Kā stāsta Renāta M. O’Donels raksta 2019. gada dokumentā ar nosaukumu “Izaicināt rasistiskus paredzamus policijas algoritmus saskaņā ar vienlīdzīgas aizsardzības klauzulu”, mašīnmācīšanās algoritmi mācās no datiem, kas iegūti no tiesu sistēmas, kurā “melnādainie amerikāņi tiek ieslodzīti štata cietumos ar ātrumu tas ir 5,1 reizi vairāk nekā balto ieslodzījums, un viens no katriem trim šodien dzimušajiem melnādainajiem vīriešiem savas dzīves laikā var nonākt cietumā, ņemot vērā pašreizējās tendences Turpināt."

"Dati nav objektīvi," Fērgusons sacīja Digital Trends. “Mēs esam tikai reducēti uz bināro kodu. Uz datiem balstītas sistēmas, kas darbojas reālajā pasaulē, nav objektīvākas, godīgākas vai objektīvākas par reālo pasauli. Ja jūsu reālā pasaule ir strukturāli nevienlīdzīga vai rasu ziņā diskriminējoša, uz datiem balstīta sistēma atspoguļos šīs sabiedrības nevienlīdzības. Ievadītās ievades ir neobjektivitātes. Analīze ir neobjektivitāte. Un policijas varas mehānismi nemainās tikai tāpēc, ka ir tehnoloģijas, kas vada sistēmas.

Fergusons min piemēru par arestiem kā vienu šķietami objektīvu faktoru riska prognozēšanā. Tomēr arestus novirzīs policijas resursu sadalījums (piemēram, kur viņi patrulē) un noziegumu veidi, kas parasti ir aresti. Šis ir tikai viens piemērs potenciāli problemātiskiem datiem.

Netīro datu briesmas

Trūkstošie un nepareizie dati datu ieguvē dažkārt tiek saukti par “netīriem datiem”. A 2019. gada pētnieku no A.I. Tagad Ņujorkas universitātes institūts paplašina šo terminu, lai apzīmētu arī datus, kurus ietekmē korumpēti, neobjektīvi un nelikumīgi prakses — neatkarīgi no tā, vai tās ir tīši manipulētas, ko izkropļojušas personas un sabiedrības aizspriedumiem. Tā varētu, piemēram, ietvert datus, kas iegūti, arestējot nevainīgu personu, kurai ir bijuši pierādījumi vai kura ir citādi nepatiesi apsūdzēta.

Ir zināma ironija faktā, ka pēdējo desmitgažu laikā datu sabiedrības prasības, kurās viss ir saistīts ar kvantitatīvo noteikšanu un čuguna skaitliskiem mērķiem, tikko ir novedis pie daudz... nu, tiešām slikti dati. HBO seriāls Stieple demonstrēja reālās pasaules fenomenu “statistikas pārsūtīšana”, un gadi, kopš šovs izskanēja ēterā, ir piedāvājuši daudz piemēri faktiskām sistēmiskām manipulācijām ar datiem, viltotiem policijas ziņojumiem un antikonstitucionālai praksei, kas ir nosūtījusi nevainīgus cilvēkus cietums.

Viena lieta ir slikti dati, kas ļauj varas cilvēkiem mākslīgi trāpīt mērķiem. Bet apvienojiet to ar algoritmiem un prognozēšanas modeļiem, kas to izmanto kā pamatu pasaules modelēšanai, un jūs, iespējams, iegūsit kaut ko daudz sliktāku.

Pētnieki ir parādījuši, kā apšaubāmi noziedzības dati, kas pievienoti paredzamajiem policijas algoritmiem, var radīt to, ko sauc par "bēguļojošas atgriezeniskās saites cilpas”, kurā policija atkārtoti tiek nosūtīta uz tiem pašiem rajoniem neatkarīgi no patiesā noziedzības līmeņa. Viens no šī raksta līdzautoriem, datorzinātnieks Suresh Venkatasubramanian, saka, ka mašīnmācīšanās modeļi var veidot kļūdainus pieņēmumus, izmantojot to modelēšanu. Tāpat kā vecais teiciens par to, ka cilvēkam ar āmuru katra problēma izskatās kā nagla, šīs sistēmas modelē tikai noteiktus problēmas elementus un iedomājieties tikai vienu iespējamo iznākumu.

"[Kaut kas] šajos modeļos netiek apskatīts, ir tas, cik lielā mērā jūs modelējat faktu, ka vairāk policistu izmešana apgabalā faktiski var pazeminātu dzīves kvalitāti cilvēkiem, kas tur dzīvo? Venkatasubramanian, Jūtas Universitātes Datortehnikas skolas profesors, pastāstīja Digital Tendences. "Mēs pieņemam, ka vairāk policistu ir labāka lieta. Taču, kā mēs šobrīd redzam, vairāk policijas ne vienmēr ir laba lieta. Tas faktiski var pasliktināt situāciju. Nevienā modelī, ko es jebkad esmu redzējis, kāds jebkad ir jautājis, cik maksā vairāk policijas izvietošana rajonā.

Prognozējošās policijas darbības neskaidrā nākotne

Tie, kas strādā paredzamajā policijas darbā, dažreiz unironiski lieto terminu “Mazākuma ziņojums”, lai norādītu uz prognozēšanas veidu, ko viņi dara. Šis termins bieži tiek izmantots kā atsauce uz 2002. gada filma ar tādu pašu nosaukumu, kas savukārt bija brīvi balstīta uz 1956. gada Filipa K. noveli. Diks. In Mazākuma ziņojums, īpaša pirmsnoziedzības policijas nodaļa aiztur noziedzniekus, pamatojoties uz iepriekšēju zināšanām par noziegumiem, kas tiks pastrādāti nākotnē. Šīs prognozes sniedz trīs ekstrasensi, kurus sauc par "priekšsēdekļiem".

Bet pagrieziens iekšā Mazākuma ziņojums ir tas, ka prognozes ne vienmēr ir precīzas. Viena no priekšgājējiem atšķirīgas vīzijas sniedz alternatīvu skatījumu uz nākotni, kas tiek apspiests, baidoties likt sistēmai šķist neuzticama.

Iekšējie auditi, kas parāda taktiku, nedarbojās. Prognozējošie saraksti bija ne tikai kļūdaini, bet arī neefektīvi.

Šobrīd paredzamā policijas darbība saskaras ar savu nenoteikto nākotni. Līdzās jaunām tehnoloģijām, piemēram, sejas atpazīšanai, tiesībaizsardzības iestādēm iespējamā izmantošanai pieejamā tehnoloģija nekad nav bijusi tik jaudīga. Tajā pašā laikā izpratne par prognozējamās policijas izmantošanu ir izraisījusi sabiedrības pretreakciju, kas, iespējams, faktiski palīdzēja to atcelt. Fērgusons pastāstīja Digital Trends, ka prognozējošo policijas rīku izmantošana pēdējos gados ir bijusi “samazināta”.

"Savā zenītā [uz vietu balstīta prognozēšana] bija vairāk nekā 60 lielākajās pilsētās un pieauga, taču veiksmīgai kopienas organizēšanai, tā lielā mērā ir samazināta un vai aizstāta ar citiem datu virzītas darbības veidiem analītika,” viņš teica. "Īsumā sakot, termins "prognozējošā kārtība" kļuva toksisks, un policijas departamenti iemācījās pārdēvēt to, ko viņi dara ar datiem. Straujāks kritums bija uz personu balstītai paredzamajai policijai. Divas galvenās pilsētas, kas ieguldīja tās izveidē - Čikāga un Losandželosa - atteicās no savām personībām stratēģijas pēc asas kopienas kritikas un postošajiem iekšējiem auditiem, kas liecina, ka taktika tā nebija strādāt. Prognozējošie saraksti bija ne tikai kļūdaini, bet arī neefektīvi.

Nepareizi instrumenti darbam?

tomēr Rašida Ričardsone, politikas izpētes direktors A.I. Tagad institūts teica, ka šīs tehnoloģijas izmantošana ir pārāk neskaidra. "Mēs joprojām nezinām, jo trūkst pārredzamības attiecībā uz valdības tehnoloģiju iegādi un daudzām citām nepilnības esošajās iepirkuma procedūrās, kas var pasargāt noteiktus tehnoloģiju iepirkumus no sabiedrības kontroles. viņa teica. Viņa sniedz piemēru par tehnoloģijām, kuras var bez maksas nodot policijas departamentam vai iegādāties trešā puse. "No pētījumiem, piemēram, maniem un plašsaziņas līdzekļiem, mēs zinām, ka daudzi no lielākajiem policijas departamentiem ASV ir izmantojuši tehnoloģiju kādā brīdī, taču ir arī daudzas mazas policijas nodaļas, kas to izmanto vai ir izmantojušas ierobežotu laiku no laika."

Ņemot vērā pašreizējos jautājumus par policijas lomu, vai radīsies kārdinājums no jauna pieņemties paredzamā policijas darbība kā rīks uz datiem balstītai lēmumu pieņemšanai — iespējams, mazāk distopiskas zinātniskās fantastikas ietvaros zīmola veidošana? Pastāv iespēja, ka šāda atdzimšana varētu rasties. Bet Venkatasubramanian ir ļoti skeptisks par to, ka mašīnmācība, kā pašlaik tiek praktizēta, ir īstais rīks šim darbam.

“Mašīnmācības kopums un tās panākumi mūsdienu sabiedrībā ir balstīti uz pieņēmumu, ka neatkarīgi no faktiskā problēma, galu galā ir jāsavāc dati, jāizveido modelis, jāparedz rezultāts — un jums nav jāuztraucas par domēnu. viņš teica. “Jūs varat uzrakstīt vienu un to pašu kodu un lietot to 100 dažādās vietās. Tas ir abstrakcijas un pārnesamības solījums. Problēma ir tāda, ka tad, ja mēs izmantojam to, ko cilvēki sauc par sociāli tehniskām sistēmām, kur cilvēki un tehnoloģijas ir sajauktas sarežģītos viļņos, jūs to nevarat izdarīt. Jūs nevarat vienkārši pievienot gabalu un gaidīt, ka tas darbosies. Jo [ir] viļņošanās efekti, ieliekot šo gabalu un to, ka ir dažādi spēlētāji ar dažādām programmām šādā sistēmā, un viņi sagrauj sistēmu savām vajadzībām Dažādi ceļi. Visas šīs lietas ir jāņem vērā, runājot par efektivitāti. Jā, var abstrakti teikt, ka viss darbosies labi, bet tur ir nav abstrakta. Ir tikai konteksts, kurā jūs strādājat.