ChatGPT eksplodē, un tā AI modeļa mugurkauls balstās uz Nvidia grafikas kartēm. Viens analītiķis teica ChatGPT apmācīšanai tika izmantoti aptuveni 10 000 Nvidia GPU, un, pakalpojumam turpinot paplašināties, pieaug arī nepieciešamība pēc GPU. Ikviens, kurš pārdzīvoja kriptovalūtas pieaugumu 2021. gadā, var sajust a GPU trūkums pie apvāršņa.

Saturs

- Kāpēc Nvidia GPU ir izstrādāti AI

- Tas viss paliek atmiņā

- Dažādas vajadzības, dažādas dies

Esmu redzējis, ka daži reportieri izveido šo precīzu savienojumu, taču tas ir maldīgs. Kriptogrāfijas vadīta tipa GPU trūkuma laiki ir aiz muguras. Lai gan mēs, visticamāk, redzēsim pieprasījuma pieaugumu grafiskās kartes AI turpina uzplaukt, šis pieprasījums nav vērsts uz labākās grafikas kartes uzstādīts iekšā spēļu iekārtas.

Ieteiktie videoklipi

Kāpēc Nvidia GPU ir izstrādāti AI

Pirmkārt, mēs aplūkosim, kāpēc Nvidia

Saistīts

- Wix izmanto ChatGPT, lai palīdzētu ātri izveidot visu vietni

- ChatGPT veidotājs OpenAI saskaras ar FTC izmeklēšanu par patērētāju aizsardzības likumiem

- ChatGPT Bing pārlūkošanas funkcija ir atspējota maksas sienas piekļuves trūkuma dēļ

CUDA ir Nvidia lietojumprogrammu interfeiss (API), ko izmanto visās jomās, sākot no visdārgākajiem datu centra GPU līdz tā. lētākie spēļu GPU. CUDA paātrinājums tiek atbalstīts mašīnmācīšanās bibliotēkās, piemēram, TensorFlow, ievērojami paātrina apmācību un secinājums. CUDA ir dzinējspēks AMD tik tālu atpaliek no AI salīdzinot ar Nvidia.

Tomēr nejauciet CUDA ar Nvidia CUDA kodoliem. CUDA ir platforma, kurā darbojas daudzas AI lietotnes, savukārt CUDA kodoli ir tikai Nvidia GPU kodoli. Viņiem ir kopīgs nosaukums, un CUDA kodoli ir labāk optimizēti, lai palaistu CUDA lietojumprogrammas. Nvidia spēļu GPU ir CUDA kodoli, un tie atbalsta CUDA lietotnes.

Tensor kodoli būtībā ir paredzēti AI kodoli. Viņi apstrādā matricas reizināšanu, kas ir slepenā mērce, kas paātrina AI apmācību. Ideja šeit ir vienkārša. Reiziniet vairākas datu kopas vienlaikus un apmāciet AI modeļus eksponenciāli ātrāk, ģenerējot iespējamos rezultātus. Lielākā daļa procesoru uzdevumus apstrādā lineāri, savukārt Tensor kodoli var ātri ģenerēt scenārijus vienā pulksteņa ciklā.

Atkal, Nvidia spēļu GPU, piemēram, RTX 4080 ir Tensor kodoli (un dažreiz pat vairāk nekā dārgi datu centra GPU). Tomēr visām Nvidia kartēm ir jāpaātrina AI modeļi, taču neviena no tām nav tik svarīga kā atmiņa. Un Nvidia spēļu GPU nav daudz atmiņas.

Tas viss paliek atmiņā

"Atmiņas lielums ir vissvarīgākais," saka Džefrijs Hītons, vairāku grāmatu autors par mākslīgo intelektu un Vašingtonas universitātes profesors Sentluisā. “Ja jums nav pietiekami daudz GPU

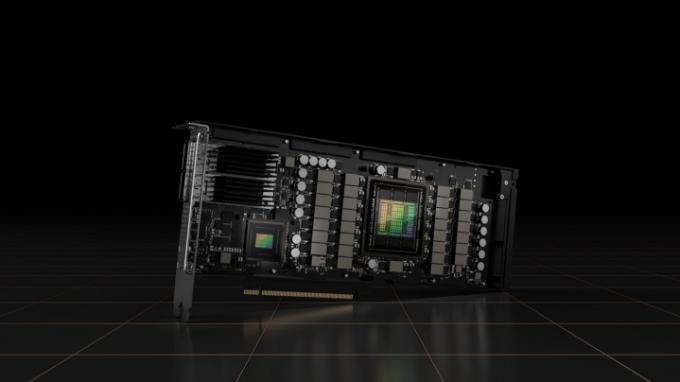

Hītons, kurš ir YouTube kanāls veltīts tam, cik labi AI modeļi darbojas ar noteiktiem GPU, atzīmēja, ka svarīgi ir arī CUDA kodoli, taču atmiņas ietilpība ir dominējošais faktors, kad runa ir par GPU darbību AI. The RTX 4090 ir daudz atmiņas pēc spēļu standartiem — 24 GB GDDR6X — bet ļoti maz, salīdzinot ar datu centra klases GPU. Piemēram, Nvidia jaunākajam H100 GPU ir 80 GB HBM3 atmiņa, kā arī milzīga 5120 bitu atmiņas kopne.

Jūs varat iztikt ar mazāku daudzumu, taču jums joprojām ir nepieciešams daudz atmiņas. Heaton iesaka iesācējiem izmantot ne mazāk kā 12 GB, savukārt parastajam mašīnmācības inženierim būs viens vai divi 48 GB profesionāli. Nvidia GPU. Pēc Hītona teiktā, “lielākā daļa darba slodzes vairāk samazināsies no viena A100 līdz astoņām A100 diapazonā”. Nvidia A100 GPU ir 40 GB atmiņa.

Šo mērogošanu var redzēt arī darbībā. Puget sistēmas parāda vienu A100 ar 40 GB atmiņu, kas darbojas apmēram divas reizes ātrāk nekā viens RTX 3090 ar 24 GB atmiņu. Un tas ir neskatoties uz to, ka RTX 3090 ir gandrīz divreiz vairāk CUDA kodolu un gandrīz tikpat daudz Tensor kodolu.

Atmiņa ir sašaurinājums, nevis neapstrādāta apstrādes jauda. Tas ir tāpēc, ka AI modeļu apmācība balstās uz lielām datu kopām, un jo vairāk šo datu varat saglabāt atmiņā, jo ātrāk (un precīzāk) varat apmācīt modeli.

Dažādas vajadzības, dažādas dies

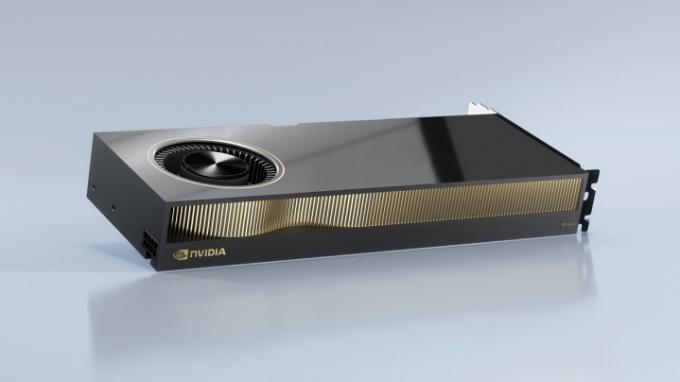

Nvidia spēļu GPU parasti nav piemēroti AI, jo tiem ir maz video atmiņas salīdzinājumā ar uzņēmuma līmeņa aparatūru, taču šeit ir arī atsevišķa problēma. Nvidia darbstaciju GPU parasti nedala GPU kausu ar spēļu kartēm.

Piemēram, A100, uz kuru atsaucās Hītons, izmanto GA100 GPU, kas ir Nvidia Ampere sērijas matrica, kas nekad netika izmantota uz spēlēm orientētās kartēs (tostarp augstākās klases kartēs). RTX 3090 Ti). Līdzīgi, Nvidia jaunākajā H100 tiek izmantota pilnīgi cita arhitektūra nekā RTX 40 sērijai, kas nozīmē, ka tā izmanto arī citu formu.

Ir izņēmumi. Nvidia AD102 GPU, kas atrodas iekšpusē RTX 4090 un RTX 4080, tiek izmantots arī nelielā Ada Lovelace uzņēmuma GPU klāstā (L40 un RTX 6000). Tomēr vairumā gadījumu Nvidia nevar vienkārši izmantot spēļu GPU veidni datu centra kartei. Tās ir atsevišķas pasaules.

Pastāv dažas būtiskas atšķirības starp GPU deficītu, ko redzējām kriptoraktu ieguves dēļ, un AI modeļu popularitātes pieaugumu. Saskaņā ar Heaton teikto, GPT-3 modelim bija nepieciešami vairāk nekā 1000 A100 Nvidia GPU, lai vilcienos un apmēram astoņi, lai darbotos. Šiem GPU ir arī piekļuve liela joslas platuma NVLink starpsavienojumam, savukārt Nvidia RTX 40 sērijas GPU nav. Tas salīdzina maksimālo 24 GB atmiņu Nvidia spēļu kartēs ar vairākiem simtiem GPU, piemēram, A100 ar NVLink.

Pastāv arī dažas citas bažas, piemēram, atmiņu uzlikšana profesionāliem GPU, nevis spēļu GPU, bet dienas, kad jāsteidzas uz vietējo Micro Center vai Best Buy, lai atrastu GPU noliktavā, ir pagājis. Hītons to labi rezumēja: “Tiek lēsts, ka lieliem valodu modeļiem, piemēram, ChatGPT, ir nepieciešami vismaz astoņi GPU, lai tie darbotos. Šādos aprēķinos tiek pieņemti augstākās klases A100 GPU. Manas spekulācijas ir, ka tas varētu izraisīt augstākās klases GPU deficītu, taču tas var neietekmēt spēlētāju klases GPU, jo mazāk.

Redaktoru ieteikumi

- Labākie autori pieprasa samaksu no AI firmām par viņu darba izmantošanu

- Google Bard tagad var runāt, bet vai tas var noslāpēt ChatGPT?

- ChatGPT vietnes trafika ir samazinājusies pirmo reizi

- 81% uzskata, ka ChatGPT ir drošības risks, liecina aptauja

- Apple ChatGPT sāncensis var automātiski rakstīt kodu jūsu vietā

Uzlabojiet savu dzīvesveiduDigitālās tendences palīdz lasītājiem sekot līdzi steidzīgajai tehnoloģiju pasaulei, izmantojot visas jaunākās ziņas, jautrus produktu apskatus, ieskatu saturošus rakstus un unikālus ieskatus.