良いニュース? 彼らはまだ圧倒的多数の人々に認識されていません。 悪い知らせは? 彼らは現代のコンピューターサイエンスを騙しません。

おすすめ動画

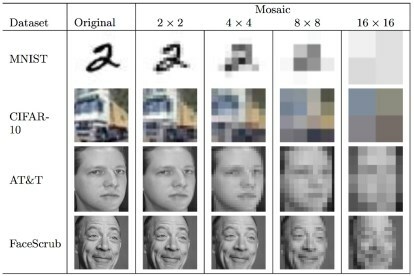

この情報は、テキサス大学オースティン校とコーネル大学の研究者らによって実施された新しいプロジェクトによるものです。 ディープラーニング に 編集されたアイデンティティを正確に推測する 難読化によって隠された人々の。 人間が個人情報を正確に編集できる確率は 0.19% でしたが、機械学習システムは 5 回の試行を許可した場合、83% の精度で正しい判断を下すことができました。

「ぼかしやピクセル化は、写真やビデオで人の身元を隠すためによく使用されます。」 ヴィタリー・シュマチコフとコーネル大学のコンピューターサイエンス教授はデジタルトレンドに語った。 「これらのシナリオの多くでは、敵は少数の潜在的な人々についてかなりよく知っています。 画像に誰が写っている可能性があるか、そして彼はその中の誰が写っているかを把握するだけで済みます。 写真。"

これはまさにチームのテクノロジーがうまく機能するシナリオである、とシュマチコフ氏は続けた。 「これは、誰かの身元を暴露することで危険にさらされる場合、ぼかし、ピクセル化、その他の画像難読化手法ではあまり保護できない可能性があることを示しています」と彼は述べた。

もちろん、課題は、個人の身元を編集するこのような方法が、内部告発者や犯罪の目撃者などの個人を保護するために使用されることが多いことです。 このような画像認識アルゴリズムを適用することで、 人工ニューラルネットワークしたがって、既製のツールを使用して難読化された画像では、人々が危険にさらされる可能性があります。

「根本的な課題は、プライバシー保護技術と機械学習の間のギャップを埋めることです」とシュマチコフ氏は語った。 「プライバシー テクノロジーの設計者の多くは、最新の機械学習の力を十分に理解していません。そのため、実際にはプライバシーを保護しないテクノロジーが生み出されてしまいます。」

編集者のおすすめ

- Google Pixel 4a 5G に対して Verizon 5G 税を支払わないでください

- 話さないでください: このウェアラブルを使用すると、何も言わずに音声コマンドを与えることができます

- だまされないでください。この自動システムはビデオ コンテンツをこっそり操作します

ライフスタイルをアップグレードするDigital Trends は、読者が最新ニュース、楽しい製品レビュー、洞察力に富んだ社説、ユニークなスニーク ピークをすべて提供して、ペースの速いテクノロジーの世界を監視するのに役立ちます。