チャットGPT は爆発的に成長しており、その AI モデルのバックボーンは Nvidia グラフィックス カードに依存しています。 あるアナリストはこう語った ChatGPT のトレーニングには約 10,000 個の Nvidia GPU が使用されました。サービスが拡大し続けるにつれて、GPU の必要性も高まります。 2021 年の仮想通貨の隆盛を生きた人なら誰でも、その匂いを感じることができるでしょう。 GPU不足 地平線に。

コンテンツ

- Nvidia GPU が AI 向けに構築されている理由

- すべては記憶に帰着する

- 異なるニーズ、異なる金型

何人かの記者がまさにそのような関係を築いているのを見てきましたが、それは見当違いです。 暗号通貨駆動型の GPU が不足する時代は終わりました。 おそらく需要が急増すると思われますが、 グラフィックスカード AI のブームが続く中、その需要は、 最高のグラフィックスカード にインストールされています ゲームリグ.

おすすめ動画

Nvidia GPU が AI 向けに構築されている理由

まず、Nvidia が選ばれる理由を説明します。

関連している

- Wix は ChatGPT を使用して、ウェブサイト全体を迅速に構築するのに役立ちます

- ChatGPTメーカーのOpenAIは消費者保護法を巡りFTCの捜査に直面している

- ChatGPT の Bing ブラウジング機能がペイウォール アクセスの欠陥により無効になる

CUDA は、Nvidia のアプリケーション プログラミング インターフェイス (API) で、最も高価なデータ センターの GPU から 最安のゲーム用GPU。 CUDA アクセラレーションは TensorFlow などの機械学習ライブラリでサポートされており、トレーニングとトレーニングを大幅に高速化します。 推論。 CUDA はその原動力です AMDはAIにおいて大きく遅れをとっている エヌビディアと比較して。

ただし、CUDA を Nvidia の CUDA コアと混同しないでください。 CUDA は大量の AI アプリが実行されるプラットフォームですが、CUDA コアは Nvidia GPU 内のコアにすぎません。 これらは名前を共有しており、CUDA コアは CUDA アプリケーションを実行するためにより最適化されています。 Nvidia のゲーム GPU には CUDA コアが搭載されており、CUDA アプリをサポートしています。

Tensor コアは基本的に専用の AI コアです。 彼らは行列の乗算を処理します。これは、AI トレーニングを高速化する秘密のソースです。 ここでの考え方はシンプルです。 複数のデータセットを一度に乗算し、考えられる結果を生成することで AI モデルを飛躍的に高速にトレーニングします。 ほとんどのプロセッサはタスクを線形に処理しますが、Tensor コアは 1 クロック サイクルでシナリオを迅速に生成できます。

繰り返しになりますが、Nvidia のゲーム用 GPU は、 RTX4080 Tensor コア (場合によっては、高価なデータセンターの GPU を超えるコア) を備えています。 ただし、AI モデルを高速化するために Nvidia カードが必要とするすべての仕様において、メモリほど重要なものはありません。 また、Nvidia のゲーム用 GPU にはそれほど多くのメモリが搭載されていません。

すべては記憶に帰着する

人工知能に関する数冊の本の著者であり、セントルイスのワシントン大学教授であるジェフリー・ヒートン氏は、「メモリのサイズが最も重要です」と述べています。 「GPUが足りない場合は、

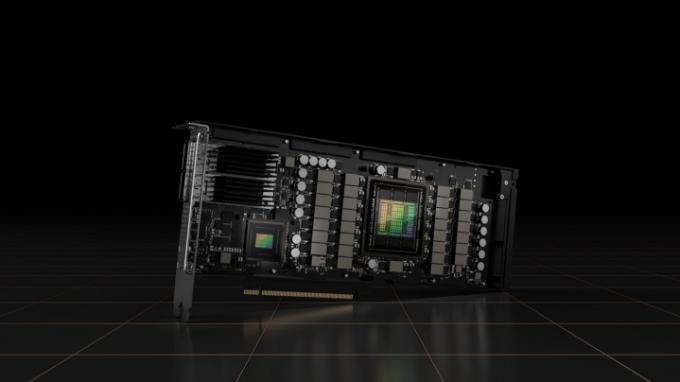

ヒートンって誰よ YouTube チャンネルがあります AI モデルが特定の GPU 上でどの程度適切に実行されるかに重点を置いた同氏は、CUDA コアも同様に重要ですが、GPU が AI に対してどのように機能するかについては、メモリ容量が支配的な要素であると指摘しました。 の RTX4090 ゲーム標準では 24GB の GDDR6X という大量のメモリを搭載していますが、データセンタークラスの GPU と比べると非常に少ないです。 たとえば、Nvidia の最新の H100 GPU には、80 GB の HBM3 メモリと、大規模な 5,120 ビット メモリ バスが搭載されています。

少なくても済みますが、それでも大量のメモリが必要です。 Heaton 氏は、初心者には 12GB 以上を推奨しますが、一般的な機械学習エンジニアには 48GB のプロフェッショナルを 1 つまたは 2 つ所有することになります。 Nvidia GPU。 Heaton 氏によると、「ほとんどのワークロードは、1 つの A100 から 8 つの A100 の範囲に収まるでしょう。」 Nvidia の A100 GPU には 40GB の メモリ。

このスケーリングの動作も確認できます。 ピュージェット システム 40 GB のメモリを搭載した 1 台の A100 が、24 GB のメモリを搭載した 1 台の RTX 3090 の約 2 倍の速度で動作することを示しています。 それは、RTX 3090 がほぼ 2 倍の CUDA コアとほぼ同数の Tensor コアを搭載しているという事実にもかかわらずです。

ボトルネックとなるのはメモリであり、生の処理能力ではありません。 これは、AI モデルのトレーニングは大規模なデータセットに依存しており、メモリに保存できるデータが多ければ多いほど、モデルをより速く (そしてより正確に) トレーニングできるためです。

異なるニーズ、異なる金型

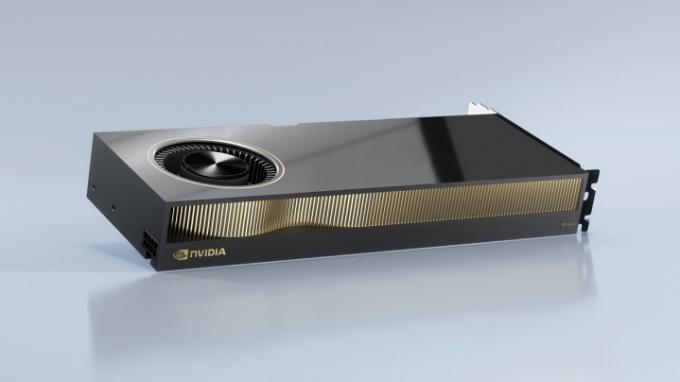

Nvidia のゲーム GPU は、エンタープライズ グレードのハードウェアと比較してビデオ メモリが少ないため、一般に AI には適していませんが、ここにも別の問題があります。 Nvidia のワークステーション GPU は通常、GPU ダイをゲーム カードと共有しません。

たとえば、Heaton が参照した A100 は GA100 GPU を使用していますが、これは Nvidia の Ampere シリーズのダイであり、ゲームに特化したカード (ハイエンド カードを含む) では決して使用されませんでした。 RTX3090Ti). 同様に、Nvidia の最新の H100 は、RTX 40 シリーズとは完全に異なるアーキテクチャを使用しています。つまり、異なるダイも使用しています。

例外もあります。 Nvidia の AD102 GPU は、 RTX4090 および RTX 4080 は、小規模な Ada Lovelace エンタープライズ GPU (L40 および RTX 6000) でも使用されています。 ただし、ほとんどの場合、Nvidia はゲーム用 GPU ダイをそのままデータセンター カードに再利用することはできません。 それらは別の世界です。

仮想通貨マイニングによる GPU 不足と AI モデルの人気の高まりの間には、根本的な違いがいくつかあります。 Heaton 氏によると、GPT-3 モデルのトレーニングには 1,000 個を超える A100 Nvidia GPU が必要で、実行には約 8 個が必要でした。 これらの GPU は高帯域幅の NVLink インターコネクトにもアクセスできますが、Nvidia の RTX 40 シリーズ GPU はアクセスできません。 Nvidia のゲーム カードの最大 24 GB のメモリと、NVLink を備えた A100 などの GPU の数百 GB のメモリを比較しています。

他にもいくつかの懸念があります。たとえば、メモリ ダイがゲーム用 GPU ではなくプロ用 GPU に割り当てられているなどです。 しかし、GPU の在庫を見つけるために、地元の Micro Center や Best Buy に駆け込む日々は終わります。 消えた。 Heaton 氏は、この点をうまくまとめました。「ChatGPT などの大規模な言語モデルの実行には、少なくとも 8 つの GPU が必要であると推定されています。 このような見積もりは、ハイエンドの A100 GPU を前提としています。 私の推測では、これによりハイエンドの GPU が不足する可能性がありますが、ゲーマークラスの GPU には影響しないかもしれません。

編集者のおすすめ

- トップクラスの著者がAI企業に作品の使用料を要求

- Google Bard は話せるようになりましたが、ChatGPT をかき消すことができるでしょうか?

- ChatGPT Webサイトのトラフィックが初めて減少

- 81% が ChatGPT はセキュリティ リスクであると考えていることが調査で判明

- Apple の ChatGPT ライバルが自動的にコードを作成する可能性がある

ライフスタイルをアップグレードするDigital Trends は、読者が最新ニュース、楽しい製品レビュー、洞察力に富んだ社説、ユニークなスニーク ピークをすべて提供して、ペースの速いテクノロジーの世界を監視するのに役立ちます。