Modificando leggermente il titolo di un noto programma televisivo: I bambini fanno le cose più brutte. Recentemente, ricercatori tedeschi e britannici hanno condotto uno studio, pubblicato sulla rivista Robotica scientifica, che ha dimostrato la misura in cui i bambini sono suscettibili alla pressione dei coetanei robot. Versione TLDR: la risposta a quella vecchia domanda dei genitori: "Se tutti i tuoi amici ti dicessero di saltare da un dirupo, tu lo faresti?" potrebbe anche essere “Certo. Se tutti i miei amici fossero robot.”

Contenuti

- Gli adulti sono davvero molto più intelligenti?

- Per ogni nave c’è un naufragio

Il test ha rievocato un famoso esperimento del 1951 sperimentato dallo psicologo polacco Solomon Asch. L’esperimento ha dimostrato come le persone possano essere influenzate dalle pressioni del pensiero di gruppo, anche quando questo va contro le informazioni che sanno essere corrette. Negli esperimenti di Asch, un gruppo di studenti universitari veniva riunito e venivano mostrate due carte. La carta a sinistra mostrava l'immagine di una singola linea verticale. La carta a destra mostrava tre righe di varia lunghezza. Lo sperimentatore ha quindi chiesto ai partecipanti quale linea sulla carta destra corrispondeva alla lunghezza della linea mostrata sulla carta sinistra.

Video consigliati

"La particolarità di ragazzi di questa fascia d'età è che sono ancora in un'età in cui sospendono l'incredulità."

Fin qui tutto semplice. Il punto in cui le cose si sono fatte più subdole, tuttavia, è stata la composizione del gruppo. Solo una persona del gruppo era un vero partecipante, mentre gli altri erano tutti attori, a cui era stato detto in anticipo cosa dire. L'esperimento consisteva nel verificare se il vero partecipante sarebbe stato d'accordo con il resto del gruppo quando all'unanimità avessero dato la risposta sbagliata. A quanto pare, la maggior parte lo farebbe. La pressione dei pari significa che la maggioranza delle persone negherà informazioni chiaramente corrette se ciò significa conformarsi all’opinione della maggioranza.

Imparentato

- I robot in evoluzione e autoreplicanti sono qui, ma non preoccuparti di una rivolta

- I robot non verranno a rubarti il lavoro. Stanno venendo per migliorarlo

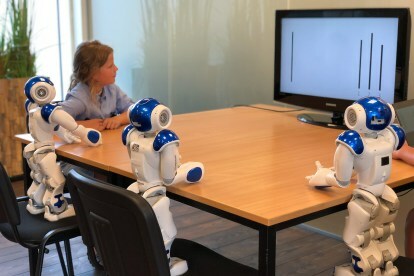

Nel remix dell’esperimento del 2018, è stato utilizzato lo stesso principio: solo che invece di un gruppo di coetanei in età universitaria, il “vero partecipante” era un bambino, di età compresa tra i sette e i nove anni. Gli “attori” erano interpretati da tre robot, programmati per dare la risposta sbagliata. In un campione di 43 volontari, il 74% dei bambini ha dato la stessa risposta errata dei robot. I risultati suggeriscono che la maggior parte dei bambini di questa età tratterà la pressione dei robot allo stesso modo della pressione dei loro coetanei in carne ed ossa.

"La particolarità di ragazzi di questa fascia d'età è che sono ancora in un'età in cui sospendono l'incredulità", Tony Belpaeme, professore di Sistemi di controllo intelligenti e autonomi, che ha contribuito alla realizzazione dello studio, ha dichiarato a Digital Trends. “Giocheranno con i giocattoli e crederanno ancora che le loro action figure o bambole siano reali; guarderanno ancora uno spettacolo di marionette e crederanno davvero a quello che sta succedendo; potrebbero ancora credere in [Babbo Natale]. È la stessa cosa quando guardano un robot: non vedono l’elettronica e la plastica, ma piuttosto un carattere sociale”.

È interessante notare che l’esperimento ha messo a confronto questo con la risposta degli adulti. A differenza dei bambini, gli adulti non si sono lasciati influenzare dagli errori dei robot. "Quando un adulto ha visto il robot dare la risposta sbagliata, gli ha rivolto uno sguardo perplesso e poi ha dato la risposta corretta", ha continuato Belpaeme.

Quindi niente di cui preoccuparsi allora? Finché impediamo ai bambini di mettere le mani su robot programmati per dare risposte sbagliate, tutto dovrebbe andare bene, giusto? Non essere così veloce.

Gli adulti sono davvero molto più intelligenti?

Come ha riconosciuto Belpaeme, questo compito era stato concepito per essere così semplice che non vi era alcuna incertezza su quale potesse essere la risposta. Il mondo reale è diverso. Quando pensiamo ai tipi di lavori facilmente affidati alle macchine, spesso si tratta di compiti che, come esseri umani, non siamo sempre in grado di eseguire perfettamente.

Questo compito è stato progettato per essere così semplice che non vi era alcuna incertezza su quale potesse essere la risposta.

Potrebbe darsi che il compito sia incredibilmente semplice, ma che la macchina possa eseguirlo molto più velocemente di noi. Oppure potrebbe trattarsi di un compito più complesso, in cui il computer ha accesso a quantità di dati molto maggiori di noi. A seconda del potenziale impatto del lavoro da svolgere, non sorprende che molti di noi non sarebbero contenti di correggere una macchina.

Un'infermiera in un ospedale sarebbe felice di annullare il Algoritmo approvato dalla FDA che possono aiutare a stabilire le priorità sulla salute del paziente monitorando i segni vitali e quindi inviando avvisi al personale medico? Oppure un conducente si sentirebbe a suo agio al volante di un’auto senza conducente quando si trova ad affrontare uno scenario stradale particolarmente complesso? O anche un pilota che esclude il pilota automatico perché pensa che sia stata presa la decisione sbagliata? In tutti questi casi, vorremmo pensare che la risposta sia “sì”. Per tutta una serie di ragioni, però, questa potrebbe non essere la realtà.

Nicholas Carr scrive di questo nel suo libro del 2014 La gabbia di vetro: dove ci sta portando l’automazione. Il modo in cui lo descrive sottolinea il tipo di ambiguità che comportano i casi di automazione nella vita reale, dove si trovano i problemi molto più complesse della lunghezza di una linea su una carta, le macchine sono molto più intelligenti e il risultato è potenzialmente migliore cruciale.

“Come si misura il costo di un’erosione dello sforzo e dell’impegno, o di un declino dell’azione e dell’autonomia, o di un sottile deterioramento delle competenze? Non puoi”, scrive. “Questi sono i tipi di cose oscure e intangibili che raramente apprezziamo finché non se ne sono andate, e anche allora potremmo avere difficoltà a esprimere le perdite in termini concreti”.

"Questi sono il tipo di cose oscure e intangibili che raramente apprezziamo finché non se ne sono andate."

I robot sociali del tipo teorizzato da Belpaeme nel documento di ricerca non sono ancora diventati mainstream, ma ci sono già esempi di alcuni di questi enigmi in azione. Ad esempio, Carr apre il suo libro menzionando un promemoria della Federal Aviation Administration in cui si sottolinea come i piloti dovrebbero trascorrere meno tempo volando con il pilota automatico a causa dei rischi che ciò comporta. Ciò si basava sull'analisi dei dati sugli incidenti, dimostrando che i piloti spesso fanno troppo affidamento sui sistemi computerizzati.

Un caso simile riguardava una causa del 2009 in cui una donna di nome Lauren Rosenberg ha intentato una causa contro Google dopo che gli è stato consigliato di camminare lungo un percorso che immetteva in traffico pericoloso. Anche se il caso è stato respinto dal tribunale, ciò dimostra che le persone ignoreranno il proprio buon senso nella convinzione che l’intelligenza artificiale sia più intelligente della nostra.

Per ogni nave c’è un naufragio

In definitiva, come riconosce Belpaeme, il problema è che a volte vogliamo affidare il processo decisionale alle macchine. Robot prometti di fare i lavori noiosi, sporchi e pericolosi – e se dobbiamo riconsiderare ogni decisione, non sono proprio i dispositivi salva-lavoro che sono stati promessi. Se un giorno inviteremo i robot a casa nostra, vorremo che siano in grado di agire in modo autonomo e ciò implicherà un certo livello di fiducia.

“I robot che esercitano una pressione sociale su di te possono essere una buona cosa; non deve essere sinistro”, ha continuato Belpaeme. “Se disponi di robot utilizzati nel settore sanitario o educativo, vuoi che siano in grado di influenzarti. Ad esempio, se desideri perdere peso, potresti ricevere un robot dimagrante per due mesi monitor il tuo apporto calorico e ti incoraggia a fare più esercizio fisico. Vuoi che un robot del genere sia persuasivo e ti influenzi. Ma qualsiasi tecnologia che possa essere usata per il bene può essere usata anche per il male”.

Qual è la risposta a questa domanda? Domande come questa verranno discusse caso per caso. Se alla fine il male prevale sul bene, la tecnologia come i robot sociali non decollerà mai. Ma è importante trarre le giuste lezioni da studi come quello sulla pressione dei pari indotta dai robot. E non è il fatto che siamo molto più intelligenti dei bambini.

Raccomandazioni degli editori

- Il futuro dell’automazione: i robot stanno arrivando, ma non ti prenderanno il lavoro

- Questi robot colpiscono a morte le erbacce in modo che gli agricoltori non abbiano bisogno di erbicidi chimici