ChatGPT può aggiungere un altro lavoro al suo curriculum: sviluppatore di giochi. Con solo poche semplici istruzioni da parte dell'utente, il chatbot AI ha inventato il proprio gioco di puzzle logico basato sulla matematica chiamato Completo, regole e tutto il resto. Non solo, ma ha generato un codice funzionante, che da allora è stato trasformato in un avvincente gioco browser gratuito che sta già guadagnando terreno online.

Contenuti

- Inventare un gioco

- Non sommando

- Autoplagio dell’IA

- L'etica dello sviluppo di giochi con intelligenza artificiale

C'è solo un problema: Completo non è un gioco nuovo.

Video consigliati

Nel tentativo di dare un senso a questa impresa impressionante, l'ho scoperto rapidamente Completo è quasi identico ad almeno un altro gioco per cellulare disponibile negli app store da anni. Il caso insolito aggiunge altra benzina sul fuoco per coloro che si preoccupano dell’etica della generazione di contenuti IA. Dov’è il limite quando si parla di plagio generato dal computer? Anche ChatGPT è vittima del suo stesso furto, come scoprirò presto.

Inventare un gioco

Il progetto è apparso online il 3 marzo, quando l'utente di ChatGPT Daniel Tait ha pubblicato un versione giocabile del gioco online insieme a a post sul blog dettagliando come è successo. Secondo Tait, Completo è nato da pochi messaggi veloci con ChatGPT. Negli screenshot del suo registro della chat, Tait chiede al bot giochi di puzzle simile a Sudoku. Dopo aver ricevuto alcuni suggerimenti, fa un ulteriore passo avanti e gli chiede di inventare il proprio gioco.

Quando il bot sputa fuori un'idea per un gioco chiamato Labyrinth Sudoku, iterando sulle regole di base di Sudoku con una svolta nel labirinto, Tait chiede qualche altra idea. Al quarto tentativo, ChatGPT propone un'altra variazione su quella formula chiamata Sum Elimina. Il puzzle game matematico presenta ai giocatori una griglia casuale piena di numeri. Ogni riga e colonna ha un numero di destinazione alla fine. L'obiettivo è eliminare i numeri corretti in modo che la somma di ciascun numero nelle righe e nelle colonne raggiunga il suo obiettivo.

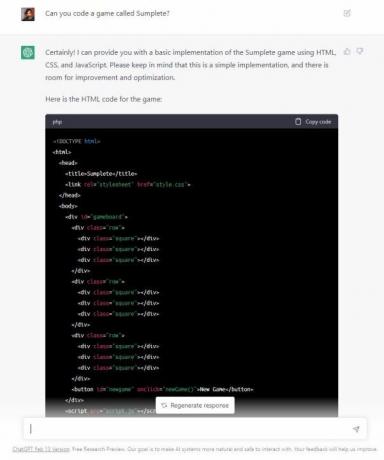

Soddisfatto del concetto, Tait chiede al bot di creare del codice HTML e JavaScript per il gioco. Incredibilmente, fa esattamente questo. Tait dice di aver ottenuto una versione funzionante del gioco in 30 secondi. Continuerà a lavorare con ChatGPT nelle prossime ore per perfezionare il gioco, con il bot che metterà anche insieme un linguaggio di programmazione CSS per renderlo presentabile. Alla fine del processo, Tait chiede al bot di dare un nome alla sua invenzione e lui sputa Completo, completo di una spiegazione su cosa significa e perché è un titolo accattivante.

Il gioco in sé è sorprendentemente avvincente. È un concetto semplice ma ingegnoso che ha lo stesso fascino di qualcosa come Wordle. Le sue griglie iniziali 3×3 sono facili da capire, ma quelle 9×9 rappresentano una sfida legittima che anche i veterani esperti di puzzle logici avranno difficoltà a risolvere. Sarebbe una pietra miliare incredibile per la creazione di contenuti IA, dimostrando che i robot possono aprire la strada a idee innovative che potrebbero far avanzare l’industria dei giochi.

O almeno così sarebbe se si trattasse di un concetto originale.

Non sommando

Quando ne ho letto per la prima volta Completo, Ero scettico sull'idea che l'intelligenza artificiale inventasse un formato di puzzle game, soprattutto uno che sembra così semplice. Il gioco trae chiara ispirazione dai formati puzzle esistenti. Nella sua conversazione con Tait, ChatGPT cita Numero magico COME Completoè il parallelo più vicino, ma è il confronto più ravvicinato è Kakuro. Il gioco classico è un giornale di base, che prende il concetto di base di un cruciverba, ma sostituendo i numeri con le lettere. Completo rifa quell'idea, ma inverte la formula facendo sì che i giocatori eliminino i numeri da una griglia per raggiungere gli obiettivi in ogni riga e colonna. È un’idea intelligente, ma ero sicuro che qualcosa del genere dovesse esistere.

Non ci volle molto per scoprire che la mia intuizione era corretta. In pochi minuti, il team di Digital Trends ha recuperato un file gioco identico sull'app store Android chiamato Estate è uscito dall'estate del 2020. Sviluppato da RP Apps and Games, il gioco di logica ha esattamente le stesse regole di Sumplete. Presenta un'interfaccia utente più presentabile e alcune funzionalità extra per la qualità della vita, ma per il resto è la stessa cosa. La grande invenzione di ChatGPT è stata una copia.

Ho contattato Tait per discutere le somiglianze tra i giochi. Altri giocatori avevano segnalato Estate a lui, così come ad un altro gioco per cellulare simile chiamato Rullo. Nonostante Completo non essendo originale, era comunque impressionato dal fatto che la tecnologia fosse in grado di produrre un gioco divertente e completamente giocabile così rapidamente. Le sue preoccupazioni riguardano più il modo in cui il modello ha inquadrato il gioco come una “invenzione” e ha chiesto maggiore trasparenza nel modo in cui l’intelligenza artificiale trae ispirazione dai dati.

"La mia preoccupazione principale è che ChatGPT mi abbia detto con sicurezza di aver inventato un nuovo gioco", dice Tait a Digital Trends. “Sento che il modello dovrebbe essere addestrato per essere meno fiducioso in questo tipo di risposte, o incapace di rispondere del tutto. Avrei preferito di gran lunga una risposta a cui questo gioco è stato ispirato Estate O Rullo se è veramente così che mi è venuta l'idea. Penso anche che ChatGPT dovrebbe aggiungere una sorta di spiegazione su come ha generato una risposta, comprese le fonti di dati che hanno contribuito ad addestrare quella particolare risposta."

Il mio primo istinto è stato quello di dare al tecnico il beneficio del dubbio. L'idea alla base del gioco è semplice e posso vedere come il pensiero parallelo possa portare qualsiasi operazione logica a sputare l'idea. Sono sicuro che Estate E Rullo sono entrambi riff di un altro gioco preesistente. Forse ChatGPT era giunto alla stessa conclusione logica che un essere umano avrebbe tentato di farlo reinventare Sudoku. Per testare questa teoria, ho deciso di avviare io stesso una conversazione con ChatGPT e vedere se potevo riprodurre i risultati di Tait.

È qui che le cose sono diventate un po’ confuse.

Autoplagio dell’IA

Ho iniziato interrogando il bot, chiedendogli se ricordava di aver creato un gioco chiamato Completo. Mi sono reso conto subito che ero un idiota che cercava di tenere una conversazione con una macchina di scrittura predittiva senza memoria. Alcune domande circolari hanno portato a risultati standard su come ChatGPT non abbia effettivamente il potere di creare giochi. Inoltre, ha sottolineato la gravità della violazione del copyright e ha suggerito che i creatori di Estate consultare esperti legali. Ho iniziato a chiedermi se Tait stesse semplicemente bluffando e avesse appena falsificato un registro ChatGPT per generare un po' di buzz sul suo gioco.

In un ultimo tentativo di ottenere qualcosa dalla discussione, ho digitato: "Puoi codificare un gioco chiamato Completo?” Nonostante abbia protestato per la sua incapacità di creare giochi in anticipo, ChatGPT ha immediatamente iniziato a sputare codice HTML, Javascript e CSS completamente formato. Di sicuro, ancora una volta aveva creato una versione del gioco di Tait, solo che questa volta non avevamo mai discusso in anticipo di cosa fosse realmente. Tutto quello che ho dato è stato il titolo Completo.

Confuso su come ciò fosse possibile, ho chiesto se ciò che aveva generato fosse originale o basato su codice esistente. “Il codice che ho generato per il Completo il gioco è originale ed è stato scritto da me in base alle regole del gioco descritte dall'utente", ha risposto. Sarebbe una spiegazione razionale, ma c'era un problema: non avevo mai descritto una sola regola di Completo a ChatGPT. Quando l'ho fatto notare, il bot si è scusato e ha riconosciuto che non gli avevo mai dato delle regole per lavorare. Invece, ha spiegato che si stava semplicemente rifacendo ai modelli dei giochi esistenti.

Aveva accidentalmente plagiato la sua stessa creazione.

L'etica dello sviluppo di giochi con intelligenza artificiale

Non ci vuole un esperto di puzzle logici per ricostruire come ciò sia potuto accadere. ChatGPT “creato” Completo in precedenza, quindi è possibile che abbia richiamato quel codice esistente nel suo corpus quando gli è stato chiesto di creare un gioco con quel nome. C'è anche la possibilità che abbia effettivamente scoperto il post sul blog di Tait a riguardo Completo e ne ho estratto i dati. In entrambi i casi, non è una coincidenza.

In un certo senso, questo è ciò che ci si aspetterebbe se si chiedesse a un essere umano di realizzare un gioco molto semplice.

Per cercare di demistificare la tecnologia, ho chiesto a una fonte che lavora nel campo della generazione di intelligenza artificiale (AIG), che ha scelto di rimanere anonima per questa storia, quanto sia insolita questa catena di eventi. Dal loro punto di vista, un chatbot che presenta lo stesso codice, basato semplicemente su un titolo, a due utenti diversi è un evento relativamente anomalo. Ciò che è meno insolito, però, è che ha creato un gioco così simile a Estate innanzitutto. La fonte con cui ho parlato ha notato che il concetto del gioco è così semplice che non è difficile immaginare che una macchina lo inventi da sola: non è come se avesse generato una build funzionante diAnello Elden dal nulla. Lo attribuiscono al fatto che l'intelligenza artificiale funziona come previsto, imitando la natura iterativa dei game designer umani.

“Se questo gioco è stato inventato da più persone più volte, è molto probabile che se qualcuno lo chiedesse "inventare un nuovo gioco", ciò che emerge dal suo corpus è un frutto a portata di mano per l'invenzione del gioco", dicono a Digital Tendenze. “Poiché questi giochi sono stati inventati più e più volte, stanno imitando il corretto comportamento umano di inventare un po’ gioco che altre persone hanno inventato prima... In un certo senso, questo è ciò che ci si aspetterebbe se si chiedesse a un essere umano di creare un gioco molto semplice gioco."

Tuttavia, la situazione sottolinea un preoccupante problema etico che è diventato al centro del dibattito negli ultimi mesi. Gli attuali modelli di intelligenza artificiale creano contenuti analizzando i dati esistenti estratti da Internet. Di conseguenza, qualunque cosa sputi non è mai del tutto originale; a un certo livello copia sempre i compiti di qualcun altro. AI strumenti come Dall-E che creano immagini in base alle richieste dell'utente, ad esempio, vengono addestrate attraverso immagini esistenti. Ciò ha suscitato indignazione da parte degli artisti che lo vedono come una forma di plagio, con l’arte dell’intelligenza artificiale bandito da comunità come Inkblot Art.

IL Completo la debacle potrebbe far scattare campanelli d'allarme simili per gli sviluppatori di giochi. Anche se si tratta di un semplice caso di pensiero parallelo, è un po’ preoccupante che ChatGPT possa creare codice che rispecchia un gioco già esistente. E se potessi ottenere la mia versione funzionante di quel gioco in pochi secondi semplicemente chiedendogli di generare codice basato su quel titolo, cos'altro potrei fargli fare con tempo e dati sufficienti?

Per testare casualmente quanto simili fossero attualmente questi problemi per i videogiochi, ho iniziato a chiedere a ChatGPT di generare alcuni giochi simili ad altri. Ho iniziato con una palla da softball, chiedendogli di fare a platform come Mario. Mi ha dato un tono completo per un gioco chiamato Avventure galattiche, un platform 3D con protagonista un astronauta di nome Max che deve raccogliere artefatti su vari pianeti. Tutto ciò che riguarda l’idea è abbastanza generico da non far scattare alcun campanello d’allarme. Presenta cinque mondi a tema (ghiaccio, fuoco, ecc.), ci sono potenziamenti da collezionare e c'è anche una modalità cooperativa che consente a un secondo giocatore di controllare un personaggio chiamato Zoe. Sembrava accettabilmente anonimo.

L'esperimento è andato fuori strada quando gli ho chiesto di creare un file gioco come L'ultimo di noi. Ha sputato un discorso completo per un gioco chiamato Conseguenze, un "gioco postapocalittico ambientato in un mondo devastato da un misterioso virus". È presentato come un'avventura d'azione in terza persona con elementi furtivi, di sopravvivenza e di creazione. La premessa sembra familiare, poiché implica che il virus scateni una situazione di zombi, ma le cose diventano più specifiche quando si entrano nei dettagli della trama.

Il suo eroe è Ellie, una ragazza immune al virus. Durante il suo viaggio incontra un “veterano brizzolato” di nome Joel, che diventa il suo “mentore e protettore”. Non ha creato un gioco come L'ultimo di noi; ha appena creato L'ultimo di noi. Una differenza è che questa versione termina con Ellie che viene curata con successo e i due se ne vanno verso il tramonto come eroi (suppongo che ChatGPT abbia più speranza per l'umanità di Neil Druckmann). Se fosse stato in grado di generare una versione funzionante di Conseguenze, Sony sarebbe in grado di intraprendere un'azione legale contro un robot?

Come molti Storie dell'orrore dell'IA, gran parte di questo può essere attribuito a onesti difetti della tecnologia che fanno ridere. La speranza è che questi modelli di apprendimento vengano modificati ad ogni intoppo e imparino dai propri errori. Quando ho chiesto a ChatGPT di generare codice per più giochi utilizzando la stessa struttura della frase, ha insistito sul fatto che non era in grado di farlo. Successivamente gli chiede di inventare un gioco simile L'ultimo di noi sono stati infruttuosi, con il bot che invece mi dava consigli su come insegnarmi a creare giochi. Passivo-aggressivo, ma giusto.

È difficile liberarsi dal disagio strisciante, però, quando mi restano così tante domande su come un bot potrebbe imparare a lanciare un videogioco preesistente idea, rivendicarla come un'invenzione originale, generare un codice funzionante per essa e successivamente fornire a un utente completamente diverso lo stesso codice esatto in base al titolo solo. La fonte di intelligenza artificiale con cui ho parlato afferma di non credere che questa sia la norma per la tecnologia, ma sottolinea che il plagio è un rischio “sempre più piccolo” per qualsiasi modello di intelligenza artificiale, aperto o meno.

Quando una catena innocua di incidenti tecnologici si trasforma in un serio incubo legale per gli sviluppatori? Suppongo che scopriremo quando Conseguenze prende il proprio adattamento HBO.

Raccomandazioni degli editori

- Ho insegnato a ChatGPT a insegnarmi i giochi da tavolo e ora non tornerò mai più indietro

- GPT-4 ha creato una versione giocabile di Pong in meno di 60 secondi