La forza di Google nelle fotocamere degli smartphone è sempre stata la sua A.I. e sistemi di fotografia computazionale. La foto che il tuo telefono ti mostra dopo aver premuto il pulsante di scatto non è una copia esatta di ciò che vedi: è una combinazione di dozzine di fotogrammi fusi insieme, elaborati da algoritmi avanzati. Ciò crea un problema: Google ha scoperto che i suoi algoritmi fotografici non fanno un ottimo lavoro nel rappresentare correttamente tutte le tonalità della pelle e le caratteristiche fisiche.

Video consigliati

In un annuncio a I/O di Google 2021, la società ha detto che sto lavorando per cambiare la situazione. Il suo obiettivo è “creare”. smartphone la fotografia davvero per tutti […] per costruire una fotocamera più precisa e inclusiva.”

Google ha lanciato una nuova iniziativa nella sua divisione fotografica per garantire che i suoi algoritmi di elaborazione fotografica rappresentare in modo accurato e appropriato le persone di colore: dalle tonalità della pelle, alle caratteristiche del corpo e del viso, ai tipi di capelli, e oltre. Tutto è iniziato riunendo un gruppo di esperti di fotografia per raccogliere informazioni su come ha portato la fotografia computazionale lacune nel rappresentare adeguatamente alcuni gruppi e ha iniziato a lavorare per garantire che il software nelle sue fotocamere possa contrastare Quello.

Imparentato

- Hai un vecchio Google Pixel? Questo test della fotocamera ti farà venire voglia di un Pixel 7a

- Colori di Google Pixel 7a: ecco tutte le opzioni che puoi ottenere

- Google Pixel 7a ha la ricarica wireless?

“Il lavoro spetta a noi. Non spetta alle persone cambiare il loro aspetto; sta a noi cambiare il modo in cui funzionano gli strumenti”, ha affermato Google.

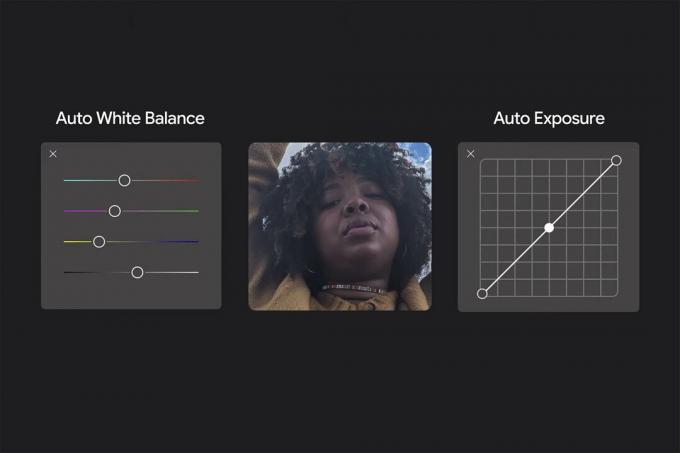

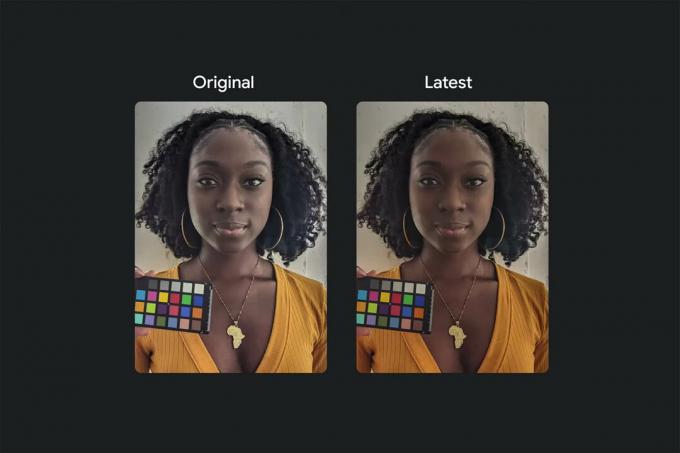

Alcuni cambiamenti sono un po’ più semplici di altri. Modificando il modo in cui gli algoritmi di bilanciamento automatico del bianco e di esposizione automatica elaborano le immagini, Google l'app della fotocamera può rappresentare in modo più accurato il tono della pelle di qualcuno indipendentemente dalla scena circostante.

E invece di dare semplicemente per scontato che "un'immagine più luminosa è migliore", come spesso accade, può prendere in considerazione il fatto che esiste un motivo perché alcune parti di una scena hanno quel colore o tono. Google è stato in prima linea nel combinare più fotogrammi in foto composite, e questa è un’altra area in cui questo tipo di esperienza può essere applicato a una nuova filosofia.

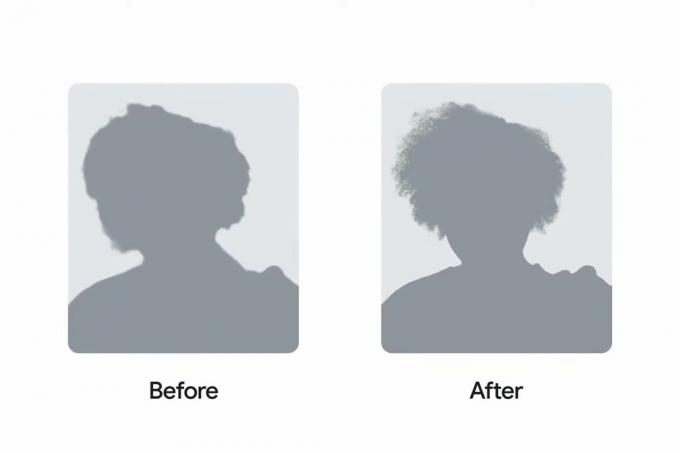

Questo va oltre il colore e la luminosità, ovviamente. Google si sta concentrando anche sui suoi algoritmi per l’elaborazione di diversi tipi di capelli: per foto, selfie e scatti in modalità ritratto. Abbiamo tutti avuto a che fare con i finti ritratti che tagliavano occhiali, orecchie o ciocche di capelli, ma Google ha scoperto che questo ha influenzato in modo sproporzionato i tipi di capelli più ricci. Le nuove modifiche all’algoritmo aiutano a rappresentare correttamente i capelli in modo naturale, invece di lisciarli artificialmente e rimuovere la definizione dai ricci, ad esempio.

Alla fine tutto si riduce alla precisione. Dove vari telefoni rientrano nello spettro di presa accurato foto o piacevole le foto sono una costante fonte di dibattito; ma sfortunatamente non è stata data abbastanza attenzione alla rappresentazione dei soggetti, indipendentemente dal tono della pelle o dalle caratteristiche fisiche. Mentre possiamo e dobbiamo discutere sulla natura soggettiva del bianco corretto nella foto di un parco o di una scena notturna equilibrio o grana innaturale nelle luci basse, non dovrebbe esserci alcun dibattito sul fatto che gli algoritmi della fotocamera dovrebbero farlo rappresentare persone nel modo più accurato possibile, senza pregiudizi.

Google afferma che tutti questi cambiamenti, e altro ancora, arriveranno sui telefoni Pixel in autunno, presumibilmente in coincidenza con il lancio del Pixel 6. Ma non finisce qui; Google condividerà "tutto" ciò che apprende con l'intero Androide ecosistema di partner, nella speranza che altre aziende aderiscano a questa iniziativa.

Raccomandazioni degli editori

- Google Pixel 8: tutte le ultime indiscrezioni e cosa vogliamo vedere

- Sono entusiasta di Google Pixel Fold e dovresti esserlo anche tu

- Google Pixel 7a ha un jack per le cuffie?

- Il Google Pixel Tablet è qui ed è un'enorme delusione

- Non acquistare Google Pixel Fold (ancora)

Migliora il tuo stile di vitaDigital Trends aiuta i lettori a tenere d'occhio il frenetico mondo della tecnologia con tutte le ultime notizie, divertenti recensioni di prodotti, editoriali approfonditi e anteprime uniche nel loro genere.