ChatGPT est devenu viral au cours des six derniers mois, mais cela n’est pas sorti de nulle part. Selon un article de blog publié par Microsoft Lundi, OpenAI, la société derrière ChatGPT, a contacté Microsoft pour construire une infrastructure d'IA sur des milliers de GPU Nvidia il y a plus de cinq ans.

Le partenariat entre OpenAI et Microsoft a récemment retenu l'attention, en particulier après que Microsoft a investi 10 milliards de dollars dans le groupe de recherche à l'origine d'outils tels que ChatGPT et DALL-E2. Cependant, le partenariat a commencé il y a longtemps, selon Microsoft. Depuis lors, Rapports Bloomberg que Microsoft a dépensé « plusieurs centaines de millions de dollars » pour développer l'infrastructure nécessaire à la prise en charge de ChatGPT et de projets tels que Chat Bing.

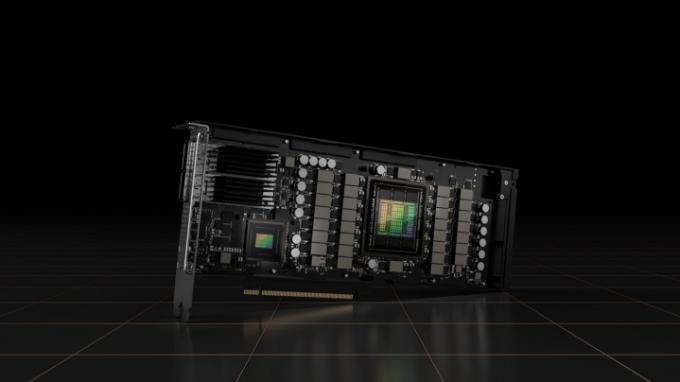

Une grande partie de cet argent est allée à Nvidia, qui est désormais à la pointe du matériel informatique nécessaire à la formation des modèles d'IA. Au lieu de GPU de jeu comme vous le trouverez sur une liste des

meilleures cartes graphiques, Microsoft s’est attaqué aux GPU d’entreprise de Nvidia comme l’A100 et le H100.En rapport

- ChatGPT: les dernières actualités, controverses et astuces à connaître

- Qu'est-ce qu'une invite DAN pour ChatGPT?

- Google Bard peut désormais parler, mais peut-il étouffer ChatGPT?

Ce n'est pas aussi simple que d'obtenir cartes graphiques ensemble et former un modèle de langage, cependant. Comme l’explique Nidhi Chappell, responsable produit Microsoft pour Azure: « Il ne s’agit pas d’acheter tout un tas de GPU, de les connecter ensemble et ils commenceront à fonctionner ensemble. Il y a beaucoup d’optimisation au niveau du système pour obtenir les meilleures performances, et cela s’accompagne d’une grande expérience sur plusieurs générations.

Vidéos recommandées

Avec l'infrastructure en place, Microsoft ouvre désormais son matériel aux autres. La société a annoncé le Lundi dans un article de blog séparé qu'il offrirait des systèmes Nvidia H100 « à la demande dans des tailles allant de huit à des milliers de GPU Nvidia H100 », livrés via le réseau Azure de Microsoft.

La popularité de ChatGPT a fait monter en flèche Nvidia, qui investit dans l’IA via du matériel et des logiciels depuis plusieurs années. AMD, le principal concurrent de Nvidia dans le domaine des cartes graphiques de jeu, a tenté de progresser dans ce domaine avec des accélérateurs comme l'Instinct MI300.

Selon Greg Brockman, président et co-fondateur d'OpenAI, la formation de ChatGPT n'aurait pas été possible sans la puissance fournie par Microsoft: « La co-conception de superordinateurs avec Azure a été cruciale pour faire évoluer nos besoins exigeants en formation en IA, en faisant fonctionner notre recherche et notre alignement sur des systèmes comme ChatGPT. possible."

Nvidia devrait en révéler davantage sur les futurs produits d'IA lors de la GPU Technology Conference (GTC). avec la présentation principale donne le coup d'envoi le 21 mars. Microsoft élargit sa feuille de route en matière d'IA plus tard cette semaine, avec une présentation axée sur l'avenir de l'IA sur le lieu de travail prévue le 16 mars.

Recommandations des rédacteurs

- Les meilleurs auteurs exigent une rémunération des entreprises d’IA pour l’utilisation de leurs travaux

- GPT-4: comment utiliser le chatbot IA qui fait honte à ChatGPT

- Wix utilise ChatGPT pour vous aider à créer rapidement un site Web complet

- Le créateur de ChatGPT, OpenAI, fait face à une enquête de la FTC sur les lois sur la protection des consommateurs

- Le trafic du site ChatGPT a chuté pour la première fois

Améliorez votre style de vieDigital Trends aide les lecteurs à garder un œil sur le monde en évolution rapide de la technologie avec toutes les dernières nouvelles, des critiques de produits amusantes, des éditoriaux perspicaces et des aperçus uniques.