OpenAI: n GPT-2-tekstin luontialgoritmia pidettiin kerran liian vaarallisena julkaistavaksi. Sitten se julkaistiin - ja maailma jatkoi kääntymistä.

Sisällys

- Mihin se on hyvä? Ehdottomasti kaikki

- Lisää mistä se tuli

- Uskottavaa paskaa

- Takaisin kiinalaiseen huoneeseen

- Stokastisten papukaijojen ruokinta

- Kielimallit ja A.I: n tulevaisuus

Jälkikäteen tarkasteltuna suhteellisen pieni GPT-2-kielimalli (pienet 1,5 miljardia parametria) näyttää vaatimattomalta jatko-osansa, GPT-3:n, rinnalla. jossa on valtavat 175 miljardia parametria, se on koulutettu 45 TB: n tekstidataan ja maksoi (ainakin) 12 miljoonaa dollaria. rakentaa.

"Perspektiivimme ja näkemyksemme tuolloin oli lavastettu julkaisu, joka oli kuin alun perin julkaiset pienempi malli ja odotat ja katsot mitä tapahtuu”, Sandhini Agarwal, A.I. OpenAI: n politiikan tutkija kertoi Digitalille Trendit. ”Jos asiat näyttävät hyvältä, julkaiset seuraavan koon mallin. Syy, miksi valitsimme tämän lähestymistavan, johtuu siitä, että tämä on rehellisesti sanottuna [ei vain meille, vaan myös] kartoittamattomia vesiä koko maailmalle."

Liittyvät

- Hauska kaava: Miksi koneella luotu huumori on A.I: n pyhä malja?

- A.I.:n tulevaisuus: 4 suurta asiaa, joita kannattaa huomioida lähivuosina

- Tunteita tunnistava A.I. on täällä, ja se voi olla seuraavassa työhaastattelussasi

Hyppää eteenpäin nykypäivään, yhdeksän kuukauden kuluttua GPT-3:n julkaisu viime kesänä, ja se antaa voimaa yli 300 hakemusta samalla kun se tuottaa 4,5 miljardia sanaa päivässä. Se sisältää vain asiakirjan ensimmäiset virkkeet, ja se pystyy luomaan loputtomalta näyttävää tekstiä samalla tyylillä – jopa kuvitteelliset lainaukset mukaan lukien.

Tuhoaako se maailman? Menneen historian perusteella ei läheskään varmasti. Mutta se tekee joitain peliä muuttavia sovelluksia A.I. mahdollista, ja samalla esität joitakin erittäin syvällisiä kysymyksiä matkan varrella.

Mihin se on hyvä? Ehdottomasti kaikki

Hiljattain startupin perustaja Francis Jervis soitti Lisätty, käytti GPT-3:a auttamaan vuokransa kanssa kamppailevia ihmisiä kirjoittamaan kirjeitä vuokra-alennuksista. "Kuvaisin käyttötapausta tässä "tyylisiirroksi", Jervis kertoi Digital Trendsille. "[Se ottaa huomioon] luettelomerkit, joiden ei tarvitse olla edes täydellistä englannin kielellä, ja [tulostaa] kahdesta kolmeen virkettä virallisella kielellä."

Suositellut videot

Tämän erittäin tehokkaan kielimallin tukemana Jervisin työkalun avulla vuokralaiset voivat kuvata tilanteensa ja syytä, miksi he tarvitsevat alennettua ratkaisua. "Syötä vain muutama sana siitä, miksi menetit tuloja, ja saat muutamassa sekunnissa ehdotetun vakuuttavan, muodollisen kappaleen lisättäväksi kirjeeseen", yritys väittää.

Tämä on vain jäävuoren huippu. Kun Aditya Joshi, koneoppimisen tutkija ja entinen Amazon Web Services -insinööri, tapasi ensimmäisen kerran GPT-3:n. Hän oli niin hämmästynyt näkemästään, että hän perusti verkkosivuston, www.gpt3examples.com, pysyäksesi kirjassa parhaista.

"Pian sen jälkeen, kun OpenAI ilmoitti API: nsa, kehittäjät alkoivat twiitata vaikuttavia demoja sovelluksista, jotka on rakennettu GPT-3:lla", hän kertoi Digital Trendsille. "Ne olivat hämmästyttävän hyviä. Rakensin [verkkosivustoni], jotta yhteisön olisi helppo löytää nämä esimerkit ja löytää luovia tapoja käyttää GPT-3:a ongelmien ratkaisemiseen omalla toimialueellaan."

Täysin interaktiiviset synteettiset persoonat GPT-3:lla ja https://t.co/ZPdnEqR0Hn 🎇

He tietävät keitä he ovat, missä he työskentelivät, kuka heidän pomonsa on ja paljon muuta. Tämä ei ole isäsi botti… pic.twitter.com/kt4AtgYHZL

- Tyler Lastovich (@tylerlastovich) 18. elokuuta 2020

Joshi viittaa useisiin demoihin, jotka todella vaikuttivat häneen. Yksi, a layout generaattori, tekee toiminnallisen asettelun luomalla JavaScript-koodin yksinkertaisesta tekstikuvauksesta. Haluatko vesimelonin muotoisen painikkeen, jossa lukee "tilaa"? Haluaisitko banneritekstin, jossa on sateenkaaren värisiä painikkeita? Selitä ne perustekstinä, ja Sharif Shameemin asettelugeneraattori kirjoittaa koodin puolestasi. Toinen, a GPT-3-pohjainen hakukone Paras Chopran luoma, voi muuttaa minkä tahansa kirjallisen kyselyn vastaukseksi ja URL-linkiksi lisätietojen antamiseksi. Toinen, Michael Tefulan Francis Jervisin käänteiskappale, kääntää juridisia asiakirjoja tavalliseksi englanniksi. Vielä yksi, Raphaël Millière, kirjoittaa filosofisia esseitä. Ja toinen, Gwern Branwen, voi luoda luovaa fiktiota.

"En odottanut yhden kielen mallin toimivan niin hyvin niin erilaisissa tehtävissä kielen kääntämisestä ja luomisesta tekstin yhteenvetoon ja kokonaisuuden poimimiseen", Joshi sanoi. "Sisään yksi omista kokeiluistani, Käytin GPT-3:a ennustamaan kemiallisia palamisreaktioita, ja se onnistui yllättävän hyvin.

Lisää mistä se tuli

GPT-3:n transformatiiviset käyttötavat eivät myöskään lopu tähän. Tietojenkäsittelytieteilijä Tyler Lastovich on käyttänyt GPT-3:a luoda vääriä ihmisiä, mukaan lukien taustatarina, jonka kanssa voidaan sitten olla vuorovaikutuksessa tekstin kautta. Sillä välin Andrew Mayne on osoittanut, että GPT-3 voi olla käytetään muuttamaan elokuvien nimiä hymiöiksi. Nick Walton, Latituden teknologiajohtaja, GPT: n luoman tekstiseikkailupelin takana oleva studio AI Dungeon teki äskettäin saman nähdäkseen, voisiko se kääntyä pidempiä tekstijonoja emojiksi. Ja Copy.ai, startup, joka rakentaa tekstinkirjoitustyökaluja GPT-3:n avulla, hyödyntää mallia kuukausittaisella toistuva tulo 67 000 dollaria maaliskuussa – ja äskettäin 2,9 miljoonan dollarin rahoituskierros.

Koneoppiminen on ollut pelin muuttaja monella tapaa viimeisen parin vuosikymmenen aikana.

"Varmasti oli yllätys ja paljon kunnioitusta sen luovuuden suhteen, mihin ihmiset ovat käyttäneet GPT-3:a", Sandhini Agarwal, A.I. OpenAI: n politiikan tutkija kertoi Digital Trendsille. ”Niin monet käyttötapaukset ovat vain niin luovia, ja aloilla, joita en ollut edes osannut ennakoida, sillä olisi paljon tietoa. Se on mielenkiintoista nähdä. Mutta tästä huolimatta GPT-3 - ja koko tämä OpenAI: n tutkimussuunta - oli hyvin pitkälti siinä toivossa, että tämä antaisi meille A.I. malli, joka oli yleiskäyttöisempi. Yleiskäyttöisen A.I: n koko pointti. malli on [että se olisi] yksi malli, joka haluaisi tehdä kaikki nämä erilaiset A.I. tehtäviä.”

Monet projekteista korostavat yhtä GPT-3:n suurista lisäarvoista: sen vaatiman koulutuksen puute. Koneoppiminen on muuttunut monella tapaa viimeisen parin vuosikymmenen aikana. Mutta koneoppiminen vaatii suuren määrän koulutusesimerkkejä voidakseen tuottaa oikeita vastauksia. GPT-3:lla on toisaalta "muutaman laukauksen kyky", jonka avulla se voidaan opettaa tekemään jotain vain muutamalla esimerkillä.

Uskottavaa paskaa

GPT-3 on erittäin vaikuttava. Mutta se asettaa myös haasteita. Jotkut näistä liittyvät kustannuksiin: Suuren volyymin palveluissa, kuten chatboteissa, jotka voisivat hyötyä GPT-3:n taikuudesta, työkalu saattaa olla liian kallis käytettäväksi. (Yksi viesti voi maksaa 6 senttiä, mikä ei todellakaan ole pankkeja tuhoava, mutta varmasti summautuu.)

Toiset liittyvät sen laajaan saatavuuteen, mikä tarkoittaa, että on todennäköisesti vaikeaa rakentaa startup yksinomaan sen ympärille, koska kova kilpailu todennäköisesti laskee marginaaleja.

Toinen on muistin puute; sen kontekstiikkunassa on hieman alle 2000 sanaa kerrallaan, kuten Guy Piercen hahmo elokuvassa Muisto, sen muisti nollataan. "Tämä rajoittaa merkittävästi tekstin pituutta, jonka se voi luoda, karkeasti lyhyeen kappaleeseen pyyntöä kohti", Lastovich sanoi. "Käytännössä tämä tarkoittaa, että se ei pysty generoimaan pitkiä asiakirjoja, mutta silti muistaa, mitä alussa tapahtui."

Ehkä merkittävin haaste liittyy kuitenkin myös sen suurimpaan vahvuuteen: sen konfabulaatiokykyyn. Konfabulaatio on termi, jota lääkärit usein käyttävät kuvaamaan tapaa, jolla jotkut muistiongelmista kärsivät ihmiset pystyvät siihen valmistaa tietoa, joka vaikuttaa aluksi vakuuttavalta, mutta joka ei välttämättä kestä tarkastelua lähempänä tarkastus. GPT-3:n kyky konfabuloida on kontekstista riippuen vahvuus ja heikkous. Luoville projekteille se voi olla loistava, koska se antaa sen riffata teemoja välittämättä mistään niin arkipäiväisestä kuin totuus. Muissa projekteissa se voi olla hankalampaa.

Francis Jervis Augrentedista viittaa GPT-3:n kykyyn "tuottaa uskottavaa paskaa". Nick Walton AI Dungeon sanoi: "GPT-3 on erittäin hyvä kirjoittamaan luovaa tekstiä, joka näyttää siltä, että sen olisi voinut kirjoittaa ihminen… Yksi sen heikkoutena on kuitenkin se, että se voi usein kirjoittaa kuin se olisi hyvin itsevarma – vaikka sillä ei olisi aavistustakaan, mikä vastaus kysymys kuuluu."

Takaisin kiinalaiseen huoneeseen

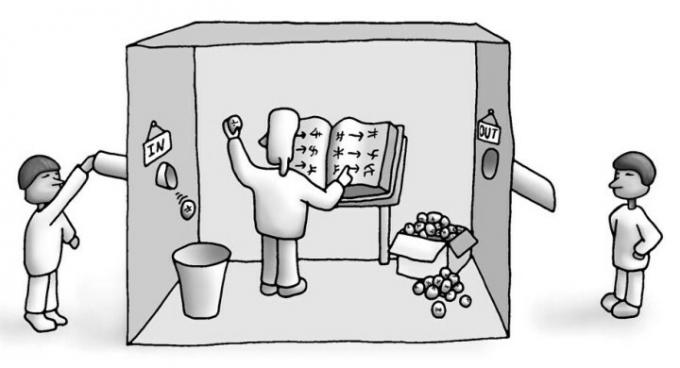

Tässä suhteessa GPT-3 palauttaa meidät tutulle John Searlen kiinalaisen huoneen alueelle. Vuonna 1980 Searle, filosofi, julkaisi yksi tunnetuimmista A.I. ajatuskokeita, keskittyi aiheeseen "ymmärtäminen". Kiinalainen huone pyytää meitä kuvittelemaan ihmisen, joka on lukittu huoneeseen, jossa on paljon kirjoitusta kielellä, jota he eivät ymmärrä. He tunnistavat vain abstrakteja symboleja. Huoneessa on myös joukko sääntöjä, jotka osoittavat, kuinka yksi symbolisarja vastaa toista. Huoneen asukkaiden on kohdattava kysymyssymbolit vastaussymboleihin, kun on annettu useita vastauksia. Toistettuaan tämän tehtävän monta kertaa, he tulevat taitaviksi suorittamaan sen - vaikka heillä ei ole aavistustakaan, mitä kumpikaan symbolijoukko tarkoittaa, vain että toinen vastaa toista.

GPT-3 on maailma kaukana kielellisestä A.I: stä. joka oli olemassa silloin, kun Searle kirjoitti. Ymmärryskysymys on kuitenkin yhtä vaikea kuin koskaan.

"Tämä on hyvin kiistanalainen kysymysalue, kuten olen varma, että tiedät, koska on niin monia erilaisia mielipiteitä siitä, olisiko kielimalleilla yleensä koskaan [todellista] ymmärrystä", sanoi OpenAI: n Sandhini Agarwal. "Jos kysyt minulta GPT-3:sta juuri nyt, se toimii erittäin hyvin joskus, mutta ei kovin hyvin toisinaan. On tämä satunnaisuus tavallaan siinä, kuinka merkitykselliseltä tulos saattaa tuntua sinusta. Joskus tulos voi olla hämmästynyt, ja joskus tulos on vain järjetöntä. Ottaen huomioon, että tällä hetkellä mielestäni… GPT-3:lla ei näytä ymmärtävän."

Tämän päivän Chinese Room -kokeeseen lisätty käänne on se, että pieni tutkijaryhmä ei ohjelmoi GPT-3:a jokaisessa vaiheessa. Se on valtava malli, joka on koulutettu valtavalle tietojoukolle, joka koostuu Internetistä. Tämä tarkoittaa, että se voi poimia päätelmiä ja harhoja, jotka voivat olla koodattuina verkosta löytyvään tekstiin. Oletko kuullut ilmaisun, että olet keskimäärin niistä viidestä ihmisestä, joilla ympäröit itsesi? No, GPT-3 koulutettiin lähes käsittämättömiin määriin tekstidataa useista lähteistä, kuten kirjoista, Wikipediasta ja muista artikkeleista. Tästä se oppii ennustamaan minkä tahansa sekvenssin seuraavan sanan tutkimalla harjoitustietojaan nähdäkseen aiemmin käytetyt sanayhdistelmät. Tällä voi olla tahattomia seurauksia.

Stokastisten papukaijojen ruokinta

Tätä suurten kielimallien haastetta korostettiin ensimmäisen kerran a uraauurtava paperi niin sanotuista stokastisista papukaijoista. Stokastinen papukaija – termi, jonka ovat keksineet kirjoittajat, jotka sisällyttivät joukkoonsa Googlen eettisen A.I: n entisen johtajan. tiimi Timnit Gebru – viittaa suureen kielimalliin, joka "satunnaisesti [ompelee] yhteen kielellisten muotojen sekvenssit, jotka se on havainnut valtavassa harjoitusdatassaan todennäköisyystietojen mukaan niiden yhdistämisestä, mutta ilman viittausta merkitykseen."

"Olen saanut koulutusta suuressa osassa Internetiä, joten on tärkeää tunnustaa, että se sisältää joitain ennakkoluuloja." Albert Gozzi, toinen GPT-3-käyttäjä, kertoi Digital Trendsille. "Tiedän, että OpenAI-tiimi työskentelee lujasti tämän lieventämiseksi muutamilla eri tavoilla, mutta odotan tämän olevan ongelma [jonkin] tulevaisuudessa."

OpenAI: n vastatoimiin puolueellisuutta vastaan puolustautumiseen kuuluu myrkyllisyyssuodatin, joka suodattaa tietyn kielen tai aiheet pois. OpenAI etsii myös tapoja integroida ihmisten palautetta, jotta voidaan määrittää, mille alueille ei eksytä. Lisäksi tiimi valvoo pääsyä työkaluun siten, että tietyille työkalun negatiivisille käyttökohteille ei myönnetä käyttöoikeutta.

"Bias ja mahdollisuus nimenomaiseen tuottoon ovat ehdottomasti olemassa ja vaativat kehittäjiltä ponnisteluja välttääkseen."

"Yksi syistä, miksi et ehkä ole nähnyt liian monia näitä haitallisia käyttäjiä, on se, että meillä on intensiivinen sisäinen tarkistusprosessi", Agarwal sanoi. "Työskentelemme siten, että joka kerta kun haluat käyttää GPT-3:a tuotteessa, joka todella otetaan käyttöön, täytyy käydä läpi prosessi, jossa tiimi – kuten ihmisryhmä – todella tarkistaa, miten haluat käyttää se. … Sen jälkeen, kun varmistat, ettei se ole haitallinen, sinulle myönnetään käyttöoikeus.”

Osa tästä on kuitenkin haastavaa – ei vähiten siksi, että puolueellisuus ei aina ole yksiselitteinen tapaus käyttää tiettyjä sanoja. Jervis huomauttaa, että toisinaan hänen GPT-3-vuokraviestinsä voivat "taipumusta stereotyyppiseen sukupuoleen [tai] luokkaan oletuksia." Jos se jätetään ilman valvontaa, se saattaa olettaa vuokrakirjeessä kohteen sukupuoli-identiteetin heidän perheensä perusteella rooli tai työ. Tämä ei ehkä ole surkein esimerkki A.I. harhaa, mutta se korostaa, mitä tapahtuu, kun suuria tietomääriä syötetään ja kootaan sitten todennäköisyydellä uudelleen kielimalliin.

"Bias ja mahdollisuus nimenomaiseen tuottoon ovat ehdottomasti olemassa ja vaativat kehittäjiltä ponnisteluja välttääkseen", Tyler Lastovich sanoi. "OpenAI ilmoittaa mahdollisesti myrkyllisistä tuloksista, mutta viime kädessä se lisää vastuuta, jota asiakkaiden on mietittävä huolellisesti ennen mallin käyttöönottoa. Erityisen vaikea reunatapaus kehitteillä on mallin taipumus valehdella – sillä sillä ei ole käsitystä oikeasta tai väärästä tiedosta.

Kielimallit ja A.I: n tulevaisuus

Yhdeksän kuukautta debyyttinsä jälkeen GPT-3 on varmasti täyttänyt laskunsa pelin vaihtajana. Se, mikä ennen oli puhtaasti potentiaalia, on osoittautunut potentiaaliseksi toteutuneeksi. GPT-3:n kiehtovien käyttötapausten määrä korostaa, kuinka tekstiä luova A.I. on paljon monipuolisempi kuin kuvaus saattaa antaa ymmärtää.

Ei sillä, että se olisi uusi lapsi korttelissa näinä päivinä. Aiemmin tänä vuonna GPT-3 ohitettiin suurimmaksi kielimalliksi. Google Brain esitteli uuden kielimallin noin 1,6 biljoonaa parametria, mikä tekee siitä yhdeksän kertaa OpenAI: n tarjontaa suuremman. Tämä ei myöskään todennäköisesti ole kielimallien tien loppu. Nämä ovat erittäin tehokkaita työkaluja – joilla on potentiaalia muuttaa yhteiskuntaa, mahdollisesti parempaan ja huonompaan suuntaan.

Näillä teknologioilla on varmasti haasteita, ja niihin yritysten, kuten OpenAI: n, riippumattomien tutkijoiden ja muiden on vastattava. Mutta kokonaisuutena tarkasteltuna on vaikea väittää, etteivätkö kielimallit ole tulossa yhdeksi tekoälytutkimuksen mielenkiintoisimmista ja tärkeimmistä rajoista.

Kuka olisi uskonut, että tekstigeneraattorit voisivat olla niin tärkeitä? Tervetuloa tekoälyn tulevaisuuteen.

Toimittajien suositukset

- Analoginen A.I.? Kuulostaa hullulta, mutta se saattaa olla tulevaisuutta

- Lue aavemaisen kaunista A.I: n synteettistä kirjoitusta. joka luulee olevansa Jumala

- Algoritminen arkkitehtuuri: Pitäisikö meidän antaa A.I. suunnitteletko rakennuksia meille?

- Naiset tavun kanssa: Vivienne Mingin suunnitelma ratkaista "sotkuiset inhimilliset ongelmat" A.I: n kanssa.

- Miksi robottien opettaminen leikkimään piilosta voisi olla avain seuraavan sukupolven A.I: lle?