ChatGPT plahvatuslikult kasvab ja selle AI mudeli selgroog toetub Nvidia graafikakaartidele. Üks analüütik ütles ChatGPT koolitamiseks kasutati umbes 10 000 Nvidia GPU-d ja teenuse laienedes kasvab ka vajadus GPU-de järele. Kõik, kes 2021. aastal krüpto tõusu üle elasid, võivad tunda a GPU puudus silmapiiril.

Sisu

- Miks Nvidia GPU-d on loodud AI jaoks?

- See kõik taandub mälule

- Erinevad vajadused, erinevad suremused

Olen näinud, kuidas mõned ajakirjanikud seda täpset ühendust loovad, kuid see on ekslik. Krüptopõhise GPU-de nappuse päevad on seljataga. Kuigi tõenäoliselt näeme nõudluse tõusu graafikakaardid Kuna tehisintellekt jätkab buumi, ei ole see nõudlus suunatud sellele parimad graafikakaardid sisse paigaldatud mänguriistad.

Soovitatavad videod

Miks Nvidia GPU-d on loodud AI jaoks?

Esiteks käsitleme, miks Nvidia

Seotud

- Wix kasutab ChatGPT-d, mis aitab teil kiiresti terve veebisaidi luua

- ChatGPT tootja OpenAI seisab silmitsi FTC uurimisega tarbijakaitseseaduste üle

- ChatGPT Bingi sirvimisfunktsioon on tasulisele juurdepääsuvea tõttu keelatud

CUDA on Nvidia rakenduste programmeerimisliides (API), mida kasutatakse kõige kallimates andmekeskuse GPU-dest kuni selle Odavaimad mängu GPU-d. CUDA kiirendust toetavad masinõppeteegid nagu TensorFlow, mis kiirendab oluliselt koolitust ja järeldus. CUDA on edasiviiv jõud AMD on AI-s nii palju maha jäänud võrreldes Nvidiaga.

Ärge ajage CUDA-d segamini Nvidia CUDA tuumadega. CUDA on platvorm, millel töötab palju AI-rakendusi, samas kui CUDA tuumad on vaid Nvidia GPU-de tuumad. Neil on ühine nimi ja CUDA tuumad on paremini optimeeritud CUDA rakenduste käitamiseks. Nvidia mängugraafikaprotsessoritel on CUDA tuumad ja need toetavad CUDA rakendusi.

Tensori tuumad on põhimõtteliselt spetsiaalsed AI tuumad. Nad tegelevad maatriksi korrutamisega, mis on salakaste, mis kiirendab tehisintellekti treenimist. Idee on siin lihtne. Korrutage mitu andmekomplekti korraga ja treenige tehisintellekti mudeleid eksponentsiaalselt kiiremini, luues võimalikke tulemusi. Enamik protsessoreid lahendab ülesandeid lineaarselt, samas kui Tensori tuumad saavad kiiresti luua stsenaariume ühe taktitsükli jooksul.

Jällegi meeldivad Nvidia mängu GPU-d RTX 4080 neil on Tensori tuumad (ja mõnikord isegi rohkem kui kulukad andmekeskuse GPU-d). Kõigi spetsifikatsioonide jaoks peavad Nvidia kaardid AI-mudeleid kiirendama, kuid ükski neist pole nii oluline kui mälu. Ja Nvidia mängude GPU-del pole palju mälu.

See kõik taandub mälule

"Mälu suurus on kõige olulisem," ütles Jeffrey Heaton, mitme tehisintellekti käsitleva raamatu autor ja St. Louis Washingtoni ülikooli professor. "Kui teil pole piisavalt GPU-d

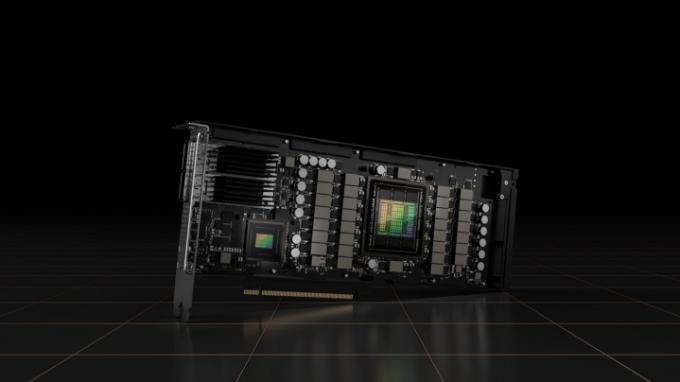

Heaton, kes on YouTube'i kanal pühendatud sellele, kui hästi AI mudelid teatud GPU-dega töötavad, märkis, et CUDA tuumad on samuti olulised, kuid mälumaht on domineeriv tegur, kui rääkida GPU toimimisest AI jaoks. The RTX 4090 sellel on mängustandardite järgi palju mälu – 24 GB GDDR6X –, kuid andmekeskuseklassi GPU-ga võrreldes väga vähe. Näiteks Nvidia uusimal H100 GPU-l on 80 GB HBM3 mälu ja massiivne 5120-bitine mälusiin.

Saab hakkama ka vähemaga, aga mälu on ikka palju vaja. Heaton soovitab, et algajatel oleks vähemalt 12 GB, samas kui tavalisel masinõppeinseneril on üks või kaks 48 GB professionaali. Nvidia GPU-d. Heatoni sõnul langeb enamik töökoormusi rohkem vahemikus A100 kuni kaheksa A100. Nvidia A100 GPU-l on 40 GB mälu.

Seda skaleerimist näete ka töös. Puget süsteemid näitab üht 40 GB mäluga A100, mis toimib umbes kaks korda kiiremini kui üksainus RTX 3090 oma 24 GB mäluga. Ja seda hoolimata asjaolust, et RTX 3090-l on peaaegu kaks korda rohkem CUDA südamikke ja peaaegu sama palju Tensori südamikke.

Kitsaskoht on mälu, mitte töötlemata töötlemisvõimsus. Selle põhjuseks on asjaolu, et AI mudelite treenimine tugineb suurtele andmekogumitele ja mida rohkem neid andmeid mällu salvestate, seda kiiremini (ja täpsemalt) saate mudelit treenida.

Erinevad vajadused, erinevad suremused

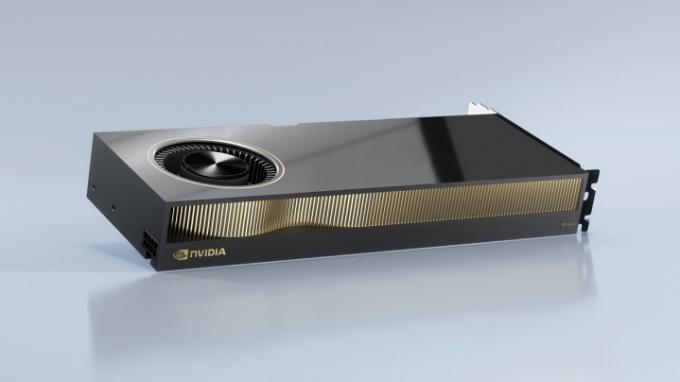

Nvidia mängugraafikaprotsessorid ei sobi üldiselt tehisintellektile, kuna neil on võrreldes ettevõtte riistvaraga vähe videomälu, kuid siin on ka eraldi probleem. Nvidia tööjaama GPU-d ei jaga tavaliselt oma mängukaartidega GPU-d.

Näiteks A100, millele Heaton viitas, kasutab GA100 GPU-d, mis on Nvidia Ampere'i sarjast stants, mida pole kunagi kasutatud mängudele keskendunud kaartidel (sealhulgas tipptasemel kaartidel). RTX 3090 Ti). Samamoodi kasutab Nvidia uusim H100 täiesti erinevat arhitektuuri kui RTX 40-seeria, mis tähendab, et see kasutab ka teistsugust stantsi.

On erandeid. Nvidia AD102 GPU, mis on sees RTX 4090 ja RTX 4080, kasutatakse ka väikeses valikus Ada Lovelace'i ettevõtte GPU-des (L40 ja RTX 6000). Enamikul juhtudel ei saa Nvidia aga lihtsalt andmekeskuse kaardi jaoks mängu GPU-d ümber kasutada. Need on eraldi maailmad.

Krüptokaevandamisest tingitud GPU puuduse ja tehisintellekti mudelite populaarsuse kasvu vahel on mõned põhimõttelised erinevused. Heatoni sõnul vajas GPT-3 mudel treenimiseks üle 1000 A100 Nvidia GPU ja töötamiseks umbes kaheksa. Nendel GPU-del on juurdepääs ka suure ribalaiusega NVLinki vastastikusele ühendusele, samas kui Nvidia RTX 40-seeria GPU-del seda pole. See võrdleb maksimaalselt 24 GB mälu Nvidia mängukaartidel mitmesaja graafikaprotsessoriga, nagu A100 koos NVLinkiga.

On ka muid probleeme, näiteks mälupesade eraldamine professionaalsetele GPU-dele mänguritele, kuid päevad, mil kiirustate oma kohalikku Micro Centerisse või Best Buy'i, et leida laost GPU läinud. Heaton võttis selle punkti kenasti kokku: "Suured keelemudelid, nagu ChatGPT, nõuavad töötamiseks hinnanguliselt vähemalt kaheksat GPU-d. Sellised hinnangud eeldavad tipptasemel A100 GPU-sid. Minu spekulatsioon on, et see võib põhjustada kõrgema klassi GPU-de puudust, kuid see ei pruugi mõjutada mängijaklassi GPU-sid, kuna see on väiksem.

Toimetajate soovitused

- Tippautorid nõuavad tehisintellektifirmadelt nende töö kasutamise eest tasu

- Google Bard saab nüüd rääkida, kuid kas see võib ChatGPT-d välja uputada?

- ChatGPT veebisaidi liiklus on esimest korda langenud

- 81% arvab, et ChatGPT on turvarisk, selgub uuringust

- Apple'i ChatGPT rivaal võib teie eest automaatselt koodi kirjutada

Uuenda oma elustiiliDigitaalsed suundumused aitavad lugejatel hoida silma peal kiirel tehnikamaailmal kõigi viimaste uudiste, lõbusate tooteülevaadete, sisukate juhtkirjade ja ainulaadsete lühiülevaadetega.