Para modificar ligeramente el título de un conocido programa de televisión: Los niños hacen las cosas más increíbles. Recientemente, investigadores de Alemania y el Reino Unido llevaron a cabo un estudio, publicado en la revista Robótica científica, que demostró hasta qué punto los niños son susceptibles a la presión de los compañeros de los robots. Versión TLDR: la respuesta a esa vieja pregunta de los padres: "Si todos tus amigos te dijeran que saltas por un acantilado, ¿lo harías?" bien podría ser “Claro. Si todos mis amigos fueran robots”.

Contenido

- ¿Son realmente los adultos mucho más inteligentes?

- Por cada barco hay un naufragio

La prueba recreó un famoso experimento de 1951 iniciado por el psicólogo polaco Solomon Asch. El experimento demostró cómo las personas pueden verse influenciadas por las presiones del pensamiento grupal, incluso cuando éste va en contra de la información que saben que es correcta. En los experimentos de Asch, se reunió a un grupo de estudiantes universitarios y se les mostraron dos tarjetas. La tarjeta de la izquierda mostraba una imagen de una sola línea vertical. La tarjeta de la derecha mostraba tres líneas de diferentes longitudes. Luego, el experimentador preguntó a los participantes qué línea de la tarjeta derecha coincidía con la longitud de la línea que se muestra en la tarjeta izquierda.

Vídeos recomendados

"Lo especial de los niños de ese rango de edad es que todavía están en una edad en la que suspenderán la incredulidad".

Hasta ahora, todo muy sencillo. Sin embargo, donde las cosas se pusieron más tortuosas fue en la composición del grupo. Sólo una persona del grupo era un participante genuino, mientras que los demás eran todos actores a quienes se les había dicho qué decir de antemano. El experimento consistía en comprobar si el participante real estaría de acuerdo con el resto del grupo cuando dieran por unanimidad una respuesta incorrecta. Al final resultó que, la mayoría lo haría. La presión de grupo significa que la mayoría de las personas negarán información que sea claramente correcta si eso significa ajustarse a la opinión mayoritaria.

Relacionado

- Los robots en evolución y autorreplicantes están aquí, pero no te preocupes por un levantamiento

- Los robots no vienen a robarte el trabajo. Vienen a mejorarlo

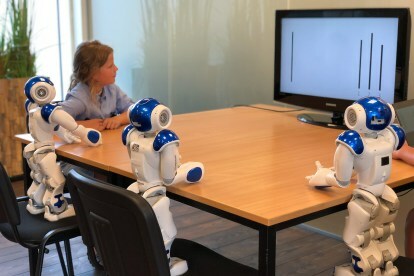

En la remezcla del experimento de 2018, se utilizó el mismo principio: solo que en lugar de un grupo de compañeros en edad universitaria, el “participante real” era un niño de entre siete y nueve años. Los “actores” fueron interpretados por tres robots, programados para dar la respuesta incorrecta. En una muestra de 43 voluntarios, el 74 por ciento de los niños dieron la misma respuesta incorrecta que los robots. Los resultados sugieren que la mayoría de los niños de esta edad tratarán la presión de los robots de la misma manera que la presión de sus compañeros de carne y hueso.

"Lo especial de los niños de ese rango de edad es que todavía están en una edad en la que suspenderán la incredulidad". Tony Belpaeme, dijo a Digital Trends el profesor de Sistemas de Control Inteligentes y Autónomos, que ayudó a realizar el estudio. “Jugarán con juguetes y seguirán creyendo que sus muñecos de acción o muñecos son reales; seguirán viendo un espectáculo de marionetas y realmente creerán lo que está pasando; es posible que todavía crean en [Santa Claus]. Lo mismo ocurre cuando miran un robot: no ven electrónica ni plástico, sino un carácter social”.

Curiosamente, el experimento contrastó esto con la respuesta de los adultos. A diferencia de los niños, los adultos no se dejaron llevar por los errores de los robots. "Cuando un adulto vio que el robot daba la respuesta incorrecta, lo miró perplejo y luego dio la respuesta correcta", continuó Belpaeme.

¿Entonces no hay nada de qué preocuparse? Mientras impidamos que los niños tengan en sus manos robots programados para dar malas respuestas, todo debería estar bien, ¿verdad? No seas tan rápido.

¿Son realmente los adultos mucho más inteligentes?

Como reconoció Belpaeme, esta tarea fue diseñada para ser tan simple que no hubiera incertidumbre sobre cuál podría ser la respuesta. El mundo real es diferente. Cuando pensamos en los tipos de trabajos que se encomiendan fácilmente a las máquinas, con frecuencia se trata de tareas que nosotros, como seres humanos, no siempre somos capaces de realizar a la perfección.

Esta tarea fue diseñada para ser tan simple que no hubiera incertidumbre sobre cuál podría ser la respuesta.

Podría ser que la tarea sea increíblemente sencilla, pero que la máquina pueda realizarla mucho más rápido que nosotros. O podría ser una tarea más compleja, en la que la computadora tiene acceso a cantidades de datos mucho mayores que nosotros. Dependiendo del impacto potencial del trabajo en cuestión, no sorprende que muchos de nosotros no estemos contentos con la idea de corregir una máquina.

¿Estaría contenta una enfermera de un hospital con anular la Algoritmo aprobado por la FDA ¿Qué puede ayudar a establecer prioridades sobre la salud del paciente al monitorear los signos vitales y luego enviar alertas al personal médico? ¿O se sentiría cómodo un conductor tomando el volante de un automóvil sin conductor cuando se enfrenta a un escenario vial particularmente complejo? ¿O incluso un piloto que anula el piloto automático porque cree que se está tomando una decisión equivocada? En todos estos casos, nos gustaría pensar que la respuesta es "sí". Sin embargo, por todo tipo de razones, esa puede no ser la realidad.

Nicholas Carr escribe sobre esto en su libro de 2014. La jaula de cristal: hacia dónde nos lleva la automatización. La forma en que lo describe subraya el tipo de ambigüedad que implican los casos de automatización de la vida real, donde los problemas son mucho más complejas que la longitud de una línea en una tarjeta, las máquinas son mucho más inteligentes y el resultado es potencialmente más crucial.

“¿Cómo se mide el costo de una erosión del esfuerzo y el compromiso, o una disminución de la agencia y la autonomía, o un deterioro sutil de las habilidades? No puedes”, escribe. "Este es el tipo de cosas oscuras e intangibles que rara vez apreciamos hasta que desaparecen, e incluso entonces podemos tener problemas para expresar las pérdidas en términos concretos".

"Este es el tipo de cosas oscuras e intangibles que rara vez apreciamos hasta que desaparecen".

Los robots sociales del tipo sobre el que Belpaeme teoriza en el artículo de investigación aún no son comunes, pero ya existen ejemplos de algunos de estos enigmas en acción. Por ejemplo, Carr abre su libro mencionando un memorando de la Administración Federal de Aviación que señalaba que los pilotos deberían pasar menos tiempo volando en piloto automático debido a los riesgos que esto planteaba. Esto se basó en el análisis de datos de accidentes, que muestran que los pilotos con frecuencia dependen demasiado de los sistemas computarizados.

Un caso similar involucró una demanda de 2009 en la que una mujer llamada Lauren Rosenberg presentó una demanda contra Google después de que le aconsejaran caminar por una ruta que conducía a tráfico peligroso. Aunque el caso fue desestimado por los tribunales, demuestra que la gente anulará su propio sentido común al creer que la inteligencia de las máquinas tiene más inteligencia que la nuestra.

Por cada barco hay un naufragio

En última instancia, como reconoce Belpaeme, el problema es que a veces queremos dejar la toma de decisiones en manos de las máquinas. Robots Prometo hacer los trabajos que son aburridos, sucios y peligrosos. – y si tenemos que cuestionar cada decisión, en realidad no son los dispositivos que ahorran mano de obra que se han prometido. Si finalmente vamos a invitar robots a nuestra casa, querremos que puedan actuar de forma autónoma, y eso implicará un cierto nivel de confianza.

“Que los robots ejerzan presión social sobre ti puede ser algo bueno; no tiene por qué ser siniestro”, continuó Belpaeme. “Si tienes robots utilizados en la atención sanitaria o la educación, quieres que puedan influir en ti. Por ejemplo, si quieres perder peso te podrían regalar un robot adelgazante durante dos meses que monitores tu ingesta de calorías y te anima a hacer más ejercicio. Quieres que un robot como ese sea persuasivo e influya en ti. Pero cualquier tecnología que pueda usarse para el bien también puede usarse para el mal”.

¿Cuál es la respuesta a esto? Preguntas como ésta se debatirán caso por caso. Si en última instancia lo malo supera a lo bueno, la tecnología como los robots sociales nunca despegará. Pero es importante que aprendamos las lecciones correctas de estudios como el de la presión social inducida por robots. Y no es el hecho de que seamos mucho más inteligentes que los niños.

Recomendaciones de los editores

- El futuro de la automatización: los robots están llegando, pero no quitarán tu trabajo

- Estos robots matan las malas hierbas con pistolas Taser para que los agricultores no necesiten herbicidas químicos