Die guten Nachrichten? Für die überwiegende Mehrheit der Menschen sind sie immer noch nicht erkennbar. Die schlechten Nachrichten? Sie täuschen die moderne Informatik nicht.

Empfohlene Videos

Diese Informationen gehen aus einem neuen Projekt hervor, das von Forschern der University of Texas in Austin und der Cornell University durchgeführt wurde tiefes Lernen Zu Erraten Sie die redigierten Identitäten richtig von Menschen, die durch Verschleierung verborgen sind. Während menschliche Identitäten in 0,19 Prozent der Fälle korrekt erraten wurden, war das maschinelle Lernsystem in der Lage, bei fünf Versuchen ein korrektes Urteil mit einer Genauigkeit von 83 Prozent zu fällen.

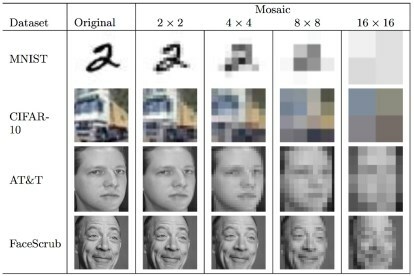

„Unschärfe und Verpixelung werden häufig verwendet, um die Identität von Personen in Fotos und Videos zu verbergen.“ Vitaly Shmatikov, Professor für Informatik an der Cornell University, sagte gegenüber Digital Trends. „In vielen dieser Szenarien hat der Gegner eine ziemlich gute Vorstellung von einer kleinen Gruppe möglicher Personen wer auf dem Bild hätte erscheinen können, und er muss nur herausfinden, wer von ihnen auf dem Bild zu sehen ist Bild."

Dies, so Shmatikov weiter, sei genau das Szenario, in dem die Technologie des Teams gut funktioniere. „Dies zeigt, dass Unschärfe, Verpixelung und andere Methoden zur Bildverschleierung möglicherweise keinen großen Schutz bieten, wenn die Offenlegung der Identität einer Person diese gefährden würde“, sagte er.

Die Herausforderung besteht natürlich darin, dass solche Methoden zur Schwärzung der Identität einer Person häufig zum Schutz einer Person eingesetzt werden, beispielsweise eines Whistleblowers oder eines Zeugen einer Straftat. Durch die Anwendung solcher Bilderkennungsalgorithmen, basierend auf künstliche neurale NetzwerkeBei Bildern, die daher mit handelsüblichen Werkzeugen verschleiert wurden, könnten Personen möglicherweise in Gefahr gebracht werden.

„Die grundlegende Herausforderung besteht darin, die Lücke zwischen Datenschutztechnologien und maschinellem Lernen zu schließen“, sagte Shmatikov. „Viele Entwickler von Datenschutztechnologien sind sich der Leistungsfähigkeit des modernen maschinellen Lernens nicht voll bewusst – und das führt zu Technologien, die die Privatsphäre nicht wirklich schützen.“

Empfehlungen der Redaktion

- Zahlen Sie nicht die Verizon 5G-Steuer für das Google Pixel 4a 5G

- Nicht sprechen: Mit diesem Wearable können Sie Sprachbefehle erteilen, ohne ein Wort zu sagen

- Lassen Sie sich nicht täuschen – dieses automatisierte System manipuliert heimlich Videoinhalte

Werten Sie Ihren Lebensstil aufDigital Trends hilft Lesern mit den neuesten Nachrichten, unterhaltsamen Produktrezensionen, aufschlussreichen Leitartikeln und einzigartigen Einblicken, den Überblick über die schnelllebige Welt der Technik zu behalten.