Künstliche allgemeine Intelligenz, die Idee einer intelligenten K.I. Ein Agent, der in der Lage ist, jede intellektuelle Aufgabe des Menschen zu verstehen und zu erlernen, ist seit langem ein Bestandteil der Science-Fiction. Als K.I. wird immer intelligenter – insbesondere mit Durchbrüchen bei maschinellen Lerntools, die ihre Fähigkeiten neu schreiben können Code, um aus neuen Erfahrungen zu lernen – er ist immer häufiger Teil echter Gespräche über künstliche Intelligenz Also.

Inhalt

- Welten bauen

- Spielregeln

- Schwieriges Zeug ist einfach, leichtes Zeug ist schwer

Aber wie messen wir den AGI, wenn er tatsächlich ankommt? Im Laufe der Jahre haben Forscher eine Reihe von Möglichkeiten aufgezeigt. Am bekanntesten ist nach wie vor der Turing-Test, bei dem ein menschlicher Richter unsichtbar mit Menschen und einer Maschine interagiert und versuchen muss, zu erraten, wer welcher ist. Zwei weitere, Ben Goertzels Robot College Student Test und Nils J. Mit Nilssons Beschäftigungstest sollen die Fähigkeiten einer KI praktisch getestet werden, indem festgestellt wird, ob sie einen Hochschulabschluss erwerben oder Arbeitsplätze am Arbeitsplatz ausüben kann. Eine andere, die ich persönlich gerne außer Acht lassen würde, besagt, dass Intelligenz an der erfolgreichen Fähigkeit gemessen werden kann, Flatpack-Möbel im Ikea-Stil problemlos zusammenzubauen.

Empfohlene Videos

Eine der interessantesten AGI-Maßnahmen wurde von Apple-Mitbegründer Steve Wozniak vorgeschlagen. Woz, wie er von Freunden und Bewunderern genannt wird, schlägt den Kaffeetest vor. Eine allgemeine Intelligenz, sagte er, würde einen Roboter bedeuten, der in jedes Haus der Welt gehen, die Küche ausfindig machen, eine frische Tasse Kaffee zubereiten und ihn dann in eine Tasse gießen kann.

Verwandt

- Analoge KI? Es klingt verrückt, aber es könnte die Zukunft sein

- Hier erfahren Sie, was eine trendanalysierende K.I. glaubt, dass es das nächste große Ding in der Technik sein wird

- Die Zukunft der KI: 4 große Dinge, auf die man in den nächsten Jahren achten sollte

Wie bei jeder K.I. Bei einem Intelligenztest kann man darüber streiten, wie breit oder eng die Parameter sind. Allerdings ist die Idee, dass Intelligenz mit der Fähigkeit verbunden sein sollte, durch die reale Welt zu navigieren, faszinierend. Es ist auch eines, das ein neues Forschungsprojekt testen möchte.

Welten bauen

„In den letzten Jahren hat die K.I. Die Community hat große Fortschritte beim Training von K.I. gemacht. Agenten, um komplexe Aufgaben zu erledigen“, Luca Weihs, ein Forschungswissenschaftler am Allen Institute for AI, einem Labor für künstliche Intelligenz, das vom verstorbenen Microsoft-Mitbegründer Paul Allen gegründet wurde, sagte gegenüber Digital Trends.

Weihs zitierte die Entwicklung der KI durch DeepMind. Agenten, die dazu in der Lage sind Spielen Sie klassische Atari-Spiele Und Besiege menschliche Spieler bei Go. Weihs stellte jedoch fest, dass diese Aufgaben „häufig losgelöst“ von unserer Welt seien. Zeigen Sie einer KI ein Bild der realen Welt. Es ist darauf trainiert, Atari-Spiele zu spielen, und es wird keine Ahnung haben, was es da sieht. Hier glauben die Forscher des Allen Institute, etwas zu bieten zu haben.

Das Allen Institute for A.I. hat so etwas wie ein Immobilienimperium aufgebaut. Dabei handelt es sich jedoch nicht um physische Immobilien, sondern vielmehr um virtuelle Immobilien. Es wurden Hunderte virtuelle Räume und Wohnungen entwickelt – darunter Küchen, Schlafzimmer, Badezimmer und Wohnzimmer – in denen K.I. Agenten können mit Tausenden von Objekten interagieren. Diese Räume verfügen über eine realistische Physik, Unterstützung für mehrere Agenten und sogar Zustände wie heiß und kalt. Indem man K.I. Wenn Agenten in diesen Umgebungen spielen, besteht die Idee darin, dass sie eine realistischere Wahrnehmung der Welt aufbauen können.

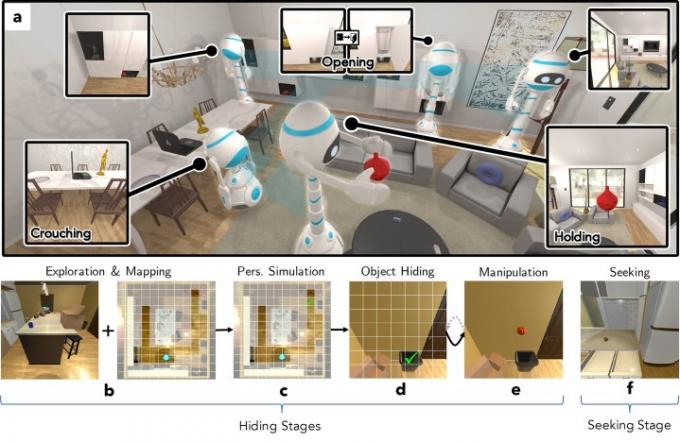

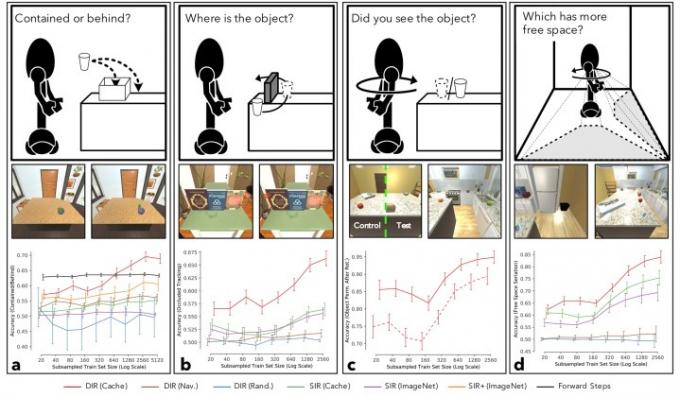

„In [unserer neuen] Arbeit wollten wir verstehen, wie K.I. Agenten könnten etwas über eine realistische Umgebung lernen, indem sie darin ein interaktives Spiel spielen“, sagte Weihs. „Um diese Frage zu beantworten, haben wir zwei Agenten darin geschult, Cache zu spielen, eine Variante des Versteckspiels, wobei wir gegnerisches Verstärkungslernen innerhalb der High-Fidelity-Umgebung nutzen AI2-THOR-Umgebung. Durch dieses Gameplay haben wir festgestellt, dass unsere Agenten gelernt haben, einzelne Bilder darzustellen und sich der Leistung von Methoden anzunähern erforderte Millionen von handbeschrifteten Bildern – und begann sogar mit der Entwicklung einiger kognitiver Grundelemente, die oft von [Entwicklungs-] Psychologen.“

Spielregeln

Im Gegensatz zum normalen Versteckspiel verstecken die Bots in Cache abwechselnd Gegenstände wie Toilettenkolben, Brotlaibe, Tomaten und mehr, die jeweils über ihre eigene, individuelle Geometrie verfügen. Die beiden Agenten – einer ein Verstecker, der andere ein Sucher – konkurrieren dann darum, ob einer das Objekt erfolgreich vor dem anderen verstecken kann. Dies beinhaltet eine Reihe von Herausforderungen, darunter Erkundung und Kartierung, Verständnis der Perspektive, Verstecken, Objektmanipulation und Suchen. Alles ist genau simuliert, bis hin zur Anforderung, dass der Versteckte in der Lage sein muss, den Gegenstand in seiner Hand zu manipulieren und ihn nicht fallen zu lassen.

Verwendung von Deep Reinforcement Learning – einem Paradigma des maschinellen Lernens, das auf dem Lernen basiert, Maßnahmen in einem zu ergreifen Umgebung, um die Belohnung zu maximieren – die Bots werden immer besser darin, die Objekte zu verstecken und zu suchen die raus.

„Was es für KIs so schwierig macht, ist, dass sie die Welt nicht so sehen wie wir“, sagte Weihs. „Milliarden Jahre der Evolution haben dafür gesorgt, dass unser Gehirn bereits als Kleinkinder Photonen effizient in Konzepte umwandelt. Andererseits ist eine K.I. fängt bei Null an und sieht seine Welt als ein riesiges Zahlengitter, das es dann lernen muss, in Bedeutung zu entschlüsseln. Darüber hinaus erfasst jedes vom Agenten gesehene Bild, anders als beim Schach, wo die Welt sauber in 64 Felder unterteilt ist, nur einen Es handelt sich um einen kleinen Teil der Umwelt, und daher muss es seine Beobachtungen über die Zeit hinweg integrieren, um ein kohärentes Verständnis davon zu entwickeln Welt."

Um es klar zu sagen: Bei dieser neuesten Arbeit geht es nicht um den Aufbau einer superintelligenten KI. In Filmen wie Terminator 2: Tag des Jüngsten Gerichts, erreicht der Skynet-Supercomputer am 29. August 1997 genau um 2:14 Uhr Eastern Time das Selbstbewusstsein. Ungeachtet des Datums, das mittlerweile fast ein Vierteljahrhundert in unserem kollektiven Rückspiegel liegt, scheint es unwahrscheinlich, dass es einen so genauen Wendepunkt geben wird, wenn die reguläre KI wieder in Kraft treten wird. wird zu AGI. Stattdessen werden immer mehr rechnerische Früchte – niedrig hängende und hoch hängende – gepflückt, bis wir schließlich etwas haben, das einer verallgemeinerten Intelligenz über mehrere Domänen hinweg nahekommt.

Schwieriges Zeug ist einfach, leichtes Zeug ist schwer

Forscher konzentrieren sich traditionell auf komplexe Probleme der KI. zu lösen, basierend auf der Idee, dass, wenn die schwierigen Probleme gelöst werden können, die einfachen nicht zu weit zurückliegen sollten. Wenn Sie die Entscheidungsfindung eines Erwachsenen simulieren können, können Ideen wie Objektpermanenz (die Idee, dass Objekte stillstehen) umgesetzt werden (die existieren, wenn wir sie nicht sehen können), die ein Kind in den ersten Monaten seines Lebens lernt, beweisen das wirklich schwierig? Die Antwort ist ja – und dieses Paradoxon, dass, wenn es um KI geht, die Schwieriges ist oft einfach, und das Einfache ist schwer, ist das Ziel dieser Arbeit.

„Das gängigste Paradigma für das Training von K.I. Agenten [beinhaltet] riesige, manuell beschriftete Datensätze, die sich eng auf eine einzelne Aufgabe konzentrieren – zum Beispiel das Erkennen von Objekten“, sagte Weihs. „Obwohl dieser Ansatz großen Erfolg hatte, halte ich es für optimistisch zu glauben, dass wir manuell genügend Datensätze erstellen können, um eine KI zu erstellen.“ Agent, der in der realen Welt intelligent agieren, mit Menschen kommunizieren und alle möglichen Probleme lösen kann, mit denen er zuvor noch nicht konfrontiert war. Um dies zu erreichen, müssen wir den Agenten meines Erachtens die grundlegenden kognitiven Grundprinzipien erlernen, die wir für selbstverständlich halten, indem wir sie frei mit ihrer Welt interagieren lassen. Unsere Arbeit zeigt, dass der Einsatz von Gameplay zur Motivation von K.I. Wenn Agenten mit ihrer Welt interagieren und sie erkunden, beginnen sie zu lernen diese Grundelemente – und zeigt damit, dass Gameplay eine vielversprechende Richtung weg von manuell beschrifteten Datensätzen und hin zu Erfahrung ist Lernen."

A Papier, das diese Arbeit beschreibt wird auf der kommenden International Conference on Learning Representations 2021 vorgestellt.

Empfehlungen der Redaktion

- Optische Täuschungen könnten uns beim Aufbau der nächsten Generation der KI helfen

- Die lustige Formel: Warum maschinengenerierter Humor der heilige Gral der KI ist

- Lesen Sie die unheimlich schöne „synthetische Schrift“ einer KI. das denkt, es sei Gott

- Algorithmische Architektur: Sollten wir K.I. Entwerfen Sie Gebäude für uns?

- Emotionserfassende KI ist hier, und es könnte in Ihrem nächsten Vorstellungsgespräch sein