Aus Journeys „Hören Sie nicht auf zu glauben„zu Queen’s“Böhmische Rhapsodie„zu Kylie Minogues“Ich kriege dich nicht aus meinem Kopf„Es gibt einige Lieder, die es schaffen, sich erfolgreich durch unsere Gehörgänge zu schleichen und sich in unserem Gehirn festzusetzen. Was wäre, wenn es möglich wäre, die Signale des Gehirns zu lesen und diese zu nutzen, um genau zu erraten, welches Lied eine Person gerade hört?

Inhalt

- Gedanken lesen, Maschinen trainieren

- Der Weg zu Gehirn-Computer-Schnittstellen

Das sagen Forscher der Abteilung Human-Centered Design der Technischen Universität Delft Niederlande und die Abteilung für Kognitionswissenschaft am Indian Institute of Technology Gandhinagar waren arbeiten an. In einem kürzlich durchgeführten Experiment haben sie gezeigt, dass dies durchaus möglich ist – und die Auswirkungen könnten schwerwiegender sein, als Sie vielleicht denken.

Empfohlene Videos

Für die Studie rekrutierten die Forscher eine Gruppe von 20 Personen. und bat sie, sich 12 Lieder anzuhören

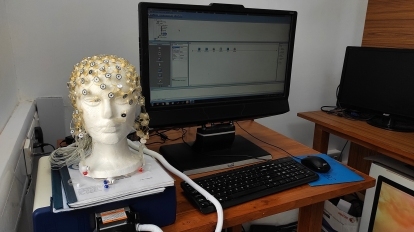

Kopfhörer. Um sie besser konzentrieren zu können, wurde der Raum abgedunkelt und den Freiwilligen wurden die Augen verbunden. Jeder wurde mit einer Elektroenzephalographie (EEG)-Kappe ausgestattet, die in der Lage ist, die elektrische Aktivität auf ihrer Kopfhaut nichtinvasiv aufzuzeichnen, während sie die Lieder hören.Diese Gehirndaten wurden dann zusammen mit der entsprechenden Musik verwendet, um einen zu trainieren künstliche neuronale Netz um Zusammenhänge zwischen beiden erkennen zu können. Als der resultierende Algorithmus anhand von Daten getestet wurde, die er zuvor noch nicht gesehen hatte, konnte er das Lied mit einer Genauigkeit von 85 % korrekt identifizieren – ausschließlich basierend auf den Gehirnwellen.

„Die Lieder waren eine Mischung aus westlichen und indischen Liedern und umfassten eine Reihe von Genres“ Krishna Miyapuram, Assistenzprofessor für Kognitionswissenschaft und Informatik am Indian Institute of Technology Gandhinagar, sagte gegenüber Digital Trends. „Auf diese Weise haben wir eine größere repräsentative Stichprobe für Schulungen und Tests erstellt. Der Ansatz wurde bestätigt, als wir beeindruckende Klassifizierungsgenauigkeiten erzielten, selbst wenn wir die Trainingsdaten auf einen kleineren Prozentsatz des Datensatzes beschränkten.“

Gedanken lesen, Maschinen trainieren

Dies ist nicht das erste Mal, dass Forscher gezeigt haben, dass es möglich ist, „Gedankenlese“-Demonstrationen durchzuführen, die David Blaine neidisch machen würden, und zwar mithilfe von EEG-Daten. Beispielsweise haben Neurowissenschaftler der kanadischen University of Toronto Scarborough zuvor Bilder basierend auf EEG-Daten rekonstruiert Gesichtsbilder digital nachbilden im Kopf einer Person gespeichert. Miyapurams eigene bisherige Forschung umfasst ein Projekt, bei dem EEG-Daten verwendet wurden, um von Teilnehmern angesehene Filmclips zu identifizieren, wobei jeder einzelne eine andere emotionale Reaktion hervorrufen sollte.

Interessanterweise zeigte diese neueste Arbeit, dass sich Algorithmen als sehr effektiv beim Erraten der angehörten Songs erwiesen Die Ratschläge eines Teilnehmers, nachdem er an seinem spezifischen Gehirn trainiert wurde, würden bei der Anwendung auf einen anderen nicht so gut funktionieren Person. Tatsächlich ist „nicht so gut“ eine grobe Untertreibung: Die Genauigkeit dieser Tests sank von 85 % auf weniger als 10 %.

„Unsere Forschung zeigt, dass Einzelpersonen personalisierte Musikerlebnisse haben“, sagte Miyapuram. „Man würde erwarten, dass das Gehirn auf die Verarbeitung von Informationen aus verschiedenen Reizen auf ähnliche Weise reagiert. Dies gilt für das, was wir als Low-Level-Features oder Stimulus-Level-Features verstehen. [Aber] wenn es um Musik geht, sind es vielleicht die übergeordneten Merkmale, wie zum Beispiel der Genuss, die einzelne Erlebnisse unterscheiden.“

Derek Lomas, Assistenzprofessor für positive K.I. von der Technischen Universität Delft, sagte, dass ein zukünftiges Ziel des Projekts darin bestehe, die Beziehung zwischen EEG-Frequenzen und Musikfrequenzen abzubilden. Dies könnte helfen, Fragen zu beantworten, etwa ob eine größere ästhetische Resonanz mit einer größeren neuronalen Resonanz einhergeht.

Anders ausgedrückt: Eine Person, die von einem Musikstück „bewegt“ ist, zeigt größere Korrelationen zwischen der Musik selbst und dem Gehirnreaktion, die es ermöglicht, allein anhand der Gehirnwellen genau vorherzusagen, wie sehr eine Person ein Musikstück genießt? Auch wenn die Reaktion jedes Einzelnen auf Musik subtil unterschiedlich sein mag, könnte dies Aufschluss darüber geben, warum Menschen überhaupt nach Musik suchen.

Der Weg zu Gehirn-Computer-Schnittstellen

„Für kurzfristige Anwendungen [in den nächsten zwei Jahren] stellen wir uns eine Musikempfehlungsmaschine vor, die auf der Gehirnreaktion einer Person basieren könnte“, sagte Lomas gegenüber Digital Trends. „Derzeit arbeitet ein Student an algorithmisch generierter Musik, die die neuronale Resonanz maximiert. Es ist ziemlich unheimlich: Die maximale neuronale Resonanz ist nicht dasselbe wie die maximale ästhetische Resonanz.“

Mittelfristig könnte dies laut Lomas zu leistungsstarken Anwendungen führen, um Informationen über die „Erfahrungstiefe“ einer Person zu gewinnen, die sich mit Medien beschäftigt. Mithilfe von Gehirnanalysetools kann (und sollte) es möglich sein, genau vorherzusagen, wie sehr sich eine Person beschäftigt, wenn sie beispielsweise einen Film ansieht oder ein Album anhört. Eine gehirnbasierte Messung des Engagements könnte dann verwendet werden, um bestimmte Erfahrungen zu verfeinern. Möchten Sie Ihren Film für 90 % der Zuschauer ansprechender gestalten? Optimieren Das Szenenwechsel Das eins.

„Langfristig – 20 Jahre – könnte dieses Arbeitsfeld Methoden zur Transkription von Vorstellungsinhalten ermöglichen“, fuhr Lomas fort. „Zum Beispiel das Transkribieren von Gedanken in Text. Das ist die große Zukunft von [Gehirn-Computer-Schnittstellen].“

Wie Lomas feststellte, sind wir von dem letztendlichen Ziel einer Gehirn-Computer-Schnittstelle noch weit entfernt. Nichtsdestotrotz deuten Arbeiten wie diese darauf hin, dass es an diesem Baum viele leckere, tiefer hängende Früchte gab, bevor wir ihn schließlich fällten.

A Papier, das diese Forschung beschreibtmit dem Titel GuessTheMusic: Song Identification from Electroencephalography wurde kürzlich auf der CODS-COMAD 2021 vorgestellt.

Empfehlungen der Redaktion

- Deep-Learning-K.I. kann die Verzerrungseffekte ikonischer Gitarrengötter imitieren

Werten Sie Ihren Lebensstil aufDigital Trends hilft Lesern mit den neuesten Nachrichten, unterhaltsamen Produktrezensionen, aufschlussreichen Leitartikeln und einzigartigen Einblicken, den Überblick über die schnelllebige Welt der Technik zu behalten.