Googles Stärke bei Smartphone-Kameras war schon immer seine KI. und Computerfotografiesysteme. Das Foto, das Ihr Telefon Ihnen zeigt, nachdem Sie den Auslöser gedrückt haben, ist keine Kopie dessen, was Sie gerade sehen – es ist eine Kombination aus Dutzenden von Bildern, die zusammengefügt und von fortschrittlichen Algorithmen verarbeitet werden. Das schafft ein Problem: Google hat festgestellt, dass seine Fotoalgorithmen nicht alle Hauttöne und körperlichen Merkmale richtig darstellen.

Empfohlene Videos

In einer Ankündigung unter Google I/O 2021 sagte das Unternehmen, dass ich daran arbeite, das zu ändern. Sein Ziel ist es, „zu machen Smartphone Fotografie wirklich für jedermann […], um eine genauere und umfassendere Kamera zu bauen.“

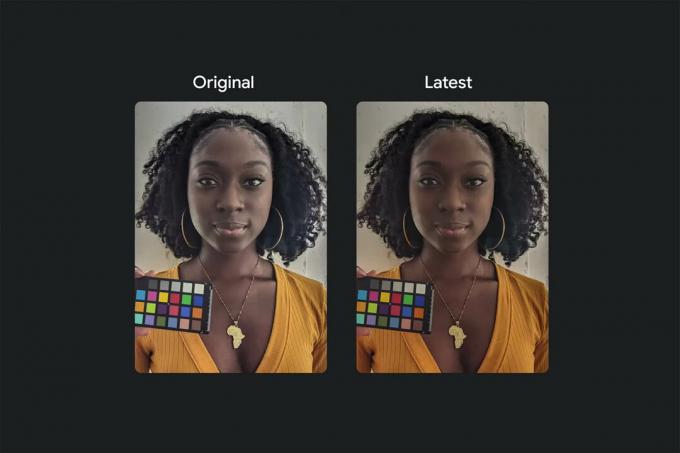

Google hat in seiner Fotoabteilung eine neue Initiative ins Leben gerufen, um sicherzustellen, dass seine Fotoverarbeitungsalgorithmen sicher sind Stellen Sie Menschen mit unterschiedlicher Hautfarbe genau und angemessen dar – von Hauttönen über Körper- und Gesichtszüge bis hin zu Haartypen. und darüber hinaus. Es begann mit der Zusammenstellung einer Gruppe von Fotografieexperten, um Informationen darüber zu sammeln, wie die Computerfotografie dazu geführt hat Lücken bei der korrekten Darstellung einiger Gruppen und begann mit der Arbeit, um sicherzustellen, dass die Software in seinen Kameras dem entgegenwirken kann Das.

Verwandt

- Besitzen Sie ein altes Google Pixel? Dieser Kameratest macht Lust auf ein Pixel 7a

- Farben des Google Pixel 7a: Hier finden Sie alle verfügbaren Optionen

- Verfügt das Google Pixel 7a über kabelloses Laden?

„Die Arbeit liegt an uns. Es steht den Menschen nicht zu, ihr Aussehen zu ändern. Es liegt an uns, die Funktionsweise der Tools zu ändern“, sagte Google.

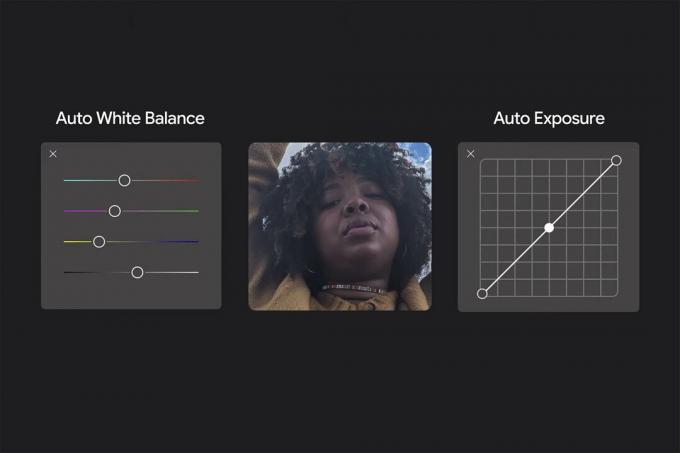

Einige der Änderungen sind etwas einfacher als andere. Durch die Optimierung der Art und Weise, wie die Algorithmen für den automatischen Weißabgleich und die automatische Belichtung Bilder verarbeiten, hat Google Die Kamera-App kann den Hautton einer Person unabhängig von der umgebenden Szene genauer darstellen.

Und anstatt einfach anzunehmen, dass „ein helleres Bild besser ist“, wie es so oft der Fall ist, kann die Tatsache berücksichtigt werden, dass es eins gibt Grund warum bestimmte Teile einer Szene diese Farbe oder diesen Ton haben. Google war Vorreiter bei der Kombination mehrerer Frames zu zusammengesetzten Fotos, und dies ist ein weiterer Bereich, in dem diese Art von Fachwissen auf eine neue Philosophie angewendet werden kann.

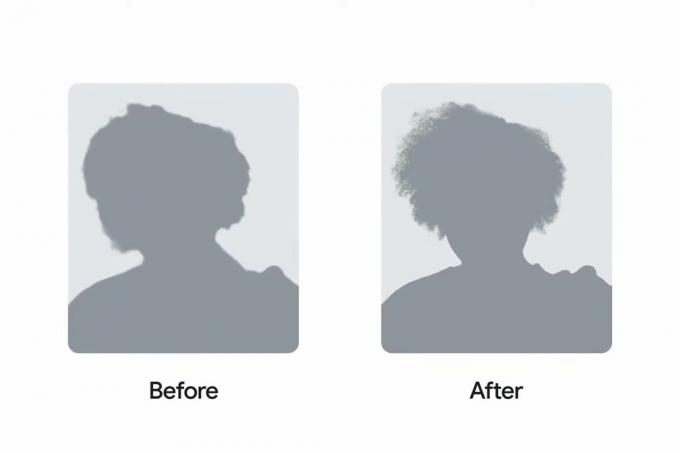

Das geht natürlich über Farbe und Helligkeit hinaus. Google konzentriert sich auch auf seine Algorithmen zur Verarbeitung verschiedener Haartypen – für Fotos, Selfies und Aufnahmen im Porträtmodus. Wir alle kennen die falschen Porträtaufnahmen, bei denen Brillen, Ohren oder Haarsträhnen abgeschnitten wurden, aber Google hat herausgefunden, dass sich dies unverhältnismäßig stark auf lockige Haartypen auswirkt. Neue Algorithmusänderungen tragen dazu bei, Haare auf natürliche Weise richtig darzustellen, anstatt sie beispielsweise künstlich zu glätten und die Definition von Locken zu verlieren.

Letztlich kommt es auf die Genauigkeit an. Wo verschiedene Telefone im Aufnahmespektrum landen genau Fotos bzw erfreulich Fotos sind eine ständige Quelle von Debatten; Aber leider wurde der Darstellung von Motiven, unabhängig von ihrer Hautfarbe oder ihren körperlichen Merkmalen, nicht ausreichend Aufmerksamkeit geschenkt. Wir können und sollten zwar über die subjektive Natur diskutieren, ob das Foto eines Parks oder einer Nachtszene das richtige Weiß hat Balance oder unnatürliche Körnung bei schwachem Licht, es sollte keine Debatte darüber geben, dass Kameraalgorithmen dies tun sollten vertreten Menschen so genau wie möglich, ohne Vorurteile.

Laut Google werden all diese und weitere Änderungen im Herbst für Pixel-Telefone verfügbar sein – vermutlich zeitgleich damit der Start des Pixel 6. Aber das ist noch nicht alles; Google wird „alles“, was es lernt, mit der ganzen Welt teilen Android Partner-Ökosystem, in der Hoffnung, dass sich weitere Unternehmen dieser Initiative anschließen.

Empfehlungen der Redaktion

- Google Pixel 8: alle aktuellen Gerüchte und was wir sehen wollen

- Ich bin gespannt auf das Google Pixel Fold, und Sie sollten es auch sein

- Hat das Google Pixel 7a einen Kopfhöreranschluss?

- Das Google Pixel Tablet ist da und es ist eine große Enttäuschung

- Kaufen Sie das Google Pixel Fold (noch) nicht

Werten Sie Ihren Lebensstil aufDigital Trends hilft Lesern mit den neuesten Nachrichten, unterhaltsamen Produktrezensionen, aufschlussreichen Leitartikeln und einzigartigen Einblicken, den Überblick über die schnelllebige Welt der Technik zu behalten.