For lidt at ændre titlen på et velkendt tv-program: Børn gør de darndeste ting. For nylig udførte forskere fra Tyskland og Storbritannien en undersøgelse, offentliggjort i tidsskriftet Videnskab robotik, der demonstrerede, i hvilket omfang børn er modtagelige for gruppepres fra robotter. TLDR-version: svaret på det gamle forældrespørgsmål: "Hvis alle dine venner fortalte dig at hoppe ud af en klippe, ville du så?" kan godt være "Sikkert. Hvis alle mine venner var robotter."

Indhold

- Er voksne virkelig så meget klogere?

- For hvert skib er der et skibsvrag

Testen genopførte et berømt eksperiment fra 1951, som var pioneret af den polske psykolog Solomon Asch. Eksperimentet demonstrerede, hvordan mennesker kan blive påvirket af presset fra gruppetænkning, selv når dette er i strid med informationer, som de ved er korrekte. I Aschs eksperimenter blev en gruppe universitetsstuderende samlet og vist to kort. Kortet til venstre viste et billede af en enkelt lodret linje. Kortet til højre viste tre linjer af forskellig længde. Eksperimentatoren spurgte derefter deltagerne, hvilken linje på det højre kort, der matchede længden af linjen vist på det venstre kort.

Anbefalede videoer

"Det særlige ved den aldersgruppe af børn er, at de stadig er i en alder, hvor de vil suspendere vantro."

Så langt, så ligetil. Hvor tingene dog blev mere lumske, var i gruppens sammensætning. Kun én person ud af gruppen var en ægte deltager, mens de andre alle var skuespillere, som havde fået at vide, hvad de skulle sige på forhånd. Eksperimentet skulle teste, om den rigtige deltager ville følge med resten af gruppen, når de enstemmigt gav det forkerte svar. Som det viste sig, ville de fleste. Gruppepres betyder, at flertallet af mennesker vil nægte information, der er klart korrekt, hvis det betyder, at de stemmer overens med flertallets holdning.

Relaterede

- Udviklende, selvreplikerende robotter er her - men du skal ikke bekymre dig om et oprør

- Robotter kommer ikke for at stjæle dit job. De kommer for at forbedre det

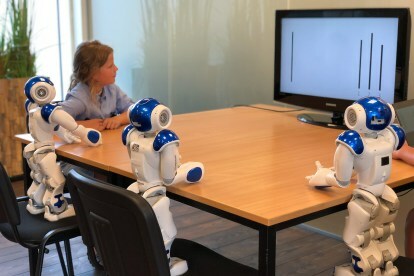

I 2018-remixet af eksperimentet blev det samme princip brugt - kun i stedet for en gruppe kammerater i collegealderen var den "rigtige deltager" et barn i alderen syv til ni år. "Skuespillerne" blev spillet af tre robotter, programmeret til at give det forkerte svar. I en prøve på 43 frivillige gav 74 procent af børnene det samme forkerte svar som robotterne. Resultaterne tyder på, at de fleste børn i denne alder vil behandle pres fra robotter på samme måde som gruppepres fra deres jævnaldrende af kød og blod.

"Det særlige ved den aldersgruppe af børn er, at de stadig er i en alder, hvor de vil suspendere vantro," Tony Belpaeme, fortalte professor i intelligente og autonome kontrolsystemer, som hjalp med at udføre undersøgelsen, til Digital Trends. "De vil lege med legetøj og stadig tro, at deres actionfigurer eller dukker er ægte; de vil stadig se på et dukketeater og virkelig tro på, hvad der sker; de tror måske stadig på [julemanden]. Det er det samme, når de ser på en robot: de ser ikke elektronik og plastik, men snarere en social karakter."

Interessant nok kontrasterede eksperimentet dette med svaret fra voksne. I modsætning til børnene blev voksne ikke påvirket af robotternes fejl. "Da en voksen så robotten give det forkerte svar, gav de den et undrende blik og gav derefter det rigtige svar," fortsatte Belpaeme.

Så intet at bekymre sig om? Så længe vi forhindrer børn i at få fingrene i robotter programmeret til at give dårlige svar, burde alt være godt, ikke? Vær ikke så hurtig.

Er voksne virkelig så meget klogere?

Som Belpaeme erkendte, var denne opgave designet til at være så enkel, at der ikke var nogen usikkerhed om, hvad svaret kunne være. Den virkelige verden er anderledes. Når vi tænker på den slags job, der let kan overdrages til maskiner, er det ofte opgaver, som vi som mennesker ikke altid er i stand til at udføre perfekt.

Denne opgave var designet til at være så enkel, at der ikke var nogen usikkerhed om, hvad svaret kunne være.

Det kan være, at opgaven er utrolig enkel, men at maskinen kan udføre den væsentligt hurtigere, end vi kan. Eller det kan være en mere kompleks opgave, hvor computeren har adgang til langt større mængder data, end vi har. Afhængigt af den potentielle virkning af det aktuelle job, er det ingen overraskelse, at mange af os ville være utilfredse med at rette en maskine.

Ville en sygeplejerske på et hospital være glad for at tilsidesætte FDA-godkendt algoritme som kan hjælpe med at prioritere patienternes sundhed ved at overvåge vitale tegn og derefter sende advarsler til medicinsk personale? Eller ville en chauffør være tryg ved at tage rattet fra en førerløs bil, når han beskæftiger sig med et særligt komplekst vejscenarie? Eller endda en pilot, der tilsidesætter autopiloten, fordi de mener, at den forkerte beslutning bliver truffet? I alle disse tilfælde vil vi gerne tro, at svaret er "ja". Men af alle mulige årsager er det måske ikke virkeligheden.

Nicholas Carr skriver om dette i sin bog fra 2014 Glasburet: Hvor automatiseringen tager os. Den måde han beskriver det på understreger den slags tvetydighed, som sager om automatisering i det virkelige liv involverer, hvor problemerne er langt mere kompleks end længden af en linje på et kort, maskinerne er meget smartere, og resultatet er potentielt mere afgørende.

"Hvordan måler man omkostningerne ved en udhuling af indsats og engagement, eller en aftagende handlefrihed og autonomi eller en subtil forringelse af færdigheder? Det kan du ikke,« skriver han. "Det er den slags skyggefulde, uhåndgribelige ting, som vi sjældent sætter pris på, før efter de er væk, og selv da kan vi have problemer med at udtrykke tabene i konkrete termer."

"Det er den slags skyggefulde, uhåndgribelige ting, som vi sjældent sætter pris på, før de er væk."

Sociale robotter af den slags, som Belpaeme teoretiserer om i forskningspapiret, er endnu ikke mainstream, men der er allerede illustrationer af nogle af disse gåder i aktion. For eksempel åbner Carr sin bog med omtale af et notat fra Federal Aviation Administration, som bemærkede, hvordan piloter skulle bruge mindre tid på at flyve på autopilot på grund af de risici, dette indebar. Dette var baseret på analyse af nedbrudsdata, der viste, at piloter ofte stoler for meget på computeriserede systemer.

En lignende sag involverede en retssag fra 2009, hvor en kvinde ved navn Lauren Rosenberg anlagde sag mod Google efter at være blevet rådet til at gå ad en rute, der gik ud i farlig trafik. Selvom sagen blev smidt ud af retten, viser den, at folk vil tilsidesætte deres egen sunde fornuft i den tro, at maskinintelligens har mere intelligens, end vi har.

For hvert skib er der et skibsvrag

I sidste ende, som Belpaeme erkender, er problemet, at nogle gange ønsker vi at overlade beslutningstagningen til maskiner. Robotter lover at udføre de opgaver, der er kedelige, beskidte og farlige - og hvis vi skal gætte enhver beslutning, er de ikke rigtig de arbejdsbesparende enheder, der er blevet lovet. Hvis vi i sidste ende skal invitere robotter ind i vores hjem, vil vi gerne have, at de kan handle selvstændigt, og det vil involvere en vis grad af tillid.

“Robotter, der udøver socialt pres på dig, kan være en god ting; det behøver ikke at være uhyggeligt,” fortsatte Belpaeme. ”Hvis du har robotter brugt i sundhedsvæsenet eller uddannelsen, vil du gerne have, at de kan påvirke dig. For eksempel, hvis du ønsker at tabe dig, kan du få en vægttabsrobot i to måneder, hvilket skærme dit kalorieindtag og opmuntrer dig til at dyrke mere motion. Du vil have, at sådan en robot skal være overbevisende og påvirke dig. Men enhver teknologi, der kan bruges til det gode, kan også bruges til det onde."

Hvad er svaret på dette? Spørgsmål som dette vil blive drøftet fra sag til sag. Hvis det dårlige i sidste ende opvejer det gode, vil teknologi som sociale robotter aldrig tage fart. Men det er vigtigt, at vi tager de rigtige erfaringer fra undersøgelser som den om robot-induceret gruppepres. Og det er ikke det faktum, at vi er så meget klogere end børn.

Redaktørens anbefalinger

- Fremtiden for automatisering: Robotter kommer, men de vil ikke tage dit job

- Disse robotter river ukrudt ihjel, så landmændene ikke behøver kemiske herbicider