Trochu upravit název známého televizního pořadu: Děti dělají ty nejstrašnější věci. Nedávno provedli výzkumníci z Německa a Spojeného království studii, zveřejněno v časopise Vědecká robotika, která prokázala, do jaké míry jsou děti náchylné k tlaku robotů. Verze TLDR: odpověď na starou rodičovskou otázku: „Kdyby vám všichni vaši přátelé řekli, abyste skočili z útesu, udělali byste to? může být „Jistě. Kdyby všichni moji přátelé byli roboti."

Obsah

- Opravdu jsou dospělí o tolik chytřejší?

- Pro každou loď existuje vrak

Test zopakoval slavný experiment z roku 1951, jehož průkopníkem byl polský psycholog Solomon Asch. Experiment ukázal, jak mohou být lidé ovlivněni tlaky skupinového myšlení, i když to naráží na informace, o nichž vědí, že jsou správné. V Aschových experimentech byla shromážděna skupina vysokoškolských studentů a ukázala jim dvě karty. Na kartě vlevo byl zobrazen obrázek jedné svislé čáry. Na kartě vpravo byly zobrazeny tři řádky různé délky. Experimentátor se poté zeptal účastníků, která čára na pravé kartě odpovídá délce čáry zobrazené na levé kartě.

Doporučená videa

"Zvláštní na tomto věkovém rozmezí dětí je to, že jsou stále ve věku, kdy přestanou věřit."

Zatím tak přímočaré. Tam, kde se věci staly složitější, však bylo složení skupiny. Pouze jedna osoba ze skupiny byla skutečným účastníkem, zatímco ostatní byli všichni herci, kterým bylo předem řečeno, co mají říci. Experiment měl otestovat, zda by skutečný účastník souhlasil se zbytkem skupiny, pokud by jednomyslně odpověděli špatně. Jak se ukázalo, většina ano. Tlak vrstevníků znamená, že většina lidí bude popírat informace, které jsou jasně správné, pokud to znamená přizpůsobit se většinovému názoru.

Příbuzný

- Vyvíjející se, samoreprodukující se roboti jsou tady – ale nebojte se povstání

- Roboti nepřijdou ukrást vaši práci. Přijdou to zlepšit

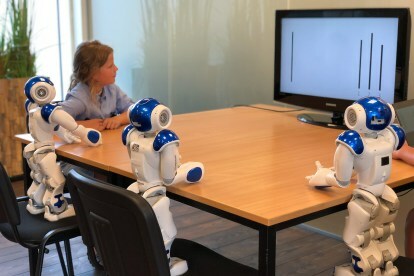

V remixu experimentu z roku 2018 byl použit stejný princip – pouze místo skupiny vysokoškolských vrstevníků bylo „skutečným účastníkem“ dítě ve věku sedm až devět let. „Herce“ hráli tři roboti, naprogramovaní tak, aby dávali špatnou odpověď. Ve vzorku 43 dobrovolníků uvedlo 74 procent dětí stejnou nesprávnou odpověď jako roboti. Výsledky naznačují, že většina dětí tohoto věku bude s tlakem robotů zacházet stejně jako s tlakem vrstevníků ze strany svých vrstevníků z masa a kostí.

"Zvláštní na tomto věkovém rozmezí dětí je to, že jsou stále ve věku, kdy přestanou věřit," Tony Belpaeme, profesor inteligentních a autonomních řídicích systémů, který pomohl provést studii, řekl Digital Trends. „Budou si hrát s hračkami a stále věřit, že jejich akční figurky nebo panenky jsou skutečné; stále se budou dívat na loutkové divadlo a skutečně věřit tomu, co se děje; mohou stále věřit v [Santa Clause]. Je to stejné, když se dívají na robota: nevidí elektroniku a plasty, ale spíše sociální charakter.“

Je zajímavé, že experiment to kontrastoval s odpovědí dospělých. Na rozdíl od dětí se dospělí nenechali ovlivnit chybami robotů. "Když dospělý viděl robota, jak dává špatnou odpověď, vrhl na něj zmatený pohled a pak odpověděl správně," pokračoval Belpaeme.

Takže se není čeho bát? Dokud zabráníme dětem dostat do rukou roboty naprogramované tak, aby dávali špatné odpovědi, všechno by mělo být v pořádku, ne? Nebuď tak rychlý.

Opravdu jsou dospělí o tolik chytřejší?

Jak Belpaeme uznal, tento úkol byl navržen tak, aby byl tak jednoduchý, že neexistovala žádná nejistota, jaká by mohla být odpověď. Skutečný svět je jiný. Když přemýšlíme o druzích prací, které lze snadno předat strojům, často se jedná o úkoly, které nejsme jako lidé vždy schopni provést dokonale.

Tento úkol byl navržen tak, aby byl tak jednoduchý, že neexistovala žádná nejistota ohledně odpovědi.

Je možné, že úkol je neuvěřitelně jednoduchý, ale že ho stroj dokáže provést výrazně rychleji než my. Nebo to může být složitější úkol, při kterém má počítač přístup k mnohem většímu množství dat než my. V závislosti na potenciálním dopadu dané práce není žádným překvapením, že mnozí z nás by nebyli spokojeni s opravou stroje.

Byla by sestra v nemocnici ráda, kdyby to zrušila? Algoritmus schválený FDA které mohou pomoci stanovit priority týkající se zdraví pacientů sledováním životních funkcí a následným zasíláním výstrah zdravotnickému personálu? Nebo by řidiči vyhovovalo převzít volant z auta bez řidiče, když řeší obzvlášť složitý scénář? Nebo dokonce pilot vyřadí autopilota, protože si myslí, že bylo učiněno špatné rozhodnutí? Ve všech těchto případech bychom si rádi mysleli, že odpověď je „ano“. Ze všech možných důvodů to však nemusí být realita.

Nicholas Carr o tom píše ve své knize z roku 2014 Skleněná klec: Kam nás zavádí automatizace. Způsob, jakým to popisuje, podtrhuje druh nejednoznačnosti, kterou zahrnují skutečné případy automatizace, kde jsou problémy mnohem složitější než délka řádku na kartě, stroje jsou mnohem chytřejší a výsledek je potenciálně více rozhodující.

„Jak změříte náklady na erozi úsilí a angažovanosti nebo ochabnutí svobody jednání a autonomie nebo jemné zhoršení dovedností? Nemůžeš,“ píše. "Jsou to ty druhy stínových, nehmotných věcí, které jen zřídka oceníme, dokud nezmizí, a i tak můžeme mít problém vyjádřit ztráty v konkrétních termínech."

"Jsou to druhy temných, nehmotných věcí, které jen zřídka oceníme, dokud nezmizí."

Sociální roboti toho druhu, o kterém Belpaeme ve své výzkumné práci teoretizuje, ještě nejsou mainstreamem, ale již existují příklady některých z těchto hlavolamů v praxi. Například Carr otevírá svou knihu zmínkou o zprávě Federálního úřadu pro letectví, která uvádí, jak by piloti měli trávit méně času létáním na autopilota kvůli rizikům, která to představuje. To bylo založeno na analýze dat o nehodách, která ukázala, že piloti často příliš spoléhají na počítačové systémy.

Podobný případ se týkal soudního sporu z roku 2009, ve kterém byla žena jménem Lauren Rosenberg podal žalobu na Google poté, co mu bylo doporučeno jít po trase, která vedla do nebezpečného provozu. I když byl případ shozen před soud, ukazuje, že lidé potlačí svůj vlastní zdravý rozum ve víře, že strojová inteligence má více inteligence než my.

Pro každou loď existuje vrak

Nakonec, jak uznává Belpaeme, problém je v tom, že někdy chceme rozhodování předat strojům. Roboti slib, že bude dělat práce, které jsou nudné, špinavé a nebezpečné – a pokud musíme každé rozhodnutí odhadnout, ve skutečnosti to nejsou zařízení na úsporu práce, která byla slíbena. Pokud se nakonec chystáme pozvat roboty do našeho domova, budeme chtít, aby byli schopni jednat autonomně, a to bude vyžadovat určitou úroveň důvěry.

„Roboti, kteří na vás vyvíjejí společenský tlak, mohou být dobrá věc; nemusí to být zlověstné,“ pokračoval Belpaeme. „Pokud máte roboty používané ve zdravotnictví nebo školství, chcete, aby vás mohli ovlivňovat. Například, pokud chcete zhubnout, můžete dostat robota na hubnutí na dva měsíce, který monitory váš příjem kalorií a povzbudí vás k většímu pohybu. Chcete, aby byl takový robot přesvědčivý a ovlivnil vás. Ale každá technologie, která může být použita pro dobro, může být také použita pro zlo."

jaká je na to odpověď? O takových otázkách se bude diskutovat případ od případu. Pokud to špatné nakonec převáží to dobré, technologie jako sociální roboti nikdy nevzlétnou. Je však důležité, abychom si ze studií, jako je ta o tlaku vrstevníků vyvolaném roboty, vzali správná ponaučení. A nejde o to, že jsme o tolik chytřejší než děti.

Doporučení redakce

- Budoucnost automatizace: Roboti přicházejí, ale nevezmou vám práci

- Tito roboti tasují plevel k smrti, takže farmáři nepotřebují chemické herbicidy