ChatGPT exploduje a páteř jeho modelu AI spoléhá na grafické karty Nvidia. Řekl jeden analytik k trénování ChatGPT bylo použito kolem 10 000 GPU Nvidia a jak se služba neustále rozšiřuje, roste i potřeba GPU. Každý, kdo zažil vzestup kryptoměn v roce 2021, může cítit a nedostatek GPU na horizontu.

Obsah

- Proč jsou GPU Nvidia stavěny pro umělou inteligenci

- Všechno se to ukládá do paměti

- Jiné potřeby, různé formy

Viděl jsem několik reportérů, kteří vytvořili toto přesné spojení, ale je to zavádějící. Dny nedostatku GPU řízeného kryptoměnami jsou za námi. I když pravděpodobně uvidíme nárůst poptávky grafické karty jak AI pokračuje v rozmachu, tato poptávka není zaměřena na nejlepší grafické karty nainstalovaný v herní soupravy.

Doporučená videa

Proč jsou GPU Nvidia stavěny pro umělou inteligenci

Nejprve se budeme zabývat tím, proč Nvidia

Příbuzný

- Wix používá ChatGPT, který vám pomůže rychle vytvořit celý web

- Tvůrce ChatGPT OpenAI čelí vyšetřování FTC kvůli zákonům na ochranu spotřebitele

- Funkce procházení Bing ChatGPT je deaktivována kvůli chybě v přístupu k paywallu

CUDA je aplikační programovací rozhraní (API) společnosti Nvidia, které se používá ve všem, od nejdražších GPU datových center až po nejlevnější herní GPU. Akcelerace CUDA je podporována v knihovnách strojového učení, jako je TensorFlow, což výrazně urychluje trénink a odvození. CUDA je hnací silou AMD je v AI tak pozadu ve srovnání s Nvidií.

Nezaměňujte však CUDA s jádry CUDA společnosti Nvidia. CUDA je platforma, na které běží spousta aplikací AI, zatímco jádra CUDA jsou jen jádra uvnitř GPU Nvidia. Sdílejí název a jádra CUDA jsou lépe optimalizována pro spouštění aplikací CUDA. Herní GPU Nvidia mají jádra CUDA a podporují aplikace CUDA.

Tensor jádra jsou v podstatě vyhrazená jádra AI. Zvládají násobení matic, což je tajná omáčka, která urychluje trénink AI. Myšlenka je zde jednoduchá. Násobte více sad dat najednou a trénujte modely umělé inteligence exponenciálně rychleji generováním možných výsledků. Většina procesorů zpracovává úkoly lineárním způsobem, zatímco jádra Tensor mohou rychle generovat scénáře v jediném hodinovém cyklu.

Opět platí, že herní GPU společnosti Nvidia mají rádi RTX 4080 mají jádra Tensor (a někdy dokonce více než drahé GPU datových center). Nicméně, pro všechny specifikace, které mají karty Nvidia urychlit modely AI, žádná z nich není tak důležitá jako paměť. A herní GPU Nvidia nemají moc paměti.

Všechno se to ukládá do paměti

„Velikost paměti je nejdůležitější,“ říká Jeffrey Heaton, autor několika knih o umělé inteligenci a profesor na Washingtonské univerzitě v St. Louis. „Pokud nemáte dostatek GPU

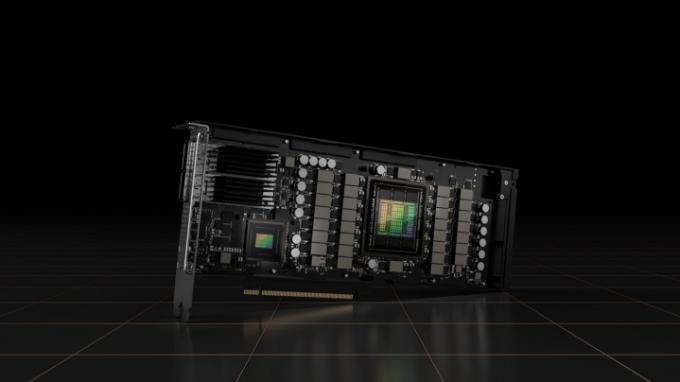

Heaton, kdo má kanál YouTube věnovaný tomu, jak dobře modely AI běží na určitých GPU, poznamenal, že jádra CUDA jsou také důležitá, ale kapacita paměti je dominantním faktorem, pokud jde o to, jak GPU funguje pro AI. The RTX 4090 má podle herních standardů spoustu paměti – 24 GB GDDR6X – ale velmi málo ve srovnání s GPU třídy datových center. Například nejnovější GPU H100 od Nvidie má 80 GB paměti HBM3 a také masivní 5 120bitovou paměťovou sběrnici.

Vystačíte si s méně, ale stále potřebujete hodně paměti. Heaton doporučuje začátečníkům, aby neměli méně než 12 GB, zatímco typický inženýr strojového učení bude mít jednoho nebo dva profesionály s kapacitou 48 GB. GPU Nvidia. Podle Heatona „většina pracovních zátěží bude spadat spíše do řady A100 až osmi A100“. GPU Nvidia A100 má 40 GB Paměť.

Toto škálování můžete vidět také v akci. Puget Systems ukazuje jediný A100 se 40 GB paměti, který pracuje přibližně dvakrát rychleji než jeden RTX 3090 s 24 GB paměti. A to navzdory skutečnosti, že RTX 3090 má téměř dvakrát tolik jader CUDA a téměř tolik jader Tensor.

Úzkým hrdlem je paměť, nikoli surová zpracovatelská síla. Je to proto, že trénovací modely umělé inteligence se spoléhají na velké datové sady a čím více těchto dat můžete uložit do paměti, tím rychleji (a přesněji) můžete model trénovat.

Jiné potřeby, různé formy

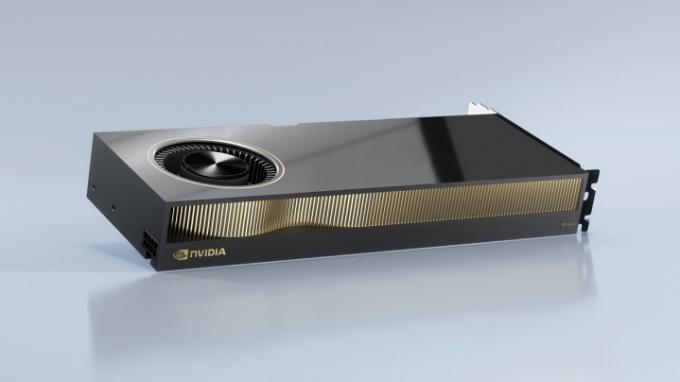

Herní GPU Nvidia obecně nejsou vhodné pro AI kvůli tomu, jak malou videopaměť mají ve srovnání s hardwarem podnikové třídy, ale je zde také samostatný problém. GPU pracovní stanice Nvidia obvykle nesdílejí kostku GPU se svými herními kartami.

Například A100, který Heaton zmiňuje, používá GPU GA100, což je kostka z řady Ampere od Nvidie, která nebyla nikdy použita na kartách zaměřených na hry (včetně špičkových RTX 3090 Ti). Podobně nejnovější H100 od Nvidie používá zcela odlišnou architekturu než řada RTX 40, což znamená, že používá také jinou matrici.

Existují výjimky. GPU Nvidia AD102, který je uvnitř RTX 4090 a RTX 4080, se také používá v malé řadě podnikových GPU Ada Lovelace (L40 a RTX 6000). Ve většině případů však Nvidia nemůže pouze znovu použít herní GPU pro kartu datového centra. Jsou to oddělené světy.

Mezi nedostatkem GPU, který jsme viděli kvůli těžbě kryptoměn, a nárůstem popularity modelů AI jsou některé zásadní rozdíly. Podle Heatona model GPT-3 vyžadoval více než 1 000 GPU A100 Nvidia pro vlaky a asi osm pro provoz. Tyto GPU mají také přístup k vysokorychlostnímu propojení NVLink, zatímco GPU řady Nvidia RTX 40 ne. Porovnává maximálně 24 GB paměti na herních kartách Nvidia s několika stovkami na GPU, jako je A100 s NVLink.

Existují i další obavy, jako je alokace paměťových karet pro profesionální GPU před herními, ale dny, kdy jste spěchali do místního Micro Center nebo Best Buy, abyste našli GPU na skladě, jsou pryč. Heaton to hezky shrnul: „Odhaduje se, že velké jazykové modely, jako je ChatGPT, vyžadují ke svému běhu alespoň osm GPU. Takové odhady předpokládají špičkové GPU A100. Moje spekulace je, že by to mohlo způsobit nedostatek GPU vyšší třídy, ale nemusí to mít vliv na GPU třídy hráčů, protože

Doporučení redakce

- Špičkoví autoři požadují od firem zabývajících se umělou inteligencí platby za použití jejich díla

- Google Bard nyní umí mluvit, ale dokáže přehlušit ChatGPT?

- Návštěvnost webu ChatGPT poprvé klesla

- 81 % si myslí, že ChatGPT je bezpečnostní riziko, zjistil průzkum

- Konkurent společnosti Apple ChatGPT za vás může automaticky napsat kód

Upgradujte svůj životní stylDigitální trendy pomáhají čtenářům mít přehled o rychle se měnícím světě technologií se všemi nejnovějšími zprávami, zábavnými recenzemi produktů, zasvěcenými úvodníky a jedinečnými náhledy.