Прогнозна поліція мав змінити спосіб здійснення поліцейської діяльності, перевівши нас у світ розумного права правозастосування, в якому було усунено упередженість і поліція могла б реагувати на дані, а не на передчуття. Але через десятиліття після того, як більшість із нас уперше почули термін «прогнозна поліцейська діяльність», здається, зрозуміло, що він не спрацював. У зв’язку з негативною реакцією громадськості ця технологія переживає значний спад у використанні порівняно з кількома роками тому.

Зміст

- Обіцянка прогностичного контролю

- Дискримінаційні алгоритми

- Небезпека брудних даних

- Невизначене майбутнє інтелектуальної поліції

- Неправильні інструменти для роботи?

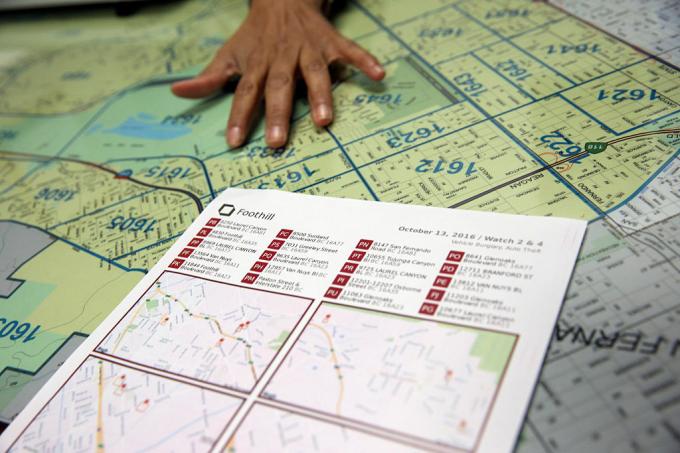

У квітні цього року Лос-Анджелес — який, за словами LA Times, «першопрохідцем у прогнозуванні злочинів за допомогою даних» — скоротив фінансування своєї програми прогнозування поліції, звинувативши в цьому витрати. "Це важке рішення", - сказав начальник поліції Мішель Мур сказав LA Times. «Це стратегія, яку ми використовували, але прогнозовані витрати на сотні тисяч доларів тепер замість того, щоб знайти ці гроші та спрямувати ці гроші на інші більш важливі види діяльності, це те, що я маю зробити».

Рекомендовані відео

Що пішло не так? Як те, що рекламується як «розумна» технологія, може призвести до подальшого закріплення упереджень і дискримінації? І чи є мрія про передбачливу поліцію такою, яку можна налаштувати за допомогою правильного алгоритму, чи це глухий кут у більш справедливому суспільстві, яке зараз бореться з тим, як має працювати поліція?

Обіцянка прогностичного контролю

Інтелектуальна поліцейська діяльність у її нинішньому вигляді бере свій початок близько десяти років із публікації психолога Колін МакК’ю та начальника поліції Лос-Анджелеса Чарлі Бека в 2009 році під назвою «Прогнозна поліцейська діяльність: чого ми можемо навчитися у Walmart і Amazon про боротьбу зі злочинністю під час рецесії?У статті вони схопилися за те, як великі дані використовуються великими роздрібними торговцями, щоб допомогти виявити моделі минулої поведінки клієнтів, які можна використовувати для прогнозування майбутньої поведінки. Завдяки прогресу в обчислювальній техніці та зборі даних МакК’ю та Бек припустили, що можна збирати й аналізувати дані про злочини в реальному часі. Потім ці дані можна використовувати для передбачення, запобігання та більш ефективного реагування на злочини, які ще не відбулися.

З тих пір у багатьох частинах Сполучених Штатів, як і в усьому світі, інтелектуальна поліцейська діяльність перетворилася з одноразової ідеї на реальність. У процесі вона має намір змінити поліцейську діяльність із реактивної сили на проактивну; спираючись на деякі прориви в технології керування даними, які дозволяють виявляти закономірності в режимі реального часу — і діяти відповідно до них.

«Існує дві основні форми інтелектуальної поліцейської діяльності», Ендрю Фергюсон, професор права Університету округу Колумбія Девід А. Школа права Кларка та автор Розвиток поліцейської діяльності з використанням великих даних: стеження, раса та майбутнє правоохоронних органів, розповіли Digital Trends. «[Це] інтелектуальна поліція на основі місця та інтелектуальна поліція на основі особи».

В обох випадках інтелектуальна поліцейська система призначає оцінку ризику відповідній особі чи місцю, що спонукає поліцію до подальших дій через певний проміжок часу. Перший із цих підходів, передбачувана поліцейська діяльність на місці, зосереджується переважно на поліцейських патрулях. Це передбачає використання карти злочинності та аналітику ймовірних місць майбутніх злочинів на основі попередньої статистики.

Замість того, щоб допомогти позбутися таких проблем, як расизм та інші системні упередження, інтелектуальна поліцейська діяльність може насправді допомогти їх закріпити.

Другий підхід зосереджений на передбаченні ймовірності того, що особа представляє потенційний майбутній ризик. Наприклад, у 2013 році начальник поліції Чикаго був направлений до будинку 22-річного Роберта МакДеніела. який був позначений як потенційний ризик або винуватець насильства з використанням зброї в центрі міста Чикаго алгоритм. «Список тепла», який допоміг скласти алгоритм, шукав шаблони, які могли б передбачити майбутніх злочинців або жертви, навіть якщо вони самі не робили нічого, що вимагало б такого розгляду, окрім відповідності a профіль.

Як Відзначає Chicago Tribune: «Стратегія передбачає індивідуальне попередження осіб, які перебувають на гарячому, про подальшу злочинну діяльність, навіть за найдрібніші правопорушення призведе до застосування повної сили закону їх».

Мрія передбачуваної поліцейської діяльності полягала в тому, що, діючи на основі кількісно виміряних даних, вона зробить поліцейську діяльність не тільки більш ефективною, але й менш схильною до здогадів і, як наслідок, упередженості. Прихильники стверджували, що це змінить поліцейську діяльність на краще та започаткує нову еру розумної поліцейської діяльності. Проте майже з самого початку прогностична поліцейська діяльність мала різких критиків. Вони стверджують, що замість того, щоб допомогти позбутися таких проблем, як расизм та інші системні упередження, прогностична поліцейська діяльність може насправді допомогти їх закріпити. І важко сперечатися, що вони не мають сенсу.

Дискримінаційні алгоритми

Ідея про те, що інтелектуальні поліцейські системи на основі машинного навчання можуть навчитися розрізняти на основі таких факторів, як раса, не нова. Інструменти машинного навчання навчаються величезними масивами даних. І до тих пір, поки ці дані збираються системою, в якій раса продовжує бути переважаючим фактором, це може призвести до дискримінації.

Як Рената М. О’Доннелл пише в статті за 2019 рік під назвою «Виклик расистським прогнозованим алгоритмам поліцейської діяльності відповідно до положення про рівний захист,» алгоритми машинного навчання навчаються на даних, отриманих від системи правосуддя, в якій «темношкірі американці ув’язнені в державних в’язницях зі швидкістю це в 5,1 разів більше, ніж ув’язнення білих, і кожен третій темношкірий чоловік, народжений сьогодні, може розраховувати потрапити до в’язниці протягом свого життя, якщо сучасні тенденції продовжувати».

«Дані необ’єктивні», — сказав Фергюсон Digital Trends. «Ми просто зведені до двійкового коду. Системи, що керуються даними, які працюють у реальному світі, не є більш об’єктивними, чесними чи неупередженими, ніж реальний світ. Якщо ваш реальний світ є структурно нерівним або расово дискримінаційним, система, що керується даними, відображатиме ці суспільні нерівності. Вхідні дані заплямовані упередженістю. Аналіз заплямований упередженістю. І механізми поліцейської влади не змінюються лише тому, що є технологія, яка керує системами».

Фергюсон наводить приклад арештів як одного, здавалося б, об'єктивного фактора прогнозування ризику. Однак арешти будуть спотворені розподілом ресурсів поліції (наприклад, де вони патрулюють) і видами злочинів, які зазвичай вимагають арештів. Це лише одна ілюстрація потенційно проблемних даних.

Небезпека брудних даних

Відсутні та неправильні дані іноді називають «брудними даними». А Стаття 2019 року дослідників з Інституту ім. А.І. Нині Інститут Нью-Йоркського університету розширює цей термін, щоб також позначати дані, на які впливає корупція, упередженість і незаконність практики — незалежно від того, чи це навмисне маніпулювання, спотворене окремими та суспільні упередження. Це може, наприклад, включати дані, отримані в результаті арешту невинної особи, якій підкинули докази або яку іншим чином фальшиво звинуватили.

Є певна іронія в тому, що за останні десятиліття вимоги суспільства даних, у якому все залежить від кількісного визначення та чітких чисельних цілей, щойно призвело до купи… ну, справді погані дані. Серіал HBO Провід продемонстрував реальний феномен «перевірки статистики», і роки, що минули після того, як шоу вийшло в ефір, запропонували багато приклади справжнього системного маніпулювання даними, підроблених поліцейських звітів і неконституційних дій, через які невинних людей в'язниця.

Погані дані, які дозволяють людям при владі штучно вражати цілі, це одне. Але поєднайте це з алгоритмами та прогнозними моделями, які використовують це як основу для моделювання світу, і ви потенційно отримаєте щось набагато гірше.

Дослідники продемонстрували, як сумнівні дані про злочини, підключені до алгоритмів прогностичного контролю, можуть створити те, що називається «петлі зворотного зв'язку”, у якому поліція неодноразово відправляється в ті самі райони, незалежно від справжнього рівня злочинності. Один із співавторів цієї статті, інформатик Суреш Венкатасубраманян, каже, що моделі машинного навчання можуть створювати хибні припущення через їх моделювання. Подібно до старої приказки про те, що для людини з молотком кожна проблема виглядає як цвях, ці системи моделюють лише певні елементи проблеми — і уявіть лише один можливий результат.

«[Щось, що] не розглядається в цих моделях, це те, якою мірою ви моделюєте той факт, що закидання більшої кількості поліцейських у територію насправді може погіршує якість життя людей, які там живуть?» Венкатасубраманян, професор Школи обчислювальної техніки Університету Юти, розповів Digital Тенденції. «Ми припускаємо, що більше поліцейських — це краще. Але, як ми зараз бачимо, наявність більшої кількості поліції – це не обов’язково добре. Це насправді може погіршити ситуацію. У жодній моделі, яку я коли-небудь бачив, ніхто ніколи не запитував, яка ціна розміщення більшої кількості поліції на території».

Невизначене майбутнє інтелектуальної поліції

Ті, хто працює в поліцейській поліцейській сфері з прогнозуванням, іноді без іронії вживають термін «звіт про меншини», щоб позначити тип прогнозу, який вони роблять. Термін часто вживається як посилання на Однойменний фільм 2002 року, який, у свою чергу, був заснований на оповіданні 1956 року Філіпа К. Дік. в Звіт меншості, спеціальний підрозділ поліції PreCrime затримує злочинців на основі передбачення злочинів, які будуть скоєні в майбутньому. Ці прогнози надають три екстрасенси, які називаються «прогнозами».

Але поворот в Звіт меншості полягає в тому, що прогнози не завжди точні. Різні бачення одного з провізорів забезпечують альтернативне бачення майбутнього, яке пригнічується через страх, що система може здатися негідною.

Внутрішні аудити, які показують, що тактика не спрацювала. Прогнозні списки не тільки були недосконалими, але й неефективними.

Прямо зараз у поліцейської діяльності з прогнозуванням чекає власне невизначене майбутнє. Поряд із новими технологіями, такими як розпізнавання обличчя, технологія, доступна правоохоронним органам для можливого використання, ніколи не була такою потужною. У той же час усвідомлення використання інтелектуальної поліцейської служби викликало негативну реакцію громадськості, яка, можливо, допомогла скасувати її. Фергюсон сказав Digital Trends, що використання інтелектуальних інструментів контролю за останні кілька років було на «спаді».

«У своєму зеніті [прогностична поліцейська робота на місці] була в понад 60 великих містах і зростала, але в результаті успішної організації спільноти, її значною мірою скорочено та/або замінено іншими формами керованих даними аналітика", - сказав він. «Коротше кажучи, термін прогностична поліція став токсичним, і поліцейські департаменти навчилися перейменовувати те, що вони робили з даними. Прогностична поліцейська діяльність, орієнтована на людину, зазнала різкішого падіння. Два головних міста, які інвестували в його створення, — Чикаго та Лос-Анджелес — відмовилися від індивідуальної підтримки стратегії після різкої критики спільноти та нищівних внутрішніх перевірок, які показують, що тактика не працювати. Прогнозні списки були не лише недосконалими, але й неефективними».

Неправильні інструменти для роботи?

однак, Рашида Річардсон, директор політичних досліджень Інституту ім. Зараз Інститут сказав, що використання цієї технології є занадто непрозорим. «Ми досі не знаємо через відсутність прозорості щодо державного придбання технологій та багатьох інших лазівки в існуючих процедурах закупівель, які можуть захистити певні закупівлі технологій від громадського контролю», вона сказала. Вона наводить приклад технологій, які можуть бути надані поліцейському відділу безкоштовно або придбані третьою стороною. «Ми знаємо з таких досліджень, як моє, і з повідомлень ЗМІ, що багато найбільших поліцейських департаментів США використовували технологія в якийсь момент, але є також багато невеликих відділень поліції, які використовують її або використовували протягом обмеженого періоду часу часу."

З огляду на поточне запитання про роль поліції, чи буде спокуса знову обійняти інтелектуальна поліція як інструмент для прийняття рішень на основі даних — можливо, у менш антиутопічній науковій фантастиці брендинг? Існує ймовірність того, що таке відродження може виникнути. Але Венкатасубраманіан дуже скептично налаштований щодо того, що машинне навчання, яке зараз практикується, є правильним інструментом для роботи.

«Машинне навчання в цілому та його успіх у сучасному суспільстві базується на передумові, що незалежно від того, що насправді проблема, зрештою, зводиться до збору даних, створення моделі, прогнозування результату — і вам не потрібно турбуватися про домен», він сказав. «Ви можете написати той самий код і застосувати його в 100 різних місцях. Це обіцянка абстракції та портативності. Проблема полягає в тому, що коли ми використовуємо те, що люди називають соціотехнічними системами, де люди й технології переплітаються в складні хвилі, ви не можете цього зробити. Ви не можете просто підключити шматок і очікувати, що він запрацює. Тому що [існують] хвильові ефекти, якщо вставити цей шматок і той факт, що вони різні гравці з різними планами в такій системі, і вони підривають систему під свої власні потреби різні шляхи. Усі ці речі слід враховувати, коли ви говорите про ефективність. Так, можна сказати абстрактно, що все буде працювати нормально, але там є немає анотації. Є лише контекст, у якому ви працюєте».