ต้องการทราบชื่อดอกไม้หรือนกที่คุณพบระหว่างเดินเล่นในสวนสาธารณะหรือไม่? เร็วๆ นี้ Google Assistant จะสามารถบอกคุณได้โดยใช้กล้องและปัญญาประดิษฐ์

วิดีโอแนะนำ

Google เริ่มต้นปี 2560 อย่างก้าวกระโดด การประชุม I/O เกี่ยวกับ AI และการเรียนรู้ของเครื่อง และเทคโนโลยีคอมพิวเตอร์วิทัศน์หนึ่งที่ไฮไลต์คือ Google Lens ซึ่งช่วยให้ กล้องไม่เพียงแต่ถ่ายภาพเท่านั้น แต่ยังให้บริบทเกี่ยวกับสิ่งที่คุณกำลังมองเห็นได้ดียิ่งขึ้น

กำลังมา ผู้ช่วยของ Google และ Google รูปภาพเทคโนโลยี Google Lens สามารถ "เข้าใจสิ่งที่คุณกำลังดูและช่วยให้คุณดำเนินการได้" Sundar Pichai ซีอีโอของ Google กล่าวในระหว่างการกล่าวสุนทรพจน์ ตัวอย่างเช่น หากคุณเล็งกล้องไปที่กระโจมสถานที่จัดคอนเสิร์ต Google Assistant จะสามารถบอกคุณเพิ่มเติมเกี่ยวกับสิ่งนั้นได้ นักแสดงและเล่นเพลงช่วยคุณซื้อตั๋วเข้าชมการแสดงและเพิ่มลงในปฏิทินของคุณ ทั้งหมดนี้ทำได้ภายใน แอพเดียว

เมื่อกล้องชี้ไปที่วัตถุที่ไม่คุ้นเคย Google Assistant จะสามารถบอกคุณได้ว่าสิ่งนั้นคืออะไรผ่านการจดจำรูปภาพ ชี้ไปที่ป้ายร้าน และใช้ข้อมูลสถานที่ตั้งเพื่อให้ข้อมูลที่มีความหมายเกี่ยวกับธุรกิจแก่คุณได้ ทั้งหมดนี้สามารถทำได้ผ่านการโต้ตอบด้วยเสียงที่ผู้ใช้มีกับ Assistant

“คุณสามารถชี้โทรศัพท์ของคุณไปที่มัน แล้วเราจะทำงานหนักให้คุณโดยอัตโนมัติ” พิชัยกล่าว

ด้วย Google Lens ของคุณ สมาร์ทโฟน กล้องจะไม่เพียงแค่เห็นสิ่งที่คุณเห็น แต่จะเข้าใจสิ่งที่คุณเห็นเพื่อช่วยให้คุณดำเนินการได้ #io17pic.twitter.com/viOmWFjqk1

— กูเกิล (@Google) 17 พฤษภาคม 2017

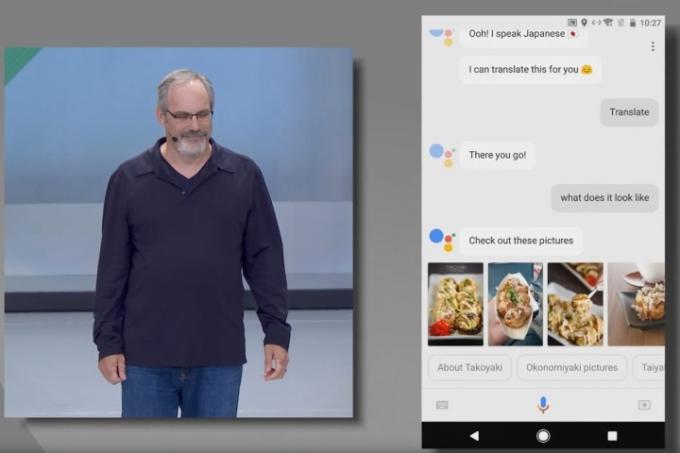

หากคุณใช้แอปแปลภาษาของ Google คุณคงได้เห็นแล้วว่าเทคโนโลยีทำงานอย่างไร: วางกล้องไว้เหนือข้อความ จากนั้นแอปจะแปลเป็นภาษาที่คุณเข้าใจ ใน Google Assistant นั้น Google Lens จะดำเนินการต่อไป ในการสาธิต Google ได้แสดงให้เห็นว่า

เทคโนโลยีการจดจำรูปภาพไม่ใช่เรื่องใหม่ แต่ Google Lens แสดงให้เห็นว่าการเรียนรู้ของเครื่องขั้นสูงกำลังเป็นอย่างไร พิชัยกล่าวว่า Google มองเห็นการปรับปรุงด้านการมองเห็นอย่างมากเช่นเดียวกับการทำงานด้านคำพูด เทคโนโลยีคอมพิวเตอร์วิทัศน์ไม่เพียงแต่ช่วยจดจำว่าสิ่งใดคืออะไร แต่ยังสามารถช่วยซ่อมแซมหรือปรับปรุงภาพได้อีกด้วย ถ่ายรูปหอไอเฟลเบลอๆ เหรอ? เนื่องจากคอมพิวเตอร์จดจำวัตถุและรู้ว่ามันควรจะเป็นอย่างไร จึงสามารถปรับภาพนั้นให้เหมาะสมโดยอัตโนมัติตามสิ่งที่รู้อยู่แล้ว

“เราสามารถเข้าใจคุณลักษณะเบื้องหลังภาพถ่ายได้” พิชัยกล่าว “ระบบคอมพิวเตอร์วิทัศน์ของเราตอนนี้ดีกว่ามนุษย์ในการจดจำภาพ”

เพื่อให้ Lens มีประสิทธิภาพ Google จึงใช้สถาปัตยกรรมการคำนวณที่ซับซ้อนของ ชิปเซ็ต Cloud Tensor Processing Unit (TPU) เพื่อจัดการการฝึกอบรมและการอนุมานสำหรับเครื่อง การเรียนรู้. เทคโนโลยี TPU รุ่นที่สองสามารถรองรับการดำเนินการจุดลอยตัวได้ 180 ล้านล้านจุดต่อวินาที บอร์ด TPU 64 บอร์ดในซูเปอร์คอมพิวเตอร์หนึ่งเครื่องสามารถรองรับ 11.5 เพตาฟล็อปส์ ด้วยพลังการประมวลผลนี้ TPU ใหม่สามารถรองรับทั้งการฝึกและการอนุมานไปพร้อมๆ กัน ซึ่งไม่เป็นเช่นนั้น เป็นไปได้ในอดีต (TPU ก่อนหน้านี้สามารถรองรับงานการอนุมานเท่านั้น แต่ไม่ซับซ้อนกว่านี้ การฝึกอบรม). การเรียนรู้ของเครื่องต้องใช้เวลา แต่ฮาร์ดแวร์นี้จะช่วยเร่งความพยายามได้

Google Lens จะขับเคลื่อนการอัปเดตครั้งต่อไปของ Google Photos การจดจำรูปภาพมีการใช้อยู่แล้วในแอพรูปภาพเพื่อจดจำใบหน้า สถานที่ และสิ่งต่างๆ เพื่อช่วยในการจัดระเบียบและการค้นหา Google Lens ช่วยให้ Google Photos ให้ข้อมูลเพิ่มเติมเกี่ยวกับสิ่งต่างๆ ในรูปภาพ เช่น ชื่อและคำอธิบายของอาคาร การแตะที่หมายเลขโทรศัพท์ในรูปภาพจะเป็นการโทรออก โดยดึงข้อมูลเพิ่มเติมเกี่ยวกับงานศิลปะที่คุณเห็นใน พิพิธภัณฑ์ หรือแม้แต่ป้อนรหัสผ่าน Wi-Fi โดยอัตโนมัติจากภาพถ่ายที่คุณถ่ายด้านหลังของ Wi-Fi เราเตอร์

Assistant และ Photos จะเป็นแอปแรกๆ ที่ใช้ Google Lens แต่จะเปิดตัวในแอปอื่นๆ และด้วยการประกาศรองรับ Assistant ใน iOS ผู้ใช้ iPhone จะสามารถใช้เทคโนโลยี Google Lens ได้เช่นกัน

คำแนะนำของบรรณาธิการ

- ไม่ คุณไม่จำเป็นต้องมี Google Assistant บนสมาร์ทวอทช์ของคุณ

- 5 สิ่งที่เราอยากเห็นใน Google I/O 2023 (แต่อาจจะไม่เป็นเช่นนั้น)

- Google I/O 2023 จะจัดขึ้นในวันที่ 10 พฤษภาคมแบบเข้าร่วมด้วยตนเอง

- iPhone 14 Pro เทียบกับ การต่อสู้ของกล้อง Google Pixel 7 Pro ใกล้เข้ามาอย่างไม่น่าเชื่อ

- คุณลักษณะใหม่ของ Google Lens นี้ดูเหมือนหลุดมาจากภาพยนตร์ไซไฟโดยตรง

อัพเกรดไลฟ์สไตล์ของคุณDigital Trends ช่วยให้ผู้อ่านติดตามโลกแห่งเทคโนโลยีที่เปลี่ยนแปลงไปอย่างรวดเร็วด้วยข่าวสารล่าสุด รีวิวผลิตภัณฑ์สนุกๆ บทบรรณาธิการที่เจาะลึก และการแอบดูที่ไม่ซ้ำใคร