"Åldern för A.I. har börjat”, förklarade Nvidias vd Jensen Huang vid årets GTC. På sin GPU Technology Conference i år visade Nvidia upp sin innovation för att främja A.I., och noterade hur tekniken kunde hjälpa till att lösa världens problem 10 gånger bättre och snabbare.

Innehåll

- Ännu en ursäkt för lanseringen av RTX 3080/3090

- Nvidia Omniverse är en träningsplats för robotar

- Nvidia RTX A6000: Strålspårning för proffs

- Framväxten av A.I. bots

- A.I. för framtiden att arbeta hemifrån

- Att ta ett datacenter till ett ARM-chip

- Personliga rekommendationsmotorer

- A.I. för allt IoT

- Avancerar ARM

Medan Nvidia är mest känt för sitt grafikkort — och på senare tid associerad med realtid strålspårning — företaget driver också innovationen bakom kulisserna som för in artificiell intelligens i våra dagliga liv, från lagerrobotar som packar våra fraktbeställningar, till självkörande bilar och robotar på naturligt språk som levererar nyheter, sökningar och information med liten latens eller dröjsmål.

"Vi älskar att arbeta med extremt hårda datorproblem som har stor inverkan på världen," sa Huang och noterade att företaget nu har 110 SDK: er som riktar sig till de mer än 1 miljard CUDA-kompatibla GPU: er som har varit skickas. Företaget säger att mer än 6 500 startups bygger applikationer på Nvidia, och ansluter sig till de totalt 2 miljoner Nvidia-utvecklarna. "Det här är precis i vårt styrhus. Vi är alla redo för att främja och demokratisera denna nya form av datoranvändning för A.I. Nvidia är dedikerat till att avancera accelererad datoranvändning."

Relaterad

- Nvidia tar med ChatGPT-stil AI till videospel, och jag är redan orolig

- Jag presenterade min löjliga startidé för en robot-VC

- Analog A.I.? Det låter galet, men det kanske är framtiden

Ännu en ursäkt för lanseringen av RTX 3080/3090

Huang ledde med ytterligare en snabb ursäkt om den svåra lanseringen av grafikkorten Nvidia RTX 3080 och 3090. Läs mer här.

Rekommenderade videor

Nvidia Omniverse är en träningsplats för robotar

För spelare,

Nvidia Omniverse är nu tillgänglig i öppen beta och är en öppen plattform för samarbete och simulering där robotar kan lära sig av realistiska simuleringar av den verkliga världen. Med Omniverse kan autonoma fordon snabbt lära sig att köra och interagera med verkliga scenarier mänskliga förare kan stöta på, utan risk att äventyra åskådare om experimentet går i sidled. Omniverse tillåter också tester i en mycket bredare skala, eftersom ett autonomt fordon eller en robot inte behöver vara fysiskt utplacerad för att testa den.

För att visa hur Nvidia Omniverse kan påverka oss alla, lyfte Nvidia fram hur Omniverse kan arbeta inom läkemedelsupptäckt, vilket är ett ännu viktigare forskningsområde med tanke på den globala pandemin. Även om läkemedelsupptäckten vanligtvis tar mer än ett decennium att utveckla adug och kräver mer än en halv miljard dollar i forsknings- och utvecklingsfinansiering, misslyckas 90 % av dessa ansträngningar, sa Huang. För att göra saken värre, vart nionde år fördubblas kostnaden för att upptäcka nya läkemedel.

Nvidias Omniverse kan hjälpa forskare att identifiera de proteiner som kan orsaka sjukdomar, samt påskynda testning av potentiella mediciner genom att använda A.I. och dataanalys. Allt detta tillämpas på Nvidias nya Clara Discovery-plattform. Och i Storbritannien introducerade Nvidia sitt nya Cambridge One-datacenter, som företaget säger är det snabbaste i regionen och ett av de 30 bästa i världen, med 400 petaflops av A.I. prestanda.

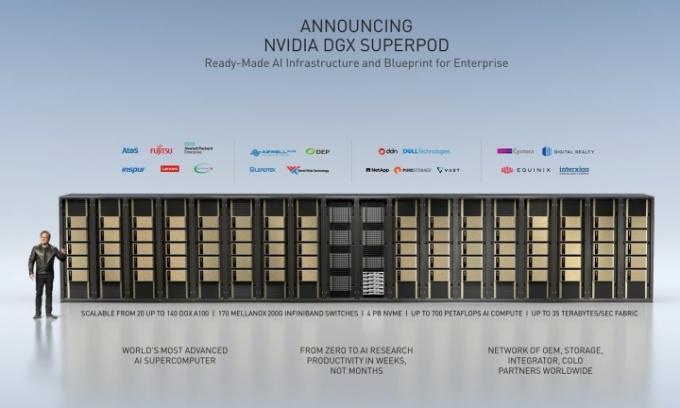

Företaget introducerade också sin nya DGX Super Pod-arkitektur, för att göra det möjligt för andra forskare att bygga sina egna skalbara superdatorer som länkar mellan 20 till 140 DGX-system.

Nvidia RTX A6000: Strålspårning för proffs

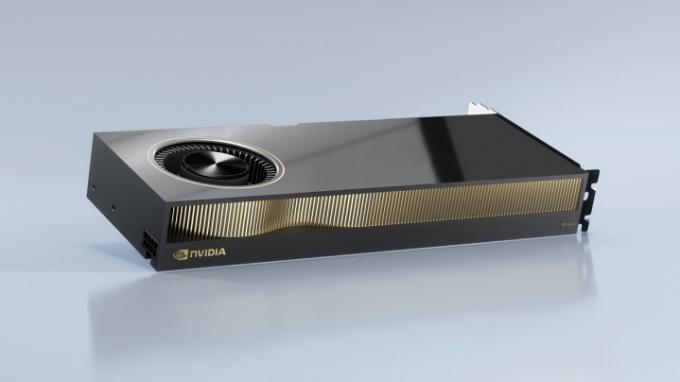

Expanderar på de nyligen tillkännagivna GeForce RTX 3070, RTX 3080 och RTX 3090 grafikkort, Nvidia tillkännagav en ny generation Ampere-baserade GPU: er för proffs. Den nya

"GPU: erna ger den hastighet och prestanda som gör det möjligt för ingenjörer att utveckla innovativa produkter, designers att skapa toppmoderna byggnader och forskare att upptäcka genombrott från var som helst i världen", sade företaget i ett blogginlägg och noterade att de nya A6000 och A40 har nya RT-kärnor, Tensor-kärnor och CUDA-kärnor som är "betydligt snabbare än de tidigare generationer.”

Företaget lämnade inga specifika detaljer om hårdvaran. Nvidia hävdade dock att andra generationens RT-kärnor levererar 2x genomströmningen av tidigare generationskort samtidigt som de ger samtidiga

Korten levereras med 48 GB GPU-minne som kan utökas till 96 GB med NVLink när två GPU: er är anslutna. Detta kan jämföras med bara 24 GB minne på RTX 3090. Medan RTX 3090 marknadsförs som en GPU som kan rendera spel i 8K med 60 bilder per sekund (fps), utökat minne på de professionella RTX A6000 och A40 hjälper till att bearbeta Blackmagic RAW 8K och 12K-material för video redigering. Liksom Ampere-korten för konsumenter är A6000 och A40 GPU: erna baserade på PCIe Gen 4, som levererar dubbelt så mycket bandbredd som föregående generation.

De A40-baserade servrarna kommer att finnas tillgängliga i system från Cisco, Dell, Fujitsu, Hewlett Packard Enterprise och Lenovo. A6000 GPU: erna kommer till kanalpartners, och båda GPU: erna kommer att finnas tillgängliga i början av nästa år. Prisinformation var inte omedelbart tillgänglig, och det är oklart om professionella kort kommer att se detsamma begränsat utbud och stora brister som Nvidia upplevde med lanseringen av sina konsumentkort.

Framväxten av A.I. bots

Nvidia lyfte också fram hur dess arbete med GPU: er hjälper till att påskynda A.I. utveckling och adoption. Facebooks A.I. Forskare har utvecklat en chatbot med kunskap och empati som hälften av det sociala nätverkets användare faktiskt föredrog. Forskare från California Institute of Technology tränade en drönare med hjälp av förstärkningsinlärning för att kontrollera flygsystemet för att flyga smidigt genom turbulens och förändringar i terrängen.

Nvidias A.I. är baserad på tre pelare: Noder med enkel till flera GPU på valfri ram eller modell, användning av slutledning och tillämpning av förtränade modeller, sa Huang.

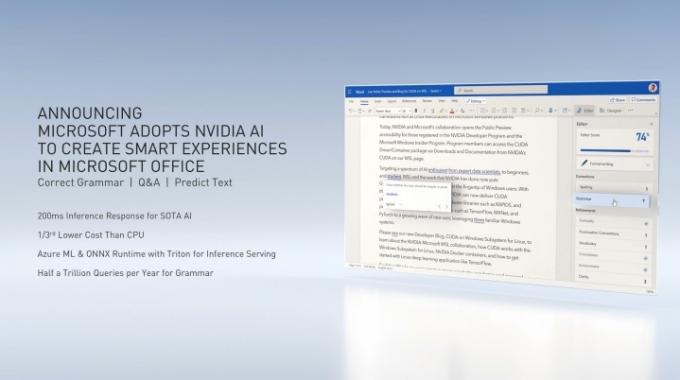

Nvidia tillkännagav också att de har samarbetat med Microsoft för att ta med Nvidia A.I. till Azure för att göra Office smartare.

"I dag tillkännager vi att Microsoft antar Nvidia A.I. på Azure, för att driva smarta upplevelser i Microsoft Office”, sa Huang under keynoten. "Världens mest populära produktivitetsapplikation som används av hundratals miljoner kommer nu att vara A.I.-stödd. De första funktionerna kommer att inkludera smart grammatikkorrigering, frågor och svar, textförutsägelse. På grund av mängden användare och det omedelbara svaret som krävs för en bra upplevelse kommer Office att anslutas till Nvidia GPU: er och Azure med Nvidia GPU: er tar mindre än 200 millisekunder. Vår genomströmning låter Microsoft skala till miljontals samtidiga användare."

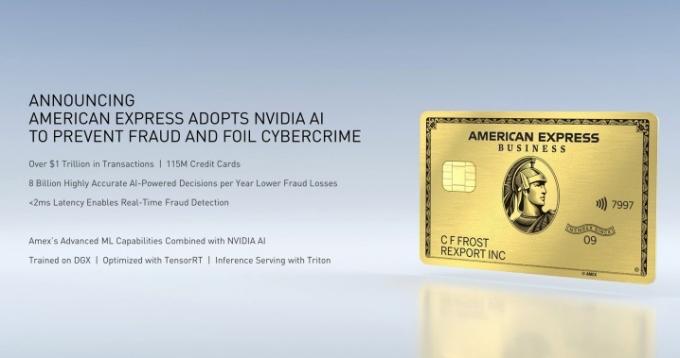

American Express använder också A.I. för att bekämpa bedrägerier, medan Twitter utnyttjar artificiell intelligens för att hjälpa den att förstå och kontextualisera den stora mängd videor som laddas upp till plattformen.

Med konversations-AI har resultat från röstfrågor utförda på Nvidias GPU-plattform hälften av fördröjning jämfört med CPU-behandlade frågor och även mer realistiska, människoliknande text-till-tal motorer. Nvidia tillkännagav också en öppen betaversion av Jarvis för utvecklare att prova A.I. med konversationsförmåga.

A.I. för framtiden att arbeta hemifrån

A.I. kan också byggas in i applikationer som videokonferenser och chattlösningar som hjälper arbetare att samarbeta på distans. Med Nvidias Video Maxene sa Huang att A.I. kan göra magi för videosamtal.

Maxene kan identifiera de viktiga funktionerna i ett ansikte, skicka bara ändringarna av funktionerna över internet och sedan återuppliva ansiktet vid mottagaren. Detta sparar bandbredd, vilket ger en bättre videoupplevelse i områden med dålig internetanslutning. Huang hävdade att bandbredden minskar med en faktor 10.

A.I. göra samtal bättre även i områden med hög bandbredd. I det mest extrema exemplet har A.I. kan användas för att omorientera ditt ansikte så att du får ögonkontakt med varje person i ett samtal, även när ditt ansikte lutar något bort från kameran. A.I. kan också minska bakgrundsljudet, lysa upp ditt ansikte igen, ersätta bakgrunden och förbättra videokvaliteten i dålig belysning. I kombination med Jarvis A.I. tal, Maxene kan även leverera text med dold bildtext.

"Vi har en möjlighet att revolutionera dagens videokonferenser och uppfinna morgondagens virtuella närvaro," sa Huang. "Och video A.I. slutledningstillämpningar kommer från alla branscher."

Att ta ett datacenter till ett ARM-chip

Nvidia lyfte fram sin investering i ARM-chips och tillkännagav de nya BlueField DPU: erna, som ger kraften hos ett datacenter-infrastruktur-på-ett-chip och stöds av DOCA, vilket är arkitektur.

De nya BlueField 2 DPU: erna laddar ner kritiska komponenter – som nätverk och lagring – samt säkerhetsuppgifter från CPU: n för att förhindra cyberattacker.

"En enda BlueField-2 DPU kan leverera samma datacentertjänster som kan förbruka upp till 125 CPU-kärnor," hävdade Nvidia i ett förberett uttalande. "Detta frigör värdefulla CPU-kärnor för att köra ett brett utbud av andra företagsapplikationer." Företaget sa att minst 30% av CPU var tidigare konsumerats av att köra datacenterinfrastruktur, och dessa kärnor frigörs nu eftersom uppgiften nu laddas ner till BlueField DPU.

En andra Bluefield 2X DPU kommer också med Nvidias Ampere-baserad GPU-teknik. Ampere tar med A.I. till BlueField 2X för att tillhandahålla säkerhetsanalyser i realtid och identifiera skadlig aktivitet.

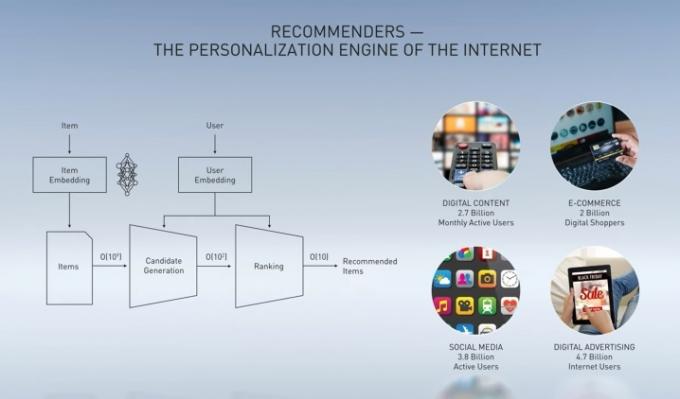

Personliga rekommendationsmotorer

A.I. kan användas för att leverera personliga rekommendationer av digitala och fysiska varor på plattformar, visa relevanta digitala annonser, nyheter och filmer. Nvidia hävdade att även en förbättring på 1% i rekommendationsnoggrannhet kan uppgå till miljarder mer i försäljning och högre kundbehållning.

För att hjälpa företag att förbättra sin rekommendationsmotor introducerade Nvidia Merlin, som drivs av Nvidia Rapids-plattformen. Medan CPU-baserade lösningar kan ta dagar att lära sig, sägs Merlin vara supersnabb och superskalbar, med cykeltider som går från en dag till bara tre timmar. Merlin är nu i öppen beta, sa Huang.

Rapids används av Adobe för intelligent marknadsföring, medan Capital One använder plattformen för bedrägerianalys och för att driva företagets Eno chatbot.

A.I. för allt IoT

Nvidias EGX-plattform används för att få A.I. att kanta enheter för att göra A.I. mer lyhörd för Internet of Things, eller IoT, applikationer. EGX är tillgängligt på Nvidias NGC, och det används av sjukhus som Northwestern Memorial Hospital för att ladda ner vissa uppgifter till datorer som rutinmässigt utförs av sjuksköterskor. Patienter kan till exempel använda naturliga språkfrågor för att fråga en bot vilken procedur de har.

"EGX A.I. Datorn integrerar en Mellanox Bluefield 2 GPU och en Ampere GPU till ett enda PCI Express-kort, vilket gör vilken standard OEM-server som helst till en säker accelererad A.I. datacenter, sa Huang.

Plattformen kan utnyttjas inom hälsovård, tillverkning, logistik, leverans, detaljhandel och transport.

Avancerar ARM

"I dag. vi tillkännager ett stort initiativ för att främja ARM-plattformen”, sa Huang om företagets annonserade förvärv av ARM, inget som det gör investeringar i tre dimensioner.

"För det första kompletterar vi ARM-partners med GPU-, nätverks-, lagrings- och säkerhetstekniker för att skapa kompletta accelererade plattformar. För det andra arbetar vi med våra partners för att skapa plattformar för HPC cloud edge NPC. Detta kräver chipssystem och systemprogramvara. Och för det tredje portar vi Nvidia A.I. och Nvidia RTX-motorer till ARM."

För närvarande är detta endast tillgängligt på x86-plattformen. Nvidias investering i ARm kommer dock att förvandla den i framkant och accelerera den i A.I. datoranvändning, sa Huang, när han ser till att positionera ARM som en konkurrent till Intel i serverutrymmet.

Redaktörens rekommendationer

- Nvidias superdator kan skapa en ny era av ChatGPT

- Nvidia GPU: er ser massiva prishöjningar och enorm efterfrågan från AI

- Zooms A.I. teknik för att upptäcka känslor under samtal upprör kritiker

- Nvidia avslöjar den första CPU och Hopper GPU någonsin på GTC 2022

- Hur Nvidia använder A.I. för att hjälpa Domino’s leverera pizzor snabbare