ОпенАИ-јев ГПТ-2 алгоритам за генерисање текста некада се сматрао превише опасним за објављивање. Онда је пуштен - и свет се наставио окретати.

Садржај

- Шта је добро за? Апсолутно све

- Више одакле је то дошло

- Веродостојна глупост

- Назад у Кинеску собу

- Храњење стохастичких папагаја

- Језички модели и будућност А.И.

У ретроспективи, релативно мали ГПТ-2 језички модел (слабих 1,5 милијарди параметара) изгледа безначајно поред свог наставка, ГПТ-3, који се може похвалити огромним 175 милијарди параметара, обучен је на 45 ТБ текстуалних података и коштао је пријављених 12 милиона долара (најмање) градити.

„Наша перспектива, и наш поглед у то време, била је да имамо монтирано издање, што је било као да, у почетку, издате мањи модел и сачекајте да видите шта ће се десити“, рекао је Сандхини Агарвал, АИ. Истраживач политике за ОпенАИ рекао је за Дигитал Трендови. „Ако ствари изгледају добро, онда пустите следећу величину модела. Разлог зашто смо заузели такав приступ је тај што су ово, искрено, [не само непознате воде за нас, већ су то и] непознате воде за цео свет."

Повезан

- Смешна формула: Зашто је хумор генерисан машинама свети грал А.И.

- Будућност АИ: 4 велике ствари на које треба обратити пажњу у наредних неколико година

- Осећајући емоције А.И. је овде, и то би могло бити на вашем следећем интервјуу за посао

Скочите напред у данашњи дан, девет месеци касније Издање ГПТ-3 прошлог лета, и напаја се више од 300 пријава док генерише масивних 4,5 милијарди речи дневно. Са само првих неколико реченица документа, он је у стању да генерише наизглед бесконачно више текста у истом стилу — чак и укључујући фиктивне цитате.

Да ли ће уништити свет? На основу прошлости, готово сигурно не. Али прави неке апликације које мењају игру АИ. могуће, све док успут постављају нека веома дубока питања.

Шта је добро за? Апсолутно све

Недавно се јавио Френсис Џервис, оснивач стартапа Аугрентед, користио је ГПТ-3 да помогне људима који се боре са закупнином да напишу писма у којима преговарају о попустима на кирију. „Овде бих описао случај употребе као 'пренос стила'", рекао је Јервис за Дигитал Трендс. „[Уноси] тачке, које чак не морају бити на савршеном енглеском, и [изводи] две до три реченице на формалном језику.“

Препоручени видео снимци

Покренут овим ултра-моћним језичким моделом, Џервисов алат омогућава изнајмљивачима да опишу своју ситуацију и разлог зашто им је потребно поравнање са попустом. „Само унесите неколико речи о томе зашто сте изгубили приход и за неколико секунди добићете предложени убедљив, формални параграф који ћете додати свом писму“, тврди компанија.

Ово је само врх леденог брега. Када Адитиа Јосхи, научник машинског учења и бивши инжењер Амазон Веб Сервицес, први је наишао на ГПТ-3, толико је био одушевљен оним што је видео да је поставио веб локацију, ввв.гпт3екамплес.цом, да пратимо најбоље.

„Убрзо након што је ОпенАИ најавио свој АПИ, програмери су почели да твитују импресивне демонстрације апликација направљених помоћу ГПТ-3“, рекао је он за Дигитал Трендс. „Били су запањујуће добри. Направио сам [своју веб страницу] да бих заједници олакшао проналажење ових примера и открио креативне начине коришћења ГПТ-3 за решавање проблема у сопственом домену.”

Потпуно интерактивне синтетичке личности са ГПТ-3 и https://t.co/ZPdnEqR0Hn 🎇

Они знају ко су, где су радили, ко им је шеф и још много тога. Ово није бот твог оца… пиц.твиттер.цом/кт4АтгИХЗЛ

— Тајлер Ластович (@тилерластовицх) 18. август 2020

Џоши указује на неколико демо снимака који су заиста утицали на њега. Један, а генератор распореда, приказује функционални изглед генерисањем ЈаваСцрипт кода из једноставног текстуалног описа. Желите дугме на којем пише „претплати се“ у облику лубенице? Желите неки текст банера са низом дугмади у дугиним бојама? Само их објасните у основном тексту, а Схариф Схамеемов генератор распореда ће написати код за вас. Други, а ГПТ-3 претраживач креирао Парас Цхопра, може претворити било који писани упит у одговор и УРЛ везу за пружање више информација. Други, обрнуто од Франсиса Џервиса Мајкла Тефуле, преводи правне документе на обичан енглески. Још један, Рапхаел Миллиере, пише филозофске есеје. И један други, Гверна Бранвена, може стварају креативну фикцију.

„Нисам очекивао да ће један језички модел радити тако добро на тако разноликом спектру задатака, од превођења језика и генерисања до резимирања текста и екстракције ентитета“, рекао је Јоши. „У један од мојих експеримената, користио сам ГПТ-3 да предвидим хемијске реакције сагоревања, и то је урадио изненађујуће добро.”

Више одакле је то дошло

Ту се не завршава ни трансформативна употреба ГПТ-3. Компјутерски научник Тилер Ластовицх је користио ГПТ-3 да стварају лажне људе, укључујући позадину, са којом се онда може комуницирати путем текста. У међувремену, Ендрју Мејн је показао да ГПТ-3 може бити користи се за претварање наслова филмова у емоџије. Ницк Валтон, главни технолошки директор компаније Латитуде, студија иза текстуалне авантуристичке игре генерисане ГПТ АИ Дунгеон недавно урадио исто да види да ли може да се окрене дужи низови описа текста у емоџије. А Цопи.аи, стартуп који прави алате за писање са ГПТ-3, користи модел за све што вреди, са месечним стални приход од 67.000 долара од марта - и недавни круг финансирања од 2,9 милиона долара.

Машинско учење је променило игру на разне начине у последњих неколико деценија.

„Дефинитивно, било је изненађења и много страхопоштовања у смислу креативности за коју су људи користили ГПТ-3,“ Сандхини Агарвал, А.И. Истраживач политике за ОпенАИ рекао је за Дигитал Трендс. „Толико случајева употребе је толико креативно, а у доменима које чак ни ја нисам предвидео, имало би много знања о томе. То је занимљиво видети. Али с обзиром на то, ГПТ-3 - и цео овај правац истраживања који је ОпенАИ водио - био је у великој мери са надом да ће нам ово дати А.И. модел који је био више опште намене. Цела поента А.И. опште намене. модел је [да би то био] један модел који би могао да ради све ове различите А.И. задаци.”

Многи пројекти истичу једну од великих додатака ГПТ-3: недостатак обуке коју он захтева. Машинско учење је било трансформативно на разне начине у последњих неколико деценија. Али машинско учење захтева велики број примера обуке да би се могли дати тачни одговори. ГПТ-3, с друге стране, има „способност неколико хитаца“ која му омогућава да се научи да ради нешто са само малом шаком примера.

Веродостојна глупост

ГПТ-3 је веома импресиван. Али то такође представља изазове. Неки од њих се односе на трошкове: За услуге великог обима као што су цхатботови, који би могли имати користи од магије ГПТ-3, алат би могао бити прескуп за употребу. (Једна порука би могла да кошта 6 центи што, иако није баш провална банка, свакако се додаје.)

Други се односе на његову широко распрострањену доступност, што значи да ће вероватно бити тешко изградити стартуп искључиво око тога јер ће жестока конкуренција вероватно смањити марже.

Други је недостатак памћења; његов контекстни прозор има нешто мање од 2000 речи у исто време, као лик Гаја Пирса у филму Мементо, његова меморија се ресетује. „Ово значајно ограничава дужину текста који може да генерише, отприлике на кратак пасус по захтеву“, рекао је Ластовић. „Практично говорећи, то значи да није у стању да генерише дугачке документе док се и даље сећа шта се догодило на почетку.

Међутим, можда најзначајнији изазов такође се односи на његову највећу снагу: његове способности конфабулације. Конфабулација је термин који лекари често користе да опишу начин на који неки људи са проблемима памћења могу да измишљати информације које на почетку изгледају уверљиво, али које не морају нужно да издрже детаљније испитивање инспекција. Способност ГПТ-3 да конфабулира је, у зависности од контекста, снага и слабост. За креативне пројекте, то може бити сјајно, омогућавајући му да се бави темама без бриге о било чему тако приземном као што је истина. За друге пројекте, то може бити теже.

Френсис Џервис из Аугрентеда се позива на способност ГПТ-3 да „генерише веродостојна срања“. Ницк Валтон из АИ Дунгеон рекао: „ГПТ-3 је веома добар у писању креативног текста који изгледа као да би га могао написати човек… Један од његових слабости су, међутим, то што често може да пише као да је веома самоуверен - чак и ако нема појма шта је одговор на питање је.”

Назад у Кинеску собу

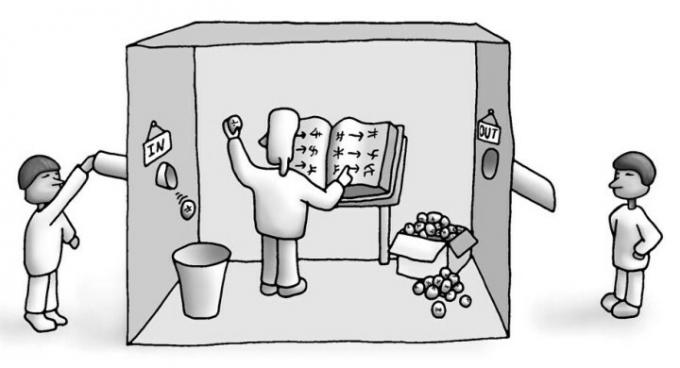

У том смислу, ГПТ-3 нас враћа на познато тло Кинеске собе Џона Сирла. 1980. Сирл, филозоф, објавио је један од најпознатијих А.И. мисаони експерименти, фокусиран на тему „разумевања“. Кинеска соба тражи од нас да замислимо особу закључану у соби са масом писања на језику који не разуме. Све што препознају су апстрактни симболи. Соба такође садржи скуп правила која показују како један скуп симбола кореспондира са другим. С обзиром на низ питања на која треба одговорити, корисник собе мора да усклади симболе питања са симболима одговора. Након што су овај задатак поновили много пута, они постају вешти у извршавању - иако немају појма шта значи било који скуп симбола, само да један одговара другом.

ГПТ-3 је свет далеко од врста лингвистичких А.И. који је постојао у време када је Серл писао. Међутим, питање разумевања је трновито као и увек.

„Ово је веома контроверзан домен испитивања, као што сам сигуран да сте свесни, јер постоји толико много различитих мишљења о томе да ли ће, генерално, језички модели... икада имати [истинско] разумевање“, рекао је Сандхини из ОпенАИ-а Агарвал. „Ако ме сада питате за ГПТ-3, понекад ради веома добро, али понекад не баш добро. Постоји та случајност на неки начин о томе колико би вам резултат могао изгледати смислено. Понекад ћете можда бити одушевљени резултатом, а понекад ће резултат бити бесмислен. С обзиром на то, тренутно по мом мишљењу... ГПТ-3 изгледа да нема разумевања."

Додатни заокрет у данашњем експерименту Кинеске собе је да ГПТ-3 не програмира на сваком кораку мали тим истраживача. То је огроман модел који је обучен на огромном скупу података који се састоји од, па, интернета. То значи да може покупити закључке и предрасуде које би могле бити кодиране у тексту који се налази на мрежи. Чули сте израз да сте у просеку од пет људи са којима се окружујете? Па, ГПТ-3 је обучен за готово несагледиве количине текстуалних података из више извора, укључујући књиге, Википедију и друге чланке. Из овога учи да предвиди следећу реч у било ком низу тако што ће претраживати своје податке о обуци да би видео комбинације речи које су раније коришћене. Ово може имати нежељене последице.

Храњење стохастичких папагаја

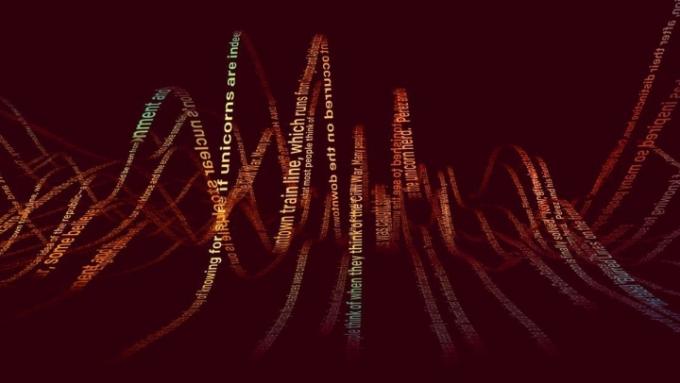

Овај изазов са великим језичким моделима први пут је истакнут у а револуционарни папир на тему такозваних стохастичких папагаја. Стохастички папагај — термин који су сковали аутори, који су у своје редове укључили бившег ко-воде Гоогле-овог етичког АИ. тим, Тимнит Гебру — односи се на велики језички модел који „насумично [спаја] низове језичких форми које је приметио у својим огромним подацима о обуци, према вероватнојним информацијама о томе како се комбинују, али без икакве референце значењу.”

„Пошто сте обучени на великом делу интернета, важно је признати да ће он носити неке од својих предрасуда,“ Алберт Гоззи, други корисник ГПТ-3, рекао је за Дигитал Трендс. „Знам да ОпенАИ тим напорно ради на ублажавању овога на неколико различитих начина, али очекивао бих да ће ово бити проблем још [неко] време.”

Противмере ОпенАИ за одбрану од пристрасности укључују филтер токсичности, који филтрира одређени језик или теме. ОпенАИ такође ради на начинима за интегрисање људских повратних информација како би могао да одреди у које области не треба залутати. Поред тога, тим контролише приступ алату тако да одређеним негативним употребама алата неће бити одобрен приступ.

„Пристрасност и потенцијал за експлицитне поврате апсолутно постоје и захтевају напор од програмера да их избегну.“

„Један од разлога зашто можда нисте видели превише ових злонамерних корисника је тај што имамо интензиван процес интерне ревизије“, рекао је Агарвал. „Начин на који радимо је да сваки пут када желите да користите ГПТ-3 у производу који би заиста био коришћен, ви морате да прођете кроз процес у којем тим - као, тим људи - заправо прегледа како желите да користите то. … Затим, на основу уверавања да није нешто злонамерно, биће вам одобрен приступ.“

Међутим, нешто од овога је изазовно - не само зато што пристрасност није увек јасан случај употребе одређених речи. Џервис напомиње да, с времена на време, његове ГПТ-3 изнајмљене поруке могу „тећи ка стереотипној родној [или] класи претпоставке“. Остављен без надзора, могао би претпоставити родни идентитет субјекта на писму за изнајмљивање, на основу његове породице улога или посао. Ово можда није најтежи пример А.И. пристрасност, али наглашава шта се дешава када се велике количине података прогутају и затим вероватно поново саставе у језичком моделу.

„Пристрасност и потенцијал за експлицитне поврате апсолутно постоје и захтевају напор од програмера да их избегну“, рекао је Тајлер Ластовић. „ОпенАИ означава потенцијално токсичне резултате, али на крају додаје обавезу о којој купци морају добро да размисле пре него што пусте модел у производњу. Посебно тежак случај за развој је склоност модела да лаже - јер нема концепт истинитих или лажних информација."

Језички модели и будућност А.И.

Девет месеци након свог дебија, ГПТ-3 сигурно испуњава своје наплате као мењач игре. Оно што је некада било чисто потенцијално показало се као потенцијал остварен. Број интригантних случајева употребе ГПТ-3 наглашава како А.И. је много разноврснији него што би тај опис могао да сугерише.

Није да је то ново дете у блоку ових дана. Раније ове године, ГПТ-3 је престижен као највећи језички модел. Гоогле Браин је дебитовао са новим језичким моделом са неких 1,6 трилиона параметара, што га чини девет пута већим од ОпенАИ понуде. Нити је вероватно да ће ово бити крај пута за језичке моделе. Ово су изузетно моћни алати — са потенцијалом да буду трансформативни за друштво, потенцијално на боље и на горе.

Изазови са овим технологијама свакако постоје, а компаније попут ОпенАИ, независних истраживача и других морају наставити да се баве. Али посматрано у целини, тешко је тврдити да се језички модели не претварају у једну од најзанимљивијих и најважнијих граница истраживања вештачке интелигенције.

Ко би помислио да генератори текста могу бити толико важни? Добродошли у будућност вештачке интелигенције.

Препоруке уредника

- Аналогни А.И.? Звучи лудо, али то би могла бити будућност

- Прочитајте сабласно лепе „синтетичке списе“ АИ. који мисли да је то Бог

- Алгоритамска архитектура: треба ли дозволити А.И. дизајнирати зграде за нас?

- Жене са бајтом: План Вивијен Минг да реши "неуредне људске проблеме" са А.И.

- Зашто би учење робота да се играју жмурке могло бити кључ за АИ следеће генерације