ЦхатГПТ је брзо постао миљеник генеративне АИ, али тешко да је једини играч у игри. Додатно сви остали АИ алати тамо који раде ствари као што је генерисање слика, постоји и велики број директних конкурената са ЦхатГПТ-ом - или сам тако претпоставио.

Садржај

- Бинг од Мицрософта

- БЕРТ од Гоогле-а

- Меена од Гоогле-а

- РоБЕРТа на Фејсбуку

- КСЛНет од Гоогле-а

- ДиалоГПТ компаније Мицрософт Ресеарцх

- АЛБЕРТ од Гоогле-а

- Т5 од Гоогле-а

- ЦТРЛ од Салесфорцеа

- ГСхард од Гоогле-а

- Блендер од Фацебоок АИ Ресеарцх

- Пегасус од Гоогле-а

Зашто не питате ЦхатГПТ о томе? Управо то сам урадио да бих добио ову листу, надајући се да ћу пронаћи неке опције за њих суочавајући се са обавештењима „у капацитету“., или други који само желе да пробају нешто ново. Нису сви ови доступни јавности као ЦхатГПТ, али према ЦхатГПТ-у, ово су најбоље алтернативе.

Препоручени видео снимци

Бинг од Мицрософта

Пре него што уђемо у изборе које је навела АИ, најбоља алтернатива ЦхатГПТ-у је, па, ЦхатГПТ. Мицрософт недавно додао АИ у свој претраживач Бинг, а ускоро планира да уведе ову функцију у претраживач Едге.

Повезан

- Произвођач ЦхатГПТ-а ОпенАИ суочава се са истрагом ФТЦ-а због закона о заштити потрошача

- Рекордни раст ЦхатГПТ-а управо је срушен новом вирусном апликацијом

- ОпенАИ гради нови тим како би спречио да суперинтелигентна вештачка интелигенција постане неваљала

То је само у прегледу, али још увек можете да испробате нови АИ цхатбот на бинг.цом/нев одмах. Мицрософт каже да у почетку ограничава број упита, али можете придружите се Бинг ЦхатГПТ листи чекања да будете обавештени када пуна верзија буде доступна.

БЕРТ од Гоогле-а

БЕРТ (Бидирецтионал Енцодер Репресентатионс фром Трансформерс) је модел машинског учења који је развио Гоогле. Многи резултати ЦхатГПТ-а помињу Гоогле-ове пројекте, које ћете видети касније на овој листи.

БЕРТ је познат по својим способностима обраде природног језика (НЛП), као што су одговарање на питања и анализа осећања. Користи БоокЦорпус и енглеску Википедију као своје моделе за референце за претходну обуку, пошто је научио 800 милиона и 2,5 милијарди речи.

БЕРТ је први пут најављен као истраживачки пројекат отвореног кода и академски рад у октобру 2018. Технологија је од тада имплементирана у Гоогле претрагу. Рана књижевност о БЕРТ-у упоредите га са ОпенАИ-јевим ЦхатГПТ-ом у новембру 2018, уз напомену да је Гоогле-ова технологија дубоко двосмерна, што помаже у предвиђању долазног текста. У међувремену, ОпенАИ ГПТ је једносмеран и може да одговори само на сложене упите.

Меена од Гоогле-а

Меена је цхатбот који Гоогле је представио јануара 2020. са способношћу да разговарају на људски начин. Примери његових функција укључују једноставне разговоре који укључују занимљиве шале и игре речи, као што је Меена која предлаже да краве студирају „Говеђе науке“ на Харварду.

Као директна алтернатива ОпенАИ-јевом ГПТ-2, Меена је имала могућност да обради 8,5 пута више података од свог конкурента у то време. Његова неуронска мрежа се састоји од 2,6 параметара и обучена је за разговоре на друштвеним медијима у јавном домену. Меена је такође добила метричку оцену у просеку сензибилитета и специфичности (ССА) од 79%, што га чини једним од најинтелигентнијих цхатботова свог времена.

Меена код је доступан на ГитХуб.

РоБЕРТа на Фејсбуку

РоБЕРТа (Робустли Оптимизед БЕРТ Претраининг Аппроацх) је још једна напредна верзија оригиналног БЕРТ-а, који Фејсбук је објавио у јулу 2019.

Фејсбук креирао овај НЛП модел са већим извором података као моделом пре обуке. РоБЕРТа користи ЦоммонЦравл (ЦЦ-Невс), који укључује 63 милиона енглеских новинских чланака генерисаних између септембра 2016. и фебруара 2019, као свој скуп података од 76 ГБ. За поређење, оригинални БЕРТ користи 16 ГБ података између своје енглеске Википедије и скупова података БоокЦорпус, према Фацебооку.

Силимар према КСЛНет-у, РоБЕРТа је победио БЕРТ у скупу референтних скупова података, према истраживању Фацебоок-а. Да би добила ове резултате, компанија не само да је користила већи извор података већ је и унапред обучила свој модел за а дужи временски период.

Фацебоок је направио РоБЕРТа отвореног кода септембра 2019. а њен код је доступно на ГитХуб-у за експериментисање у заједници.

ВентуреБеат такође је поменуо ГПТ-2 међу новим системима вештачке интелигенције у то време.

КСЛНет од Гоогле-а

КСЛНЕТ је модел ауторегресивног језика заснован на трансформатору који је развио тим Истраживачи Гоогле Браин и Универзитета Царнегие Меллон. Модел је у суштини напреднији БЕРТ и први пут је представљен у јуну 2019. Група је открила да је КСЛНет најмање 16% ефикасније него оригинални БЕРТ, који је најављен 2018. године, са могућношћу да победи БЕРТ у тесту од 20 НЛП задатака.

КСЛНет: нова метода претренинга за НЛП која значајно унапређује БЕРТ на 20 задатака (нпр. СКуАД, ГЛУЕ, РАЦЕ)

аркив: https://t.co/C1tFMwZvyW

гитхуб (код + унапред обучени модели): https://t.co/kI4jsVzT1u

са Зхилин Ианг, @ЗихангДаи, Ииминг Ианг, Јаиме Царбонелл, @рсалакхупиц.твиттер.цом/ЈбоОекУВПК

— Куоц Ле (@куоцлеик) 20. јуна 2019. године

Са КСЛНет и БЕРТ-ом који користе „маскиране” токене за предвиђање скривеног текста, КСЛНет побољшава ефикасност убрзавањем предиктивног дела процеса. На пример, Амазон Алека научник података Аисхвариа Сринивасан објаснио да је КСЛНет у стању да идентификује реч „Ново” као повезану са термином „је град” пре него што предвиди термин „Јорк” који је такође повезан са тим термином. У међувремену, БЕРТ треба одвојено да идентификује речи „Њу” и „Јорк”, а затим да их повеже са термином „је град”, на пример.

Приметно, ГПТ и ГПТ-2 су такође поменути у овом објашњавачу из 2019. као други примери ауторегресивних језичких модела.

КСЛНет код и унапред обучени модели су доступно на ГитХуб-у. Модел је добро познат међу НЛП истраживачком заједницом.

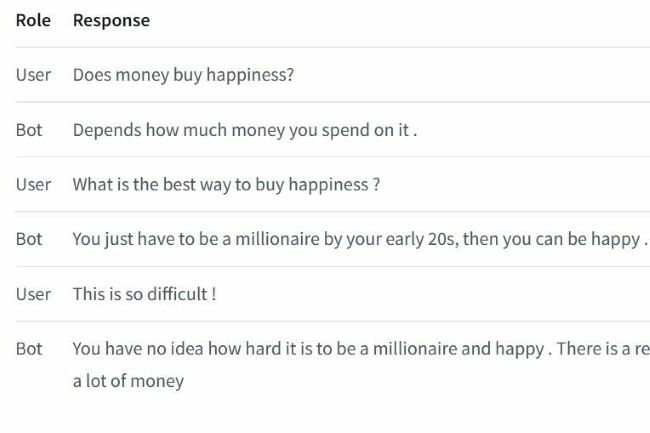

ДиалоГПТ компаније Мицрософт Ресеарцх

ДиалоГПТ (Диалогуе Генеративе Пре-траинед Трансформер) је ауторегресивни језички модел који је уведен у новембру 2019. од стране Мицрософт Ресеарцх-а. Са сличностима са ГПТ-2, модел је био унапред обучен да генерише људски разговор. Међутим, његов примарни извор информација било је 147 милиона вишеструких дијалога саструганих из Реддит тема.

ХуманФирст главни јеванђелиста Кобус Грејлинг је приметио његов успех у имплементацији ДиалоГПТ-а у Телеграм сервис за размену порука како би модел оживео као цхатбот. Додао је да коришћење Амазон Веб Сервицес и Амазон СагеМакер-а може помоћи у фином подешавању кода.

ДиалоГПТ код је доступан на ГитХуб.

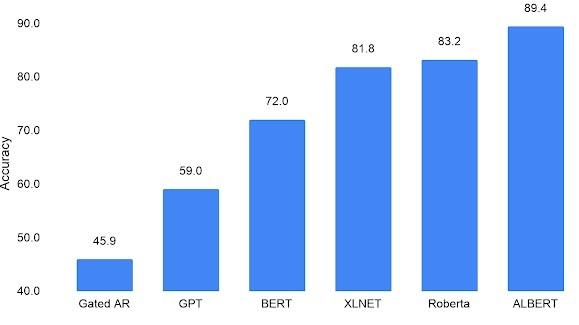

АЛБЕРТ од Гоогле-а

АЛБЕРТ (Лаки БЕРТ) је скраћена верзија оригиналног БЕРТ-а и развио га је Гоогле у децембру 2019.

Са АЛБЕРТ-ом, Гоогле је ограничио број параметара дозвољених у моделу увођењем параметара са „уграђивањем скривених слојева“.

Ово се побољшало не само на БЕРТ моделу већ и на КСЛНет и РоБЕРТа јер се АЛБЕРТ може обучити на исти већи скуп података који се користи за два новија модела док се придржавају мањег параметрима. У суштини, АЛБЕРТ ради само са параметрима неопходним за његове функције, што повећава перформансе и тачност. Гугл је детаљно навео да је открио да АЛБЕРТ премашује БЕРТ на 12 НЛП мерила, укључујући мерило разумевања читања слично САТ-у.

Иако није поменут по имену, ГПТ је укључен у слику за АЛБЕРТ на Гоогле-овом истраживачком блогу.

Гоогле је објавио АЛБЕРТ као отворени код у јануару 2020. и имплементиран је на Гоогле-ов ТенсорФлов. Код је доступан на ГитХуб.

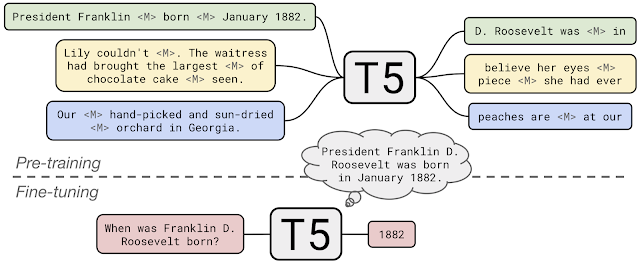

Т5 од Гоогле-а

ЦТРЛ од Салесфорцеа

ГСхард од Гоогле-а

ГСхард је а гигантски модел превода језика то Гоогле је представио јуна 2020. у сврху скалирања неуронске мреже. Модел укључује 600 милијарди параметара, што омогућава велике скупове обуке података одједном. ГСхард је посебно вешт у томе превод језика и обучени за превођење 100 језика на енглески за четири дана.

Блендер од Фацебоок АИ Ресеарцх

Блендер је цхатбот отвореног кода који је представљен у април 2020 би Фацебоок АИ Ресеарцх. Примећено је да је цхатбот побољшао конверзацијске вештине у односу на конкурентске моделе, са способношћу да пружи ангажујући тачке за разговор, слушајте и покажите разумевање доприноса свог партнера и покажите емпатију и личност.

Блендер је упоређен са Гоогле-овим Меена цхатботом, који је заузврат упоређен са ОпенАИ ГПТ-2

Блендер код је доступан на Парл.аи.

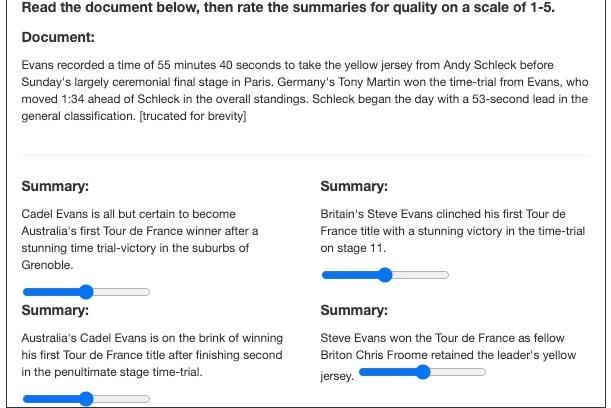

Пегасус од Гоогле-а

Пегаз је модел обраде природног језика који је био увео Гоогле у децембру 2019. Пегасус се може обучити за креирање резимеа, и слично другим моделима као што су БЕРТ, ГПТ-2, РоБЕРТа, КСЛНет, АЛБЕРТ и Т5, може се фино подесити за специфичне задатке. Пегасус је тестиран на његову ефикасност у сажимању вести, науке, прича, упутстава, е-поште, патената и законских закона у поређењу са људским субјектима.

Пегасус код је доступан на ГитХуб.

Препоруке уредника

- Гоогле Бард сада може да говори, али може ли да пригуши ЦхатГПТ?

- ЦхатГПТ: најновије вести, контроверзе и савети које треба да знате

- Саобраћај на ЦхатГПТ веб локацији је по први пут опао

- ЦхатГПТ-ова функција прегледања Бинг-а је онемогућена због грешке у приступу паивалл-у

- Најбољи АИ цхат ботови за испробавање: ЦхатГПТ, Бард и још много тога