Če nekoliko spremenim naslov znane televizijske oddaje: Kids do the darndest things. Pred kratkim so raziskovalci iz Nemčije in Združenega kraljestva izvedli študijo, objavljeno v reviji Znanstvena robotika, ki je pokazal, v kolikšni meri so otroci dovzetni za pritisk vrstnikov robotov. Različica TLDR: odgovor na staro starševsko vprašanje: "Če bi ti vsi tvoji prijatelji rekli, da skočiš s pečine, bi?" morda »Seveda. Če bi bili vsi moji prijatelji roboti.«

Vsebina

- So odrasli res toliko pametnejši?

- Za vsako ladjo obstaja brodolom

Test je ponovil slavni eksperiment iz leta 1951, ki ga je uvedel poljski psiholog Solomon Asch. Poskus je pokazal, kako lahko na ljudi vplivajo pritiski skupinskega razmišljanja, tudi če je to v nasprotju z informacijami, za katere vedo, da so pravilne. V Aschovih poskusih so zbrali skupino študentov in pokazali dve karti. Kartica na levi je prikazovala sliko ene navpične črte. Kartica na desni je prikazovala tri vrstice različnih dolžin. Eksperimentator je nato vprašal udeležence, katera črta na desni kartici se ujema z dolžino črte, prikazane na levi kartici.

Priporočeni videoposnetki

"Posebna stvar pri tej starostni skupini otrok je, da so še vedno v starosti, ko ne bodo več verjeli."

Tako daleč je tako preprosto. Stvari pa so postale bolj zvijačne pri sestavi skupine. Samo ena oseba iz skupine je bila pravi udeleženec, drugi pa so bili vsi igralci, ki jim je bilo vnaprej povedano, kaj naj povedo. Namen poskusa je bil preizkusiti, ali bi se pravi udeleženec strinjal s preostalimi člani skupine, ko so soglasno dali napačen odgovor. Kot se je izkazalo, večina bi. Pritisk vrstnikov pomeni, da bo večina ljudi zanikala informacije, ki so očitno pravilne, če to pomeni prilagajanje mnenju večine.

Povezano

- Razvijajoči se samopodvajajoči roboti so tukaj - vendar naj vas ne skrbi upor

- Roboti vam ne bodo ukradli službe. Prihajajo, da bi ga izboljšali

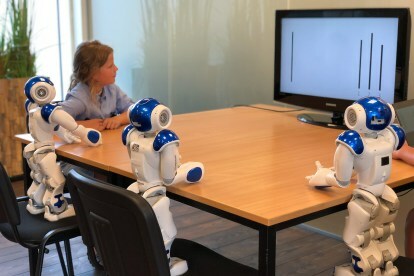

V remiksu eksperimenta iz leta 2018 je bil uporabljen isti princip - le da je bil namesto skupine študentov "pravi udeleženec" otrok, star od sedem do devet let. "Igralce" so igrali trije roboti, programirani za napačen odgovor. V vzorcu 43 prostovoljcev je 74 odstotkov otrok dalo enak napačen odgovor kot roboti. Rezultati kažejo, da bo večina otrok te starosti pritisk robotov obravnavala enako kot pritisk vrstnikov svojih vrstnikov iz mesa in krvi.

"Posebna stvar pri tej starostni skupini otrok je, da so še vedno v starosti, ko ne bodo več verjeli," Tony Belpaeme, profesor za inteligentne in avtonomne nadzorne sisteme, ki je pomagal pri izvedbi študije, je povedal za Digital Trends. »Igrali se bodo z igračami in še vedno verjeli, da so njihove akcijske figure ali punčke resnične; še vedno bodo gledali lutkovno predstavo in resnično verjeli, kaj se dogaja; morda še verjamejo v [Božička]. Enako je, ko gledajo robota: ne vidijo elektronike in plastike, temveč socialni značaj.«

Zanimivo je, da je poskus primerjal to z odzivom odraslih. Za razliko od otrok napake robotov niso vplivale na odrasle. "Ko je odrasel videl robota, ki daje napačen odgovor, ga je začudeno pogledal in nato dal pravilen odgovor," je nadaljeval Belpaeme.

Torej ni razloga za skrb? Dokler preprečimo, da bi otroci dobili v roke robote, programirane za slabe odzive, bi moralo biti vse v redu, kajne? Ne bodite tako hitri.

So odrasli res toliko pametnejši?

Kot je priznal Belpaeme, je bila ta naloga zasnovana tako preprosto, da ni bilo negotovosti glede odgovora. Realni svet je drugačen. Ko razmišljamo o vrstah del, ki jih zlahka predamo strojem, so to pogosto naloge, ki jih kot ljudje ne moremo vedno opraviti popolno.

Ta naloga je bila zasnovana tako preprosto, da ni bilo negotovosti glede odgovora.

Lahko se zgodi, da je naloga neverjetno preprosta, vendar jo lahko stroj opravi bistveno hitreje kot mi. Lahko pa gre za bolj zapleteno nalogo, pri kateri ima računalnik dostop do veliko večjih količin podatkov kot mi. Glede na morebitni vpliv dela, ki ga opravljamo, ni presenetljivo, da mnogi od nas ne bi bili zadovoljni s popravljanjem stroja.

Ali bi bila medicinska sestra v bolnišnici vesela, če bi preglasila FDA odobril algoritem ki lahko pomaga pri določanju prioritet glede zdravja pacientov s spremljanjem vitalnih znakov in nato pošiljanjem opozoril zdravstvenemu osebju? Ali pa bi vozniku bilo udobno prevzeti volan avtomobila brez voznika, ko bi imel opravka s posebej zapletenim cestnim scenarijem? Ali celo pilot, ki preglasi avtopilota, ker misli, da je bila sprejeta napačna odločitev? V vseh teh primerih bi radi mislili, da je odgovor "da". Iz najrazličnejših razlogov pa to morda ni resničnost.

O tem v svoji knjigi iz leta 2014 piše Nicholas Carr Steklena kletka: Kam nas pelje avtomatizacija. Način, kako to opisuje, poudarja vrsto dvoumnosti, ki jo vključujejo resnični primeri avtomatizacije, kjer so težave veliko bolj zapleten kot dolžina vrstice na kartici, stroji so veliko pametnejši in rezultat je potencialno večji ključnega pomena.

»Kako merite stroške zmanjšanja truda in angažmaja ali zmanjšanja delovanja in avtonomije ali subtilnega poslabšanja spretnosti? Ne moreš,« piše. "To so tiste vrste senčnih, nematerialnih stvari, ki jih le redko cenimo, dokler ne izginejo, in celo takrat imamo lahko težave s konkretnim izražanjem izgub."

"To so senčne, nematerialne stvari, ki jih le redko cenimo, dokler ne izginejo."

Družbeni roboti, o katerih Belpaeme teoretizira v raziskovalnem prispevku, še niso običajni, vendar že obstajajo ilustracije nekaterih od teh zagat v akciji. Carr na primer začne svojo knjigo z omembo memoranduma Zvezne uprave za letalstvo, v katerem je navedeno, da bi morali piloti porabiti manj časa za letenje na avtopilotu zaradi tveganj, ki jih to predstavlja. To je temeljilo na analizi podatkov o nesrečah, ki je pokazala, da se piloti pogosto preveč zanašajo na računalniške sisteme.

Podoben primer je vključeval tožbo leta 2009, v kateri je bila ženska po imenu Lauren Rosenberg vložil tožbo proti Googlu potem ko so mu svetovali, naj hodi po poti, ki vodi v nevaren promet. Čeprav je bil primer zavržen s sodišča, kaže, da bodo ljudje preglasili lastno zdravo pamet v prepričanju, da ima strojna inteligenca več inteligence kot mi.

Za vsako ladjo obstaja brodolom

Navsezadnje, kot priznava Belpaeme, je težava v tem, da včasih želimo predati odločanje strojem. Roboti obljubite, da boste opravljali dela, ki so dolgočasna, umazana in nevarna - in če moramo vsako odločitev pretehtati, to v resnici niso obljubljene naprave, ki prihranijo delo. Če bomo sčasoma v svoj dom povabili robote, bomo želeli, da bodo lahko delovali avtonomno, kar bo vključevalo določeno stopnjo zaupanja.

»Roboti, ki na vas izvajajo socialni pritisk, so lahko dobra stvar; ni nujno, da je zlobno,« je nadaljeval Belpaeme. »Če imate robote, ki se uporabljajo v zdravstvu ali izobraževanju, želite, da lahko vplivajo na vas. Na primer, če želite shujšati, lahko za dva meseca dobite robota za hujšanje monitorji vaš vnos kalorij in vas spodbuja k večji vadbi. Želite, da bi bil takšen robot prepričljiv in vplival na vas. Toda vsaka tehnologija, ki se lahko uporablja v dobro, se lahko uporablja tudi v zlo.

Kakšen je odgovor na to? O takih vprašanjih se bo razpravljalo od primera do primera. Če slabo na koncu prevlada nad dobrim, tehnologija, kot so socialni roboti, ne bo nikoli zaživela. Vendar je pomembno, da iz študij, kot je tista o pritisku vrstnikov, ki ga povzročijo roboti, vzamemo prave lekcije. In ni dejstvo, da smo toliko pametnejši od otrok.

Priporočila urednikov

- Prihodnost avtomatizacije: Roboti prihajajo, vendar ne bodo vzeli vašega dela

- Ti roboti do smrti uničijo plevel, tako da kmetje ne potrebujejo kemičnih herbicidov