Prediktivno policijsko delovanje naj bi spremenil način izvajanja policijskega dela in nas popeljal v svet pametne zakonodaje pregon, pri katerem je bila pristranskost odstranjena in bi se policija lahko odzvala na podatke, ne pa na slutnje. Toda desetletje po tem, ko nas je večina prvič slišala za izraz "prediktivno policijsko delovanje", se zdi jasno, da ni delovalo. Tehnologija zaradi negativnega odziva javnosti doživlja precejšen upad v svoji uporabi v primerjavi s samo nekaj leti nazaj.

Vsebina

- Obljuba predvidljivega policijskega delovanja

- Diskriminatorni algoritmi

- Nevarnosti umazanih podatkov

- Negotova prihodnost prediktivnega policijskega dela

- Napačna orodja za delo?

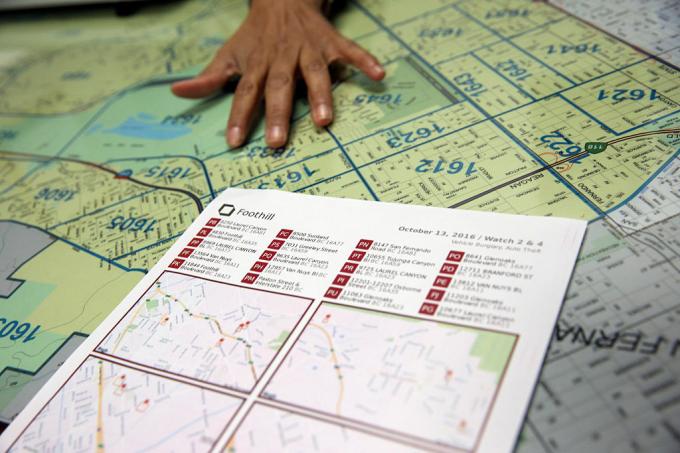

Aprila letos je Los Angeles - ki je po navedbah LA Timesa "pionir napovedoval kriminal s podatki" - zmanjšal financiranje svojega programa za napovedovanje policije, pri čemer je za to kriv stroške. "To je težka odločitev," pravi šef policije Michel Moore povedal za LA Times. »To je strategija, ki smo jo uporabili, vendar so projekcije stroškov v višini več sto tisoč dolarjev za to prav zdaj pa je tisto, kar moram storiti, v primerjavi z iskanjem tega denarja in usmerjanjem tega denarja v druge bolj osrednje dejavnosti.«

Priporočeni videoposnetki

Kaj je šlo narobe? Kako bi lahko nekaj, kar se oglašuje kot "pametna" tehnologija, povzročilo nadaljnje utrjevanje pristranskosti in diskriminacije? In ali so sanje o prediktivnem policijskem delu tiste, ki bi jih lahko prilagodili s pravim algoritmom - ali slepa ulica v pravičnejši družbi, ki se trenutno spopada s tem, kako naj policija deluje?

Obljuba predvidljivega policijskega delovanja

Prediktivno policijsko delo v sedanji obliki sega približno eno desetletje v dokument iz leta 2009, ki sta ga napisala psihologinja Colleen McCue in načelnik policije v Los Angelesu Charlie Beck z naslovom "Prediktivno policijsko delo: Kaj se lahko naučimo od Walmarta in Amazona o boju proti kriminalu v recesiji?” V časopisu so ugotovili, kako veliki trgovci na drobno uporabljajo velike podatke za pomoč pri odkrivanju vzorcev v preteklem vedenju kupcev, ki bi jih lahko uporabili za napovedovanje prihodnjega vedenja. Zahvaljujoč napredku v računalništvu in zbiranju podatkov sta McCue in Beck predlagala, da je mogoče zbirati in analizirati podatke o kriminalu v realnem času. Te podatke bi nato lahko uporabili za predvidevanje, preprečevanje in učinkovitejše odzivanje na kazniva dejanja, ki se še niso zgodila.

V preteklih letih se je prediktivno policijsko delo v mnogih delih Združenih držav, skupaj s preostalim svetom, spremenilo iz ideje, ki jo je treba zavrniti, v realnost. V tem procesu se je odločil spremeniti policijsko delovanje iz reaktivne sile v proaktivno; temelji na nekaterih dosežkih v podatkovno vodeni tehnologiji, ki omogoča odkrivanje vzorcev v realnem času – in ukrepanje v skladu z njimi.

"Obstajata dve glavni obliki prediktivnega nadzora," Andrew Ferguson, profesor prava na Univerzi okrožja Columbia David A. Clarke School of Law in avtor Vzpon policijskega nadzora z velikimi podatki: nadzor, rasa in prihodnost kazenskega pregona, je povedal za Digital Trends. "[To sta] prediktivno policijsko delovanje na podlagi kraja in prediktivno policijsko delovanje na podlagi oseb."

V obeh primerih prediktivni policijski sistemi dodelijo oceno tveganja zadevni osebi ali kraju, kar policijo spodbudi k nadaljnjemu ukrepanju v danem intervalu. Prvi od teh pristopov, prediktivno policijsko delovanje na podlagi kraja, se osredotoča predvsem na policijske patrulje. Vključuje uporabo kartiranja kriminala in analitike o verjetnih krajih prihodnjih zločinov na podlagi prejšnjih statističnih podatkov.

Namesto da bi se znebili težav, kot so rasizem in druge sistemske pristranskosti, jih lahko prediktivno policijsko delovanje dejansko pomaga utrditi.

Drugi pristop se osredotoča na napovedovanje verjetnosti, da posameznik predstavlja potencialno prihodnje tveganje. Na primer, leta 2013 je bil poveljnik čikaške policije poslan na dom 22-letnega Roberta McDaniela, ki je bil označen kot potencialno tveganje ali storilec nasilja z orožjem v središču Chicaga s strani algoritem. "Toplotni seznam", ki ga je pomagal sestaviti algoritem, je iskal vzorce, ki bi lahko napovedali prihodnje storilce ali žrtve, tudi če sami niso storili ničesar, kar bi upravičilo to preiskavo, razen skladnosti z a profil.

Kot je Chicago Tribune ugotavlja: »Strategija zahteva, da se tiste, ki so na vročem seznamu, posamično opozori, da bodo nadaljnje kriminalne dejavnosti, tudi za najbolj majhne prekrške bo povzročila razveljavitev celotne veljavnosti zakona njim."

Sanje o prediktivnem policijskem delu so bile, da bi z ukrepanjem na podlagi merljivih podatkov policijsko delo postalo ne le učinkovitejše, temveč tudi manj nagnjeno k ugibanjem in posledično pristranskosti. Zagovorniki so trdili, da bi policijo spremenili na bolje in uvedli novo dobo pametne policije. Vendar pa je prediktivno policijsko delovanje že od samega začetka imelo ostre kritike. Trdijo, da lahko prediktivno policijsko delovanje dejansko pomaga pri utrjevanju problemov, kot so rasizem in druge sistemske pristranskosti, namesto da bi pomagalo znebiti se jih. In težko je trditi, da nimajo smisla.

Diskriminatorni algoritmi

Ideja, da se sistemi predvidevanja, ki temeljijo na strojnem učenju, lahko naučijo razlikovati na podlagi dejavnikov, kot je rasa, ni nič novega. Orodja za strojno učenje se usposabljajo z ogromno količino podatkov. In dokler te podatke zbira sistem, v katerem je rasa še vedno prevladujoč dejavnik, lahko to vodi v diskriminacijo.

Kot Renata M. O'Donnell piše v članku iz leta 2019 z naslovom "Izpodbijanje rasističnih napovednih policijskih algoritmov v skladu s klavzulo o enaki zaščiti,« se algoritmi strojnega učenja učijo iz podatkov, ki izhajajo iz pravosodnega sistema, v katerem so »temnopolti Američani zaprti v državnih zaporih to je 5,1-krat več kot belci, vsak tretji temnopolti moški pa lahko pričakuje, da bo šel v življenju v zapor, če bodo trenutni trendi nadaljuj.”

"Podatki niso objektivni," je Ferguson povedal za Digital Trends. »Samo mi smo zmanjšani na binarno kodo. Podatkovno vodeni sistemi, ki delujejo v resničnem svetu, niso nič bolj objektivni, pošteni ali nepristranski kot resnični svet. Če je vaš resnični svet strukturno neenak ali rasno diskriminatoren, bo sistem, ki temelji na podatkih, odseval te družbene neenakosti. Vhodni podatki so zaznamovani s pristranskostjo. Analiza je pristranska. In mehanizmi policijske oblasti se ne spremenijo samo zato, ker obstaja tehnologija, ki vodi sisteme.«

Ferguson daje primer aretacij kot enega navidez objektivnega dejavnika pri napovedovanju tveganja. Vendar bodo aretacije izkrivljene zaradi dodelitve policijskih virov (na primer, kje patruljirajo) in vrst kaznivih dejanj, ki običajno upravičujejo aretacije. To je samo ena ilustracija potencialno problematičnih podatkov.

Nevarnosti umazanih podatkov

Manjkajoči in nepravilni podatki se v podatkovnem rudarjenju včasih imenujejo "umazani podatki". A 2019 članek raziskovalcev iz A.I. Zdaj Inštitut na Univerzi v New Yorku razširi ta izraz tako, da se nanaša tudi na podatke, na katere vplivajo pokvarjeni, pristranski in nezakoniti praks – ne glede na to, ali gre za namerno manipuliranje, ki ga izkrivljajo posamezniki in družbene pristranskosti. Lahko bi na primer vključevala podatke, pridobljene z aretacijo nedolžne osebe, ki so ji podtaknili dokaze ali je kako drugače lažno obtožena.

Nekoliko ironije je v tem, da so se v zadnjih desetletjih zahteve podatkovne družbe, v kateri vse se vrti okoli kvantifikacije in številčnih ciljev iz litega železa, je pravkar privedlo do cele množice … no, res slabi podatki. Serija HBO Žica prikazal resnični fenomen "smehanja s statistiko" in leta, odkar je bila oddaja ustavljena, so ponudila veliko primeri dejanske sistemske manipulacije podatkov, ponarejenih policijskih poročil in neustavnih praks, ki so nedolžne ljudi poslale v zapor.

Slabi podatki, ki ljudem na oblasti omogočajo, da umetno zadenejo tarče, so ena stvar. Toda združite to z algoritmi in napovednimi modeli, ki to uporabljajo kot osnovo za modeliranje sveta, in lahko dobite nekaj veliko hujšega.

Raziskovalci so pokazali, kako lahko vprašljivi podatki o kriminalu, vključeni v napovedne policijske algoritme, ustvarijo tako imenovano "ubežne povratne zanke,« v katerem je policija vedno znova poslana v iste soseske ne glede na dejansko stopnjo kriminala. Eden od soavtorjev tega prispevka, računalničar Suresh Venkatasubramanian, pravi, da lahko modeli strojnega učenja s svojim modeliranjem vgradijo napačne predpostavke. Kot stari pregovor o tem, da je za osebo s kladivom vsaka težava videti kot žebelj, ti sistemi modelirajo le določene elemente težave - in predstavljajte si samo en možen izid.

»[Nekaj, česar] ti modeli ne obravnavajo, je, v kolikšni meri modelirate dejstvo, da lahko na območje dejansko vržete več policistov. slabša kakovost življenja ljudi, ki tam živijo?« Venkatasubramanian, profesor na Fakulteti za računalništvo na Univerzi v Utahu, je za Digital povedal Trendi. »Predvidevamo, da je več policistov boljša stvar. Toda kot zdaj vidimo, več policije ni nujno dobra stvar. Pravzaprav lahko poslabša stvari. V nobenem modelu, ki sem ga videl, se ni nihče vprašal, koliko stane več policije na nekem območju.«

Negotova prihodnost prediktivnega policijskega dela

Tisti, ki delajo na področju prediktivnega policijskega dela, včasih neironično uporabljajo izraz »poročilo o manjšinah« za označevanje vrste napovedi, ki jo izvajajo. Izraz se pogosto uporablja kot referenca na 2002 istoimenski film, ki je ohlapno temeljila na kratki zgodbi iz leta 1956 Philipa K. kurac. notri Manjšinsko poročilo, poseben policijski oddelek PreCrime prijema storilce kaznivih dejanj na podlagi predznanja o kaznivih dejanjih, ki bodo storjena v prihodnosti. Te napovedi zagotavljajo trije jasnovidci, imenovani "precogs".

Toda zasuk v Manjšinsko poročilo je, da napovedi niso vedno točne. Nestrinjajoče se vizije enega od predznakov zagotavljajo alternativni pogled na prihodnost, ki pa je zamolčan zaradi strahu, da bi sistem postal nezaupljiv.

Notranje revizije, ki kažejo, da taktika ni delovala. Ne samo, da so bili napovedni seznami pomanjkljivi, ampak tudi neučinkoviti.

Prav zdaj se prediktivno policijsko delo sooča s svojo negotovo prihodnostjo. Poleg novih tehnologij, kot je prepoznavanje obraza, tehnologija, ki je na voljo organom pregona za morebitno uporabo, še nikoli ni bila močnejša. Hkrati je zavest o uporabi prediktivnega policijskega nadzora povzročila odpor javnosti, ki je morda dejansko pomagala odpraviti to. Ferguson je za Digital Trends povedal, da je bila uporaba prediktivnih policijskih orodij v zadnjih nekaj letih v "zmanjšanem zamahu".

»Na svojem vrhuncu je bilo [lokalno predvideno policijsko delovanje] v več kot 60 večjih mestih in je raslo, a kot posledica uspešnega organiziranja skupnosti, je bila v veliki meri zmanjšana in/ali nadomeščena z drugimi oblikami podatkovno usmerjenih analitiko,« je dejal. »Skratka, izraz prediktivno policijsko delovanje je postal strupen in policijske službe so se naučile preimenovati, kaj počnejo s podatki. Napovedno policijsko delo na podlagi oseb je imelo strmejši padec. Dve glavni mesti, ki sta vložili v njegovo ustanovitev - Chicago in Los Angeles - sta se umaknili od osebnega pristopa strategije po ostrih kritikah skupnosti in uničujočih notranjih revizijah, ki kažejo, da taktike niso delo. Ne le, da so bili napovedni seznami pomanjkljivi, bili so tudi neučinkoviti.«

Napačna orodja za delo?

vendar Rashida Richardson, direktor političnih raziskav pri A.I. Inštitut Now pravi, da je uporaba te tehnologije preveč nepregledna. »Še vedno ne vemo zaradi pomanjkanja preglednosti glede vladnega pridobivanja tehnologije in mnogih drugih vrzeli v obstoječih postopkih javnega naročanja, ki lahko nekatere nakupe tehnologije zaščitijo pred javnim nadzorom,« je rekla. Navaja primer tehnologije, ki bi jo lahko policijski upravi dali brezplačno ali jo kupila tretja oseba. »Iz raziskav, kot je moja, in poročanja medijev vemo, da so številni največji policijski oddelki v ZDA uporabljali tehnologija na neki točki, vendar obstaja tudi veliko majhnih policijskih oddelkov, ki jo uporabljajo ali so jo uporabljali za omejena obdobja časa."

Ali bo glede na trenutno spraševanje o vlogi policije prišlo do skušnjave po ponovnem objemu napovedno policijsko delovanje kot orodje za sprejemanje odločitev na podlagi podatkov – morda v manj distopični znanstveni fantastiki blagovna znamka? Obstaja možnost, da bi prišlo do takega ponovnega vzpona. Toda Venkatasubramanian je zelo skeptičen, da je strojno učenje, kot se trenutno izvaja, pravo orodje za delo.

»Celotno strojno učenje in njegov uspeh v sodobni družbi temelji na predpostavki, da ne glede na dejansko problem, se končno zmanjša na zbiranje podatkov, izdelavo modela, napovedovanje izida – in ni vam treba skrbeti za domeno,« rekel je. »Lahko napišete isto kodo in jo uporabite na 100 različnih mestih. To je obljuba abstrakcije in prenosljivosti. Težava je v tem, da ko uporabljamo tisto, kar ljudje imenujejo družbeno-tehnični sistemi, kjer so ljudje in tehnologija prepleteni v zapletenih valovih, tega ne morete storiti. Ne morete kar priklopiti kosa in pričakovati, da bo deloval. Ker [obstajajo] učinki valovanja z vstavljanjem tega kosa in dejstvom, da obstajajo različni igralcev z različnimi agendami v takem sistemu in sistem podrejo svojim potrebam različne poti. Vse te stvari je treba upoštevati, ko govorimo o učinkovitosti. Da, abstraktno lahko rečete, da bo vse delovalo v redu, ampak tam je brez izvlečka. Obstaja samo kontekst, v katerem delate.«