Prediktívna polícia mal zmeniť spôsob, akým sa vykonávala polícia, a uviesť nás do sveta inteligentného práva výkonu, v ktorom bola zaujatosť odstránená a polícia by bola schopná reagovať na údaje, nie na predtuchy. Ale desať rokov po tom, čo väčšina z nás prvýkrát počula termín „prediktívna polícia“, sa zdá byť jasné, že to nefungovalo. Táto technológia, ktorá je poháňaná odporom verejnosti, zaznamenáva výrazný pokles používania v porovnaní s obdobím pred niekoľkými rokmi.

Obsah

- Prísľub prediktívnej polície

- Diskriminačné algoritmy

- Nebezpečenstvo špinavých údajov

- Neistá budúcnosť prediktívnej polície

- Nesprávne nástroje pre prácu?

V apríli tohto roku Los Angeles – ktoré podľa LA Times „je priekopníkom v predpovedaní zločinu pomocou údajov“ – znížilo financovanie svojho programu prediktívnej polície, pričom obviňovalo náklady. "Je to ťažké rozhodnutie," povedal policajný šéf Michel Moore povedal pre LA Times. „Je to stratégia, ktorú sme použili, ale odhadované náklady sú v stovkách tisíc dolárov, ktoré treba minúť za toto právo Teraz verzus nájdenie týchto peňazí a nasmerovanie týchto peňazí do iných centrálnejších aktivít je to, čo musím urobiť.“

Odporúčané videá

Čo sa pokazilo? Ako by niečo propagované ako „inteligentná“ technológia mohlo spôsobiť ďalšie zakorenené predsudky a diskrimináciu? A je sen o prediktívnej polícii tým, ktorý by sa dal vyladiť správnym algoritmom – alebo slepou uličkou v spravodlivejšej spoločnosti, ktorá sa v súčasnosti potýka s tým, ako by mala fungovať polícia?

Prísľub prediktívnej polície

Prediktívna polícia vo svojej súčasnej podobe sa datuje približne pred desaťročím do práce psychologičky Colleen McCueovej a šéfa polície v Los Angeles Charlieho Becka z roku 2009 s názvom „Prediktívna polícia: Čo sa môžeme naučiť od Walmartu a Amazonu o boji proti zločinu v recesii?“ V novinách sa chopili spôsobu, akým veľké maloobchodné predajne používali veľké údaje, aby pomohli odhaliť vzorce správania zákazníkov v minulosti, ktoré by sa dali použiť na predpovedanie budúceho správania. Vďaka pokroku v oblasti výpočtovej techniky a zhromažďovania údajov McCue a Beck navrhli, že je možné zhromažďovať a analyzovať údaje o kriminalite v reálnom čase. Tieto údaje by sa potom mohli použiť na predvídanie, prevenciu a účinnejšiu reakciu na zločiny, ktoré sa ešte nestali.

V nasledujúcich rokoch sa prediktívna polícia v mnohých častiach Spojených štátov, spolu so zvyškom sveta, zmenila z nápadu na zahodenie na realitu. V tomto procese sa rozhodla zmeniť policajnú činnosť z reaktívnej sily na proaktívnu; čerpanie z niektorých prelomov v technológii založenej na údajoch, ktoré umožňujú rozpoznať vzory v reálnom čase – a konať podľa nich.

"Existujú dve hlavné formy prediktívnej polície," Andrew Ferguson, profesor práva na University of District of Columbia David A. Clarke School of Law a autor Vzostup polície s veľkými údajmi: Dohľad, rasa a budúcnosť presadzovania práva, povedal Digital Trends. „[Toto sú] prediktívne policajné práce založené na mieste a prediktívne policajné práce založené na osobách.“

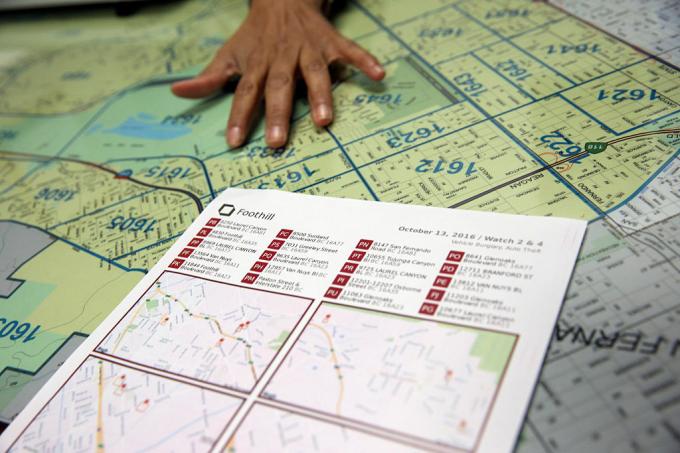

V oboch prípadoch prediktívne policajné systémy priraďujú danej osobe alebo miestu rizikové skóre, čo nabáda políciu, aby v danom intervale sledovala. Prvý z týchto prístupov, miestna prediktívna polícia, sa zameriava predovšetkým na policajné hliadky. Zahŕňa použitie mapovania kriminality a analýzy pravdepodobných miest budúcich trestných činov na základe predchádzajúcich štatistík.

Prediktívna polícia môže skôr ako pomôcť zbaviť sa problémov, ako je rasizmus a iné systémové predsudky, pomôcť ich upevniť.

Druhý prístup sa zameriava na predpovedanie pravdepodobnosti, že jednotlivec predstavuje potenciálne budúce riziko. Napríklad v roku 2013 bol veliteľ chicagskej polície poslaný do domu 22-ročného Roberta McDaniela, ktorý bol označený za potenciálneho rizika alebo páchateľa násilia so zbraňou v centre Chicaga algoritmu. „Zoznam tepla“, ktorý algoritmus pomohol zostaviť, hľadal vzory, ktoré by mohli predpovedať budúcich páchateľov alebo obete, aj keď oni sami neurobili nič, čo by zaručovalo túto kontrolu nad rámec a profilu.

Ako poznamenal Chicago Tribune: „Stratégia vyžaduje, aby jednotlivci na zozname tepla varovali pred ďalšou trestnou činnosťou, aj v prípade tých najdrobnejších priestupkov bude mať za následok zrušenie plnej platnosti zákona ich.”

Snom o prediktívnej polícii bolo, že ak sa bude konať na základe kvantifikovateľných údajov, bude policajná práca nielen efektívnejšia, ale aj menej náchylná na dohady a v dôsledku toho k zaujatosti. Zástancovia tvrdili, že by to zmenilo políciu k lepšiemu a otvorilo by novú éru inteligentnej polície. Avšak takmer od samého začiatku má prediktívna polícia zarytých kritikov. Tvrdia, že namiesto pomoci pri odstraňovaní problémov, ako je rasizmus a iné systémové predsudky, môže prediktívna polícia v skutočnosti pomôcť ich upevneniu. A je ťažké tvrdiť, že nemajú zmysel.

Diskriminačné algoritmy

Myšlienka, že prediktívne policajné systémy založené na strojovom učení sa môžu naučiť rozlišovať na základe faktorov, ako je rasa, nie je ničím novým. Nástroje strojového učenia sú trénované s obrovským množstvom údajov. A pokiaľ sú tieto údaje zhromažďované systémom, v ktorom je rasa naďalej prevažujúcim faktorom, môže to viesť k diskriminácii.

Ako Renata M. O'Donnell píše v novinách z roku 2019 s názvom „Náročné rasistické prediktívne policajné algoritmy podľa doložky o rovnakej ochraneAlgoritmy strojového učenia sa učia z údajov odvodených zo súdneho systému, v ktorom sú „Čierni Američania uväznení v štátnych väzniciach rýchlosťou to je 5,1-násobok väznenia belochov a každý tretí černoch, ktorý sa dnes narodil, môže očakávať, že pôjde do väzenia počas svojho života, ak sú súčasné trendy ďalej."

„Údaje nie sú objektívne,“ povedal Ferguson pre Digital Trends. „To sme len my zredukovaní na binárny kód. Systémy založené na údajoch, ktoré fungujú v reálnom svete, nie sú o nič objektívnejšie, spravodlivejšie alebo nezaujatejšie ako skutočný svet. Ak je váš skutočný svet štrukturálne nerovný alebo rasovo diskriminačný, systém založený na údajoch bude odrážať tieto spoločenské nerovnosti. Vstupy, ktoré prichádzajú, sú poznamenané zaujatosťou. Analýza je poznačená zaujatosťou. A mechanizmy policajnej autority sa nemenia len preto, že existuje technológia, ktorá riadi systémy."

Ferguson uvádza príklad zatknutia ako jedného zdanlivo objektívneho faktora pri predpovedaní rizika. Zatknutia však budú skreslené prideľovaním policajných zdrojov (napríklad tam, kde hliadkuje) a typmi trestných činov, ktoré si zvyčajne vyžadujú zatknutie. Toto je len jedna ilustrácia potenciálne problematických údajov.

Nebezpečenstvo špinavých údajov

Chýbajúce a nesprávne údaje sa niekedy pri získavaní údajov označujú ako „špinavé údaje“. A 2019 dokument výskumníkov z A.I. Teraz inštitút na New York University rozširuje tento pojem aj na údaje, ktoré sú ovplyvnené skorumpovanými, zaujatými a nezákonnými praktiky – či už ide o zámerne zmanipulované, ktoré sú skreslené jednotlivcami a spoločenské predsudky. Mohlo by to napríklad zahŕňať údaje, ktoré pochádzajú zo zatknutia nevinnej osoby, na ktorú boli nastrčené dôkazy alebo ktorá je inak krivo obvinená.

Je tu istá irónia v tom, že v priebehu posledných desaťročí požiadavky dátovej spoločnosti, v ktorej všetko je o kvantifikácii a liatinových numerických cieľoch, práve to viedlo k mnohým... no, naozaj zlé údaje. Seriál HBO Drôt predviedli skutočný svetový fenomén „vyhadzovania štatistík“ a roky, odkedy sa šou odvysielala, ponúkli veľa príklady skutočnej systémovej manipulácie s údajmi, falošných policajných správ a protiústavných praktík, ktoré poslali nevinných ľudí do väzenie.

Zlé údaje, ktoré umožňujú ľuďom pri moci umelo zasiahnuť ciele, sú jedna vec. Ale skombinujte to s algoritmami a prediktívnymi modelmi, ktoré to používajú ako základ na modelovanie sveta, a potenciálne dostanete niečo oveľa horšie.

Výskumníci ukázali, ako sporné údaje o trestnej činnosti zapojené do prediktívnych policajných algoritmov môžu vytvoriť to, čo sa nazýva „unikajúce spätnoväzbové slučky“, v ktorej sú policajti opakovane posielaní do rovnakých štvrtí bez ohľadu na skutočnú mieru kriminality. Jeden zo spoluautorov tohto článku, počítačový vedec Suresh Venkatasubramanian, hovorí, že modely strojového učenia môžu prostredníctvom svojho modelovania zabudovať chybné predpoklady. Rovnako ako staré príslovie o tom, že pre človeka s kladivom vyzerá každý problém ako klinec, tieto systémy modelujú iba určité prvky problému – a predstavujú si len jeden možný výsledok.

„Niečo, čo sa v týchto modeloch nerieši, je, do akej miery modelujete skutočnosť, že hádzanie ďalších policajtov do oblasti môže v skutočnosti znížiť kvalitu života ľudí, ktorí tam žijú?“ Venkatasubramanian, profesor na School of Computing na University of Utah, povedal pre Digital Trendy. „Predpokladáme, že viac policajtov je lepšia vec. Ale ako vidíme práve teraz, mať viac policajtov nie je nevyhnutne dobrá vec. V skutočnosti to môže veci ešte zhoršiť. Ani v jednom modeli, ktorý som kedy videl, sa nikto nikdy nepýtal, aké sú náklady na umiestnenie väčšieho počtu policajtov v oblasti.“

Neistá budúcnosť prediktívnej polície

Tí, ktorí pracujú v prediktívnej polícii, niekedy neironicky používajú termín „Správa o menšinách“ na označenie druhu predpovedí, ktoré robia. Tento výraz sa často používa ako odkaz na Rovnomenný film z roku 2002, ktorý bol voľne založený na poviedke z roku 1956 od Philipa K. Dick. In Správa o menšinách, špeciálne policajné oddelenie PreCrime zatýka zločincov na základe informovanosti o zločinoch, ktoré budú spáchané v budúcnosti. Tieto predpovede poskytujú traja jasnovidci nazývaní „predkogovia“.

Ale zvrat v Správa o menšinách je, že predpovede nie sú vždy presné. Nesúhlasné vízie jedného z predkolegov poskytujú alternatívny pohľad do budúcnosti, ktorý je potláčaný zo strachu, aby sa systém nezdal nedôveryhodný.

Interné audity, ktoré ukazujú, že taktika nefungovala. Prediktívne zoznamy boli nielen chybné, ale boli aj neúčinné.

Práve teraz čelí prediktívna polícia svojej vlastnej neistej budúcnosti. Popri nových technológiách, ako je rozpoznávanie tváre, technológia, ktorú majú orgány činné v trestnom konaní k dispozícii na možné použitie, nebola nikdy výkonnejšia. Povedomie o využívaní prediktívnej polície zároveň vyvolalo odpor verejnosti, ktorý ju možno v skutočnosti pomohol potlačiť. Ferguson pre Digital Trends povedal, že používanie prediktívnych policajných nástrojov bolo v posledných rokoch na „dole“.

„Na svojom vrchole bola [prediktívna polícia na základe miesta] vo viac ako 60 veľkých mestách a rástla, ale v dôsledku úspešné komunitné organizovanie sa do značnej miery obmedzilo alebo nahradilo inými formami založenými na údajoch analytika,“ povedal. „Stručne povedané, termín prediktívna polícia sa stal toxickým a policajné oddelenia sa naučili premenovať, čo robili s údajmi. Prediktívna policajná práca založená na osobách mala strmší pokles. Dve hlavné mestá, ktoré investovali do jeho vytvorenia – Chicago a Los Angeles – ustúpili od svojho osobného základu stratégie po ostrej komunitnej kritike a zničujúcich interných auditoch, ktoré ukázali, že taktika nie práca. Prediktívne zoznamy boli nielen chybné, ale boli aj neúčinné.“

Nesprávne nástroje pre prácu?

však Rashida Richardsonová, riaditeľ pre výskum politiky v A.I. Inštitút teraz povedal, že používanie tejto technológie je príliš neprehľadné. „Stále to nevieme kvôli nedostatočnej transparentnosti, pokiaľ ide o vládne získavanie technológií a mnohé ďalšie medzery v existujúcich postupoch obstarávania, ktoré môžu chrániť nákupy určitých technológií pred verejnou kontrolou,“ povedala. Uvádza príklad technológie, ktorá môže byť poskytnutá policajnému oddeleniu bezplatne alebo zakúpená treťou stranou. „Z výskumov, ako je ten môj, a z mediálnych správ vieme, že mnohé z najväčších policajných oddelení v USA využili technológie v určitom okamihu, ale existuje aj veľa malých policajných oddelení, ktoré ju používajú alebo používali na obmedzené obdobia času.”

Vzhľadom na súčasné otázky o úlohe polície, bude existovať pokušenie znovu sa objať prediktívna polícia ako nástroj na rozhodovanie založené na údajoch – možno v rámci menej dystopického sci-fi branding? Existuje možnosť, že k takémuto oživeniu dôjde. Venkatasubramanian je však veľmi skeptický, že strojové učenie, ako sa v súčasnosti praktizuje, je tým správnym nástrojom pre túto prácu.

„Celé strojové učenie a jeho úspech v modernej spoločnosti je založený na predpoklade, že bez ohľadu na to, čo je skutočné problém sa v konečnom dôsledku zredukuje na zhromažďovanie údajov, zostavovanie modelu, predpovedanie výsledku – a nemusíte sa starať o doménu,“ povedal. „Môžete napísať ten istý kód a použiť ho na 100 rôznych miestach. To je prísľub abstrakcie a prenosnosti. Problém je v tom, že keď používame to, čo ľudia nazývajú sociálno-technické systémy, kde sú ľudia a technológie prepletené v komplikovaných vlnách, nemôžete to urobiť. Nemôžete len pripojiť kus a očakávať, že bude fungovať. Pretože [sú tam] vlnové efekty s vložením toho dielu a skutočnosť, že existujú rôzne hráčov s rôznymi agendami v takomto systéme a podvracajú systém svojim vlastným potrebám v rôzne cesty. Všetky tieto veci musia byť zohľadnené, keď hovoríte o účinnosti. Áno, môžete abstraktne povedať, že všetko bude fungovať dobre, ale tam je žiadny abstrakt. Existuje len kontext, v ktorom pracujete."