Google Glass a dus ochelarii inteligenți din domeniul academicilor cu coadă de cal și al visătorilor din Silicon Valley în realitatea mainstream. Are zeci de aplicații. Are modele noi de la Oakley și Ray-Ban. Are fani care le includ pe ambele modele de piste și jucători de baschet.

Și dacă te afli într-o cameră zgomotoasă, este aproape la fel de lipsit de valoare, pe atât de geek. Pentru că vorbirea cu gadgeturile tale nu este nici pe departe la fel de simplă, la David Hasselhoff, a făcut-o să pară cavaler.

Videoclipuri recomandate

Sigur, poți să latri „Sticlă, fă o fotografie” în confortul sufrageriei tale și să-l faci pe domnul Meowsers fără să-ți așezi ceaiul. Dar să încerci același lucru într-un bar plin de viață este o modalitate sigură de a enerva oamenii din jurul tău - și poate de a obține o bătaie. Între timp, pad-ul sensibil la atingere al Glass se ocupă doar de câteva funcții de bază.

Tehnologia cu evoluție rapidă a sticlei inteligente ar putea ajuta, de asemenea, să pună un arc în pasul destul de letargic al ARI.

„Smartphone-ul se mută în viziunea ta și trebuie să existe o nouă interfață care să evolueze cu noul hardware”, spune cofondatorul Ryan Fink. „Acolo intervine ARI.”

ARI, prescurtare de la Augmented Reality Interface, nu necesită butoane, touchpad și nu vorbesc. „ARI este Siri-ul recunoașterii gesturilor pentru ochelari inteligenți”, explică Fink.

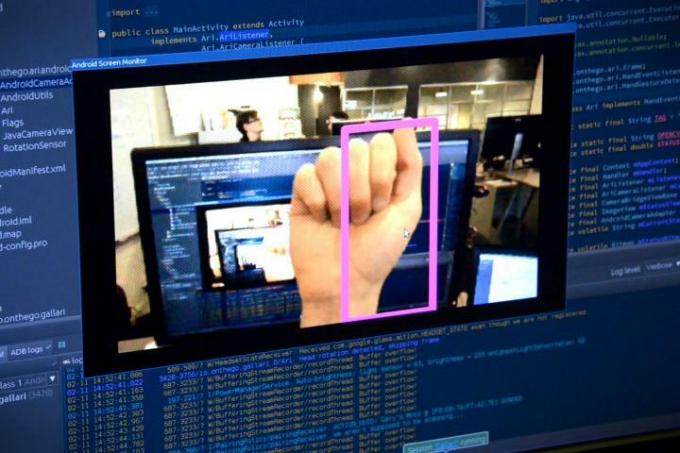

Ține-ți pumnul în fața feței (ca un boxer de altădată care caută o luptă) și o casetă apare suprapusă peste ea în Google Glass. După ce o recunoaște ca o comandă, ARI numără invers 3 secunde, astfel încât să vă puteți îndepărta mâna, apoi face o fotografie. După ce ați adunat câteva, puteți folosi mișcarea mâinii pentru a răsfoi biblioteca de fotografii a Glass, ca și cum ați întoarce pagini invizibile într-un album foto.

Aceasta este doar o utilizare. În cele din urmă, echipa speră că ARI va fi capabil să recunoască o întreagă bibliotecă de gesturi, pe care dezvoltatorii externi le pot introduce în aplicațiile lor ca comenzi. Aplicația Pandora, de exemplu, ar putea într-o zi să interpreteze un degetul mare în sus drept aprobarea ta pentru acea gem Whitesnake pe care tocmai l-a redat pe postul tău din anii 80.

O nouă modalitate de a controla Google Glass

Pe lângă faptul că sunt pur și simplu mai puțin enervant decât să vorbești cu ochelarii tăi, Fink și cofondatorul Gary Peck văd asta ca modalitate esențială de a controla sticla în scenarii în care altfel nu ar funcționa niciodată, ca într-o fabrică podea.

„Este foarte zgomotos, uneori au lucruri în mână și vor să poată interacționa cu ușurință cu conținutul sau să verifice lucrurile pe măsură ce parcurg”, explică Fink. Cu ARI, un muncitor ar putea pur și simplu să fluture cu mâna pentru a muta afișajul din ochelari la următoarea instrucțiune dintr-o listă sau să ridice pumnul pentru a marca că este finalizată.

Același lucru este valabil și pentru sportivi. Un snowboarder cu mănuși groase ar putea avea dificultăți la glisarea touchpad-ului, iar un motociclist ar putea să nu vrea să-și ridice mâinile de pe ghidon pentru a porni un cronometru.

„Cred că la început va fi puțin ciudat, mai ales pentru oamenii care nu sunt familiarizați cu tehnologia.”

În teorie, ARI rezolvă toate aceste probleme. În execuție, există încă o mulțime de îndoituri de rezolvat. Versiunea alfa timpurie pe care am testat-o a durat ceva timp pentru a recunoaște gesturile și este nevoie de o execuție intenționată pentru a scoate o lovitură sau un pumn exact așa cum caută ARI să o vadă.

Dar tehnologia din sticlă inteligentă care evoluează rapid ar putea ajuta, de asemenea, să pună un arc în pasul destul de letargic al ARI. Deoarece analizează în mod constant imaginile de la camera Glass încorporată, ARI nu poate rula pe telefonul tău; trebuie să ruleze pe procesorul anemic încorporat în Glass. Pe măsură ce acele procesoare devin mai rapide, la fel și ARI.

Camera lui Glass rămâne, de asemenea, o provocare - pentru că există doar una. Sistemele de control prin gesturi concepute special, cum ar fi Kinect de la Microsoft, se bazează pe o pereche de camere pentru a genera imagini stereo, ceea ce lasă computerul care vă citește mișcările maniacale să determine adâncimea. „Cu camerele duble, ai într-adevăr un model 3D al lumii în fața ta. Cu o singură cameră este doar o imagine simplă”, explică Peck „N-ai idee că această mână este un obiect diferit de masă, sunt doar pixeli diferiți.” Peck a trebuit să rezolve această intrare primitivă pentru a detecta obiecte doar pe baza aspectului lor.

Provocarea este făcută și mai dificilă de necesitatea de a păstra durata de viață limitată a bateriei Google Glass: cu cât detectarea gesturilor este mai precisă, cu atât mai mult consumă bateria. „Acesta este compromisul”, a spus Peck. „Cum poți obține o precizie suficient de bună pentru gesturile pe care încerci să le faci?” Codul său, de exemplu, folosește rezoluție joasă video de la camera de bord, chiar dacă tehnic poate captura la 1080p - pentru că nu încearcă să urmărească fiecare deget.

Factorul tocilar aici este, de asemenea, imposibil de ignorat: cum îi faci pe oameni să folosească o tehnologie care te face să arăți ca cel mai prost mim din lume? „Cred că la început va fi puțin ciudat, mai ales pentru oamenii care nu sunt familiarizați cu tehnologia”, recunoaște Fink, dar insistă că percepțiile se vor schimba pe măsură ce tehnologia se îmbunătățește. „Va fi mult mai asemănător Omul de fier sau Raport minoritar, unde este o experiență captivantă. Așa că cred că stigmatismul față de faptul că este ciudat și incomodă se va topi cu asta.”

Viitorul ochelarilor inteligenți și al realității augmentate rămâne neclar.

Unul dintre cei mai mari pași înainte va veni de la „lentile de ghidaj de undă”. În timp ce Glass afișează doar un mic flux video în colțul vederii tale, lentilele ghid de undă pot suprapune literalmente informații peste întregul tău câmp vizual, ca adevăratul Terminator ochelari. Vuzix a produs prototipuri timpurii ale acestei tehnologii și câteva modele scumpe destinate mediilor industriale, dar încă nu s-au redus la dimensiunea sau prețul Google Glass. Peck crede că ar putea dura cel puțin încă un an până când vom vedea acest nivel de afișare să ajungă la curentul principal.

Viitorul ochelarilor inteligenți și al realității augmentate rămâne neclar, dar următorii pași necunoscuti rămân parte din atractia pentru Peck și Fink.

„Este o nouă paradigmă de interacțiune. Sunt multe de înțeles - cum prezentați informațiile în cel mai intuitiv mod? Cum interacționezi cu ea? explică Peck. „Dar, în calitate de dezvoltator de aplicații, nu există convenții. Nu există cunoștințe despre cel mai bun mod de a prezenta informațiile care se află aici pe ecran. Sunt provocări interesante.”

Recomandările editorilor

- Digital Trends Live: noul Glass, Impossible Sausage de la Google și multe altele

Îmbunătățește-ți stilul de viațăDigital Trends îi ajută pe cititori să țină cont de lumea rapidă a tehnologiei cu toate cele mai recente știri, recenzii distractive despre produse, editoriale perspicace și anticipări unice.