Poliție predictivă trebuia să transforme modul în care se desfășura polițienești, introducându-ne într-o lume a legii inteligente aplicarea în care părtinirea a fost eliminată și poliția ar putea răspunde la date, nu la bănuieli. Dar la un deceniu după ce majoritatea dintre noi au auzit pentru prima dată termenul „poliție predictivă”, pare clar că nu a funcționat. Impulsată de o reacție publică, tehnologia se confruntă cu o scădere semnificativă a utilizării sale, comparativ cu doar câțiva ani în urmă.

Cuprins

- Promisiunea poliției predictive

- Algoritmi discriminatori

- Pericolele datelor murdare

- Viitorul incert al poliției predictive

- Instrumente greșite pentru muncă?

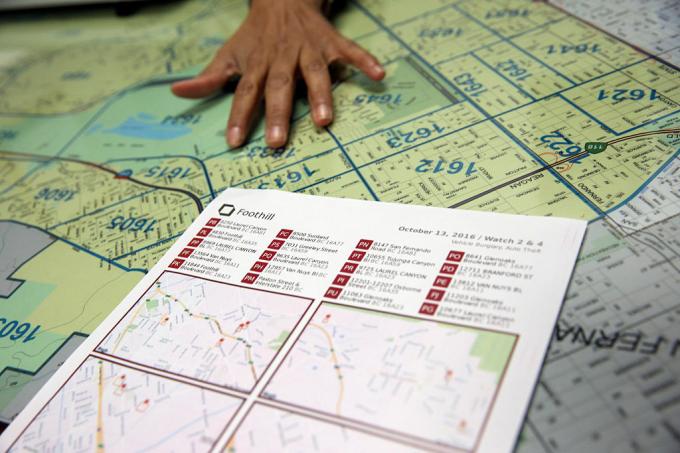

În aprilie anul acesta, Los Angeles – care, potrivit LA Times, „a fost pionier în prezicerea criminalității cu ajutorul datelor” – a redus finanțarea programului său de poliție predictivă, dând vina pe cost. „Este o decizie grea”, șeful poliției Michel Moore a spus LA Times. „Este o strategie pe care am folosit-o, dar costurile estimate de sute de mii de dolari de cheltuit în acest drept acum, față de găsirea acelor bani și direcționarea acelor bani către alte activități mai centrale este ceea ce trebuie să fac.”

Videoclipuri recomandate

Ce a mers prost? Cum ar putea ceva promovat ca tehnologie „inteligentă” să ajungă la consolidarea prejudecăților și a discriminării? Și este visul poliției predictive unul care ar putea fi ajustat cu algoritmul potrivit - sau un punct mort într-o societate mai echitabilă care se confruntă în prezent cu modul în care ar trebui să funcționeze poliția?

Promisiunea poliției predictive

Poliția predictivă în forma sa actuală datează de aproximativ un deceniu de la o lucrare din 2009 a psihologului Colleen McCue și șeful poliției din Los Angeles Charlie Beck, intitulată „Poliție predictivă: ce putem învăța de la Walmart și Amazon despre combaterea criminalității într-o recesiune?„În lucrare, aceștia au profitat de modul în care marile date erau folosite de marii retaileri pentru a ajuta la descoperirea tiparelor în comportamentul trecut al clienților care ar putea fi folosite pentru a prezice comportamentul viitor. Datorită progreselor atât în calcul, cât și în culegerea de date, McCue și Beck au sugerat că este posibil să se colecteze și să analizeze datele despre crime în timp real. Aceste date ar putea fi apoi utilizate pentru a anticipa, a preveni și a răspunde mai eficient la crimele care încă nu au avut loc.

În anii care au urmat, poliția predictivă a trecut de la o idee de aruncat la o realitate în multe părți ale Statelor Unite, împreună cu restul lumii. În acest proces, și-a propus să schimbe poliția dintr-o forță reactivă într-una proactivă; bazându-se pe unele dintre descoperirile din tehnologia bazată pe date, care fac posibilă identificarea tiparelor în timp real – și acționarea asupra lor.

„Există două forme principale de poliție predictivă”, Andrew Ferguson, profesor de drept la Universitatea din Districtul Columbia David A. Clarke School of Law și autorul Creșterea poliției de date mari: supraveghere, rasă și viitorul aplicării legii, a spus Digital Trends. „[Acestea sunt] poliție predictivă bazată pe loc și poliție predictivă bazată pe persoană.”

În ambele cazuri, sistemele de poliție predictivă atribuie un scor de risc persoanei sau locului în cauză, ceea ce încurajează poliția să urmărească la un interval dat. Prima dintre aceste abordări, poliția predictivă bazată pe loc, se concentrează în principal pe patrule de poliție. Aceasta implică utilizarea cartografierii criminalității și a analizelor despre locurile probabile ale crimelor viitoare, pe baza statisticilor anterioare.

În loc să ajute la scăparea de probleme precum rasismul și alte prejudecăți sistemice, poliția predictivă poate ajuta de fapt la consolidarea acestora.

A doua abordare se concentrează pe prezicerea probabilității ca un individ să prezinte un risc potențial viitor. De exemplu, în 2013, un comandant al poliției din Chicago a fost trimis la casa unui Robert McDaniel, în vârstă de 22 de ani, care fusese semnalat ca un potențial risc sau autor al violenței cu arme în centrul orașului Chicago de către un algoritm. „Lista de căldură” pe care a ajutat-o algoritmul la asamblare a căutat modele care ar putea fi capabile să prezică viitorii infractori sau victime, chiar dacă ei înșiși nu au făcut nimic care să justifice acest control în afară de conformarea la a profil.

Dupa cum a notat Chicago Tribune: „Strategia cere să-i avertizezi pe cei de pe lista de căldură în mod individual că continuarea activității criminale, chiar și pentru cele mai mici infracțiuni, va avea ca rezultat doborarea întregii forțe a legii lor."

Visul poliției predictive a fost că, acționând pe baza datelor cuantificabile, ar face poliția nu numai mai eficientă, ci și mai puțin predispusă la presupuneri și, în consecință, părtinire. Susținând susținătorii, ar schimba poliția în bine și ar deschide o nouă eră a poliției inteligente. Cu toate acestea, aproape de la început, poliția predictivă a avut critici fermi. Ei susțin că, în loc să ajute la scăparea de probleme precum rasismul și alte prejudecăți sistemice, poliția predictivă le poate ajuta de fapt să le înrădăcineze. Și este greu de argumentat că nu au rost.

Algoritmi discriminatori

Ideea că sistemele de poliție predictivă bazate pe învățarea automată pot învăța să discrimineze pe baza unor factori precum rasa nu este nimic nou. Instrumentele de învățare automată sunt antrenate cu cantități masive de date. Și, atâta timp cât acele date sunt adunate de un sistem în care rasa continuă să fie un factor copleșitor, asta poate duce la discriminare.

Ca Renata M. O’Donnell scrie într-o lucrare din 2019, intitulată „Contestarea algoritmilor de poliție predictivă rasistă în conformitate cu clauza de protecție egală”, algoritmii de învățare automată învață din date derivate dintr-un sistem de justiție în care „americanii de culoare sunt încarcerați în închisori de stat într-un ritm adică de 5,1 ori mai mult decât închisoarea albilor, iar unul din trei bărbați de culoare născuți astăzi se poate aștepta să meargă la închisoare în timpul vieții, dacă tendințele actuale. continua."

„Datele nu sunt obiective”, a spus Ferguson pentru Digital Trends. „Suntem doar noi reduceți la cod binar. Sistemele bazate pe date care funcționează în lumea reală nu sunt mai obiective, corecte sau imparțiale decât lumea reală. Dacă lumea reală este inegală din punct de vedere structural sau discriminatorie din punct de vedere rasial, un sistem bazat pe date va reflecta acele inechități societale. Intrările care intră sunt afectate de părtinire. Analiza este afectată de părtinire. Și mecanismele autorității de poliție nu se schimbă doar pentru că există tehnologie care ghidează sistemele.”

Ferguson dă exemplul arestărilor ca un factor aparent obiectiv în prezicerea riscului. Cu toate acestea, arestările vor fi denaturate de alocarea resurselor poliției (cum ar fi locul în care patrulează) și de tipurile de infracțiuni care justifică de obicei arestări. Aceasta este doar o ilustrare a datelor potențial problematice.

Pericolele datelor murdare

Datele lipsă și incorecte sunt uneori denumite în data mining „date murdare”. A Lucrarea din 2019 a cercetătorilor de la A.I. Acum Institutul de la Universitatea din New York extinde acest termen pentru a se referi și la datele care sunt influențate de corupte, părtinitoare și ilegale practici — fie că sunt manipulate în mod intenționat care sunt distorsionate de individ și prejudecățile societale. Ar putea, de exemplu, să includă date care sunt generate din arestarea unei persoane nevinovate căreia i s-au pus dovezi sau care este acuzată în mod fals.

Există o anumită ironie în faptul că, în ultimele decenii, solicitările societății datelor, în care totul este despre cuantificare și ținte numerice din fontă, tocmai a dus la o mulțime de... ei bine, într-adevăr date proaste. Serialul HBO Firul a prezentat fenomenul din lumea reală de a „juking the statistics”, iar anii de când serialul a ieșit în difuzare au oferit o mulțime de exemple de manipulare sistemică reală a datelor, rapoarte de poliție false și practici neconstituționale care au trimis oameni nevinovați la temniță.

Datele proaste care le permit oamenilor la putere să lovească artificial ținte sunt un lucru. Dar combină asta cu algoritmi și modele predictive care folosesc asta ca bază pentru modelarea lumii și poți obține ceva mult mai rău.

Cercetătorii au demonstrat cât de îndoielnice date despre criminalitate conectate la algoritmi predictivi de poliție pot crea ceea ce se numește „bucle de feedback fugitive”, în care polițiștii sunt trimiși în mod repetat în aceleași cartiere indiferent de rata reală a criminalității. Unul dintre co-autorii acelei lucrări, informaticianul Suresh Venkatasubramanian, spune că modelele de învățare automată pot construi ipoteze greșite prin modelarea lor. La fel ca vechea vorbă despre cum, pentru persoana cu un ciocan, fiecare problemă arată ca un cui, aceste sisteme modelează doar anumite elemente la o problemă - și își imaginează un singur rezultat posibil.

„[Ceva care] nu este abordat în aceste modele este în ce măsură modelați faptul că aruncarea mai multor polițiști într-o zonă poate de fapt scade calitatea vieții pentru oamenii care locuiesc acolo?” Venkatasubramanian, profesor la Școala de Calcul de la Universitatea din Utah, a declarat pentru Digital Tendințe. „Presupunem că mai mulți polițiști este un lucru mai bun. Dar, așa cum vedem acum, a avea mai multă poliție nu este neapărat un lucru bun. De fapt, poate înrăutăți lucrurile. În niciun model pe care l-am văzut vreodată, cineva nu a întrebat vreodată care este costul punerii mai multor polițiști într-o zonă.”

Viitorul incert al poliției predictive

Cei care lucrează în poliția predictivă folosesc uneori în mod unironic termenul „Raport minoritar” pentru a se referi la tipul de predicție pe care o fac. Termenul este frecvent invocat ca referire la Film din 2002 cu același nume, care, la rândul său, se baza pe o nuvelă din 1956 de Philip K. Dick. În Raport minoritar, un departament special de poliție PreCrime reține criminalii pe baza cunoașterii dinainte a crimelor care vor fi comise în viitor. Aceste previziuni sunt furnizate de trei psihici numiți „precogs”.

Dar răsucirea înăuntru Raport minoritar este că previziunile nu sunt întotdeauna exacte. Viziunile divergente ale unuia dintre precog oferă o viziune alternativă asupra viitorului, care este suprimată de teama de a nu face sistemul să pară nedemn de încredere.

Auditurile interne care arată că tactica nu a funcționat. Nu numai că listele de predicții erau viciate, dar erau și ineficiente.

În acest moment, poliția predictivă se confruntă cu propriul viitor incert. Pe lângă noile tehnologii, cum ar fi recunoașterea facială, tehnologia disponibilă pentru aplicarea legii pentru o posibilă utilizare nu a fost niciodată mai puternică. În același timp, conștientizarea utilizării poliției predictive a provocat o reacție publică care ar fi putut, de fapt, să fi ajutat la anularea acesteia. Ferguson a declarat pentru Digital Trends că utilizarea instrumentelor de predicție a poliției a fost în „în scădere” în ultimii câțiva ani.

„La apogeul său, [poliția predictivă bazată pe loc] a fost în peste 60 de orașe mari și în creștere, dar ca urmare a organizarea comunității de succes, aceasta a fost în mare parte redusă și sau înlocuită cu alte forme de date bazate pe date analitice”, a spus el. „Pe scurt, termenul de poliție predictivă a devenit toxic, iar departamentele de poliție au învățat să redenumească ceea ce făceau cu date. Poliția predictivă bazată pe persoană a avut o cădere mai abruptă. Cele două orașe principale care au investit în crearea sa - Chicago și Los Angeles - și-au dat înapoi bazate pe persoană strategii după critici ascuțite ale comunității și audituri interne devastatoare care arată că tacticile nu au făcut-o muncă. Nu numai că listele de predicții au fost defecte, ci și ineficiente.”

Instrumente greșite pentru muncă?

In orice caz, Rashida Richardson, Director Cercetare Politică la A.I. Acum Institutul a spus că există prea multă opacitate cu privire la utilizarea acestei tehnologii. „Încă nu știm din cauza lipsei de transparență în ceea ce privește achiziția guvernamentală de tehnologie și multe lacune în procedurile de achiziții existente care pot proteja anumite achiziții de tehnologie de controlul public.” ea a spus. Ea dă exemplu de tehnologie care ar putea fi oferită gratuit unui departament de poliție sau cumpărată de o terță parte. „Știm, din cercetări precum a mea și din mass-media, că multe dintre cele mai mari departamente de poliție din SUA au folosit tehnologia la un moment dat, dar există și multe departamente de poliție mici care o folosesc sau au folosit-o pentru perioade limitate de timp.”

Având în vedere interogarea actuală cu privire la rolul poliției, va exista o tentație de a reimbraționa Poliția predictivă ca instrument pentru luarea deciziilor bazate pe date – poate în condiții științifico-fantastice mai puțin distopice branding? Există posibilitatea ca o astfel de renaștere să poată apărea. Dar Venkatasubramanian este foarte sceptic că învățarea automată, așa cum este practicată în prezent, este instrumentul potrivit pentru această meserie.

„Întregul proces de învățare automată și succesul său în societatea modernă se bazează pe premisa că, indiferent de realitate problema, în cele din urmă se rezumă la a colecta date, a construi un model, a prezice rezultatul - și nu trebuie să vă faceți griji pentru domeniu.” el a spus. „Puteți să scrieți același cod și să-l aplicați în 100 de locuri diferite. Aceasta este promisiunea de abstractizare și portabilitate. Problema este că atunci când folosim ceea ce oamenii numesc sisteme socio-tehnice, unde ai oameni și tehnologia împletite în valuri complicate, nu poți face asta. Nu puteți pur și simplu să conectați o piesă și să vă așteptați să funcționeze. Pentru că [există] efecte de ondulare la introducerea acelei piese și faptul că sunt diferite jucători cu agende diferite într-un astfel de sistem și subminează sistemul în funcție de propriile nevoi căi diferite. Toate aceste lucruri trebuie luate în considerare atunci când vorbiți despre eficacitate. Da, poți spune în abstract că totul va funcționa bine, dar acolo este nici un abstract. Există doar contextul în care lucrezi.”