Chcesz poznać nazwę kwiatu lub ptaka, który spotkasz podczas spaceru po parku? Już niedługo Asystent Google będzie mógł Ci to powiedzieć, korzystając z aparatu i sztucznej inteligencji.

Polecane filmy

Google szybko rozpoczęło rok 2017 Konferencja we/wy wokół sztucznej inteligencji i uczenia maszynowego, a jedną z technologii widzenia komputerowego, na którą zwrócił uwagę, jest Google Lens, który umożliwia aparat potrafi więcej niż tylko przechwytywanie obrazu — zapewnia szerszy kontekst tego, co widzisz.

Zbliża się do Asystent Google I Zdjęcia Googletechnologia Google Lens może „zrozumieć, na co patrzysz i pomóc Ci podjąć działania” – powiedział podczas przemówienia dyrektor generalny Google, Sundar Pichai. Jeśli na przykład skierujesz aparat na namiot sali koncertowej, Asystent Google może Ci powiedzieć więcej na temat: wykonawcy, a także odtwarzać muzykę, pomóc w zakupie biletów na spektakl i dodać go do swojego kalendarza, a wszystko to w ciągu jednego dnia pojedyncza aplikacja.

Gdy aparat jest skierowany na nieznany obiekt, Asystent Google, rozpoznając obraz, może Ci powiedzieć, co to jest. Skieruj go na szyld sklepu, a korzystając z informacji o lokalizacji, możesz uzyskać istotne informacje o firmie. Wszystko to można zrobić poprzez „konwersacyjną” interakcję głosową użytkownika z Asystentem.

„Możesz skierować na niego telefon, a my automatycznie wykonamy całą ciężką pracę za Ciebie” – powiedział Pichai.

Dzięki Obiektywowi Google Twoje smartfon Kamera nie tylko zobaczy to, co Ty, ale także zrozumie, co widzisz, co pomoże Ci podjąć odpowiednie działania. #io17pic.twitter.com/viOmWFjqk1

— Google (@Google) 17 maja 2017 r

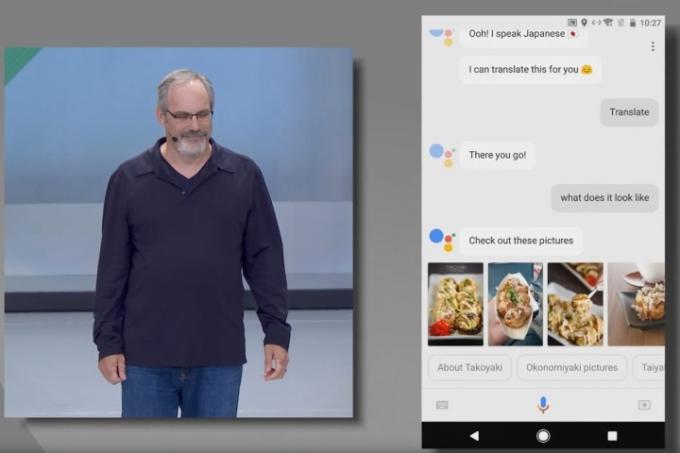

Jeśli korzystasz z aplikacji Tłumacz Google, widziałeś już, jak działa ta technologia: umieść aparat nad tekstem, a aplikacja przetłumaczy go na język, który rozumiesz. W Asystencie Google Google Lens zajmie się tym dalej. Google pokazało to podczas demonstracji

Technologia rozpoznawania obrazów nie jest nowa, ale Google Lens pokazuje, jak zaawansowane staje się uczenie maszynowe. Pichai powiedział, że podobnie jak w przypadku prac nad mową, Google obserwuje znaczną poprawę widzenia. Technologia widzenia komputerowego nie tylko pomaga rozpoznać, czym coś jest, ale może nawet pomóc naprawić lub ulepszyć obraz. Zrobiłeś niewyraźne zdjęcie Wieży Eiffla? Ponieważ komputer rozpoznaje obiekt i wie, jak powinien wyglądać, może automatycznie poprawić ten obraz w oparciu o to, co już wie.

„Możemy zrozumieć atrybuty zdjęcia” – powiedział Pichai. „Nasze komputerowe systemy wizyjne są obecnie nawet lepsze od ludzi w rozpoznawaniu obrazów”.

Aby Lens był skuteczny w swojej pracy, Google wykorzystuje wyrafinowaną architekturę obliczeniową Chipsety Cloud Tensor Processing Unit (TPU) do obsługi uczenia i wnioskowania dla swojej maszyny uczenie się. Technologia TPU drugiej generacji może obsłużyć 180 bilionów operacji zmiennoprzecinkowych na sekundę; 64 płyty TPU w jednym superkomputerze mogą obsłużyć 11,5 petaflopów. Dzięki tej mocy obliczeniowej nowy TPU może jednocześnie obsługiwać zarówno szkolenie, jak i wnioskowanie, co nie było możliwe było to możliwe w przeszłości (poprzedni TPU mógł obsługiwać tylko wnioskowanie, ale nie bardziej złożone szkolenie). Uczenie maszynowe wymaga czasu, ale ten sprzęt pomoże przyspieszyć ten wysiłek.

Google Lens będzie także zasilać następną aktualizację Zdjęć Google. Rozpoznawanie obrazów jest już używane w aplikacji Zdjęcia do rozpoznawania twarzy, miejsc i rzeczy, co ułatwia organizację i wyszukiwanie. Dzięki Obiektywowi Google Zdjęcia Google mogą dostarczyć Ci więcej informacji na temat obiektów na zdjęciach, np. nazwy i opisu budynku. dotknięcie numeru telefonu na zdjęciu spowoduje nawiązanie połączenia i wyświetlenie dodatkowych informacji na temat dzieła sztuki, które widziałeś w muzeum, a nawet wprowadź hasło Wi-Fi automatycznie ze zdjęcia zrobionego z tyłu Wi-Fi routera.

Asystent i Zdjęcia będą pierwszymi aplikacjami korzystającymi z Google Lens, ale zostanie ona wdrożona w innych aplikacjach. Wraz z ogłoszeniem wsparcia dla Asystenta w systemie iOS użytkownicy iPhone'a będą mogli również korzystać z technologii Google Lens.

Zalecenia redaktorów

- Nie, naprawdę nie potrzebujesz Asystenta Google na swoim smartwatchu

- 5 rzeczy, które chcielibyśmy zobaczyć na Google I/O 2023 (ale prawdopodobnie nie zobaczymy)

- Konferencja Google I/O 2023 odbędzie się 10 maja i będzie miała charakter wydarzenia osobistego

- iPhone 14 Pro vs. Walka o aparat w Google Pixel 7 Pro jest niewiarygodnie zacięta

- Ta nowa funkcja Google Lens wygląda jak wyjęta prosto z filmu science-fiction

Ulepsz swój styl życiaDigital Trends pomaga czytelnikom śledzić szybko rozwijający się świat technologii dzięki najnowszym wiadomościom, zabawnym recenzjom produktów, wnikliwym artykułom redakcyjnym i jedynym w swoim rodzaju zajawkom.