Dobre wieści? Dla przeważającej większości ludzi są one nadal nierozpoznawalne. Złe wiadomości? Nie oszukają współczesnej informatyki.

Polecane filmy

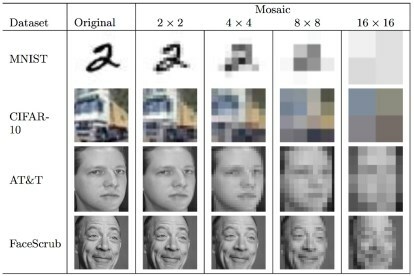

Informacje te wynikają z nowego projektu przeprowadzonego przez naukowców z Uniwersytetu Teksasu w Austin i Uniwersytetu Cornell, w którym wykorzystano głęboka nauka Do poprawnie odgadnąć zredagowane tożsamości osób ukrytych poprzez zaciemnienie. Podczas gdy człowiek odgadł zredagowaną tożsamość poprawnie w 0,19% przypadków, system uczenia maszynowego był w stanie dokonać prawidłowej oceny z 83% dokładnością po pięciu próbach.

„Rozmycie i pikselizacja są często wykorzystywane do ukrywania tożsamości ludzi na zdjęciach i filmach” Witalij Szmatikow, profesor informatyki na Uniwersytecie Cornell, powiedział Digital Trends. „W wielu z tych scenariuszy przeciwnik ma całkiem dobre pojęcie o małej grupie możliwych osób którzy mogli pojawić się na obrazie, a on musi tylko dowiedzieć się, którzy z nich się na nim znajdują zdjęcie."

To właśnie – kontynuował Szmatikow – jest dokładnie taki scenariusz, w którym technologia zespołu sprawdza się dobrze. „To pokazuje, że rozmycie, pikselacja i inne metody zaciemniania obrazu mogą nie zapewniać wystarczającej ochrony, gdy ujawnienie czyjejś tożsamości narażałoby tę osobę na ryzyko” – stwierdził.

Wyzwanie polega oczywiście na tym, że często takie metody zatajania tożsamości danej osoby wykorzystuje się w celu ochrony danej osoby, na przykład sygnalisty lub świadka przestępstwa. Stosując takie algorytmy rozpoznawania obrazu, oparte na sztuczne sieci neuronowedo obrazów, które w związku z tym zostały zaciemnione przy użyciu gotowych narzędzi, potencjalnie mogą narazić ludzi na niebezpieczeństwo.

„Podstawowym wyzwaniem jest wypełnienie luki między technologiami ochrony prywatności a uczeniem maszynowym” – powiedział Shmatikov. „Wielu projektantów technologii prywatności nie w pełni docenia siłę współczesnego uczenia maszynowego, a to prowadzi do technologii, które w rzeczywistości nie chronią prywatności”.

Zalecenia redaktorów

- Nie płać podatku Verizon 5G za Google Pixel 4a 5G

- Nie mów: to urządzenie do noszenia pozwala wydawać polecenia głosowe bez wypowiadania słów

- Nie daj się zwieść — ten zautomatyzowany system podstępnie manipuluje treścią wideo

Ulepsz swój styl życiaDigital Trends pomaga czytelnikom śledzić szybko rozwijający się świat technologii dzięki najnowszym wiadomościom, zabawnym recenzjom produktów, wnikliwym artykułom redakcyjnym i jedynym w swoim rodzaju zajawkom.