«Alder til A.I. har begynt», erklærte Nvidia-sjef Jensen Huang på årets GTC. På sin GPU-teknologikonferanse i år viste Nvidia frem sin innovasjon for å fremme A.I., og la merke til hvordan teknologien kunne bidra til å løse verdens problemer 10 ganger bedre og raskere.

Innhold

- Nok en unnskyldning for lanseringen av RTX 3080/3090

- Nvidia Omniverse er en treningsplass for roboter

- Nvidia RTX A6000: Strålesporing for profesjonelle

- Fremveksten av A.I. roboter

- A.I. for fremtiden for arbeid hjemmefra

- Bringe et datasenter til en ARM-brikke

- Personlig tilpassede anbefalingsmotorer

- A.I. for all IoT

- Fremover ARM

Mens Nvidia er mest kjent for sitt grafikkort - og mer nylig assosiert med sanntid strålesporing – selskapet driver også bak kulissene innovasjonen som bringer kunstig intelligens inn i hverdagen vår, fra lagerroboter som pakker fraktbestillingene våre til selvkjørende biler og roboter på naturlig språk som leverer nyheter, søk og informasjon med liten forsinkelse eller forsinkelse.

"Vi elsker å jobbe med ekstremt harde dataproblemer som har stor innvirkning på verden," sa Huang og bemerket at selskapet nå har 110 SDK-er som er rettet mot de mer enn 1 milliard CUDA-kompatible GPUene som har blitt sendt. Selskapet sier at mer enn 6500 startups bygger applikasjoner på Nvidia, og slutter seg til de 2 millioner Nvidia-utviklerne totalt. «Dette er rett i styrehuset vårt. Vi er alle inne for å fremme og demokratisere denne nye formen for databehandling for A.I. Nvidia er dedikert til å fremme akselerert databehandling."

I slekt

- Nvidia bringer ChatGPT-stil AI til videospill, og jeg er allerede bekymret

- Jeg presenterte min latterlige oppstartside til en robot-VC

- Analog A.I.? Det høres sprøtt ut, men det kan være fremtiden

Nok en unnskyldning for lanseringen av RTX 3080/3090

Huang ledet med nok en rask unnskyldning om den vanskelige lanseringen av Nvidia RTX 3080 og 3090 skjermkort. Les mer her.

Anbefalte videoer

Nvidia Omniverse er en treningsplass for roboter

For spillere,

Nå tilgjengelig i åpen beta, Nvidia Omniverse er en åpen plattform for samarbeid og simulering der roboter kan lære av realistiske simuleringer av den virkelige verden. Ved å bruke Omniverse kan autonome kjøretøy raskt lære å kjøre og samhandle med virkelige scenarier menneskelige sjåfører kan møte, uten risiko for å sette tilskuere i fare hvis eksperimentet går sidelengs. Omniverse tillater også testing i mye større skala, siden et autonomt kjøretøy eller robot ikke trenger å være fysisk utplassert for å teste det.

For å vise hvordan Nvidia Omniverse kan påvirke oss alle, fremhevet Nvidia hvordan Omniverse kan fungere i legemiddeloppdagelse, som er et enda viktigere forskningsområde gitt den globale pandemien. Selv om det vanligvis tar mer enn et tiår å utvikle adug og krever mer enn en halv milliard dollar i forsknings- og utviklingsfinansiering, mislykkes 90 % av denne innsatsen, sa Huang. For å gjøre vondt verre, dobles kostnadene ved å oppdage nye legemidler hvert niende år.

Nvidias Omniverse kan hjelpe forskere med å identifisere proteinene som kan forårsake sykdom, samt fremskynde testing av potensielle medisiner ved å bruke A.I. og dataanalyse. Alt dette brukes på Nvidias nye Clara Discovery-plattform. Og i Storbritannia introduserte Nvidia sitt nye Cambridge One-datasenter, som selskapet sier er det raskeste i regionen og en av de 30 beste i verden, med 400 petaflops av A.I. opptreden.

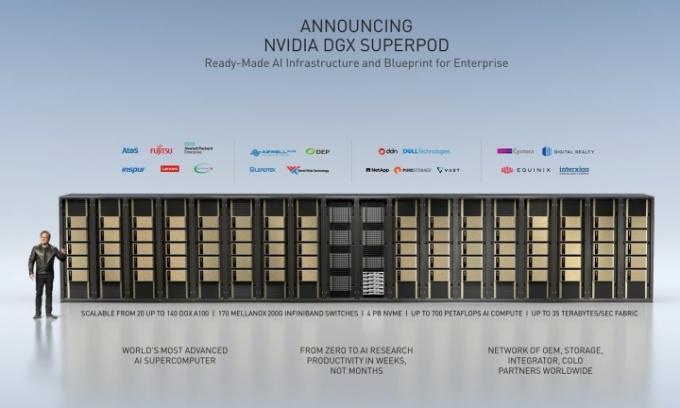

Selskapet introduserte også sin nye DGX Super Pod-arkitektur, for å la andre forskere bygge sine egne skalerbare superdatamaskiner som kobler mellom 20 til 140 DGX-systemer.

Nvidia RTX A6000: Strålesporing for profesjonelle

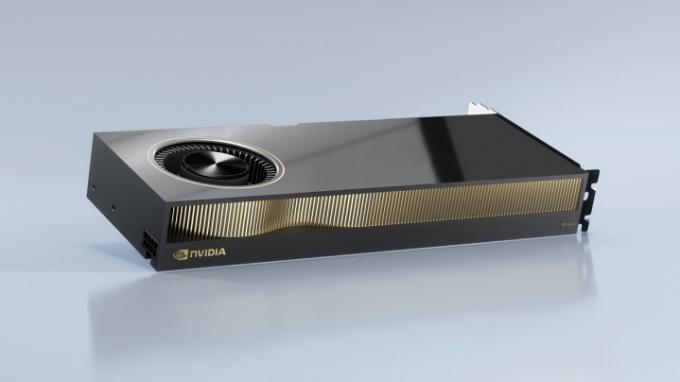

Utvider på de nylig annonserte GeForce RTX 3070, RTX 3080 og RTX 3090 grafikkort, kunngjorde Nvidia en ny generasjon Ampere-baserte GPUer for profesjonelle. Den nye

"GPU-ene gir hastigheten og ytelsen som gjør det mulig for ingeniører å utvikle innovative produkter, designere for å lage toppmoderne bygninger, og forskere til å oppdage gjennombrudd fra hvor som helst i verden," uttalte selskapet i et blogginnlegg, og la merke til at de nye A6000 og A40 har nye RT-kjerner, Tensor-kjerner og CUDA-kjerner som er "betydelig raskere enn de forrige generasjoner."

Selskapet ga ikke spesifikke detaljer om maskinvaren. Nvidia hevdet imidlertid at andregenerasjons RT-kjerner leverer 2x gjennomstrømmingen til tidligere generasjonskort, samtidig som de gir samtidige

Kortene leveres med 48 GB GPU-minne som kan utvides til 96 GB med NVLink når to GPUer er tilkoblet. Dette sammenlignet med bare 24 GB minne på RTX 3090. Mens RTX 3090 markedsføres som en GPU som er i stand til å gjengi spill i 8K med 60 bilder per sekund (fps), utvidet minne på de profesjonelle RTX A6000 og A40 hjelper til med å behandle Blackmagic RAW 8K og 12K-opptak for video redigering. I likhet med Ampere-kortene for forbrukere er A6000 og A40 GPUene basert på PCIe Gen 4, som leverer dobbelt så mye båndbredde som forrige generasjon.

De A40-baserte serverne vil være tilgjengelige i systemer fra Cisco, Dell, Fujitsu, Hewlett Packard Enterprise og Lenovo. A6000 GPUene kommer til kanalpartnere, og begge GPUene vil være tilgjengelig tidlig neste år. Prisdetaljer var ikke umiddelbart tilgjengelig, og det er uklart om de profesjonelle kortene vil se det samme begrenset tilbud og stor mangel som Nvidia opplevde med lanseringen av sine forbrukerkort.

Fremveksten av A.I. roboter

Nvidia fremhevet også hvordan arbeidet med GPU-er bidrar til å øke hastigheten på A.I. utvikling og adopsjon. Facebook's A.I. forskere har utviklet en chatbot med kunnskap og empati som halvparten av det sosiale nettverkets brukere faktisk foretrakk. California Institute of Technology-forskere trente en drone ved å bruke forsterkningslæring for å kontrollere flysystemet for å fly jevnt gjennom turbulens og endringer i terrenget.

Nvidias A.I. er basert på tre pilarer: Enkelt- til multi-GPU-noder på et hvilket som helst rammeverk eller modell, bruk av slutninger og bruk av forhåndstrente modeller, sa Huang.

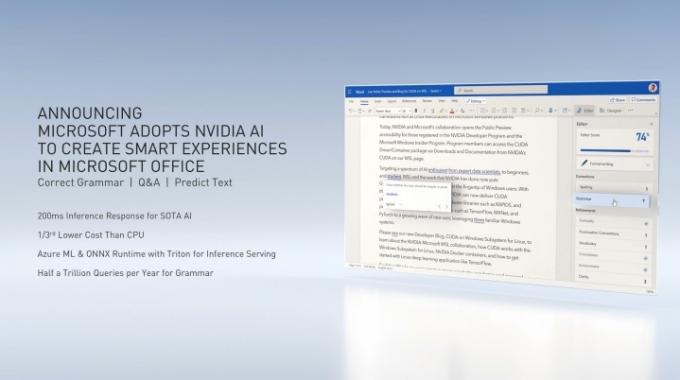

Nvidia kunngjorde også at de har inngått samarbeid med Microsoft for å bringe Nvidia A.I. til Azure for å gjøre Office smartere.

"I dag kunngjør vi at Microsoft tar i bruk Nvidia A.I. på Azure, for å drive smarte opplevelser i Microsoft Office,» sa Huang under keynoten. "Verdens mest populære produktivitetsapplikasjon brukt av hundrevis av millioner vil nå være A.I.-assistert. De første funksjonene vil inkludere smart grammatikkkorrigering, spørsmål og svar, tekstprediksjon. På grunn av antallet brukere og den umiddelbare responsen som trengs for en god opplevelse, vil Office være koblet til Nvidia GPUer, og Azure med Nvidia GPU-er tar mindre enn 200 millisekunder. Gjennomstrømningen vår lar Microsoft skalere til millioner av brukere samtidig.»

American Express bruker også A.I. for å bekjempe svindel, mens Twitter utnytter kunstig intelligens for å hjelpe den med å forstå og kontekstualisere den enorme mengden videoer som lastes opp til plattformen.

Med konversasjons-AI har resultater fra taleforespørsler utført på Nvidias GPU-plattform halvparten ventetid sammenlignet med CPU-behandlede spørringer og også mer realistisk, menneskelignende tekst-til-tale motorer. Nvidia annonserte også en åpen beta av Jarvis for utviklere å prøve A.I. med samtaleferdigheter.

A.I. for fremtiden for arbeid hjemmefra

A.I. kan også bygges inn i applikasjoner som videokonferanse- og chatteløsninger som hjelper arbeidere med å samarbeide eksternt. Med Nvidias Video Maxene sa Huang at A.I. kan gjøre magi for videosamtaler.

Maxene kan identifisere de viktige egenskapene til et ansikt, sende bare endringene av funksjonene over internett, og deretter gjenopplive ansiktet ved mottakeren. Dette sparer båndbredde, noe som gir en bedre videoopplevelse i områder med dårlig Internett-tilkobling. Huang hevdet at båndbredden er redusert med en faktor på 10.

A.I. gjøre samtaler bedre selv i områder med høy båndbredde. I det mest ekstreme eksempelet er A.I. kan brukes til å omorientere ansiktet ditt slik at du får øyekontakt med alle personer i en samtale, selv når ansiktet ditt er vippet litt bort fra kameraet. A.I. kan også redusere bakgrunnsstøy, lyse opp ansiktet ditt på nytt, erstatte bakgrunnen og forbedre videokvaliteten i dårlig belysning. Kombinert med Jarvis A.I. tale, kan Maxene også levere underteksttekst.

"Vi har en mulighet til å revolusjonere dagens videokonferanser og finne opp morgendagens virtuelle tilstedeværelse," sa Huang. «Og video A.I. slutningsapplikasjoner kommer fra alle bransjer."

Bringe et datasenter til en ARM-brikke

Nvidia fremhevet sin investering i ARM-brikker, og kunngjorde de nye BlueField DPU-ene, som gir kraften til en datasenter-infrastruktur-på-en-brikke og støttes av DOCA, som er arkitektur.

De nye BlueField 2 DPU-ene laster av kritiske komponenter – som nettverk og lagring – samt sikkerhetsoppgaver fra prosessoren for å forhindre cyberangrep.

"En enkelt BlueField-2 DPU kan levere de samme datasentertjenestene som kan forbruke opptil 125 CPU-kjerner," hevdet Nvidia i en forberedt uttalelse. "Dette frigjør verdifulle CPU-kjerner for å kjøre et bredt spekter av andre bedriftsapplikasjoner." Selskapet sa at minst 30% av CPU var tidligere konsumert av å kjøre datasenterinfrastruktur, og disse kjernene er nå frigjort ettersom oppgaven nå er overført til BlueField DPU.

En andre Bluefield 2X DPU kommer også med Nvidia Ampere-basert GPU-teknologi. Ampere bringer A.I. til BlueField 2X for å gi sanntids sikkerhetsanalyse og identifisere ondsinnet aktivitet.

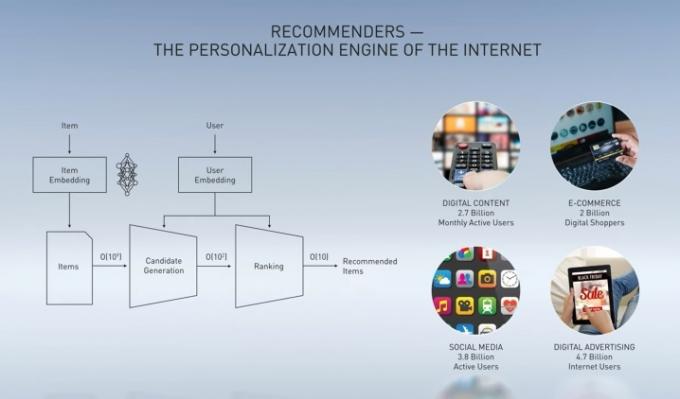

Personlig tilpassede anbefalingsmotorer

A.I. kan brukes til å levere personlige anbefalinger av digitale og fysiske varer på plattformer, vise relevante digitale annonser, nyheter og filmer. Nvidia hevdet at selv en forbedring på 1 % i anbefalingsnøyaktighet kan utgjøre flere milliarder i salg og høyere kundebevaring.

For å hjelpe bedrifter med å forbedre sin anbefalingsmotor, introduserte Nvidia Merlin, som drives av Nvidia Rapids-plattformen. Mens CPU-baserte løsninger kan ta dager å lære, sies Merlin å være superraske og superskalerbare, med syklustider som går fra en dag til bare tre timer. Merlin er nå i åpen beta, sa Huang.

Rapids brukes av Adobe til intelligent markedsføring, mens Capital One bruker plattformen for svindelanalyse og for å drive selskapets Eno chatbot.

A.I. for all IoT

Nvidias EGX-plattform brukes til å bringe A.I. å kante enheter for å lage A.I. mer responsive for Internet of Things, eller IoT, applikasjoner. EGX er tilgjengelig på Nvidias NGC, og den brukes av sykehus som Northwestern Memorial Hospital for å overføre noen oppgaver til datamaskiner som rutinemessig utføres av sykepleiere. Pasienter kan for eksempel bruke naturlig språk for å spørre en bot hvilken prosedyre de har.

«EGX A.I. datamaskinen integrerer en Mellanox Bluefield 2 GPU og en Ampere GPU til ett enkelt PCI Express-kort, og gjør enhver standard OEM-server til en sikker akselerert A.I. datasenter," sa Huang.

Plattformen kan utnyttes innen helsevesen, produksjon, logistikk, levering, detaljhandel og transport.

Fremover ARM

"I dag. vi kunngjør et stort initiativ for å fremme ARM-plattformen," sa Huang om selskapets annonserte oppkjøp av ARM, ingenting som gjør investeringer i tre dimensjoner.

"For det første kompletterer vi ARM-partnere med GPU-, nettverks-, lagrings- og sikkerhetsteknologier for å skape komplette akselererte plattformer. For det andre jobber vi med partnerne våre for å lage plattformer for HPC cloud edge NPC. Dette krever brikkesystemer og systemprogramvare. Og for det tredje, vi porterer Nvidia A.I. og Nvidia RTX-motorer til ARM.»

Foreløpig er dette kun tilgjengelig på x86-plattformen. Imidlertid vil Nvidias investering i ARm transformere den i forkant og akselerere den i A.I. databehandling, sa Huang, mens han ser ut til å posisjonere ARM som en konkurrent til Intel i serverområdet.

Redaktørenes anbefalinger

- Nvidias superdatamaskin kan bringe en ny æra av ChatGPT

- Nvidia GPUer ser massiv prisøkning og stor etterspørsel fra AI

- Zooms A.I. teknologi for å oppdage følelser under samtaler opprører kritikere

- Nvidia avslører første gangs CPU og Hopper GPU på GTC 2022

- Hvordan Nvidia bruker A.I. for å hjelpe Domino's med å levere pizza raskere