Om de titel van een bekend tv-programma enigszins aan te passen: Kinderen doen de gekste dingen. Onlangs hebben onderzoekers uit Duitsland en Groot-Brittannië een onderzoek uitgevoerd: gepubliceerd in het tijdschrift Wetenschap Robotica, waaruit bleek in hoeverre kinderen vatbaar zijn voor groepsdruk van robots. TLDR-versie: het antwoord op die oude ouderlijke vraag: “Als al je vrienden je zouden vertellen van een klif te springen, zou je dat dan doen?” zou wel eens kunnen zijn: “Zeker. Als al mijn vrienden robots waren.”

Inhoud

- Zijn volwassenen werkelijk zoveel slimmer?

- Voor elk schip is er een scheepswrak

De test voerde een beroemd experiment uit 1951 na, ontwikkeld door de Poolse psycholoog Solomon Asch. Het experiment liet zien hoe mensen kunnen worden beïnvloed door de druk van groepsdenken, zelfs als dit in strijd is met informatie waarvan ze weten dat deze juist is. In de experimenten van Asch werd een groep studenten bijeengebracht en twee kaarten getoond. Op de kaart aan de linkerkant stond een afbeelding van een enkele verticale lijn. Op de kaart rechts stonden drie regels van verschillende lengte. Vervolgens vroeg de onderzoeker aan de deelnemers welke lijn op de rechterkaart overeenkwam met de lengte van de lijn op de linkerkaart.

Aanbevolen video's

“Het bijzondere aan kinderen in deze leeftijdscategorie is dat ze nog steeds op een leeftijd zijn waarop ze hun ongeloof kunnen opschorten.”

Tot nu toe zo eenvoudig. Waar het echter slinkser werd, was de samenstelling van de groep. Slechts één persoon uit de groep was een echte deelnemer, terwijl de anderen allemaal acteurs waren, aan wie vooraf was verteld wat ze moesten zeggen. Het experiment was bedoeld om te testen of de echte deelnemer mee zou gaan met de rest van de groep als ze unaniem het verkeerde antwoord gaven. Het bleek dat de meesten dat wel zouden doen. Groepsdruk betekent dat de meerderheid van de mensen informatie zal ontkennen die duidelijk correct is als dit betekent dat ze zich moeten conformeren aan de mening van de meerderheid.

Verwant

- Evoluerende, zichzelf replicerende robots zijn er – maar maak je geen zorgen over een opstand

- Robots komen je baan niet stelen. Ze komen het verbeteren

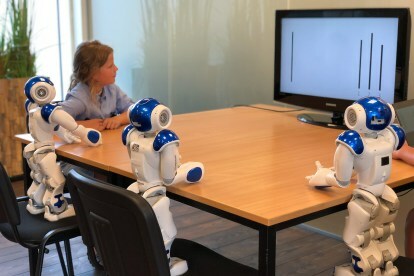

In de remix van het experiment uit 2018 werd hetzelfde principe gebruikt: alleen in plaats van een groep leeftijdsgenoten op de universiteit was de ‘echte deelnemer’ een kind van zeven tot negen jaar oud. De ‘acteurs’ werden gespeeld door drie robots, geprogrammeerd om het verkeerde antwoord te geven. In een steekproef van 43 vrijwilligers gaf 74 procent van de kinderen hetzelfde onjuiste antwoord als de robots. De resultaten suggereren dat de meeste kinderen van deze leeftijd de druk van robots op dezelfde manier zullen behandelen als de groepsdruk van hun leeftijdsgenoten van vlees en bloed.

“Het bijzondere aan kinderen in deze leeftijdscategorie is dat ze nog steeds op een leeftijd zijn waarop ze hun ongeloof kunnen opschorten,” Tony Belpaeme, zegt hoogleraar Intelligente en Autonome Controlesystemen, die hielp bij de uitvoering van het onderzoek, tegen Digital Trends. “Ze zullen met speelgoed spelen en nog steeds geloven dat hun actiefiguren of poppen echt zijn; ze kijken nog steeds naar een poppenspel en geloven echt wat er gebeurt; ze geloven misschien nog steeds in [Santa Claus]. Hetzelfde geldt als ze naar een robot kijken: ze zien geen elektronica en plastic, maar eerder een sociaal karakter.”

Interessant genoeg contrasteerde het experiment dit met de reactie van volwassenen. In tegenstelling tot de kinderen lieten volwassenen zich niet beïnvloeden door de fouten van de robots. “Toen een volwassene zag dat de robot het verkeerde antwoord gaf, keken ze hem verbaasd aan en gaven vervolgens het juiste antwoord”, vervolgde Belpaeme.

Dus niets om je zorgen over te maken dan? Zolang we voorkomen dat kinderen robots in handen krijgen die geprogrammeerd zijn om slechte reacties te geven, zou alles in orde moeten zijn, toch? Wees niet zo snel.

Zijn volwassenen werkelijk zoveel slimmer?

Zoals Belpaeme erkende, was deze taak zo eenvoudig ontworpen dat er geen onzekerheid bestond over het antwoord. De echte wereld is anders. Als we nadenken over het soort werk dat gemakkelijk aan machines kan worden overgedragen, zijn dit vaak taken die wij als mensen niet altijd perfect kunnen uitvoeren.

Deze taak was zo eenvoudig ontworpen dat er geen onzekerheid bestond over het antwoord.

Het kan zijn dat de taak ongelooflijk eenvoudig is, maar dat de machine deze aanzienlijk sneller kan uitvoeren dan wij. Of het kan een complexere taak zijn, waarbij de computer toegang heeft tot veel grotere hoeveelheden gegevens dan wij. Afhankelijk van de potentiële impact van de klus die voor u ligt, is het geen verrassing dat velen van ons ontevreden zouden zijn over het corrigeren van een machine.

Zou een verpleegster in een ziekenhuis blij zijn met het terzijde schuiven van de Door de FDA goedgekeurd algoritme die kunnen helpen prioriteiten te stellen over de gezondheid van patiënten door vitale functies te monitoren en vervolgens waarschuwingen naar medisch personeel te sturen? Of zou een bestuurder zich op zijn gemak voelen als hij het stuur overneemt van een zelfrijdende auto als hij te maken heeft met een bijzonder complex wegscenario? Of zelfs een piloot die de automatische piloot negeert omdat hij denkt dat er een verkeerde beslissing wordt genomen? In al deze gevallen zouden we graag denken dat het antwoord ‘ja’ is. Maar om allerlei redenen is dat misschien niet de realiteit.

Nicholas Carr schrijft hierover in zijn boek uit 2014 De glazen kooi: waar automatisering ons naartoe brengt. De manier waarop hij het beschrijft onderstreept het soort dubbelzinnigheid dat echte automatiseringsgevallen met zich meebrengen, waar de problemen liggen veel complexer dan de lengte van een lijn op een kaart, de machines zijn veel slimmer en de uitkomst is potentieel meer cruciaal.

“Hoe meet je de kosten van een erosie van inspanning en betrokkenheid, of een afname van keuzevrijheid en autonomie, of een subtiele verslechtering van vaardigheden? Dat kan niet”, schrijft hij. “Dit zijn het soort schimmige, ongrijpbare dingen die we zelden waarderen totdat ze verdwenen zijn, en zelfs dan kunnen we moeite hebben om de verliezen concreet uit te drukken.”

“Dit zijn het soort schimmige, ongrijpbare dingen die we zelden waarderen totdat ze verdwenen zijn.”

Sociale robots van het soort waar Belpaeme in het onderzoeksartikel over theoretiseert, zijn nog niet mainstream, maar er zijn al voorbeelden van enkele van deze raadsels in actie. Carr opent zijn boek bijvoorbeeld met vermelding van een memo van de Federal Aviation Administration waarin wordt opgemerkt dat piloten minder tijd zouden moeten besteden aan het vliegen op de automatische piloot vanwege de risico's die dit met zich meebrengt. Dit was gebaseerd op analyse van crashgegevens, waaruit bleek dat piloten vaak te sterk afhankelijk zijn van geautomatiseerde systemen.

Een soortgelijke zaak betrof een rechtszaak uit 2009 waarin een vrouw genaamd Lauren Rosenberg heeft een aanklacht ingediend tegen Google nadat hem werd geadviseerd langs een route te lopen die in gevaarlijk verkeer leidde. Hoewel de zaak buiten de rechtbank is verworpen, blijkt dat mensen hun eigen gezond verstand terzijde zullen schuiven in de overtuiging dat machine-intelligentie over meer intelligentie beschikt dan wij.

Voor elk schip is er een scheepswrak

Uiteindelijk is het probleem, zoals Belpaeme erkent, dat we de besluitvorming soms aan machines willen overdragen. Robots beloven het werk te doen dat saai, vies en gevaarlijk is – en als we bij elke beslissing moeten twijfelen, zijn het niet echt de arbeidsbesparende apparaten die zijn beloofd. Als we uiteindelijk robots bij ons thuis willen uitnodigen, willen we dat ze autonoom kunnen handelen, en daar is een bepaald niveau van vertrouwen voor nodig.

“Robots die sociale druk op je uitoefenen, kunnen een goede zaak zijn; het hoeft niet sinister te zijn”, vervolgde Belpaeme. “Als je robots in de zorg of het onderwijs laat inzetten, wil je dat ze je kunnen beïnvloeden. Als u bijvoorbeeld wilt afvallen, kunt u gedurende twee maanden een robot voor gewichtsverlies krijgen monitoren uw calorie-inname en moedigt u aan om meer te bewegen. Je wilt dat zo’n robot je overtuigt en beïnvloedt. Maar elke technologie die ten goede kan worden gebruikt, kan ook ten kwade worden gebruikt.”

Wat is het antwoord hierop? Vragen als deze zullen van geval tot geval worden besproken. Als het slechte uiteindelijk zwaarder weegt dan het goede, zal technologie zoals sociale robots nooit van de grond komen. Maar het is belangrijk dat we de juiste lessen trekken uit onderzoeken zoals die over door robots veroorzaakte groepsdruk. En het is niet het feit dat we zoveel slimmer zijn dan kinderen.

Aanbevelingen van de redactie

- De toekomst van automatisering: Robots komen eraan, maar ze zullen uw baan niet overnemen

- Deze robots taseren onkruid dood, zodat boeren geen chemische herbiciden nodig hebben