Het goede nieuws? Voor de overgrote meerderheid van de mensen zijn ze nog steeds onherkenbaar. Het slechte nieuws? Ze houden de moderne informatica niet voor de gek.

Aanbevolen video's

Die informatie is volgens een nieuw project uitgevoerd door onderzoekers van de Universiteit van Texas in Austin en Cornell University, die gebruik maakten van diep leren naar de geredigeerde identiteiten correct raden van mensen die verborgen zijn door verduistering. Terwijl mensen in 0,19 procent van de gevallen geredigeerde identiteiten correct konden raden, kon het machine learning-systeem na vijf pogingen een correct oordeel vellen met een nauwkeurigheid van 83 procent.

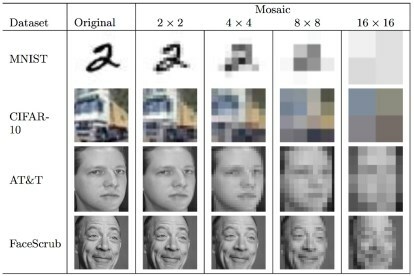

“Vervaging en pixelvorming worden vaak gebruikt om de identiteit van mensen in foto’s en video’s te verbergen,” Vitaly Sjmatikov, een professor in computerwetenschappen aan Cornell, tegen Digital Trends. “In veel van deze scenario’s heeft de tegenstander een redelijk goed beeld van een kleine groep mogelijke mensen wie er in de afbeelding had kunnen verschijnen, en hij hoeft alleen maar uit te zoeken wie van hen in de afbeelding staat afbeelding."

Dit, vervolgde Shmatikov, is precies het scenario waarin de technologie van het team goed werkt. “Dit toont aan dat vervaging, pixelvorming en andere methoden voor beeldverduistering mogelijk niet veel bescherming bieden wanneer het blootleggen van iemands identiteit hem of haar in gevaar zou brengen”, zei hij.

De uitdaging is natuurlijk dat dergelijke methoden om de identiteit van een persoon te achterhalen vaak worden gebruikt om een persoon te beschermen, zoals een klokkenluider of een getuige van een misdrijf. Door dergelijke beeldherkenningsalgoritmen toe te passen, gebaseerd op kunstmatige neurale netwerken, voor beelden die daarom met kant-en-klare hulpmiddelen zijn vertroebeld, kunnen mensen mogelijk in gevaar worden gebracht.

“De fundamentele uitdaging is het overbruggen van de kloof tussen technologieën voor privacybescherming en machine learning”, aldus Shmatikov. “Veel ontwerpers van privacytechnologieën beseffen de kracht van moderne machine learning niet ten volle – en dit leidt tot technologieën die de privacy niet daadwerkelijk beschermen.”

Aanbevelingen van de redactie

- Betaal de Verizon 5G-belasting niet voor de Google Pixel 4a 5G

- Niet spreken: met deze wearable kunt u spraakopdrachten geven zonder een woord te zeggen

- Laat u niet misleiden: dit geautomatiseerde systeem manipuleert stiekem video-inhoud

Upgrade uw levensstijlMet Digital Trends kunnen lezers de snelle technische wereld in de gaten houden met het laatste nieuws, leuke productrecensies, inzichtelijke redactionele artikelen en unieke sneak peeks.