ChatGPT ātri kļuvis par ģeneratīvā AI mīļāko, taču diez vai tas ir vienīgais spēlētājs šajā spēlē. Papildus visi pārējie AI rīki kas nodarbojas, piemēram, attēlu ģenerēšanu, ir arī vairāki tiešie konkurenti ar ChatGPT — vismaz tā es pieņēmu.

Saturs

- Microsoft Bing

- Google BERT

- Meena no Google

- RoBERTa no Facebook

- Google XLNet

- Microsoft Research DialoGPT

- ALBERTS no Google

- T5 no Google

- CTRL, ko nodrošina Salesforce

- Google GShard

- Blenderis, ko nodrošina Facebook AI izpēte

- Google Pegasus

Kāpēc nepajautāt par to ChatGPT? Tieši to es darīju, lai iegūtu šo sarakstu, cerot atrast dažas iespējas tiem saskaras ar paziņojumiem “pie ietilpības”., vai citi, kas vienkārši vēlas izmēģināt kaut ko jaunu. Ne visi no tiem ir tik pieejami sabiedrībai kā ChatGPT, taču saskaņā ar ChatGPT šīs ir labākās alternatīvas.

Ieteiktie videoklipi

Microsoft Bing

Pirms iekļūšanas AI uzskaitītajās izvēlēs, labākā ChatGPT alternatīva ir ChatGPT. Microsoft nesen pievienoja AI savai Bing meklētājprogrammai, un tā plāno drīzumā ieviest šo funkciju pārlūkprogrammā Edge.

Saistīts

- ChatGPT veidotājs OpenAI saskaras ar FTC izmeklēšanu par patērētāju aizsardzības likumiem

- ChatGPT rekordlielo izaugsmi tikko gāza jauna vīrusu lietotne

- OpenAI veido jaunu komandu, lai apturētu superinteliģentā mākslīgā intelekta ļaunprātīgu izmantošanu

Tas ir tikai priekšskatījumā, taču joprojām varat izmēģināt jauno AI tērzēšanas robotu vietnē bing.com/new tieši tagad. Microsoft saka, ka tas sākotnēji ierobežo vaicājumu skaitu, bet jūs varat pievienojieties Bing ChatGPT gaidīšanas sarakstam lai saņemtu paziņojumu, kad būs pieejama pilna versija.

Google BERT

BERT (Bidirectional Encoder Representations from Transformers) ir Google izstrādāts mašīnmācības modelis. Daudzos ChatGPT rezultātos ir minēti Google projekti, kurus redzēsiet vēlāk šajā sarakstā.

BERT ir pazīstama ar savām dabiskās valodas apstrādes (NLP) spējām, piemēram, atbildēm uz jautājumiem un sentimenta analīzi. Tā izmanto BookCorpus un angļu Wikipedia kā modeļus atsauces iepriekšējai apmācībai, jo ir iemācījušies attiecīgi 800 miljonus un 2,5 miljardus vārdu.

BERT pirmo reizi tika paziņots par atvērtā koda pētniecības projekts un akadēmiskais darbs 2018. gada oktobrī. Kopš tā laika šī tehnoloģija ir ieviesta Google meklēšanā. Agrīnā literatūra par BERT salīdziniet to ar OpenAI ChatGPT 2018. gada novembrī, atzīmējot, ka Google tehnoloģija ir dziļi divvirzienu, kas palīdz paredzēt ienākošo tekstu. Tikmēr OpenAI GPT ir vienvirziena un var atbildēt tikai uz sarežģītiem vaicājumiem.

Meena no Google

Meena ir tērzēšanas robots, kas Google iepazīstināja 2020. gada janvārī ar spēju sarunāties cilvēciski. Tās funkciju piemēri ietver vienkāršas sarunas, kas ietver interesantus jokus un vārdus, piemēram, Mīna iesaka govīm studēt “Govju zinātnes” Hārvardā.

Kā tieša alternatīva OpenAI GPT-2, Meena spēja apstrādāt 8,5 reizes vairāk datu nekā tā konkurente tajā laikā. Tās neironu tīkls sastāv no 2,6 parametriem, un tas ir apmācīts publiskā domēna sociālo mediju sarunām. Meena saņēma arī 79 % metrisko rādītāju saprātīguma un specifiskuma vidējā rādītājā (SSA), padarot to par vienu no sava laika viedākajiem tērzēšanas robotiem.

Meena kods ir pieejams GitHub.

RoBERTa no Facebook

Roberta (Robustly Optimized BERT pirmsapmācības pieeja) ir vēl viena sākotnējā BERT uzlabotā versija, kas Facebook paziņoja 2019. gada jūlijā.

Facebook izveidoja šo NLP modeli ar lielāku datu avotu kā pirmsapmācības modeli. RoBERTa kā 76 GB datu kopu izmanto CommonCrawl (CC-News), kas ietver 63 miljonus angļu ziņu rakstu, kas ģenerēti no 2016. gada septembra līdz 2019. gada februārim. Salīdzinājumam, sākotnējā BERT izmanto 16 GB datu starp angļu Wikipedia un BookCorpus datu kopām, saskaņā ar Facebook.

Saskaņā ar Facebook pētījumu, Silimar līdz XLNet, RoBERTa pārspēja BERT etalondatu kopu komplektā. Lai iegūtu šos rezultātus, uzņēmums ne tikai izmantoja lielāku datu avotu, bet arī iepriekš sagatavoja savu modeli a ilgāku laika periodu.

Facebook izveidoja RoBERTa atvērtais avots 2019. gada septembrī, un tā kods ir pieejams vietnē GitHub kopienas eksperimentiem.

VentureBeat tajā laikā arī pieminēja GPT-2 starp topošajām AI sistēmām.

Google XLNet

XLNET ir uz transformatoriem balstīts autorregresīvas valodas modelis, ko izstrādājusi komanda Google Brain un Kārnegija Melona universitātes pētnieki. Modelis būtībā ir progresīvāks BERT, un tas pirmo reizi tika demonstrēts 2019. gada jūnijā. Grupa konstatēja, ka XLNet ir vismaz Par 16% efektīvāk nekā sākotnējā BERT, par kuru tika paziņots 2018. gadā, un tā spēja pārspēt BERT 20 NLP uzdevumu testā.

XLNet: jauna priekšapmācības metode NLP, kas ievērojami uzlabo BERT 20 uzdevumos (piemēram, SQuAD, GLUE, RACE)

arxiv: https://t.co/C1tFMwZvyW

github (kods + iepriekš apmācīti modeļi): https://t.co/kI4jsVzT1u

ar Žilinu Jangu, @ZihangDai, Yiming Yang, Jaime Carbonell, @rsalakhupic.twitter.com/JboOekUVPQ

— Quoc Le (@quocleix) 2019. gada 20. jūnijs

Tā kā gan XLNet, gan BERT izmanto “maskētus” marķierus slēptā teksta prognozēšanai, XLNet uzlabo efektivitāti, paātrinot procesa paredzamo daļu. Piemēram, Amazon Alexa datu zinātnieks Aishwarya Srinivasan paskaidroja XLNet spēj identificēt vārdu “Jauns” kā saistītu ar terminu “ir pilsēta”, pirms tiek prognozēts, ka termins “Jorka” ir saistīts arī ar šo terminu. Tikmēr BERT atsevišķi jāidentificē vārdi “New” un “York” un pēc tam tie jāsaista, piemēram, ar terminu “ir pilsēta”.

Proti, GPT un GPT-2 ir minēts arī šajā skaidrojumā no 2019. gada kā citus autorregresīvo valodu modeļu piemērus.

XLNet kods un iepriekš apmācīti modeļi ir pieejams vietnē GitHub. Modelis ir labi zināms NLP pētnieku aprindās.

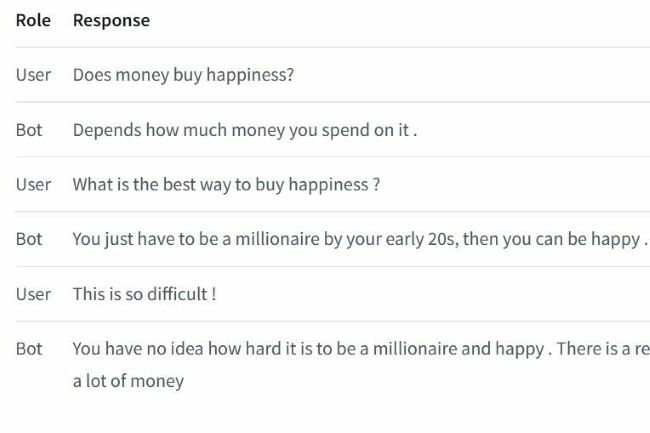

Microsoft Research DialoGPT

DialoGPT (dialogu ģeneratīvais iepriekš apmācīts transformators) ir autoregresīvs valodas modelis, kas tika ieviests 2019. gada novembrī, Microsoft Research. Ar līdzību GPT-2 modelis tika iepriekš apmācīts, lai radītu cilvēcisku sarunu. Tomēr tā galvenais informācijas avots bija 147 miljoni vairāku apgriezienu dialogu, kas tika izvilkti no Reddit pavedieniem.

To atzīmēja HumanFirst galvenais evaņģēlists Kobuss Greilings viņa panākumi DialoGPT ieviešanā Telegram ziņojumapmaiņas pakalpojumā, lai modeli atdzīvinātu kā tērzēšanas robotu. Viņš piebilda, ka Amazon Web Services un Amazon SageMaker izmantošana var palīdzēt precizēt kodu.

DialoGPT kods ir pieejams GitHub.

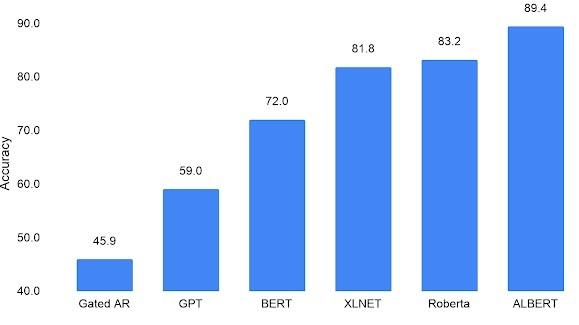

ALBERTS no Google

ALBERTS (Vienkāršais BERTs) ir sākotnējā BERT saīsināta versija, un Google to izstrādāja 2019. gada decembrī.

Izmantojot ALBERT, Google ierobežoja modelī atļauto parametru skaitu, ieviešot parametrus ar “slēpto slāņu iegulšanu”.

Tas uzlaboja ne tikai BERT modeli, bet arī XLNet un RoBERTa, jo ALBERT var apmācīt tā pati lielākā informācijas kopa, kas izmantota diviem jaunākiem modeļiem, vienlaikus ievērojot mazāku parametrus. Būtībā ALBERT strādā tikai ar tā funkcijām nepieciešamajiem parametriem, kas paaugstināja veiktspēju un precizitāti. Google paskaidroja, ka tas atklāja, ka ALBERT pārsniedz BERT 12 NLP etalonos, tostarp SAT līdzīgā lasīšanas izpratnes etalonā.

Lai gan tas nav minēts vārdā, GPT ir iekļauts Google pētniecības emuāra ALBERT attēlu veidošanā.

Google izlaida ALBERT kā atvērtā pirmkoda versiju 2020. gada janvārī, un tas tika ieviests papildus Google TensorFlow. Kods ir pieejams GitHub.

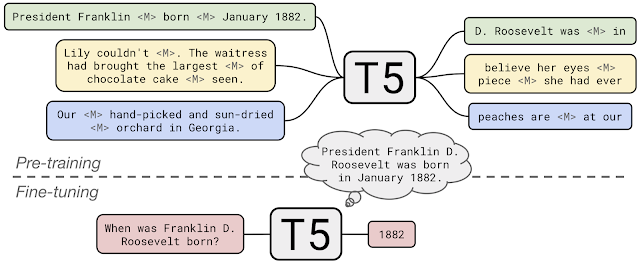

T5 no Google

CTRL, ko nodrošina Salesforce

Google GShard

GShards ir a milzu valodas tulkošanas modelis ka Google iepazīstināja 2020. gada jūnijā, lai veiktu neironu tīklu mērogošanu. Modelis ietver 600 miljardus parametru, kas ļauj vienlaikus veikt lielu datu apmācību. GShards ir īpaši prasmīgs valodas tulkojums un tiek apmācīts tulkot angļu valodā 100 valodās četru dienu laikā.

Blenderis, ko nodrošina Facebook AI izpēte

Blender ir atvērtā pirmkoda tērzēšanas robots, kas tika ieviests 2020. gada aprīlis Facebook AI izpēte. Ir atzīmēts, ka tērzēšanas robotam ir uzlabotas sarunvalodas prasmes salīdzinājumā ar konkurentu modeļiem, kā arī spēja nodrošināt saistošus sarunu punktus, klausieties un parādiet izpratni par partnera ieguldījumu, kā arī demonstrējiet empātiju un personību.

Blender ir salīdzināts ar Google Meena tērzēšanas robotu, kas savukārt ir salīdzināts ar OpenAI GPT-2

Blendera kods ir pieejams Parl.ai.

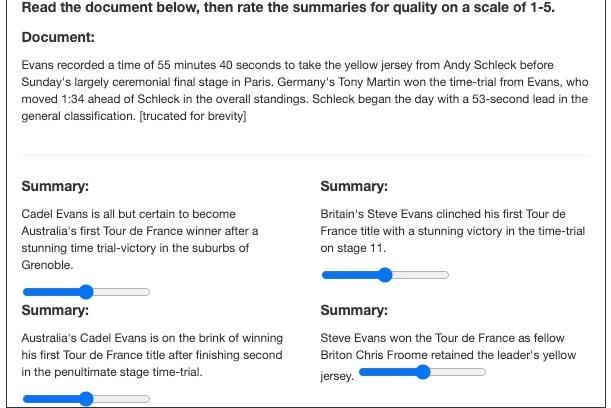

Google Pegasus

Pegasus ir dabiskas valodas apstrādes modelis, kas bija ieviesa Google 2019. gada decembrī. Pegasus var apmācīt izveidot kopsavilkumus, un līdzīgi citiem modeļiem, piemēram, BERT, GPT-2, RoBERTa, XLNet, ALBERT un T5, to var precīzi pielāgot konkrētiem uzdevumiem. Pegasus ir pārbaudīts attiecībā uz tā efektivitāti, apkopojot ziņas, zinātni, stāstus, instrukcijas, e-pastus, patentus un tiesību aktus salīdzinājumā ar cilvēkiem.

Pegasus kods ir pieejams GitHub.

Redaktoru ieteikumi

- Google Bard tagad var runāt, bet vai tas var noslāpēt ChatGPT?

- ChatGPT: jaunākās ziņas, strīdi un padomi, kas jums jāzina

- ChatGPT vietnes trafika ir samazinājusies pirmo reizi

- ChatGPT Bing pārlūkošanas funkcija ir atspējota maksas sienas piekļuves trūkuma dēļ

- Labākie AI tērzēšanas roboti, ko izmēģināt: ChatGPT, Bard un citi