공원을 산책하는 동안 만나는 꽃이나 새의 이름을 알고 싶으십니까? 곧 Google 어시스턴트가 카메라와 인공 지능을 사용하여 알려줄 수 있을 것입니다.

추천 동영상

구글은 2017년을 시작했다 I/O 컨퍼런스 AI와 머신러닝을 중심으로, 여기서 강조된 컴퓨터 비전 기술 중 하나는 Google Lens입니다. 카메라는 단순히 이미지를 캡처하는 것 이상의 기능을 수행합니다. 즉, 현재 보고 있는 내용에 대한 더 많은 맥락을 제공합니다.

에 온다 구글 어시스턴트 그리고 구글 포토Google 렌즈 기술은 "당신이 보고 있는 것을 이해하고 조치를 취하는 데 도움을 줄 수 있습니다"라고 Google CEO Sundar Pichai는 기조 연설에서 말했습니다. 예를 들어 카메라를 콘서트장 천막으로 향하면 Google 어시스턴트가 콘서트 장소에 대해 더 자세히 알려줄 수 있습니다. 연주자, 음악 연주자, 공연 티켓 구매를 돕고 달력에 추가하는 모든 작업을 한 번에 수행할 수 있습니다. 단일 앱.

카메라가 낯선 물체를 가리키면 Google 어시스턴트는 이미지 인식을 통해 그것이 무엇인지 알려줄 수 있습니다. 매장 간판을 가리키고 위치 정보를 사용하면 업체에 대한 의미 있는 정보를 얻을 수 있습니다. 이 모든 작업은 사용자와 어시스턴트의 '대화형' 음성 상호작용을 통해 수행될 수 있습니다.

피차이는 “휴대폰으로 가리키기만 하면 우리가 자동으로 어려운 일을 해줄 수 있다”고 말했다.

Google 렌즈를 사용하면 스마트 폰 카메라는 사용자가 보는 것만 보는 것이 아니라 사용자가 보고 있는 내용을 이해하여 조치를 취하는 데도 도움이 됩니다. #io17pic.twitter.com/viOmWFjqk1

— 구글(@Google) 2017년 5월 17일

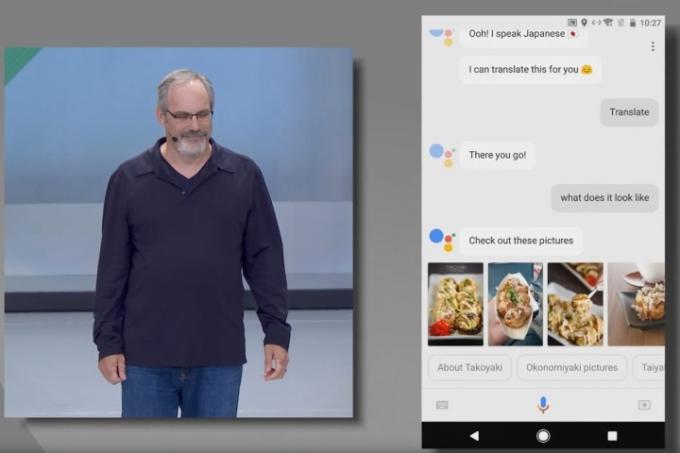

Google의 번역 앱을 사용하는 경우 기술이 어떻게 작동하는지 이미 확인하셨을 것입니다. 일부 텍스트 위에 카메라를 놓으면 앱이 해당 내용을 귀하가 이해하는 언어로 번역합니다. Google 어시스턴트에서는 Google Lens가 이 작업을 더 자세히 수행합니다. 시연에서 Google은 다음을 보여주었습니다.

이미지 인식 기술은 새로운 것은 아니지만 Google Lens는 기계 학습이 어떻게 발전하고 있는지 보여줍니다. Pichai는 음성 작업과 마찬가지로 Google의 시력도 크게 향상되고 있다고 말했습니다. 컴퓨터 비전 기술은 사물이 무엇인지 인식하는 데 도움이 될 뿐만 아니라 이미지를 복구하거나 향상시키는 데에도 도움이 됩니다. 에펠탑의 흐릿한 사진을 찍으셨나요? 컴퓨터는 물체를 인식하고 그것이 어떻게 보일지 알고 있기 때문에 이미 알고 있는 것을 바탕으로 해당 이미지를 자동으로 향상시킬 수 있습니다.

피차이는 “우리는 사진 뒤에 숨은 속성을 이해할 수 있다”고 말했다. "우리의 컴퓨터 비전 시스템은 이제 이미지 인식 분야에서 인간보다 훨씬 뛰어납니다."

Lens가 업무를 효율적으로 수행할 수 있도록 Google은 다음과 같은 정교한 컴퓨팅 아키텍처를 사용하고 있습니다. 머신에 대한 훈련 및 추론을 처리하기 위한 클라우드 Tensor 처리 장치(TPU) 칩셋 학습. 2세대 TPU 기술은 초당 180조 개의 부동 소수점 연산을 처리할 수 있습니다. 하나의 슈퍼컴퓨터에 있는 64개의 TPU 보드는 11.5페타플롭을 처리할 수 있습니다. 이러한 컴퓨팅 성능을 통해 새로운 TPU는 훈련과 추론을 동시에 처리할 수 있습니다. 과거에는 가능했습니다(이전 TPU는 추론 작업만 처리할 수 있었지만 더 복잡한 작업은 처리할 수 없었습니다). 훈련). 기계 학습에는 시간이 걸리지만 이 하드웨어는 노력을 가속화하는 데 도움이 됩니다.

Google 렌즈는 Google 포토의 다음 업데이트에도 적용됩니다. 이미지 인식은 이미 사진에서 얼굴, 장소, 사물을 인식하여 구성 및 검색에 도움이 되는 데 사용됩니다. Google 렌즈를 사용하면 Google 포토에서 건물 이름, 설명 등 사진 속 사물에 대한 더 많은 정보를 제공할 수 있습니다. 사진에 있는 전화번호를 탭하면 전화가 걸려오고, 사진에서 본 작품에 대한 추가 정보가 표시됩니다. 박물관, Wi-Fi 뒷면에서 찍은 사진에서 Wi-Fi 비밀번호를 자동으로 입력할 수도 있습니다. 라우터.

어시스턴트와 포토는 Google Lens를 사용하는 첫 번째 앱이 될 예정이지만 다른 앱에도 출시될 예정입니다. 그리고 iOS에서 어시스턴트 지원이 발표되면서 iPhone 사용자도 Google Lens 기술을 활용할 수 있게 되었습니다.

편집자의 추천

- 아니요, 스마트워치에는 Google 어시스턴트가 필요하지 않습니다.

- Google I/O 2023에서 보고 싶은 5가지(아마도 그렇지 않을 것임)

- Google I/O 2023은 5월 10일 오프라인 이벤트로 진행됩니다.

- 아이폰 14 프로 vs. Google Pixel 7 Pro 카메라 전투는 믿을 수 없을 정도로 가깝습니다.

- 이 새로운 Google 렌즈 기능은 공상과학 영화에서 튀어나온 것처럼 보입니다.

당신의 라이프스타일을 업그레이드하세요Digital Trends는 독자들이 모든 최신 뉴스, 재미있는 제품 리뷰, 통찰력 있는 사설 및 독특한 미리보기를 통해 빠르게 변화하는 기술 세계를 계속해서 살펴볼 수 있도록 도와줍니다.