ChatGPT სწრაფად გახდა გენერაციული ხელოვნური ინტელექტის საყვარელი ადამიანი, მაგრამ ის თამაშში ძნელად ერთადერთი მოთამაშეა. Დამატებით ყველა სხვა AI ინსტრუმენტი არსებობს რომლებიც აკეთებენ ისეთ რაღაცეებს, როგორიცაა სურათების გენერირება, ასევე არის რამდენიმე პირდაპირი კონკურენტი ChatGPT–ით – ან ასე ვივარაუდე.

შინაარსი

- Bing Microsoft-ის მიერ

- BERT Google-ის მიერ

- Meena Google-ის მიერ

- RoBERTa Facebook-ის მიერ

- XLNet Google-ის მიერ

- DialoGPT Microsoft Research-ის მიერ

- ALBERT Google-ის მიერ

- T5 Google-ის მიერ

- CTRL Salesforce-ის მიერ

- GShard Google-ის მიერ

- ბლენდერი Facebook AI Research-ის მიერ

- Pegasus Google-ის მიერ

რატომ არ ჰკითხავთ ამის შესახებ ChatGPT-ს? ეს არის ზუსტად ის, რაც მე გავაკეთე ამ სიის მისაღებად, იმ იმედით, რომ ვიპოვე რამდენიმე ვარიანტი მათთვის ხვდება „ტევადობის“ შენიშვნებს, ან სხვებს, რომლებსაც უბრალოდ სურთ რაღაც ახალი სცადონ. ყველა ეს არ არის ისეთი ხელმისაწვდომი საზოგადოებისთვის, როგორც ChatGPT, მაგრამ ChatGPT-ის მიხედვით, ეს საუკეთესო ალტერნატივაა.

რეკომენდებული ვიდეოები

Bing Microsoft-ის მიერ

სანამ AI-ის მიერ ჩამოთვლილ არჩევანში მოხვდებით, ChatGPT-ის საუკეთესო ალტერნატივა არის ChatGPT. Microsoft ცოტა ხნის წინ დაამატა AI თავის Bing საძიებო სისტემაში, და ის გეგმავს ფუნქციის გამოშვებას Edge ბრაუზერში მალე.

დაკავშირებული

- ChatGPT-ის შემქმნელი OpenAI-ის წინაშე დგას FTC გამოძიება მომხმარებელთა დაცვის კანონების გამო

- ChatGPT-ის რეკორდული ზრდა ახლახან ჩამოაგდეს ახალმა ვირუსულმა აპლიკაციამ

- OpenAI აშენებს ახალ გუნდს, რათა შეაჩეროს სუპერინტელექტუალური ხელოვნური ინტელექტის მოტყუება

ის მხოლოდ გადახედვისას არის, მაგრამ მაინც შეგიძლიათ სცადოთ ახალი AI ჩატბოტი აქ bing.com/new ეხლა. Microsoft ამბობს, რომ თავდაპირველად ზღუდავს მოთხოვნების რაოდენობას, მაგრამ თქვენ შეგიძლიათ შეუერთდით Bing ChatGPT-ის მომლოდინე სიას უნდა ეცნობოს, როდესაც სრული ვერსია ხელმისაწვდომი იქნება.

BERT Google-ის მიერ

BERT (ორმხრივი შიფრატორის წარმოდგენები ტრანსფორმერებიდან) არის მანქანური სწავლების მოდელი, რომელიც შემუშავებულია Google-ის მიერ. ChatGPT-ის ბევრ შედეგებში აღნიშნულია Google-ის პროექტები, რომლებსაც მოგვიანებით იხილავთ ამ სიაში.

BERT ცნობილია თავისი ბუნებრივი ენის დამუშავების (NLP) შესაძლებლობებით, როგორიცაა კითხვებზე პასუხის გაცემა და განწყობის ანალიზი. ის იყენებს BookCorpus-სა და ინგლისურ ვიკიპედიას, როგორც მოდელებს წინასწარი მომზადებისთვის, რომელმაც ისწავლა შესაბამისად 800 მილიონი და 2,5 მილიარდი სიტყვა.

BERT პირველად გამოცხადდა, როგორც ღია წყაროს კვლევის პროექტი და აკადემიური ნაშრომი 2018 წლის ოქტომბერში. მას შემდეგ ტექნოლოგია დანერგილია Google Search-ში. ადრეული ლიტერატურა BERT-ის შესახებ შეადარა მას OpenAI-ის ChatGPT-ს 2018 წლის ნოემბერში და აღნიშნა, რომ Google-ის ტექნოლოგია ღრმა ორმხრივია, რაც ხელს უწყობს შემომავალი ტექსტის პროგნოზირებას. იმავდროულად, OpenAI GPT არის ცალმხრივი და შეუძლია მხოლოდ რთულ შეკითხვებზე პასუხის გაცემა.

Meena Google-ის მიერ

Meena არის ჩატბოტი, რომელიც Google-მა გააცნო 2020 წლის იანვარში ადამიანური გზით საუბრის უნარით. მისი ფუნქციების მაგალითები მოიცავს მარტივ საუბრებს, რომლებიც შეიცავს საინტერესო ხუმრობებსა და სიტყვებს, მაგალითად, მეენა სთავაზობს ძროხებს ჰარვარდში „მსხვილფეხა რქოსანი მეცნიერებების“ შესწავლას.

როგორც OpenAI-ის GPT-2-ის პირდაპირი ალტერნატივა, Meena-ს ჰქონდა შესაძლებლობა დაემუშავებინა 8,5-ჯერ მეტი მონაცემი, ვიდრე მისი იმდროინდელი კონკურენტი. მისი ნერვული ქსელი შეიცავს 2.6 პარამეტრს და ის გაწვრთნილია საზოგადოებრივ დომენში სოციალური მედიის საუბრებზე. მეენამ ასევე მიიღო მეტრიკული ქულა Sensibleness and Specificity Average (SSA) 79%, რაც მას თავის დროზე ერთ-ერთ ყველაზე ინტელექტუალურ ჩატბოტად აქცევს.

Meena კოდი ხელმისაწვდომია GitHub.

RoBERTa Facebook-ის მიერ

რობერტა (მტკიცედ ოპტიმიზებული BERT წინასწარი მომზადების მიდგომა) არის ორიგინალური BERT-ის კიდევ ერთი მოწინავე ვერსია, რომელიც ამის შესახებ Facebook-მა განაცხადა 2019 წლის ივლისში.

ფეისბუქი შექმნა ეს NLP მოდელი მონაცემთა უფრო დიდი წყაროთი, როგორც მისი წინასწარი მომზადების მოდელი. RoBERTa იყენებს CommonCrawl-ს (CC-News), რომელიც მოიცავს 63 მილიონ ინგლისურ საინფორმაციო სტატიას, რომლებიც გენერირებულია 2016 წლის სექტემბრიდან 2019 წლის თებერვლამდე, როგორც მისი 76 გბ მონაცემთა ნაკრები. შედარებისთვის, ორიგინალური BERT იყენებს 16 გბ მონაცემს მის ინგლისურ Wikipedia-სა და BookCorpus მონაცემთა ნაკრებებს შორის, Facebook-ის თანახმად.

Silimar to XLNet, RoBERTa-მ დაამარცხა BERT საორიენტაციო მონაცემების კომპლექტში, Facebook-ის კვლევის მიხედვით. ამ შედეგების მისაღებად კომპანიამ არა მხოლოდ გამოიყენა უფრო დიდი მონაცემთა წყარო, არამედ წინასწარ მოამზადა თავისი მოდელი ა უფრო გრძელი პერიოდი.

ფეისბუქმა შექმნა RoBERTa საჯარო წყარო 2019 წლის სექტემბერში და მისი კოდია ხელმისაწვდომია GitHub-ზე საზოგადოების ექსპერიმენტებისთვის.

VentureBeat ასევე ახსენა GPT-2 იმ დროს განვითარებულ AI სისტემებს შორის.

XLNet Google-ის მიერ

XLNET არის ტრანსფორმატორზე დაფუძნებული ავტორეგრესიული ენის მოდელი, რომელიც შემუშავებულია გუნდის მიერ Google Brain და კარნეგი მელონის უნივერსიტეტის მკვლევარები. მოდელი არსებითად უფრო მოწინავე BERT-ია და პირველად აჩვენეს 2019 წლის ივნისში. ჯგუფმა აღმოაჩინა, რომ XLNet მაინც იყო 16%-ით უფრო ეფექტური ვიდრე ორიგინალური BERT, რომელიც გამოცხადდა 2018 წელს, მას შეუძლია დაამარცხოს BERT 20 NLP დავალების ტესტში.

XLNet: ახალი წინასწარი ვარჯიშის მეთოდი NLP-სთვის, რომელიც მნიშვნელოვნად აუმჯობესებს BERT-ს 20 დავალებაზე (მაგ., SQuAD, GLUE, RACE)

arxiv: https://t.co/C1tFMwZvyW

github (კოდი + წინასწარ მომზადებული მოდელები): https://t.co/kI4jsVzT1u

ჟილინ იანგთან ერთად, @ZihangDaiიმინგ იანგი, ჯეიმე კარბონელი, @rsalakhupic.twitter.com/JboOekUVPQ

— Quoc Le (@quocleix) 2019 წლის 20 ივნისი

XLNet-ისა და BERT-ის გამოყენებით, რომლებიც იყენებენ „ნიღბიან“ ჟეტონებს ფარული ტექსტის პროგნოზირებისთვის, XLNet აუმჯობესებს ეფექტურობას პროცესის პროგნოზირების ნაწილის დაჩქარებით. მაგალითად, Amazon ალექსა მონაცემთა მეცნიერი აიშვარია სრინივასანი განმარტა რომ XLNet-ს შეუძლია დაადგინოს სიტყვა „ახალი“, როგორც ასოცირდება ტერმინთან „ქალაქი“, სანამ იწინასწარმეტყველა ტერმინი „იორკი“, როგორც ამ ტერმინთან ასოცირებული. იმავდროულად, BERT-მა უნდა განსაზღვროს სიტყვები „ნიუ“ და „იორკი“ ცალ-ცალკე და შემდეგ დააკავშიროს ისინი ტერმინთან „ქალაქია“, მაგალითად.

აღსანიშნავია, რომ GPT და GPT-2 არის ასევე აღნიშნა ამ განმარტებაში 2019 წლიდან, როგორც ავტორეგრესული ენის მოდელების სხვა მაგალითები.

XLNet კოდი და წინასწარ მომზადებული მოდელებია ხელმისაწვდომია GitHub-ზე. მოდელი კარგად არის ცნობილი NLP კვლევით საზოგადოებაში.

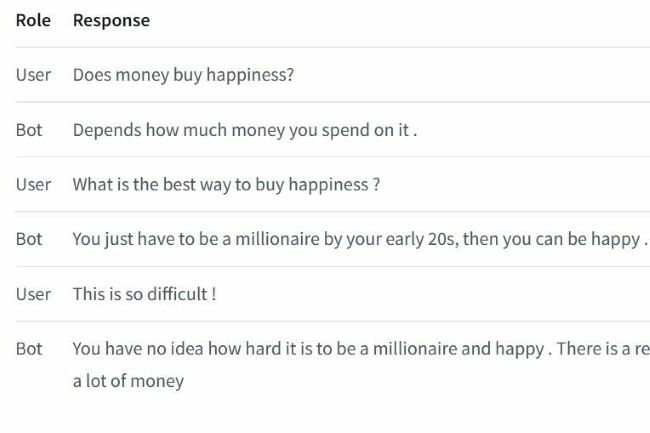

DialoGPT Microsoft Research-ის მიერ

DialoGPT (Dialogue Generative Pre-trained Transformer) არის ავტორეგრესიული ენის მოდელი, რომელიც გააცნო 2019 წლის ნოემბერში Microsoft Research-ის მიერ. GPT-2-თან მსგავსებით, მოდელი წინასწარ იყო მომზადებული ადამიანის მსგავსი საუბრის შესაქმნელად. თუმცა, მისი ინფორმაციის პირველადი წყარო იყო 147 მილიონი მრავალმხრივი დიალოგი, რომელიც ამოღებული იყო Reddit-ის თემებიდან.

HumanFirst-ის მთავარმა ევანგელისტმა კობუს გრეილინგმა აღნიშნა მისი წარმატება DialoGPT-ის დანერგვაში Telegram შეტყობინებების სერვისში, რათა მოდელი გააცოცხლოს როგორც ჩატბოტი. მან დაამატა, რომ Amazon Web Services-ისა და Amazon SageMaker-ის გამოყენება დაგეხმარებათ კოდის დაზუსტებაში.

DialoGPT კოდი ხელმისაწვდომია GitHub.

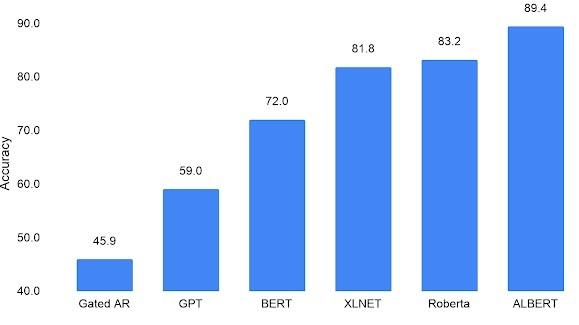

ALBERT Google-ის მიერ

ALBERT (A Lite BERT) არის ორიგინალური BERT-ის შეკვეცილი ვერსია და შეიქმნა Google-ის მიერ 2019 წლის დეკემბერში.

ALBERT-ით, Google-მა შეზღუდა მოდელში დაშვებული პარამეტრების რაოდენობა „ფარული ფენის ჩაშენებით“ პარამეტრების შემოღებით.

ეს გაუმჯობესდა არა მხოლოდ BERT-ის მოდელზე, არამედ XLNet-სა და RoBERTa-ზე, რადგან ALBERT-ის ტრენინგი შესაძლებელია. ინფორმაციის იგივე დიდი მონაცემთა ნაკრები, რომელიც გამოიყენება ორი ახალი მოდელისთვის, ხოლო უფრო მცირეზე პარამეტრები. არსებითად, ALBERT მუშაობს მხოლოდ მისი ფუნქციებისთვის საჭირო პარამეტრებით, რამაც გაზარდა შესრულება და სიზუსტე. Google-მა დააზუსტა, რომ აღმოაჩინა, რომ ALBERT აღემატება BERT-ს 12 NLP კრიტერიუმში, მათ შორის SAT-ის მსგავსი წაკითხულის გაგების ინდიკატორი.

მიუხედავად იმისა, რომ სახელით არ არის ნახსენები, GPT შედის ALBERT-ის გამოსახულებაში Google-ის კვლევის ბლოგზე.

Google-მა გამოუშვა ALBERT ღია წყაროდ 2020 წლის იანვარში და ის განხორციელდა Google-ის TensorFlow-ის თავზე. კოდი ხელმისაწვდომია GitHub.

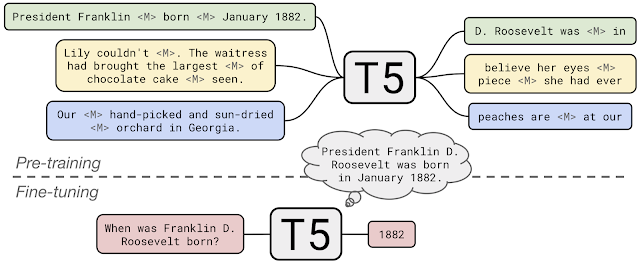

T5 Google-ის მიერ

CTRL Salesforce-ის მიერ

GShard Google-ის მიერ

GShard არის ა გიგანტური ენის თარგმანის მოდელი რომ Google-მა გააცნო 2020 წლის ივნისში ნერვული ქსელის სკალირების მიზნით. მოდელი მოიცავს 600 მილიარდ პარამეტრს, რაც საშუალებას იძლევა ერთდროულად მომზადდეს მონაცემთა დიდი ნაკრები. GShard განსაკუთრებით დახელოვნებულია ენის თარგმანი და ოთხ დღეში სწავლობენ 100 ენის ინგლისურად თარგმნას.

ბლენდერი Facebook AI Research-ის მიერ

Blender არის ღია კოდის ჩატბოტი, რომელიც დაინერგა 2020 წლის აპრილი Facebook AI Research-ის მიერ. აღინიშნა, რომ ჩატბოტს აქვს გაუმჯობესებული საუბრის უნარები კონკურენტ მოდელებთან შედარებით, უზრუნველყოფის შესაძლებლობით ჩართეთ საუბრის წერტილები, მოუსმინეთ და აჩვენეთ პარტნიორის აზრის გაგება და აჩვენეთ თანაგრძნობა და პიროვნება.

ბლენდერი შეადარეს Google-ის Meena ჩეთბოტს, რომელიც თავის მხრივ შეადარეს OpenAI-ს GPT-2-ს.

ბლენდერის კოდი ხელმისაწვდომია Parl.ai.

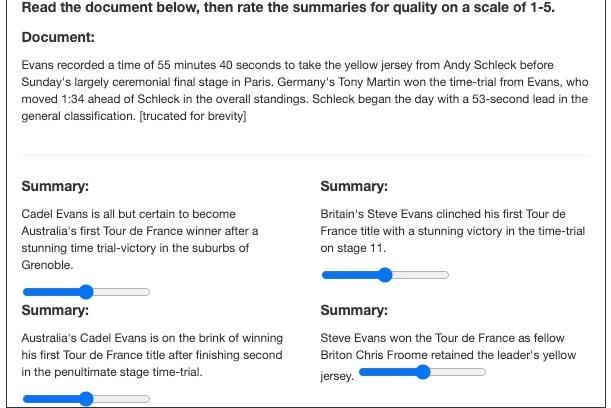

Pegasus Google-ის მიერ

პეგასუსი არის ბუნებრივი ენის დამუშავების მოდელი, რომელიც იყო Google-ის მიერ წარდგენილი 2019 წლის დეკემბერში. Pegasus-ის სწავლება შესაძლებელია შეჯამების შესაქმნელად და სხვა მოდელების მსგავსად, როგორიცაა BERT, GPT-2, RoBERTa, XLNet, ALBERT და T5, ის შეიძლება დაზუსტდეს კონკრეტულ ამოცანებზე. პეგასუსი გამოცდილია მის ეფექტურობაზე ახალი ამბების, მეცნიერების, ისტორიების, ინსტრუქციების, ელ.წერილების, პატენტებისა და საკანონმდებლო კანონპროექტების შეჯამებაში, ადამიანებთან შედარებით.

პეგასუსის კოდი ხელმისაწვდომია GitHub.

რედაქტორების რეკომენდაციები

- Google Bard-ს ახლა შეუძლია ლაპარაკი, მაგრამ შეუძლია თუ არა მას ჩაახშოს ChatGPT?

- ChatGPT: უახლესი ამბები, წინააღმდეგობები და რჩევები, რომლებიც უნდა იცოდეთ

- ChatGPT ვებსაიტის ტრაფიკი პირველად დაეცა

- ChatGPT-ის Bing-ის დათვალიერების ფუნქცია გამორთულია paywall-ზე წვდომის ხარვეზის გამო

- საუკეთესო AI ჩეთბოტები, რომლებიც უნდა გამოსცადოთ: ChatGPT, Bard და სხვა