硬くなったものは手入れにも費用がかかります。冷蔵保存する必要があるため、特別な設備と訓練を受けたスタッフが必要です。 少しずつ積み上げて 悪い評判 臓器提供者取引については、フランケンシュタイン博士が挑戦しそうな環境が整っています。

おすすめ動画

そこで、本物の死者の不足を解決するために、解剖学者は仮想の死者を作成することにしました。

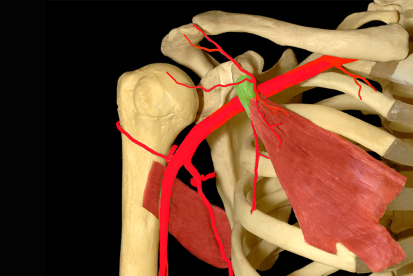

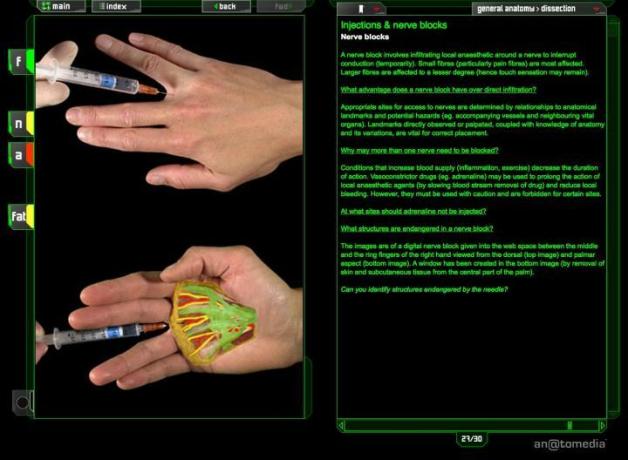

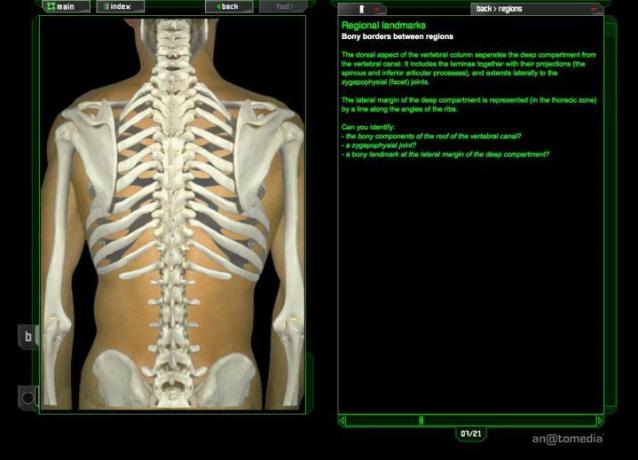

このような仮想シミュレーションの初期の先駆者は、現在オーストラリアのモナシュ大学の解剖学および発生生物学部の准教授であるノーマン・アイゼンバーグです。 20 年以上前、彼は解剖データを収集し、電子形式で保存し始めました。 その結果、An@omedia が誕生しました。 仮想解剖ソフトウェアこれにより、人体解剖学を学習する従来のプロセスが大幅にスピードアップされました。

アイゼンバーグ氏によると、彼の学校では生徒と死体の比率は 80 対 1 で、硬い死体をスライスするのは時間のかかる細心の注意を要する作業だという。

「ナイフとフォークを持ってすぐに切り始めることはできません。 脂肪や繊維、つまり私たちを結びつけているすべての組織を取り除く必要があります。」

そして、それはほんの始まりにすぎません。 他の人はそれをさらに推し進めたいと考えています。 ロバート ライス氏は、NASA のためにバーチャル宇宙飛行士を開発した元 NASA コンサルタントであり、博士号を取得しています。 Peter Moon は解剖学の博士号を取得しており、Peter Moon はオーストラリアのセンシングおよびシミュレーション技術会社 Baltech の CEO です。 彼らは、学生がその解剖学を見るだけでなく実際に見ることができる 3D 仮想人間を作成したいと考えています。

感じる. そして、彼らは合成組織から作られたプラスチックの模造体のことを話しているのではありません。 彼らが話しているのは、意欲的な医師が医療現場で切り取ることができる、触覚を備えたコンピュータ化された人体モデルについてです。 皮膚を切り裂き、脂肪を押しのけ、血液を露出させる感覚を味わいながらコンピューターの画面を見る 船。 Moon 氏は、「テクノロジーとイノベーションを組み合わせて新しい標準を生み出す」と主張しています。平らなガラスの上で人体を解剖する触覚体験をどのように構築するのでしょうか?

突飛なアイデアに聞こえるかもしれませんが、私たち一人ひとりがすでに触覚電子機器を使用しています。 デバイス - 電話番号や電話番号を入力すると振動するスマートフォンやタブレットのタッチスクリーン。 友達にテキストメッセージを送ります。 そのガラスは単純な方法でのみタップに反応し、触れているものの柔軟性や密度を伝えることができません。 しかし、他のより高度で洗練された触覚デバイスではそれが可能であり、それらはすでに存在します。 このようなデバイスは、ユーザーに力、振動、または動きを加えることによって触覚を作り出すことができます。 この機械的刺激は、コンピューター シミュレーションで触覚仮想オブジェクト (HVO) を作成するのに役立ちます。

触覚デバイスを媒介として、ユーザーは、あたかも本物であるかのように HVO を体験しながら、画面上の HVO を操作できます。 このコンセプトは、パイロットの学生が使用するフライト シミュレーターに似ており、ジョイスティックなどの簡単なコントロールで仮想飛行機を操縦できます。 ハプティックヒューマンははるかに洗練され、学生医師が仮想解剖や手術を行えるようになる。

「人間の驚くべき触感、感性、意味を呼び起こすマルチタッチ両手触覚を提供します」とライス氏は言う。

彼はすでに触覚人間へのロードマップを示しています。 Anatomedia には、体のさまざまな部分、骨、筋肉、組織を描いた写真とスキャンのデータベースがあります。 オープンソース ソフトウェア開発プラットフォームである H3DAPI などの触覚プログラミング言語を使用すると、プログラマーは触覚を割り当てることができます。 Anatomedia オブジェクトの特質を認識し、まるで学校で行うのと同じように生徒の仮想メスの動きに反応させます。 実生活。 このような触感の性質には、剛性、変形性、またはさまざまな質感が含まれます。

「肌の質感、スポーツ選手の筋肉の硬さ、お腹のたるんだ感じなどを感じるでしょう。 脂肪、肘の骨の固さ、手首の脈拍点での脈動する血流などです。」 米。 世界に存在するすべての物理的特性は、触覚プログラミング言語に組み込まれています。

意欲的な医師は、皮膚を切り裂き、脂肪を押しのけ、血管を露出させる感覚を体験しながら、コンピューター画面上で切り取ることができるようになります。

Rice と Moon は、自社のバーチャル ヒューマン ソフトウェアに「インタラクティブ ヒューマン アナトミー ビジュアライゼーション インストラクショナル テクノロジー」、または単に「IHAVIT」というタイトルを付けました。

それでは、コンピュータ死体が本物の死体に取って代わり、解剖学研究室が時代遅れになるのはいつ頃になるのでしょうか? ライス氏によれば、プロジェクトに資金が提供されれば、このような仮想人間をプログラムするには約 3 ~ 4 年かかるという。 しかし、この作業には多額の投資が必要で、通常の IndieGoGo キャンペーンで蓄積できる以上の投資が必要です。 「概念実証として人間の腕を作るとしたら、25 万ドルの予算を検討しており、12 か月以内に納品できるでしょう。」とライス氏は言います。

残りの部分を構築するには 36 ~ 48 か月かかり、大まかに見積もっても 1,500 万ドルかかるとライス氏は見積もっています。最先端のバージョンを追加すると最大 2,400 万ドルになります。 高額に聞こえるかもしれませんが、これを掘り下げてください。中規模の死体研究室を運営するには、医学部で年間約 300 万ドルから 400 万ドルの費用がかかります。 少数の医学部がこのアイデアに参加すれば、数年以内に数百万ドルを節約できるでしょう。 そして、死者の輸送、保存、返却、火葬などの問題に対処する必要もなくなる。 「おそらく医学教育の全体的なコストは削減されるでしょう」とライス氏は言う。

しかしチームはまだプロジェクトを支援してくれる投資家を見つける必要があり、それにはイーロン・マスク、ビル・ゲイツ、マーク・キューバン、マーク・ザッカーバーグのような人物が必要になるだろうとライス氏は言う。 「個人は、先進技術と従来の医療を統合する機会の擁護者になる必要があります」と彼は言います。 「私たちは、この機会をサポートしたいと考えている投資家の心と心に触れる必要があります。」

編集者のおすすめ

- CRISPR 101: 世界を変える遺伝子編集ツールに関する短期集中コース

ライフスタイルをアップグレードするDigital Trends は、読者が最新ニュース、楽しい製品レビュー、洞察力に富んだ社説、ユニークなスニーク ピークをすべて提供して、ペースの速いテクノロジーの世界を監視するのに役立ちます。