Da Journey's "Non smettere di crederci" a Queen's "Bohemian Rhapsody" a Kylie Minogue "Non riesco a toglierti dalla testa”, ci sono alcune canzoni che riescono a insinuarsi con successo nei nostri canali uditivi e a stabilirsi nel nostro cervello. E se fosse possibile leggere i segnali del cervello e usarli per indovinare con precisione quale canzone una persona sta ascoltando in un dato momento?

Contenuti

- Leggere la mente, allenare le macchine

- La strada verso le interfacce cervello-computer

Questo è ciò che dicono i ricercatori del dipartimento di Human-Centered Design della Delft University of Technology Paesi Bassi e il dipartimento di Scienze Cognitive dell'Indian Institute of Technology Gandhinagar lavorando su. In un recente esperimento, hanno dimostrato che è assolutamente possibile e che le implicazioni potrebbero essere più significative di quanto si possa pensare.

Video consigliati

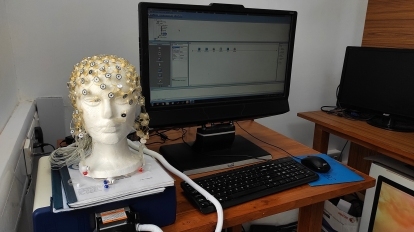

Per lo studio, i ricercatori hanno reclutato un gruppo di 20 persone. e ha chiesto loro di ascoltare 12 canzoni utilizzando

cuffie. Per facilitare la concentrazione, la stanza è stata oscurata e i volontari sono stati bendati. Ciascuno era dotato di una cuffia per elettroencefalografia (EEG) in grado di rilevare in modo non invasivo l'attività elettrica sul cuoio capelluto mentre ascoltavano le canzoni.Questi dati cerebrali, insieme alla musica corrispondente, sono stati poi utilizzati per addestrare un rete neurale artificiale essere in grado di identificare i collegamenti tra i due. Quando l’algoritmo risultante è stato testato su dati mai visti prima, è stato in grado di identificare correttamente la canzone con una precisione dell’85%, basandosi interamente sulle onde cerebrali.

"Le canzoni erano un mix di canzoni occidentali e indiane e includevano diversi generi", Krishna Miyapuram, assistente professore di scienze cognitive e informatica presso l'Indian Institute of Technology Gandhinagar, ha dichiarato a Digital Trends. “In questo modo, abbiamo costruito un campione rappresentativo più ampio per la formazione e i test. L’approccio è stato confermato ottenendo accuratezze di classificazione impressionanti, anche quando abbiamo limitato i dati di addestramento a una percentuale inferiore del set di dati”.

Leggere la mente, allenare le macchine

Questa non è la prima volta che i ricercatori dimostrano che è possibile effettuare dimostrazioni di “lettura della mente” che farebbero ingelosire David Blaine, il tutto utilizzando i dati EEG. Ad esempio, i neuroscienziati dell’Università canadese di Toronto Scarborough hanno precedentemente ricostruito immagini basate sui dati EEG ricreare digitalmente le immagini dei volti immagazzinato nella mente di una persona. Quello di Miyapuram proprie ricerche precedenti include un progetto in cui i dati EEG sono stati utilizzati per identificare i filmati visualizzati dai partecipanti, ciascuno destinato a provocare una risposta emotiva diversa.

È interessante notare che quest'ultimo lavoro ha dimostrato che gli algoritmi si sono rivelati molto efficaci nell'indovinare le canzoni ascoltate da un partecipante, dopo essere stato addestrato sul suo cervello specifico, non funzionerebbe così bene se applicato a un altro persona. In effetti, “non così bene” è un grosso eufemismo: la precisione di questi test è crollata dall’85% a meno del 10%.

"La nostra ricerca mostra che gli individui hanno esperienze musicali personalizzate", ha detto Miyapuram. “Ci si aspetterebbe che il cervello risponda in modo simile elaborando informazioni provenienti da stimoli diversi. Questo è vero per ciò che intendiamo come funzionalità di basso livello o funzionalità di livello di stimolo. [Ma] quando si tratta di musica, forse sono le caratteristiche di livello superiore, come il divertimento, a distinguere le esperienze individuali”.

Derek Lomas, assistente professore di A.I. positiva presso l'Università di Tecnologia di Delft, ha affermato che uno degli obiettivi futuri del progetto è quello di mappare la relazione tra le frequenze EEG e le frequenze musicali. Ciò potrebbe aiutare a rispondere a domande come se una maggiore risonanza estetica sia accompagnata da una maggiore risonanza neurale.

In altre parole, una persona che viene “commossa” da un brano musicale mostrerà maggiori correlazioni tra la musica stessa e il brano musicale stesso. risposta cerebrale, rendendo possibile prevedere con precisione quanto una persona apprezzerà un brano musicale semplicemente osservando le sue onde cerebrali? Sebbene la risposta di ognuno alla musica possa essere leggermente diversa, ciò potrebbe aiutare a far luce sul motivo per cui gli esseri umani cercano la musica per cominciare.

La strada verso le interfacce cervello-computer

“Per le applicazioni a breve termine [nei prossimi due anni], immaginiamo un motore di raccomandazione musicale che potrebbe essere basato sulla risposta cerebrale di una persona”, ha detto Lomas a Digital Trends. “Attualmente ho uno studente che lavora su musica generata algoritmicamente che massimizza la risonanza neurale. È piuttosto inquietante: la massima risonanza neurale non è la stessa cosa della massima risonanza estetica”.

Nel medio termine, Lomas ha suggerito che potrebbe portare a potenti applicazioni per ottenere informazioni sulla “profondità dell’esperienza” di cui gode una persona che interagisce con i media. Usando gli strumenti di analisi del cervello, potrebbe (e, in effetti, dovrebbe) essere possibile prevedere con precisione quanto profondamente sia coinvolta una persona mentre, ad esempio, guarda un film o ascolta un album. Una misura del coinvolgimento basata sul cervello potrebbe quindi essere utilizzata per affinare esperienze specifiche. Vuoi rendere il tuo film più coinvolgente per il 90% degli spettatori? Modificare Questo scena, cambiamento Quello uno.

“A lungo termine – 20 anni – questo campo di lavoro può consentire metodi per trascrivere i contenuti dell’immaginazione”, ha continuato Lomas. “Ad esempio, trascrivere i pensieri in testo. Questo è il grande futuro delle [interfacce cervello-computer.]”

Come ha osservato Lomas, siamo ancora lontani dall’obiettivo finale di un’interfaccia cervello-computer. Tuttavia, lavori come questo suggeriscono che ci sono molti frutti gustosi su quell’albero prima che finalmente lo abbattiamo.

UN articolo che descrive questa ricerca, intitolato GuessTheMusic: Song Identification from Electroencephalography, è stato recentemente presentato al CODS-COMAD 2021.

Raccomandazioni degli editori

- Apprendimento profondo dell'intelligenza artificiale può imitare gli effetti di distorsione degli iconici dei della chitarra

Migliora il tuo stile di vitaDigital Trends aiuta i lettori a tenere d'occhio il frenetico mondo della tecnologia con tutte le ultime notizie, divertenti recensioni di prodotti, editoriali approfonditi e anteprime uniche nel loro genere.